MiniMax Multimodale Generierungstechnologie erneuert: Motivreferenz, Referenzporträtbilder zur Generierung stilistisch konsistenter Videos

Jeder hat einen Filmtraum im Herzen - er möchte in verschiedene Rollen schlüpfen, um das Leben im Theater zu erleben, oder ein Regisseur werden, um jede Einstellung zu choreografieren, oder als Drehbuchautor über die unendlichen Möglichkeiten im Paralleluniversum schreiben.

Conch AI ist eine Traummaschine, die es verschiedenen Menschen ermöglicht, sich dem Film zu nähern. Zu Beginn des neuen Jahres bringt Conch AI einen neuen kreativen Helfer - Subject Reference - für Nutzer auf der ganzen Welt.

MiniMax Neuestes selbstentwickeltes S2V-01 VideomodellMit Hilfe desSingle Figure Body Referenzarchitekturmit traditionellen ProgrammenEingabe- und Berechnungskosten bis zu 1%Geben Sie einfach einEin Bild.Dies kann erreicht werden durchGenaue Wiedergabe von visuellen DetailsAuch verfügbarHoher Freiheitsgrad und Kombinierbarkeit. BenutzerErhebliche Verkürzung der Wartezeit, um eine hohe Verfügbarkeit zu erreichen.

Die Hauptreferenzfunktion ist jetzt weltweit vollständig online, gehen Sie auf die Seite Muschel-Video Die Erstellungsplattform ist sofort erlebbar.

Eingabe eines Bildes, Ausgabe eines High-Definition-Blockbusters

Im Bereich der KI-Videoproduktion ist es ein schwieriges Problem für die Industrie, wie man den Realismus und die Stabilität der Gesichter von Charakteren aus verschiedenen Blickwinkeln in dynamischen Videos beibehalten kann und wie man die Rollen der Charaktere in hohem Maße konsistent halten kann, wenn man kontinuierliche Clips zur Erstellung verwendet. Mit unserem selbstentwickelten S2V-01-Videomodell bieten wir den Benutzern eine optimale Lösung.

Nach Auswahl der Funktion "Betreff-Referenz" in Conch AI müssen Benutzer nur ein Bild hochladen, um die Betreff-Rolle zu identifizieren und zu sperren. Geben Sie das Aufforderungswort in das Textfeld ein. Sie brauchen nicht lange zu warten, sondern können kreative und konsistente Videos in hoher Qualität erstellen.

Das S2V-01-Modell ist in der Lage, Gesichtsmerkmale wie unterschiedliche Geschlechter, Altersgruppen, Hautfarben und Strukturen der Gesichtszüge in den Fotos genau zu erkennen, und die generierten Charaktere sind stabil und kohärent, und die Charaktere können in jedem Bild konsistent gehalten werden. Die Steuerung des Gesichtsausdrucks der Hauptfigur und die Textur der Nicht-Subjekt-Szene sind nach wie vor die "Spezialität" von Conch AI.

Hauptbezug + Aufforderung: Nahaufnahme eines kleinen Jungen in einem schwach beleuchteten Raum, dessen Augen auf den leuchtenden Bildschirm einer Spielkonsole gerichtet sind. Die Kamera ist leicht über der Augenhöhe positioniert und fokussiert auf seinen konzentrierten Gesichtsausdruck, während seine Finger flink den Controller bedienen. Die Kamera ist leicht oberhalb der Augenhöhe positioniert und fokussiert auf seinen konzentrierten Gesichtsausdruck, während seine Finger flink den Controller bedienen. Ein Spiel Zeichen erscheint und löst sich aus der Begrenzung des Bildschirms.

Der Schöpfer @OlivioSarikas hat ein Anime-Porträt in Öl auf Leinwand hochgeladen, das Gegenstand einer Animation ist, die den Betrachter in ein Märchenland entführt.

Derzeit bietet Conch AI die Möglichkeit, auf eine einzelne Person Bezug zu nehmen, was das Hochladen von erkennbaren Gesichtsinformationen als Gesichtsreferenz erfordert, die vom Videoobjekt erzeugt wurde. In Zukunft wird Conch AI die Möglichkeit bieten, auf mehrere Personen, Objekte und Szenen zu verweisen, sowie andere, umfassendere Funktionen.

Drastische Senkung der Eingabe- und Berechnungskosten, Neugestaltung des Videoerstellungsprozesses

MiniMax hat seit seinen Anfängen kontinuierlich die Fähigkeit der Bildreferenz erforscht, einschließlich Rollen, Stile usw. Auf der Grundlage zahlreicher technischer Untersuchungen sind wir der Meinung, dass die Obergrenze der Wirkung des Bildreferenzschemas für das Problem der Fachklassenreferenz hoch genug ist und sogar besser als das fein abgestimmte LoRA-Schema (Low-Rank Adaptation), wenn man die Wirkung und Skalierbarkeit berücksichtigt.Wir sind der Meinung, dass eine gute Technologie ein möglichst breites Spektrum von Nutzern bedienen können sollte und gleichzeitig gut genug funktioniert, um echte Probleme zu lösen.

Da das MiniMax-Subjektreferenzschema nur ein Bild als Eingabe benötigt, fallen keine zusätzlichen Trainingskosten und Wartezeiten an, und die Generierungskosten liegen nahe an denen herkömmlicher text- und graphgenerierter Videos.Im Vergleich zu aktuellen LoRA-Lösungen reduziert die Themenreferenzierung sowohl die Kosten für die Benutzereingabe als auch die Berechnungskosten auf weniger als ein Prozent, wobei die Wartezeit der Benutzer erheblich verkürzt und die Benutzerfreundlichkeit verdoppelt wird.

Hauptbezug + Aufforderung: Eine Frau in einem aufwändigen Kleid und einem Paar weißer Handschuhe geht durch einen Korridor in einer mittelalterlichen Burg. Sie läuft mit dem Rücken zur Kamera, blickt dann wieder in die Kamera, wobei ihr Gesichtsausdruck von Ruhe zu Entsetzen wechselt. Sie läuft mit dem Rücken zur Kamera, blickt dann wieder in die Kamera, wobei ihr Gesichtsausdruck von Ruhe zu Entsetzen wechselt. Das Ende des Ganges ist schwach beleuchtet. Die Kamera folgt der Frau, die immer näher kommt, und die Einstellung wechselt von einer Mittel- zu einer Nahaufnahme, in der das Gesicht der Frau im Mittelpunkt steht.

Um nur die notwendigen visuellen Informationen des Subjekts (z.B. menschliche Gesichtszüge) im Video zu erhalten, ohne dass andere Informationen wie Körperhaltung, Mimik, Beleuchtung usw. stören, hat MiniMax die Datenkonstruktion, die Modellarchitektur und die Trainingsstrategie weiter optimiert. Mit dem Modell S2V-01, das bereits online ist, haben wir den Schlüsseleffekt beider Aspekte gleichzeitig erreicht:

- Genaue Wiedergabe von visuellen Details:Die Gesichtszüge der Charaktere in den generierten Videos weisen einen hohen Grad an Ähnlichkeit mit den Referenzbildern auf;

- Hohe Freiheit + Kombinierbarkeit:Abgesehen von den Gesichtszügen, die die Identität darstellen, haben alle anderen Dimensionen einen hohen Freiheitsgrad. Zum Beispiel kann die Figur textgesteuert werden, um jede Pose und jeden Ausdruck zu zeigen; die Figur kann in jeder Umgebung mit natürlicher und harmonischer Beleuchtung platziert werden.

Mit der Themenreferenztechnologie sind die Benutzer nicht mehr gezwungen, Konsistenzprobleme durch Kartenziehen zu lösen, sondern können sich mehr auf den Ausdruck der Inhalte konzentrieren, was die Effizienz bei der Erstellung langer Videoinhalte erheblich steigert.Ihre Rolle ist natürlich konsequent.

Visuelle Modalitäten eröffnen eine Ära der KI-Ko-Innovation

Die KI-Technologie hat die Produktion von Inhalten wie Mikrofilmen, Werbung, Abwechslung, Animationen, CG-Effekten usw. vereinfacht. Das größte Problem ist jedoch, dass das Videomaterial während des Erstellungsprozesses leicht zusammenbricht und es den präsentierten Inhalten oft an Flexibilität mangelt und ein Gefühl der Fragmentierung entsteht.

Die Einführung der Master Reference-Funktion bietet professionellen Videoproduzenten eine äußerst konsistente visuelle Präsentation und kreative Flexibilität und stellt eine bahnbrechende Innovation für verschiedene Bereiche der Videoproduktion dar, einschließlich Kurzvideos und Werbespots, so dass Konsistenz und Kohärenz kein Problem mehr darstellen.Gegenwärtig stellt MiniMax die Fachreferenzfunktion auf die offene Plattform in Form eines API-Dienstes und wird weiterhin den Aspekt der Multi-Fachreferenz erforschen, um perfekte Lösungen für Unternehmen und professionelle Ersteller anzubieten.

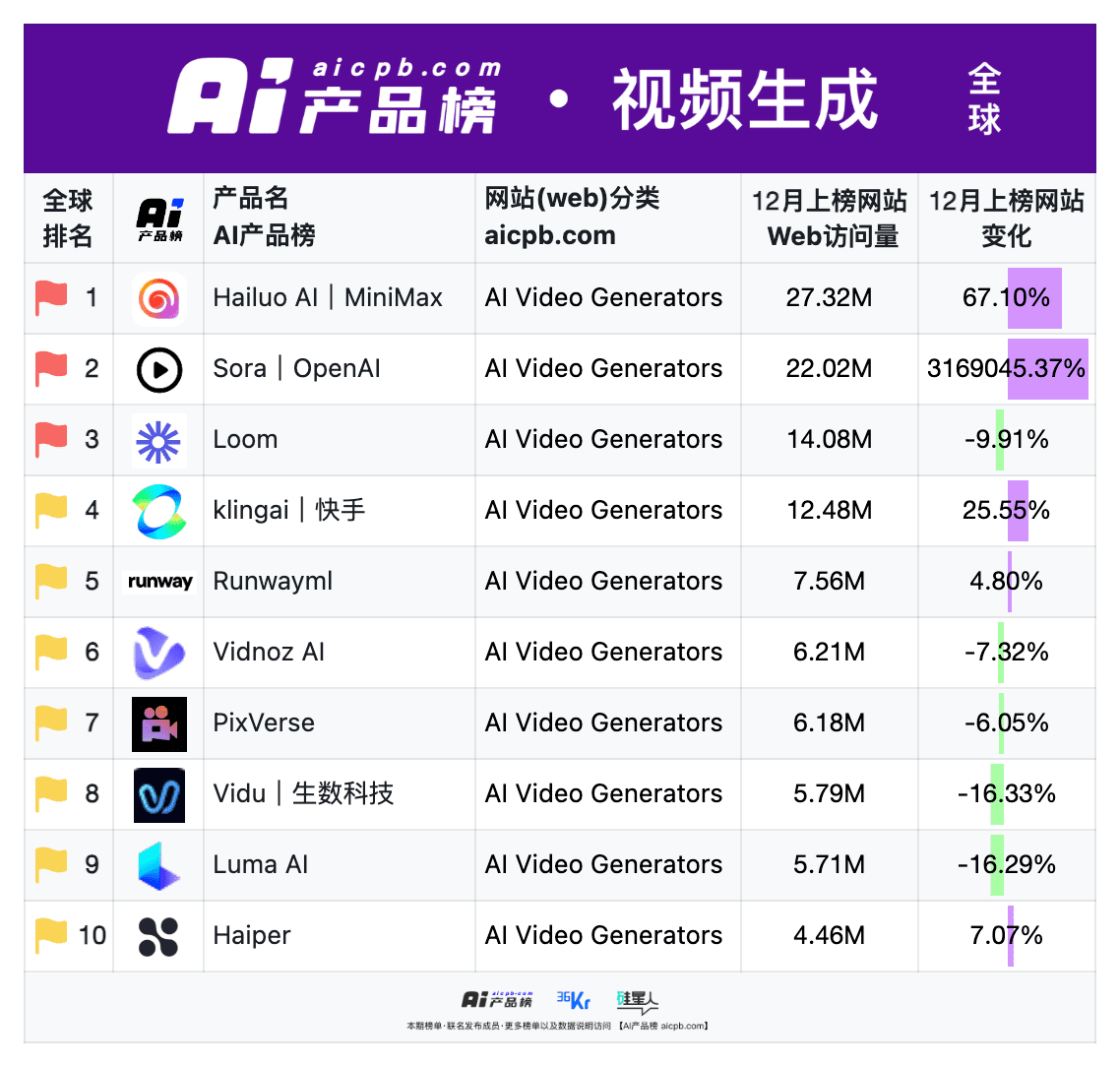

Seit MiniMax sein Videomodell auf den Markt gebracht hat, steht Conch AI weiterhin im Mittelpunkt des Interesses der Branche.2024 Im Dezember fand I2V-01-Live, ein von MiniMax eingeführtes grafisches Videomodell, großen Anklang, und die Zahl der Besuche von Conch AI im Ausland überstieg 27 Millionen, womit ein neuer Höchststand erreicht wurde und die Liste der weltweiten AI-Videoprodukte im Dezember angeführt wurde.

- Globale AI Video Produktliste Dezember 2024

Die Art und Weise, wie Menschen mit der Welt interagieren, ist von Natur aus multimodal, so dass multimodales Verstehen und Erzeugen genau das entscheidende Bindeglied zu AGI und der Eröffnung der Ära der KI-Ko-Kreation ist. Wir erwarten, dass mehr Nutzer mit MiniMax Intelligenz miterschaffen und die Freude an der Schöpfung von Conch AI genießen werden. Hier haben wir eine Anleitung zum Spielen mit der Themenreferenzfunktion vorbereitet. Klicken Sie auf den Originalartikel, um dorthin zu gelangen. Vielen Dank an alle, die MiniMax und Conch AI unterstützen und lieben.

© urheberrechtliche Erklärung

Artikel Copyright AI-Austauschkreis Alle, bitte nicht ohne Erlaubnis vervielfältigen.

Ähnliche Artikel

Keine Kommentare...