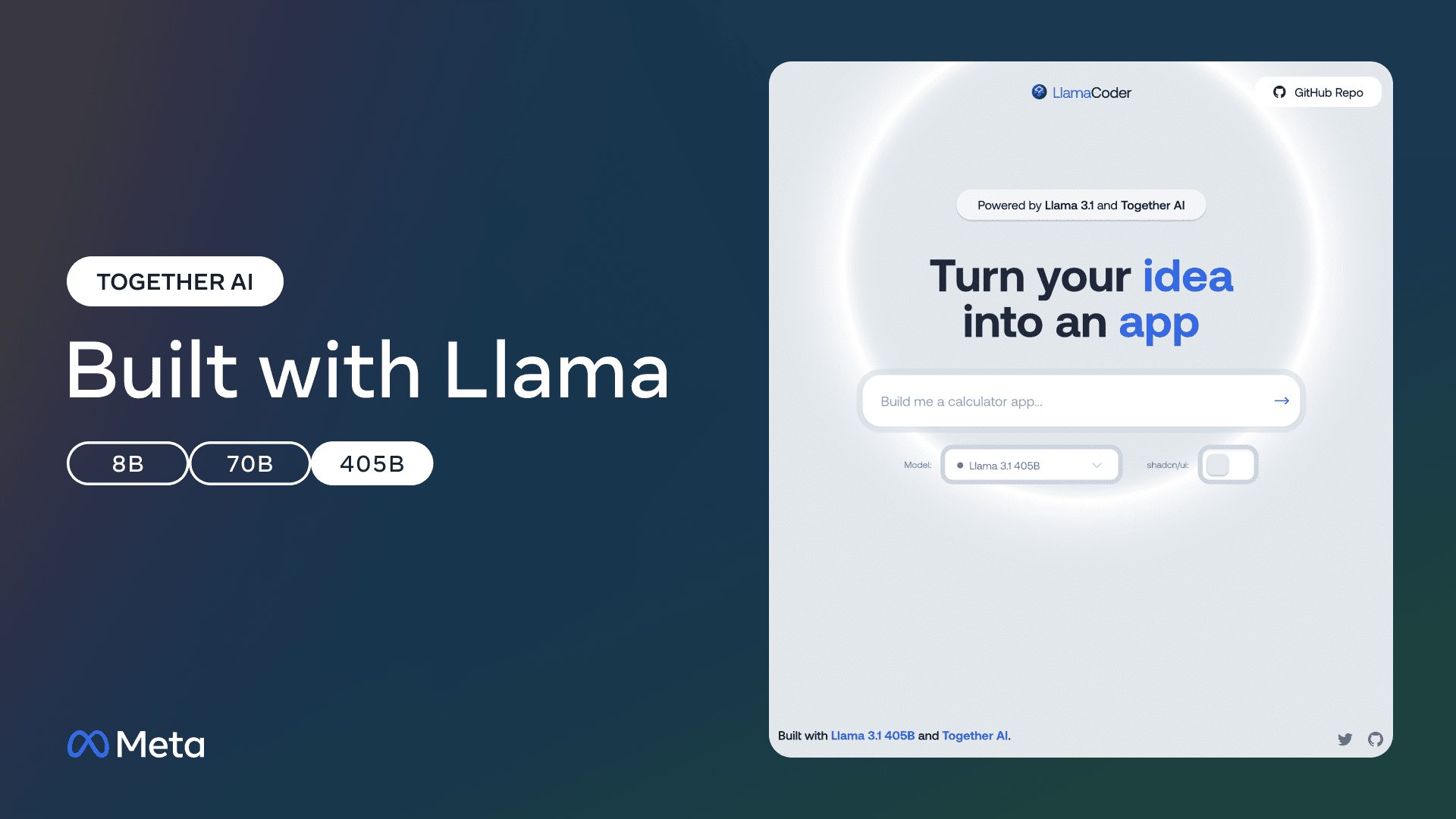

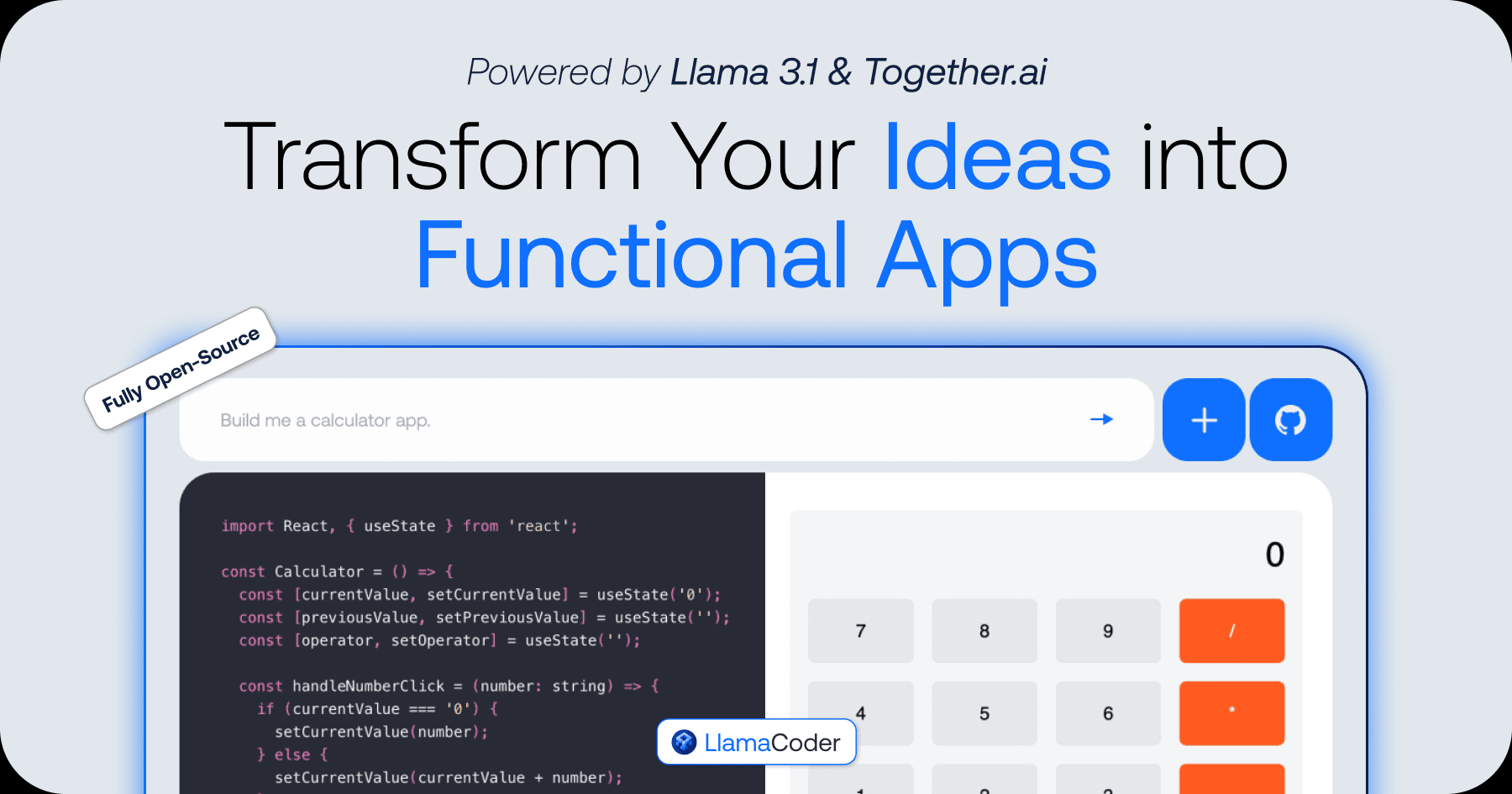

LlamaCoder: Schnelles Generieren und Veröffentlichen kleiner Webanwendungen mit Prompt Words

Allgemeine Einführung

LlamaCoder ist eine Software, die auf Llama 3.1 und dem Gemeinsam LlamaCoder ist ein Open-Source-Tool zur Codegenerierung für KI. LlamaCoder bietet ein reichhaltiges Funktionsmodul und flexible Anpassungsoptionen, die eine Vielzahl von Programmiersprachen und Frameworks unterstützen, um den Benutzern zu helfen, die Code-Entwicklungsaufgabe effizient zu erledigen.

Funktionsliste

- Codegenerierung: Generieren Sie vollständigen Anwendungscode mit einfachen Eingabeaufforderungen.

- Mehrsprachige Unterstützung: Unterstützung für eine Vielzahl von Programmiersprachen wie Python, JavaScript usw.

- Anpassungsoptionen: Bietet umfangreiche Anpassungsoptionen, mit denen die Benutzer die Parameter des generierten Codes an ihre Bedürfnisse anpassen können.

- Code-Sandbox: Integration der Sandpack-Code-Sandbox, benutzerfreundliches Online-Testen und Debuggen von Code.

- Beobachtungsfunktionalität: Verwenden Sie Helicone zur Codebeobachtung und -analyse.

- Website Analytics: Integrieren Sie Plausible für die Analyse des Website-Traffics.

Hilfe verwenden

Einbauverfahren

- Klon-Lagerhaus:

git clone https://github.com/nutlope/llamacoder - einrichten.

.envund fügen Sie den Together-AI-API-Schlüssel hinzu:TOGETHER_API_KEY=your_api_key - Installieren Sie die Abhängigkeiten und starten Sie die lokale Entwicklungsumgebung:

npm install npm run dev

Leitlinien für die Verwendung

- Codegenerierung::

- Öffnen Sie die LlamaCoder-Website oder eine lokal laufende Anwendung.

- Geben Sie in das Eingabefeld eine Beschreibung Ihrer Bewerbungsanforderungen ein.

- Klicken Sie auf die Schaltfläche "Code generieren" und LlamaCoder wird automatisch den entsprechenden Code generieren.

- Unterstützung mehrerer Sprachen::

- Bei der Codegenerierung können Sie die gewünschte Programmiersprache auswählen.

- LlamaCoder unterstützt mehrere Sprachen, um sicherzustellen, dass der erzeugte Code Ihren Anforderungen entspricht.

- Anpassungsmöglichkeiten::

- Vor der Codegenerierung können Sie die Generierungsparameter, wie z. B. den Codestil, die Bibliotheksabhängigkeiten usw., über die Einstellungsschnittstelle anpassen.

- Diese Optionen können Ihnen helfen, Code zu erzeugen, der den Anforderungen Ihres Projekts besser entspricht.

- Code-Sandbox::

- Sobald der Code generiert ist, kann er direkt in der integrierten Sandpack Code Sandbox getestet und debuggt werden.

- Code Sandbox bietet Echtzeitvorschauen und Fehlermeldungen, damit die Benutzer Probleme schnell finden und beheben können.

- Anzeigefunktion::

- Verwenden Sie Helicone zur Codebeobachtung und -analyse, um zu verstehen, wie Ihr Code funktioniert und läuft.

- Die Watch-Funktion hilft den Benutzern, ihren Code zu optimieren und die Effizienz ihrer Anwendung zu verbessern.

- Analyse der Website::

- Integrieren Sie Plausible für die Analyse des Website-Traffics, um zu verstehen, wie auf Ihre Website zugegriffen wird und wie sich die Nutzer verhalten.

- Die Webanalysefunktion liefert detaillierte Datenberichte, die datengestützte Entscheidungen erleichtern.

typisches Beispiel

Angenommen, Sie möchten eine einfache Anwendung für eine Aufgabenliste erstellen, dann können Sie die folgenden Schritte ausführen:

- Geben Sie in das Eingabefeld "Eine einfache Anwendung für die Aufgabenliste erstellen" ein.

- Wählen Sie die Programmiersprache (z. B. JavaScript).

- Klicken Sie auf die Schaltfläche "Code generieren" und LlamaCoder wird den entsprechenden Code generieren.

- Testen und debuggen Sie den generierten Code in der Sandpack-Code-Sandbox.

- Beobachten Sie die Leistung Ihres Codes mit Helicone und analysieren Sie den Website-Traffic mit Plausible.

Mit diesen Schritten können Sie schnell eine voll funktionsfähige To-Do-Listen-Anwendung erstellen und optimieren.

Mit dem LlamaCoder von Together AI vollständige Apps aus Eingabeaufforderungen generieren

Gemeinsam AI, die führende Cloud-Plattform zur KI-Beschleunigung, unterstützt Entwickler und Unternehmen bei der nahtlosen Gestaltung, Entwicklung und Verwaltung ihres gesamten generativen KI-Lebenszyklus auf der Grundlage von Open-Source-Modellen wie Llama.

Um Entwickler zu inspirieren, die auf Llama aufbauen, hat Together AI die LlamaCoder-Anwendung-eine Open-Source-Webanwendung, die es Benutzern ermöglicht, mit Llama 3.1 405B vollständige Anwendungen aus Eingabeaufforderungen zu erstellen.

In nur einem Monat seit seiner Veröffentlichung hat sich Together AI zu einem viralen Hit entwickelt. Über 2.000 GitHub-Stars und Hunderte von Entwicklern haben das Repository geklont und über 200.000 Apps mit LlamaCoder erstellt.

"Die Entwickler sind begeistert", sagt Hassan El Mghari, Software Engineer und Head of Developer Relations bei Together AI. "Es ist unglaublich zu sehen, wie die Leute Quiz-Apps, Tomatenuhren, Budget-Apps und vieles mehr nur mit Hilfe von Prompts entwickeln und an ihre Bedürfnisse anpassen. Das zeigt die Leistungsfähigkeit von Llama 3.1 405B."

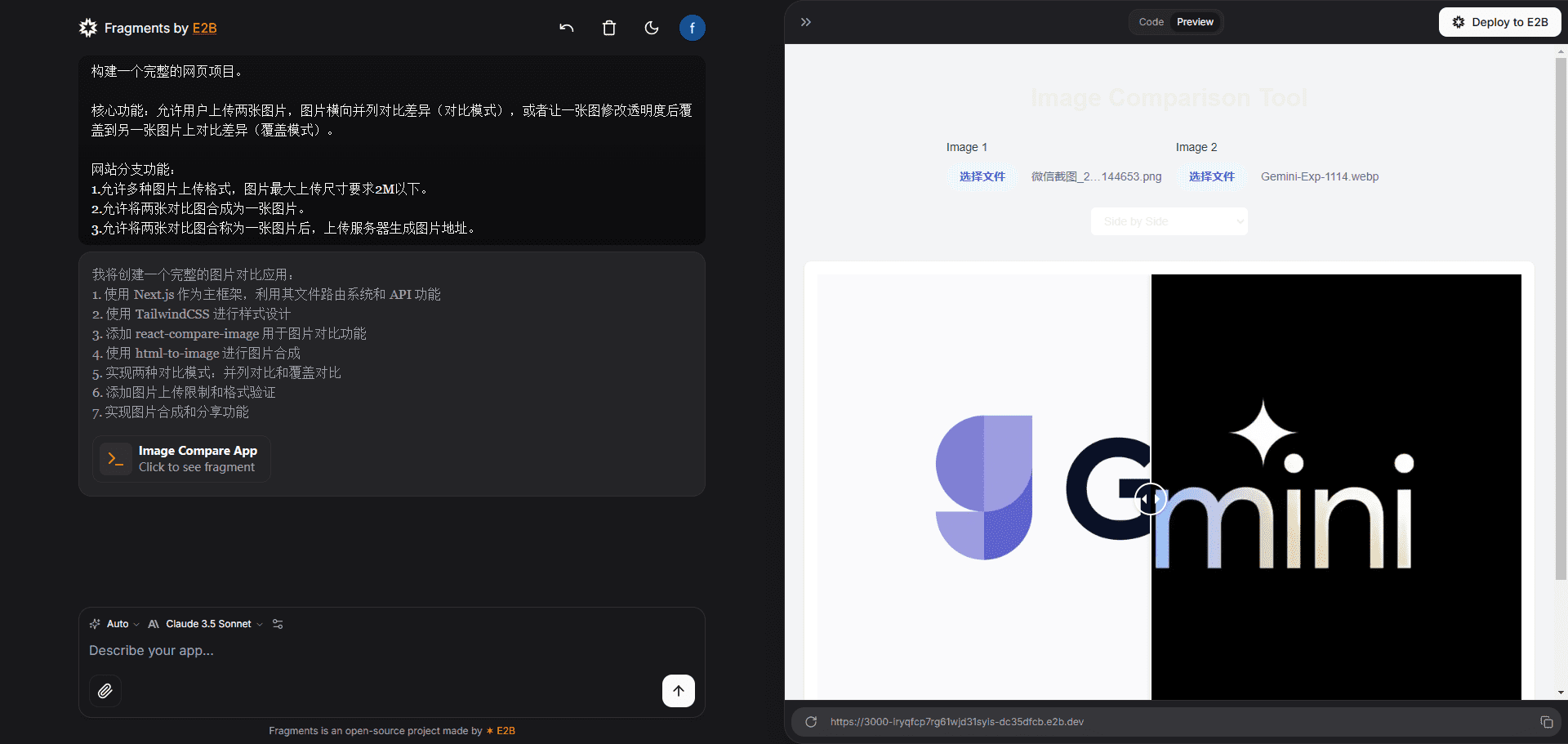

In diesem Beispiel erstellt Llamacoder eine Anwendung für ein Geschichtsquiz.

Er fügte hinzu, dass Llama 3.1 405B das erste Open-Source-Modell ist, das in diesem speziellen Anwendungsfall gut abschneidet.Together AI hat auch eine Reihe anderer Beispielanwendungen entwickelt, die Llama 3.1 verwenden, darunter LlamaTutoreine App, die Menschen beim Lernen hilft, und TurboSeekeine KI-gestützte Suchmaschine.

"Das Llama-Modell verschiebt die Grenzen von Open-Source-Modellen für große Sprachen, um mit den besten Closed-Source-Modellen konkurrieren zu können, und bietet gleichzeitig sichere Werkzeuge für eine verantwortungsvolle Entwicklung", sagte El Mghari. Er erwähnte auch, dass die bahnbrechenden Fähigkeiten von Llama 3.1 405B in den Bereichen Allgemeinwissen, Kontrollierbarkeit, Mathematik, Werkzeugnutzung und mehrsprachige Übersetzung das Potenzial haben, die Annahme von Open-Source-KI durch Entwickler und Unternehmen zu beschleunigen.

Erweiterung der Nutzungsszenarien mit jeder neuen Version

Mehr als 150.000 Entwickler und Unternehmen nutzen die Together-Plattform für eine breite Palette von Anwendungsszenarien, darunter Spiele, Kundenservice, Benchmarking und die Erstellung von Zusammenfassungen. Während sie die Together-Plattform für generative KI-Anwendungen nutzen, behält jeder Entwickler und jedes Unternehmen das Eigentum an seinen Feinabstimmungsgewichten und kann sie für andere Nutzungsszenarien herunterladen.

In diesem Beispiel erstellt Llamacoder eine Anwendung zur Budgetierung.

"Unsere Vision ist es, Forschungsinnovationen so schnell wie möglich in Produktionsumgebungen einzuführen. Die Together-Inferenz-Engine basiert auf unserer führenden Forschung zur Inferenzoptimierung und nutzt Innovationen wie den FlashAttention-3-Kernel, einen benutzerdefinierten Prädiktor auf Basis von RedPajama und die genauesten Quantifizierungsverfahren auf dem Markt", so El Mghari. "Diese Fortschritte ermöglichen es Entwicklern, generative KI-Anwendungen auf der Grundlage von Llama 3.1-Modellen im Produktionsmaßstab zu erstellen und auszuführen, und zwar mit einer unübertroffenen Leistung, Genauigkeit und Kosteneffizienz."

Dies wurde durch einen offenen Ansatz ermöglicht, sagt El Mghari und fügt hinzu, dass viele Unternehmen, die Together AI nutzen, von Closed-Source-Anbietern zu Together AI gewechselt sind, weil sie die Vorteile von Open Source nutzen wollen.

"Open-Source-KI ist ein Wendepunkt für die KI-Gemeinschaft", sagte er. "Es ist im besten Interesse aller Entwickler und wird zu den schnellsten Fortschritten und Innovationen führen. Darüber hinaus ermöglicht es den Unternehmen, ihre Daten und Modelle wirklich selbst zu nutzen und völlig flexibel zu sein, anstatt sich festzulegen.

© urheberrechtliche Erklärung

Artikel Copyright AI-Austauschkreis Alle, bitte nicht ohne Erlaubnis vervielfältigen.

Ähnliche Artikel

Keine Kommentare...