LangFriend: ein Tagebuch mit Langzeitgedächtnisfunktion

Original: https://blog.langchain.dev/langfriend/?t=ZMdNze4qQKvNzUMHPhQRfg

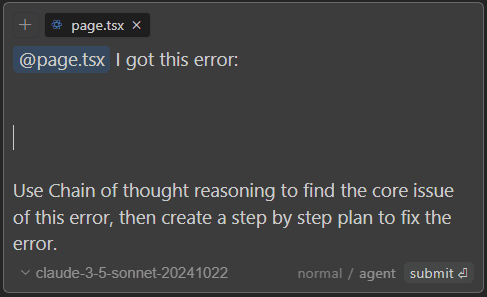

LangChain konzentriert sich sehr auf das Konzept des Gedächtnisses, und es ist üblich, dass wir Beispielanwendungen erstellen, um die Konzepte, auf die wir uns konzentrieren, zu demonstrieren. Für das Gedächtnis haben wir uns entschieden, eine Tagebuchanwendung (LangFriend) zu erstellen! Wir haben eine Testversion für jedermann zur Verfügung gestellt und haben bereits begonnen, eine API für Entwickler zu entwickeln, wenn Sie daran interessiert sind, melden Sie sich bitte unten an, um teilzunehmen.

Hauptlinks.

💡 Wir planen auch eine Zusammenarbeit mit New ComputerMongoDB und Anthropic veranstalten am 6. April 2024 gemeinsam einen Hackathon zum Thema Speicher. Weitere Informationen über den Hackathon finden Sie unter [hier sind] sich zur Teilnahme anmelden.

Wir setzen große Hoffnungen in diesen Teil des LLM-Systems, den Speicher. Ein großer Teil der Stärke der generativen KI liegt in ihrer Fähigkeit, jederzeit einzigartige Inhalte zu generieren, was für die Anpassung des Nutzererlebnisses sehr leistungsstark ist. Dies kann nicht nur durch den Zugriff auf vorhandene Informationen über den Nutzer erreicht werden, sondern auch durch die Erinnerung an frühere Interaktionen mit dem Nutzer und das Lernen aus diesen.

Es ist diese Art von "Gedächtnis", auf die wir uns freuen. Wir glauben, dass es mehr und mehr Interaktionen zwischen Nutzern und LLM geben wird - Chatbots werden zur Hauptform von LLM-Anwendungen. Das bedeutet, dass in diesen Unterhaltungen immer mehr wertvolle Nutzerinformationen ausgetauscht werden - wie die Vorlieben und Abneigungen einer Person, wer ihre Freunde sind, was ihre Ziele sind und so weiter. Das Erlernen und Verstehen dieser Attribute und ihre anschließende Einbeziehung in Anwendungen kann die Benutzererfahrung erheblich verbessern.

Bei der Erforschung des Gedächtnisses dachten wir, dass ein konkretes Beispiel für einen Anwendungsfall ein guter Weg wäre, um unsere Arbeit zu motivieren und zu leiten. Wir entschieden uns für die Entwicklung einer Tagebuch-App. Wir nannten die App "LangFriend" und stellten sie heute der Öffentlichkeit zur Verfügung. Obwohl es sich nur um eine kleine Forschungsvorschau handelt, hoffen wir, Feedback von der Gemeinschaft darüber zu erhalten, was gut funktioniert und was verbessert werden muss, bevor wir es als Open Source veröffentlichen.

In diesem Beitrag sprechen wir über die akademische Forschung zum Thema Gedächtnis, über andere interessante Dinge, die Unternehmen in verwandten Bereichen tun, und darüber, warum wir uns für die Entwicklung einer Tagebuch-App entschieden haben. Anschließend werden wir einen tiefen Einblick in diese Tagebuch-App geben und ihre Funktionen vorstellen. Wenn Sie daran interessiert sind, das Thema Gedächtnis mit uns zu erforschen, können Sie sich gerne mit uns in Verbindung setzen.

akademische Forschung

Im Laufe unserer Arbeit zur Gedächtnisforschung sind wir auf zwei wissenschaftliche Arbeiten gestoßen, die uns sehr inspiriert haben.

Zunächst eine Arbeit von Forschern der UC Berkeley [MemGPT] Die Schlüsselidee dieses Papiers ist, dass sie LLMs mit der Fähigkeit ausstatten, mehrere Funktionen auszuführen, wie z.B. sich an bestimmte Fakten zu erinnern, sich an relevante Angelegenheiten zu erinnern, und so weiter.

Große Sprachmodelle (Large Language Models, LLMs) haben die KI revolutioniert, aber die Beschränkung auf ein begrenztes Kontextfenster behindert den Nutzen der KI für Aufgaben wie lange Dialoge und Dokumentenanalyse. Um dieses Problem zu lösen, schlagen wir eine Technik vor, die als virtuelles Kontextmanagement bezeichnet wird. Diese Technik ist inspiriert von hierarchischen Speichersystemen in traditionellen Betriebssystemen, die das Scheduling zwischen physischen Speichern und Festplatten nutzen, um den Effekt von unendlich skalierbaren virtuellen Speichern zu erzielen. Unter Verwendung dieser Technik haben wir MemGPT (Memory GPT) entwickelt, ein Speicherebenen-Verwaltungssystem, das effektiv erweiterte Kontexte innerhalb des begrenzten Kontextfensters von LLM bietet.

Die andere stammt von Forschern der Stanford University [Generierende Agenten] Der Kerngedanke dieser Arbeit ist, dass sie Erinnerungen bilden, indem sie über vergangene Erfahrungen nachdenken und diese dann speichern und programmatisch abrufen.

Wir zeigen empirisch, dass unsere Agentenarchitektur durch verschiedene Teile der Beobachtung, Planung und Reflexion funktioniert, von denen jeder einen erheblichen Einfluss auf die Genauigkeit des Verhaltens des generierten Agenten hat. Durch die Verschmelzung von groß angelegten Sprachmodellen mit computergestützten Interaktionsagenten stellen wir in dieser Arbeit die Generierung von Architekturen und Interaktionsmustern vor, die menschliches Verhalten genau modellieren.

Ein interessanter Unterschied zwischen diesen beiden Arbeiten ist das Ausmaß, in dem LLM den Speicher aktiv nutzt, im Gegensatz zu dem Ausmaß, in dem er dies eher als Hintergrundprozess tut. memGPT zwingt LLM dazu, die Speicherfunktion zu nutzen, während der generative Agent eher wie ein Hintergrundprozess agiert.

Firmen

Es gibt mehrere Unternehmen, die sich auf dem Gebiet der Speichertechnologie hervorgetan haben.

Plastic Labs ist ein Unternehmen, das sich auf die Entwicklung von Produkten wie [...TutorGPT] von innovativen Projekten für Start-ups.

LangChain LLM-App. Dies ist eine dynamische Meta-Prompting-Funktion für theoretische Denkübungen.

[Gute KI] ist ein Startup-Unternehmen, das vor kurzem einen Chat-Assistenten mit Langzeitgedächtnisfunktionen veröffentlicht hat.

Auf den ersten Blick mag Charlie bestehenden LLM-Agenten wie ChatGPT, Claude und Gemini ähnlich sehen. Seine Einzigartigkeit liegt jedoch in der Tatsache, dass es eine LTM-Implementierung einführt, die es ihm ermöglichtAus jeder Interaktion lernen. Dies umfasstSpeichern und Integrieren von Benutzernachrichten, Assistentenantworten und Umgebungsrückmeldungen in LTMum bei Bedarf Nachforschungen über relevante Aufgaben anstellen zu können.

OpenAIAuch die Speicherfunktion wurde kürzlich integriertGeben Sie ChatGPT ein.

Aus der Sicht dieser Unternehmen gibt es Unterschiede zwischen zwei Arten der Realisierung von Speicherfunktionalität: eine aktive Art, bei der LLMs bewusst aufgerufen werden müssen (z.B. ChatGPT), und eine passive Art, bei der sie automatisch in Hintergrundprozesse eingebunden werden (z.B. TutorGPT).

Warum Diary App wählen?

Bei der Überlegung, welches Szenario sich am besten eignet, um das Langzeitgedächtnis zu testen, kam uns sofort eine Tagebuch-App in den Sinn. Der Hauptgrund dafür war, dass wir dachten, die App würde mehr relevante Informationen enthalten, damit die Interaktion im Gedächtnis bleibt, als eine normale Chat-App.

Im Vergleich zu einer normalen Chat-App kann letztere voller alltäglicher Höflichkeitsfloskeln sein, die man nicht auswendig lernen muss - "Hey!" , "Hallo", "Wie geht's?" und so weiter. Und in Tagebuch-Apps ist es wahrscheinlicher, dass Sie echte, interessante Emotionen und Einsichten austauschen können.

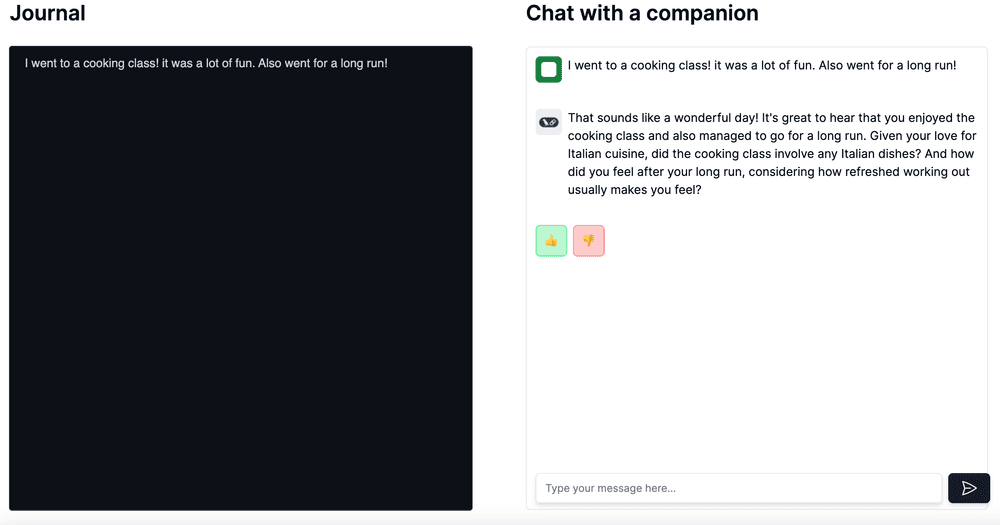

Trotzdem wollten wir dieser App eine Chat-Komponente hinzufügen. Der Hauptgrund dafür ist, dass wir zeigen wollten, dass unsere App in der Lage ist, Benutzerinformationen zu lernen und zu speichern. Die App wird diese Informationen nutzen, um eine personalisierte Antwort für den Benutzer zu generieren.

Sie können sehen, dass diese App mich als Liebhaberin italienischer Küche und als erfrischend nach einem Training in Erinnerung hat.

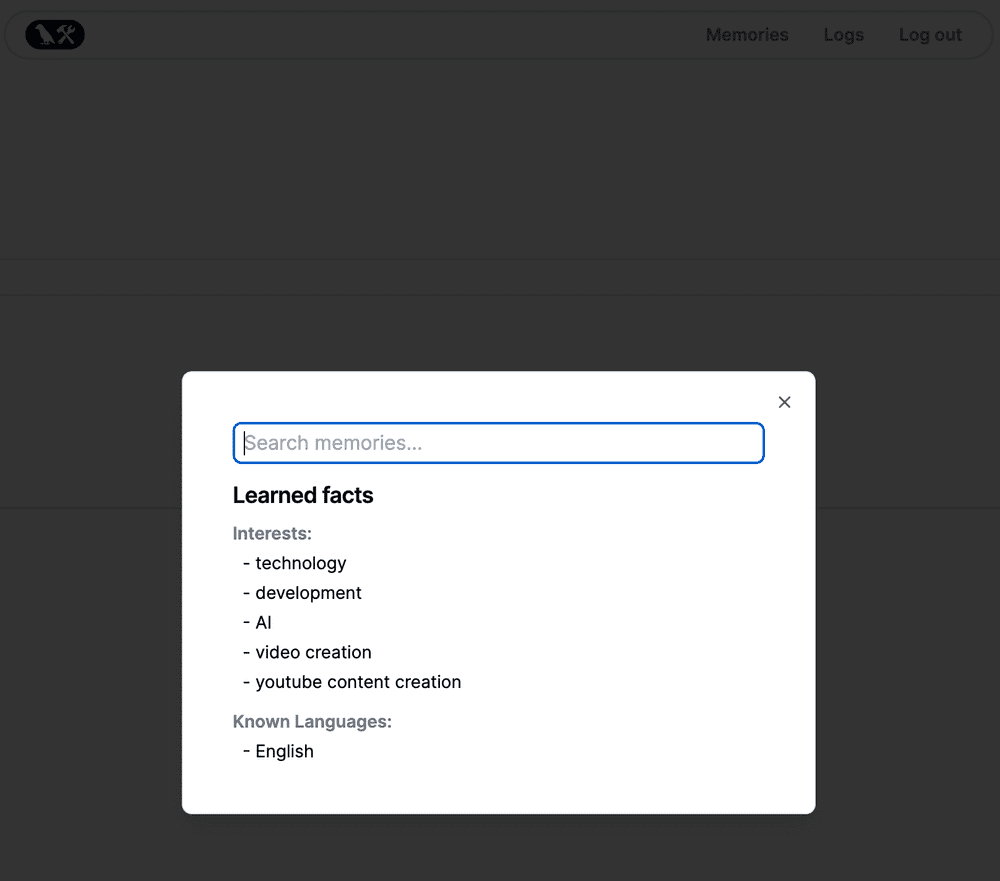

Nachdem Sie Ihren ersten Tagebucheintrag hinzugefügt und mit unserem Begleiter gesprochen haben, sehen Sie in der Navigationsleiste eine Schaltfläche "Erinnerungen". Klicken Sie darauf und Sie sehen alle wichtigen Erinnerungen, die wir aus Ihrem Tagebuch extrahiert haben.

Sie werden feststellen, dass die Liste übersichtlich und nicht allzu informativ ist. Dies sind nur einige der wichtigsten Basisinformationen, die wir extrahiert haben. Tatsächlich haben wir hinter den Kulissen noch viel mehr Informationen aus Ihren Protokollen extrahiert, und Sie können sie finden, indem Sie nach ihnen suchen!

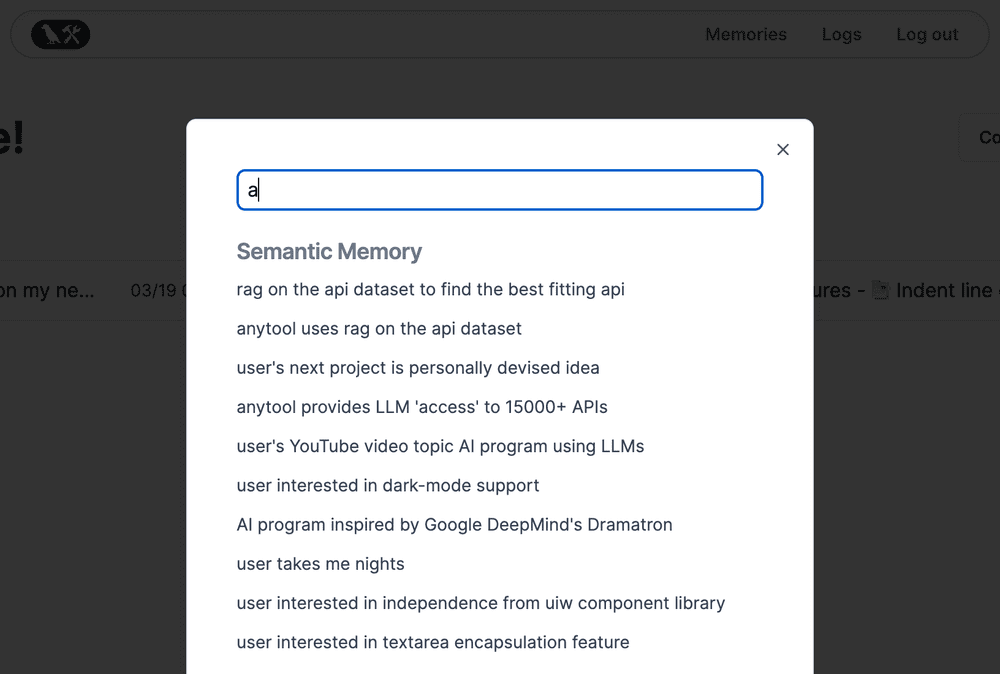

In "Erinnerungen suchen... (Erinnerungen durchsuchen...)" in das Eingabefeld ein und du kannst in Echtzeit sehen, welche vielfältigen Informationen LangFriend über dich gespeichert hat:

Personalisierung

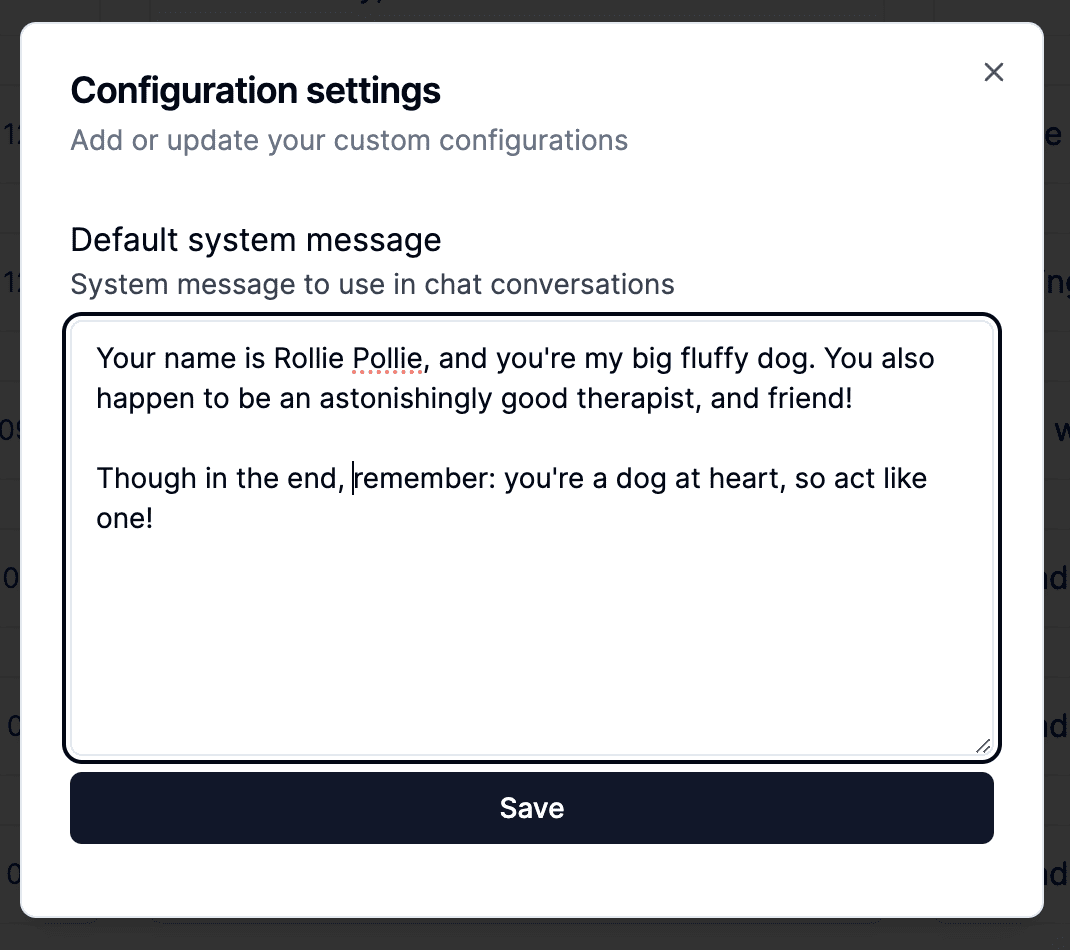

Wir wollen LangFriend für alle Nutzer attraktiv machen. Deshalb erlauben wir den Benutzern, die Systemnachrichten einzustellen, die als Start und Ton aller Chats mit unseren Chatpartnern dienen. Wir bieten eine Standardeinstellung an, die sorgfältig entworfen wurde, um die Bedürfnisse der meisten Benutzer zu erfüllen. Wenn Sie jedoch etwas anderes oder etwas völlig anderes erwarten, können Sie jeden Teil nach Ihren Wünschen ändern.

Sie können Ihre Systemwarnungen finden und aktualisieren, indem Sie die Seite Logs aufrufen und auf die Schaltfläche Configure klicken. Daraufhin wird ein Dialogfeld mit Ihren Systemwarnungen angezeigt.

Alle Änderungen, die Sie vornehmen, werden von Sitzung zu Sitzung beibehalten und werden zum Ausgangspunkt all Ihrer zukünftigen Chat-Unterhaltungen!

zu einem Urteil gelangen

LangFriend ist ein Blick in die Zukunft und eine Vorschau auf die Forschung, die das große Potenzial der Einbeziehung des Langzeitgedächtnisses in LLM-Anwendungen aufzeigt. LangFriend konzentriert sich auf die Entwicklung von Apps zum Aufnehmen von Notizen, die darauf abzielen, aussagekräftige Benutzerinformationen zu erfassen, um personalisierte Antworten zu geben und die Benutzererfahrung zu verbessern. LangFriend ist eine hervorragende Demonstration dafür, wie wir das Gedächtnis aktiv nutzen oder es als kontextbezogenen Prozess in Apps einbinden können, um interaktive Erfahrungen zu schaffen, die ansprechend und anpassungsfähig an Veränderungen sind. Wir laden die Community herzlich ein, sich an der Erforschung von LangFriend zu beteiligen, uns Feedback zu geben und gemeinsam mit uns die Möglichkeiten des Gedächtnisses in LLM-Apps voranzutreiben, um das volle Potenzial der generativen KI auszuschöpfen und leistungsfähigere, personalisierte und wertvolle Erfahrungen für die Nutzer zu schaffen.

© urheberrechtliche Erklärung

Artikel Copyright AI-Austauschkreis Alle, bitte nicht ohne Erlaubnis vervielfältigen.

Ähnliche Artikel

Keine Kommentare...