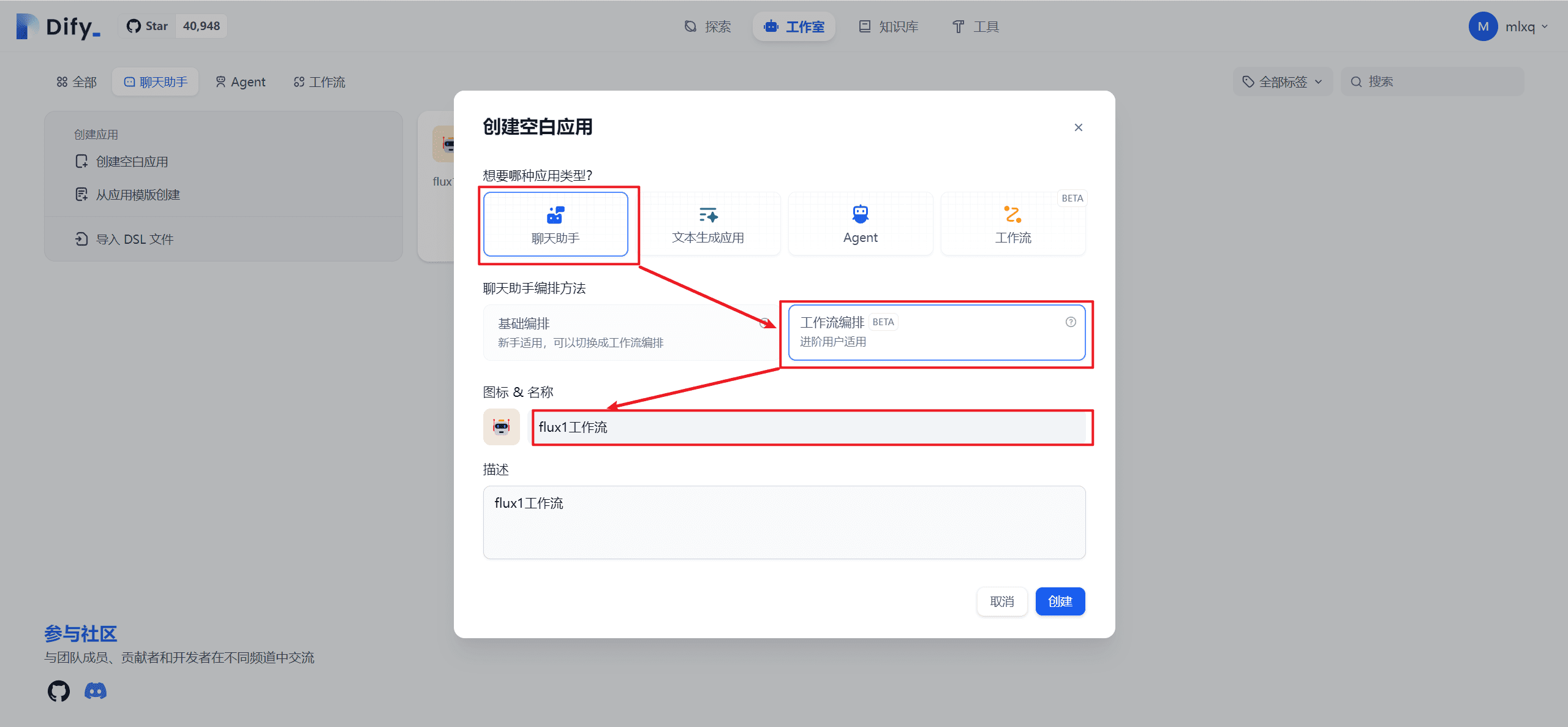

Schreiben von Einführungen für mobile Gesundheits- und Fitness-Apps - Die ultimative Marketing Copy ChatGPT Prompts

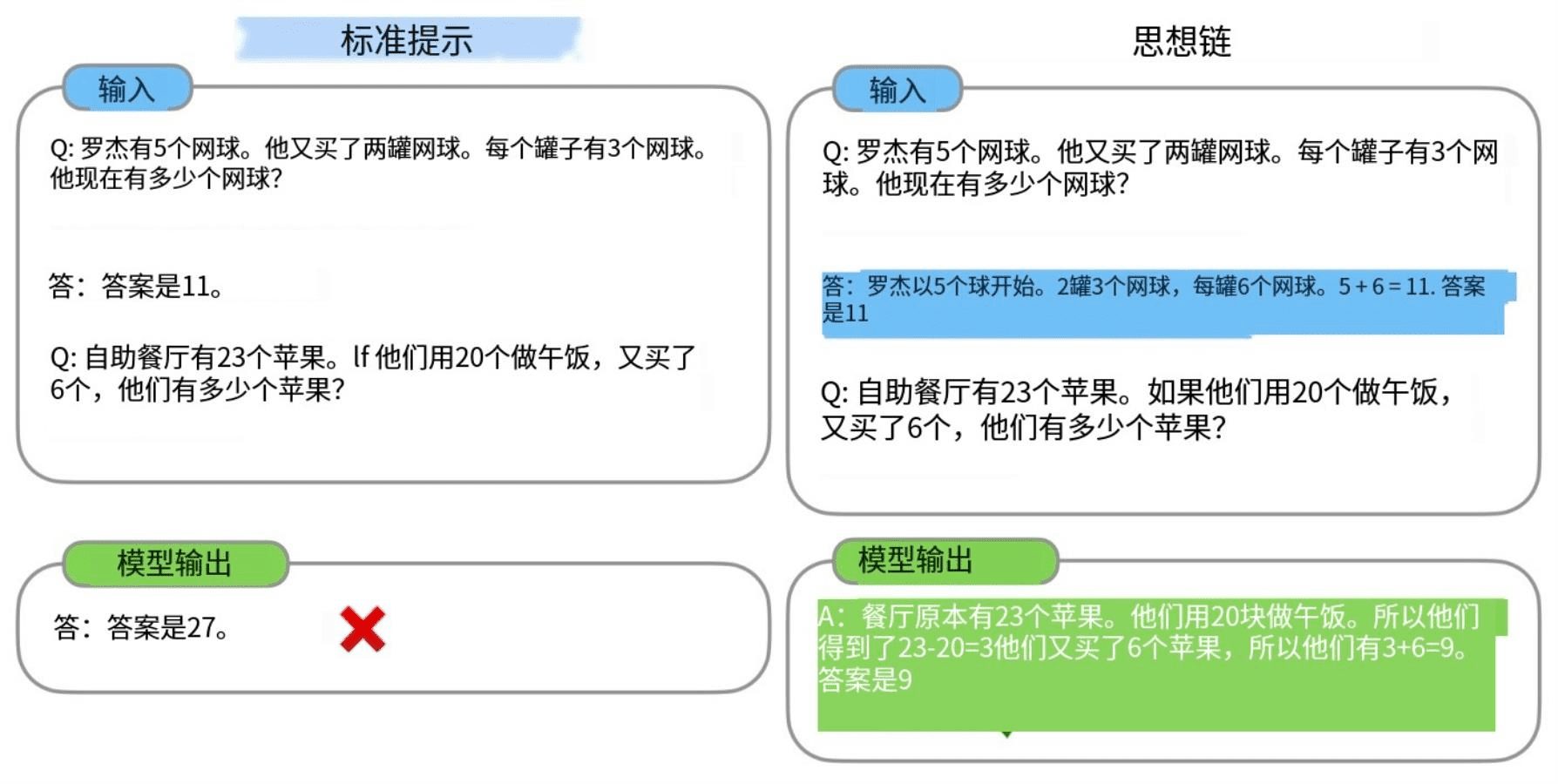

PROFESSIONAL SCENARIO COPYWRITING PROMPT WORDS [NAME DER APP EINFÜGEN] ist eine hochmoderne mobile Gesundheits- und Fitness-App, die den Nutzern helfen soll, ihre Gesundheitsziele zu erreichen. Erstellen Sie als KI-Sprachmodell einen überzeugenden Werbetext für diese App, der die folgenden Schlüsselelemente umfasst: 1. überzeugende Überschrift:...