Wav2Lip-basierte Version des Digital Man Integration Packs zur visuellen Manipulation

Hallo zusammen, heute stelle ich euch ein digitales People Maker Tool vor! Es ist einfach zu bedienen und unterstützt die Stapelverarbeitung. (Integrationspaket am Ende des Artikels, um ihre eigenen zu nehmen) Ich glaube, dass wir etwas über die Technologie der digitalen Menschen gelernt haben, vor dem großen Feuer Guo Degang sprechen Englisch, Russisch Schönheit sprechen Chinesisch, etc. sind die Verkörperung der digitalen Menschen Technologie.

Es gibt tatsächlich viele Arten von digitalen Menschen, zum Beispiel die, die ich geteilt ist das Video Form von digitalen Menschen, dann gibt es auch 3D-Modell digitale Menschen mit UnrealEngine gemacht, und sie sind alle in verschiedenen Orten angewendet. Interessierte können gehen, um zu verstehen, hier aber nicht zu viel zu erklären.

Was? Sie wissen nicht, was ein digitaler Mensch ist? ("Baidu)

Allerdings ist das heute gezeigte Exemplar tatsächlich im Original Wav2Lip Das Projekt basiert auf der Optimierung, und die Bereitstellung nach unten fand ich auch eine Menge Probleme, wie Caching, Schnittstelle, Ausführung Effizienz Fragen, und so weiter, und zielte darauf ab, die Optimierung zu tun.

Anforderungen an die Konfiguration

Windows (Computer)

N-Karte muss N-Karte sein! CPU wird nicht unterstützt!

MAC

In der Entwicklung, arbeitet immer noch an den mps-Problemen! Ich versuche es schon seit Tagen! Also MAC'ers warten ein wenig länger?

Glaubt nicht, dass ich langsam bin, meine Freunde, ich teste viel und schaue, ob es etwas gibt, das ich bei jedem Integrationspaket optimieren kann, sobald es fertig ist!

Aktualisierungen

Was ist neu im Vergleich zum Original?

1. hinzugefügtes Webui-Interface.

2. die Stapelverarbeitung unterstützen.

3. die Optimierung des ursprünglichen Cache-Problems.

4. optimierte Fragen der Verarbeitungseffizienz.

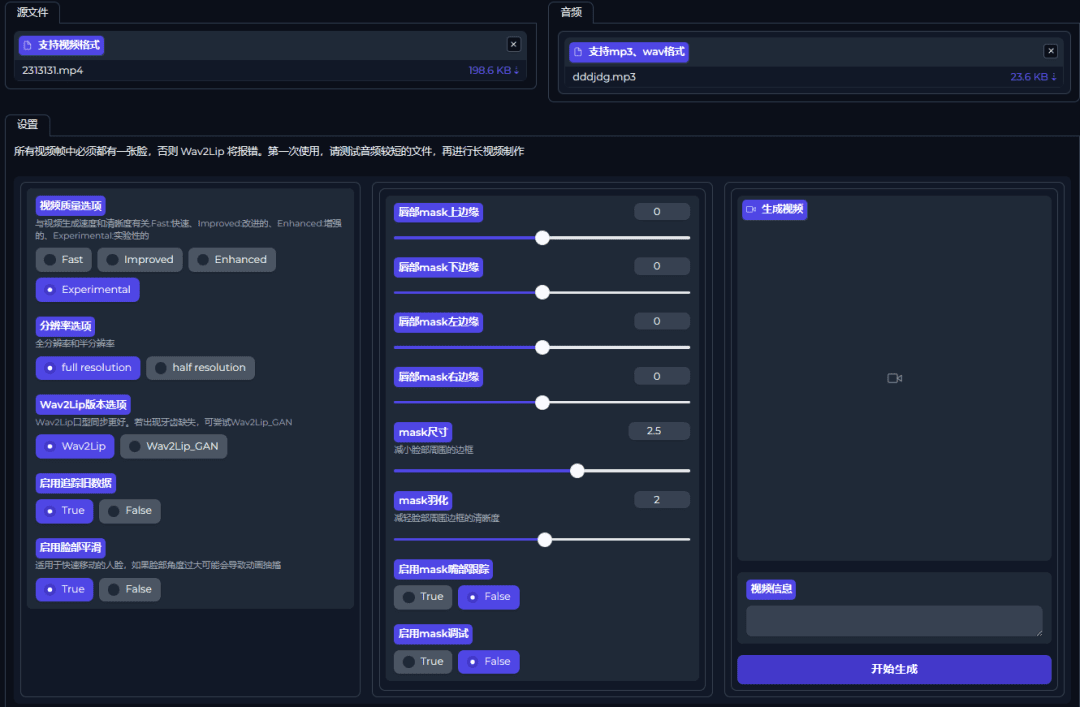

Verwendung

beabsichtigen

Audio- und Videodateien müssen vorbereitet werden.

Audiodatei (Computer)::

- Es wird empfohlen, dass die Audiolänge die gleiche Länge wie das Video hat (z. B. wenn Sie ein 10 Sekunden langes Video haben, sollte auch die Audiolänge 10 Sekunden betragen. Wenn die Audiolänge länger als die Videolänge ist, wird das Video automatisch in einer Rückwärtsschleife abgespielt, um es zu verlängern).

- Audiodateiformat: wav und mp3

Videodatei::

- Die von Ihnen ausgewählten Videobilder müssen alle ein Gesicht enthalten, sonst wird ein Fehler gemeldet. (Wenn Ihr Video z. B. insgesamt 10 Sekunden lang ist und in der Mitte 2 Sekunden Frames ohne ein Gesicht enthalten sind, wird ein Fehler gemeldet)

- Empfohlenes H264-kodiertes mp4-Videoformat

Tipp: Diese Version unterstützt Stapelverarbeitung. Batch unterstützt mehrere Videos mit mehreren Audio, mehrere Videos mit einzelnen Audio.

Ein Beispiel:

- Sie haben 3 Videos und 3 Audiodateien, dann werden diese in der Reihenfolge verarbeitet, in der Sie Video 1 für Audio 1 und Video 2 für Audio 2 ausgewählt haben.

- Sie haben 3 Videos und 1 Audio, dann wird es so verarbeitet, als ob alle von Ihnen hochgeladenen Videos diesem Audio entsprechen. Video 1 entspricht dem Ton 1, Video 2 entspricht dem Ton 1 und Video 3 entspricht dem Ton 3.

Beginn der Bearbeitung

Der einfachste Weg:

Ziehen Sie die Video- und Audiodateien per Drag & Drop in die entsprechenden Felder, klicken Sie auf Generierung starten, und fertig!

Wenn Sie genauer wissen wollen, was die einzelnen Parameter bewirken, lesen Sie weiter!

Angaben zu den Parametern

Video-Qualität:

Schnell und zügig: Wav2Lip audio to port type mode.

Verbessert: Wav2Lip-Audio in den Lippenmodus + Lippen mit Maske um die Lippen herum, um den Rand um die Lippen zu entfernen.

Verbessert: Wav2Lip Audio to Lip Modus + Maskenanpassung + GFPGAN HD Gesichtsverbesserung

Experimentell:Optimierung der Ausführungseffizienz bei einem erweiterten Modell.

Standardmäßig empfohlen, wenn Ihr Rechner nicht zu schlecht konfiguriert ist.Erweitertim Gesang antwortenExperimentelle

Auflösungsoptionen

volle Auflösung

halbe Auflösung

Achtung!

Getestet unten halbe Auflösung wird in einigen Fällen gibt es inkompatible Probleme, ist es empfehlenswert, dass diese Option, um die volle Auflösung wählen

Wav2Lip Version Optionen

Wav2Lip

Vorteile: genauere Mundsynchronisation, hält den Mund geschlossen, wenn kein Ton zu hören ist.

Nachteile: Manchmal fehlen Zähne (in einigen Fällen).

Wav2Lip_GAN

Vorteile: Der Effekt sieht besser aus und bewahrt den ursprünglichen Ausdruck des Sprechers.

Nachteile: Nicht sehr gut bei der Maskierung roher Lippenbewegungen, insbesondere ohne Ton.

Empfehlung:

Probieren Sie zunächst Wav2Lip aus und wechseln Sie dann zur Version Wav2Lip_GAN, wenn Sie den Effekt einer großen Lücke im Mundstück feststellen.

Gesichtsglättung einschalten

Wenn diese Option aktiviert ist, schneidet wav2lip das Gesicht auf jedem Frame unabhängig zu.

Ideal für schnelle Bewegungen oder Videoschnitt.

Wenn das Gesicht seltsam angewinkelt ist, kann dies zu Krämpfen führen.

Wenn diese Funktion deaktiviert ist, blendet wav2lip die erkannten Gesichtspositionen zwischen 5 Bildern ein.

Ideal für langsame Bewegungen, insbesondere bei Gesichtern, die normalerweise nicht schräg sind.

Wenn sich das Gesicht schnell durch das Bild bewegt, kann der Mund versetzt sein und zwischen den Schnitten unschön aussehen.

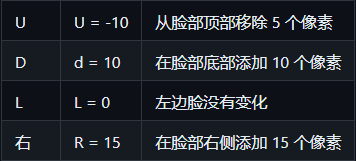

Polsterung (Füllen)::

Diese Option steuert die Anzahl der Pixel, die in jeder Richtung zum Gesichtsausschnitt hinzugefügt oder entfernt werden.

Diese Option kann helfen, harte Linien am Kinn oder an anderen Kanten des Gesichts zu entfernen, aber zu viel oder zu wenig Füllung kann die Größe oder Position des Mundes verändern. Es ist üblich, 10 Pixel zum unteren Rand hinzuzufügen, und es wird empfohlen, mit verschiedenen Werten zu experimentieren, um das beste Ergebnis zu finden.

Maske Maskenabschnitt

Maske Größe

wird der von der Maske abgedeckte Bereich vergrößert.(Ein Rahmen um das Gesicht kann diesen Wert verringern, z. B. 1,5)

Maske Befiederung

Bestimmt den Grad der Überblendung zwischen der Mitte und den Rändern der Maske.(Ein Rahmen um das Gesicht kann diesen Wert ebenfalls erhöhen)

Masken-Mund-Tracking aktivieren

Aktualisiert die Position der Maske bei jedem Bild auf die Position des Mundes (langsamer)

Achtung!

Da die Bilder auf das Gesicht zugeschnitten sind, ist die Mundposition bereits angenähert, und diese Funktion wird nur aktiviert, wenn festgestellt wird, dass die Maske des Videos dem Mund nicht zu folgen scheint.

Aktivieren der Maskendebugging-Funktion

Wenn Sie diesen Parameter aktivieren, werden der Hintergrund in Graustufen und die Maske farbig dargestellt, und Sie können die Position der Maske im Rahmen sehen. (Nachdem dieser Parameter auf True geändert wurde, können Sie die Wirkung des Parameters intuitiver erkennen)

Erwerb des Integrationspakets

Quark: https://pan.quark.cn/s/382936a190e2

Baidu:https://pan.baidu.com/s/17FJpF-V3rxhlg89QunLIDw?pwd=9mnu

bis zum Ende schieben

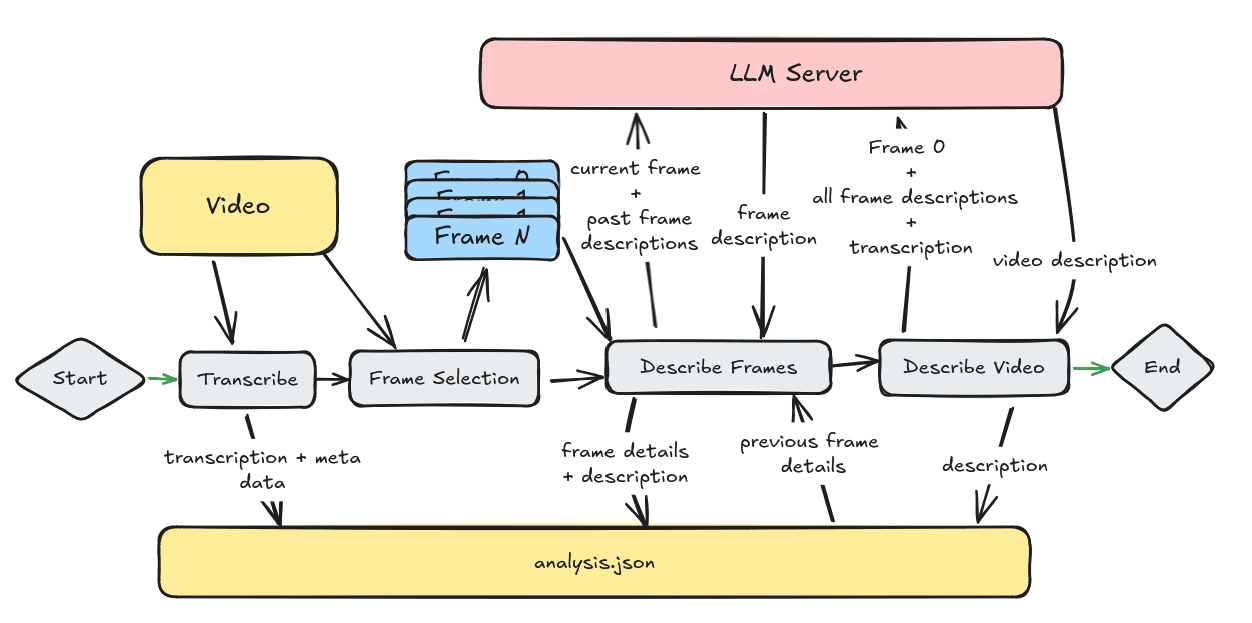

Apropos digitale Menschen allein, in der Tat, es gibt viele Möglichkeiten zu erreichen, wie heygen, Wav2lip, Geneface +, etc., diese Werkzeuge aus der Wirkung sind nicht das gleiche, jeder hat seine eigenen Vorteile und Nachteile.

Ich möchte Ihnen noch eine weitere Idee zur Produktion unterbreiten: Verwenden Sie die FaceFusion Führen Sie zunächst einen Face Swap für das Video durch und verwenden Sie dann GPT SoVITS Die Sprachsynthese wird durchgeführt, und schließlich wird das Projekt für die digitale demografische Produktion verwendet.

© urheberrechtliche Erklärung

Artikel Copyright AI-Austauschkreis Alle, bitte nicht ohne Erlaubnis vervielfältigen.

Ähnliche Artikel

Keine Kommentare...