综合介绍

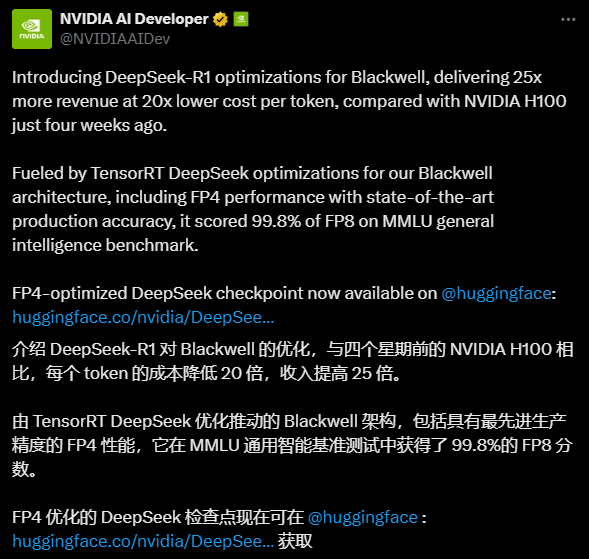

DeepSeek-R1-FP4 是由 NVIDIA 开源并优化的一个量化语言模型,基于 DeepSeek AI 的 DeepSeek-R1 开发。它通过 TensorRT Model Optimizer 将权重和激活值量化为 FP4 数据类型,使模型在保持高性能的同时大幅降低资源需求。相比原始模型,磁盘空间和 GPU 内存占用减少约 1.6 倍,非常适合在生产环境中进行高效推理。该模型特别针对 NVIDIA 的 Blackwell 架构进行了优化,据称推理速度提升高达 25 倍,每 token 成本降低 20 倍,展现了强大的性能潜力。它支持长达 128K 的上下文长度,适用于处理复杂文本任务,且开放给商业和非商业用途,为开发者提供了一个高性价比的 AI 解决方案。

功能列表

- 高效推理: 使用 FP4 量化技术大幅提升推理速度,优化资源使用。

- 长上下文支持: 最大支持 128K 的上下文长度,适合处理长文本生成任务。

- TensorRT-LLM 部署: 可通过 TensorRT-LLM 框架快速部署到 NVIDIA GPU 上运行。

- 开源使用: 支持商业和非商业场景,允许自由修改和衍生开发。

- 性能优化: 针对 Blackwell 架构设计,提供超高推理效率和成本效益。

使用帮助

安装与部署流程

DeepSeek-R1-FP4 的部署需要一定的硬件和软件环境支持,尤其是 NVIDIA GPU 和 TensorRT-LLM 框架。以下是详细的安装和使用指南,帮助用户快速上手。

1. 环境准备

- 硬件要求: 建议使用 NVIDIA Blackwell 架构 GPU(如 B200),至少需要 8 张 GPU(每张显存需满足模型需求,约 336GB VRAM 未量化,量化后约 1342GB)。对于更小规模的测试,推荐至少 1 张高性能 GPU(如 A100/H100)。

- 软件依赖:

- 操作系统:Linux(如 Ubuntu 20.04 或更高版本)。

- NVIDIA 驱动:最新版本(支持 CUDA 12.4 或更高)。

- TensorRT-LLM:需从 GitHub 源码编译最新主分支版本。

- Python:3.11 或更高版本。

- 其他库:

tensorrt_llm、torch等。

2. 下载模型

- 访问 Hugging Face 页面,点击“Files and versions”选项卡。

- 下载模型文件(如

model-00001-of-00080.safetensors等,共 80 个分片,总大小超 400GB)。 - 将文件保存至本地目录,例如

/path/to/model/。

3. 安装 TensorRT-LLM

- 从 GitHub 克隆最新 TensorRT-LLM 仓库:

git clone https://github.com/NVIDIA/TensorRT-LLM.git cd TensorRT-LLM

- 编译并安装:

make build pip install -r requirements.txt - 验证安装:

python -c "import tensorrt_llm; print(tensorrt_llm.__version__)"

4. 部署模型

- 使用提供的示例代码加载并运行模型:

from tensorrt_llm import SamplingParams, LLM # 初始化模型 llm = LLM( model="/path/to/model/nvidia/DeepSeek-R1-FP4", tensor_parallel_size=8, # 根据 GPU 数量调整 enable_attention_dp=True ) # 设置采样参数 sampling_params = SamplingParams(max_tokens=32) # 输入提示 prompts = [ "你好,我的名字是", "美国总统是", "法国的首都是", "AI的未来是" ] # 生成输出 outputs = llm.generate(prompts, sampling_params) for output in outputs: print(output) - 执行上述代码前,确保 GPU 资源已正确分配。若资源不足,可调整

tensor_parallel_size参数。

5. 功能操作指南

高效推理

- DeepSeek-R1-FP4 的核心优势是其 FP4 量化技术。用户无需手动调整模型参数,只需确保硬件支持 Blackwell 架构,即可体验推理速度提升。运行时,建议设置

max_tokens参数控制输出长度,避免资源浪费。 - 操作示例:在终端运行 Python 脚本,输入不同提示,观察输出速度和质量。

长上下文处理

- 该模型支持高达 128K 的上下文长度,适合生成长篇文章或处理复杂对话。

- 操作方法:在

prompts中输入较长的上下文,例如一段 5000 字的文章开头,然后设置max_tokens=1000,生成后续内容。运行后检查生成文本的连贯性。 - 注意事项:长上下文可能增加内存占用,建议监控 GPU 显存使用情况。

性能优化

- 若使用 Blackwell GPU,可直接受益于 25 倍推理速度提升。若使用其他架构(如 A100),性能增益可能略低,但仍显著优于未量化模型。

- 操作建议:在多 GPU 环境下,调整

tensor_parallel_size参数以充分利用硬件资源。例如,8 张 GPU 设置为 8,4 张 GPU 设置为 4。

6. 常见问题与解决

- 显存不足: 若提示内存溢出,减少

tensor_parallel_size或使用更低量化版本(如社区提供的 GGUF 格式)。 - 推理速度慢: 确保 TensorRT-LLM 已正确编译并启用 GPU 加速,检查驱动版本是否匹配。

- 输出异常: 检查输入提示格式,确保不含特殊字符干扰模型。

使用建议

- 初次使用: 从简单提示开始,逐步增加上下文长度,熟悉模型性能。

- 生产环境: 部署前测试多组提示,确保输出符合预期。建议搭配负载均衡工具优化多用户访问。

- 开发者定制: 可基于开源许可修改模型,适配特定任务,如代码生成或问答系统。

通过以上步骤,用户即可快速部署并使用 DeepSeek-R1-FP4,享受高效推理带来的便利。

© 版权声明

文章版权归 AI分享圈 所有,未经允许请勿转载。

相关文章

暂无评论...