BoT: Verbessertes Denken: Lösen von Problemen durch Versuch und Irrtum mit großen Sprachmodellen

Abstracts

Die Denkleistung von Large Language Models (LLMs) bei einem breiten Spektrum von Problemen hängt in hohem Maße von verketteten Denkaufforderungen ab, bei denen einige verkettete Denkdemonstrationen als Beispiele in den Aufforderungen enthalten sind. Jüngste Forschungsarbeiten, z.B. zu Denkbäumen, haben auf die Bedeutung von Exploration und Selbsteinschätzung bei der Auswahl von Denkschritten beim Lösen komplexer Probleme hingewiesen. In diesem Beitrag schlagen wir ein automatisiertes Prompting-System namens Boosting of Thoughts (BoT) vor, das eine große Anzahl von Thinking Trees iterativ erforscht und selbst bewertet, um eine Sammlung von Trial-and-Error-Erfahrungen zu erhalten, die als neue Form des Promptens beim Lösen komplexer Probleme dienen. Ausgehend von einfachen Hinweisen, die keine Beispiele erfordern, untersucht und bewertet BoT iterativ eine große Anzahl von Argumentationsschritten und, was noch wichtiger ist, revidiert die Hinweise explizit unter Verwendung der LLM-Fehleranalysen, um die Generierung von Argumentationsschritten zu erweitern, bis eine endgültige Antwort erreicht ist. Unsere Experimente mit GPT-4 und Llama2 an einer Vielzahl komplexer mathematischer Probleme zeigen, dass BoT durchgängig höhere oder vergleichbare Problemlösungsraten erzielt als andere moderne Hinweismethoden. Der Quellcode ist unter https://github.com/iQua/llmpebase的examples/BoTReasoning文件夹下获得 verfügbar.

1. einleitung

Große Sprachmodelle (Large Language Models, LLMs) mit einem autoregressiven Paradigma haben aufgrund ihrer potenziellen Argumentationsfähigkeiten bei einer Vielzahl von Aufgaben erhebliche Leistungen erzielt. Die Sicherstellung dieser Fähigkeit bei komplexen Aufgaben stützt sich stark auf Chained Thinking (CoT)-Hinweise, die Schritt-für-Schritt-Denkbeispiele liefern. Dieser Ansatz legt nahe, dass die Fähigkeit zum schlussfolgernden Denken durch eine Reihe von Denkschritten stimuliert werden kann, wobei das Denken als Zwischenschritt bei der Problemlösung fungiert.

Folglich haben Folgestudien, insbesondere der Tree of Thought (ToT), Wege zur Verbesserung des CoT vorgeschlagen. Um die Validität zu gewährleisten, enthalten die Prompts dieser Methoden in der Regel menschliche Anmerkungen für bestimmte Aufgaben. Diese Abhängigkeit schränkt ihre Skalierbarkeit ein. Neuere Arbeiten, die entweder Doppelprüfungen mit LLMs zur Verbesserung der Antworten durchführen oder Aufforderungen auf der Grundlage von Rückmeldungen verbessern, sind sehr vielversprechend. In der vorhandenen Literatur wird typischerweise das Verwerfen von ungültigen Gedanken in Aufforderungen befürwortet. Menschen können jedoch in der Regel kontinuierlich lernen, indem sie Fehler sorgfältig analysieren, dadurch Erfahrungen sammeln und ihre Leistung schrittweise verbessern. Daher stellen wir die Frage: Kann die Generierung von Gedanken für LLMs von menschlichen Anmerkungen befreit werden und das menschliche Problemlösungsverhalten nachahmen, um eine effektive Argumentation in einer Vielzahl von Aufgaben zu ermöglichen?

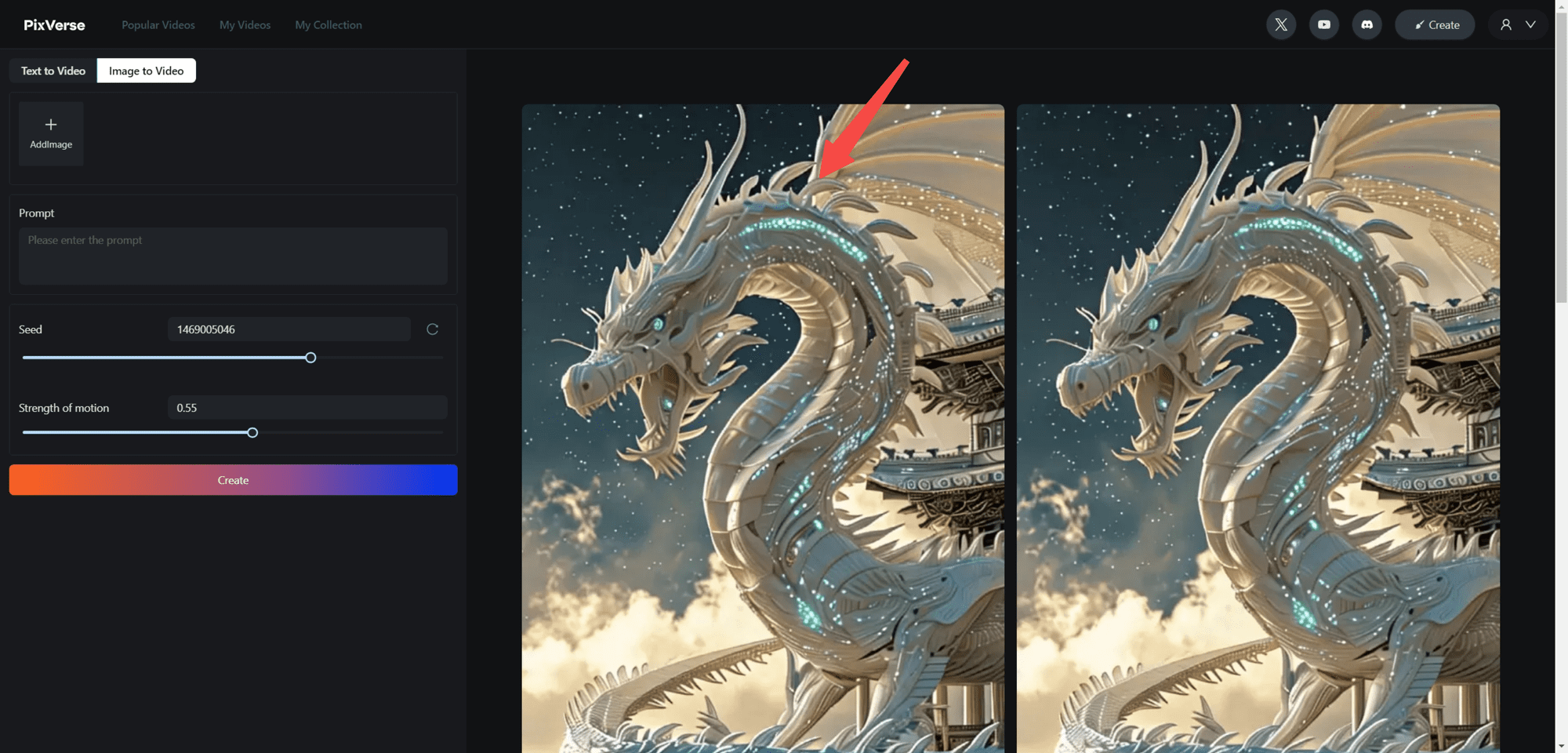

In diesem Papier schlagen wir einen neuartigen Rahmen vor, der in Abb. 1 dargestellt ist und Boosting of Thoughts (BoT) genannt wird. Dieser implementiert einen Boosting-Mechanismus, der Aggregation und Erfahrung einschließt, um unzuverlässige Argumentationsschritte (schwaches Denken) durch Lernen aus Fehlern schrittweise zu verbessern und schließlich verschiedene Probleme zu lösen. Ausgehend von einem einfachen Hinweis ohne menschliche Kommentierung kann BoT schwaches Denken entwickeln. Durch Aggregation kann das BoT daraus logischere und effektivere Gedankenketten ableiten, die zu weiteren Verbesserungen führen. Eine solche Anleitung wird in unserem Rahmen durch die Anpassung von Hinweisen erreicht, bei denen es sich um detaillierte Fehlermeldungen, Vorschläge und Anleitungen für jeden Argumentationsschritt handelt, die durch die Analyse der aggregierten Ketten unter Verwendung von LLMs gewonnen werden. Wenn solche Erfahrungen in den Hinweisen gesammelt werden, führt dies allmählich zu einem besseren Denken.

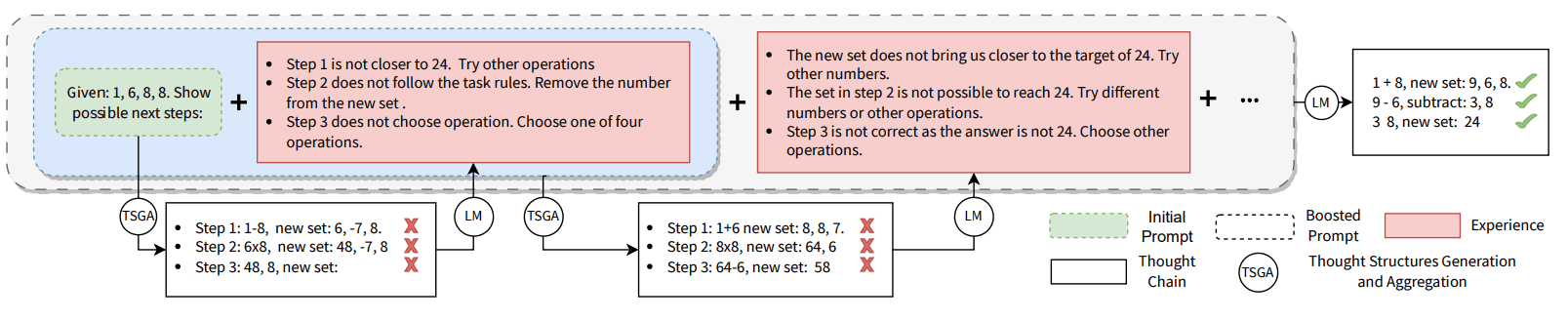

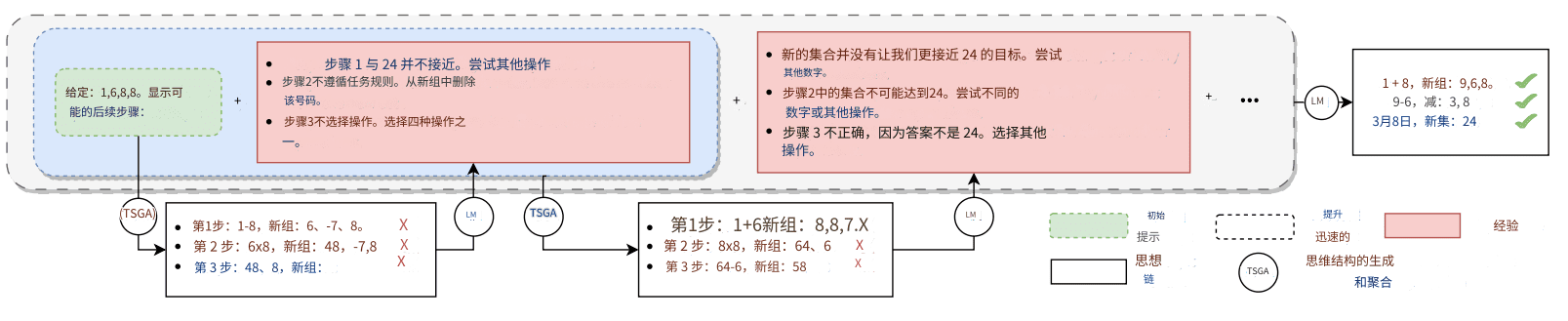

Abbildung 1: Verbesserung von Hinweisen durch schrittweise Erweiterung der Erfahrung, die aus einer Analyse der generierten Gedankenketten durch ein großes Sprachmodell (LLM oder LM) besteht. Die Erfahrung enthält explizit die Gedankenkette selbst, den entsprechenden Fehlerbericht und detaillierte Vorschläge zur Überarbeitung der einzelnen Argumentationsschritte. So können auch jene ungültigen Gedanken, die mit einem roten Kreuz markiert sind, zur Verfeinerung der Prompts beitragen. Durch das Sammeln von Erfahrungen mit den Eingabeaufforderungen kann das BoT schließlich korrekte Gedankenketten ausgehend von einfachen Eingabeaufforderungen erzeugen. Das hier vorgestellte Beispiel ist das Ergebnis der Anwendung von GPT-4 mit BoT auf eine 24-Punkte-Spielaufgabe.

Konkret implementiert BoT einen solchen Verstärkungsmechanismus als erfahrungsgesteuerten iterativen Prozess, wie in Abbildung 1 dargestellt. In jeder Iteration konstruiert BoT für einen gegebenen Hinweis eine große Anzahl von einfachen Gedankenstrukturen parallel zum LLM. Wir haben uns für die Baumstruktur entschieden, wie sie in ToT gezeigt wird, aber für unsere Boosting-Zwecke haben wir sie erheblich modifiziert, um sie zu einem gewichteten binären Baum mit verschiedenen Wachstumsstrategien zu machen. Nach der Extraktion der höchsten Punktzahlen der Wurzel-zu-Blatt-Zweige jedes Baums wurde die Aggregationskomponente von BoT ausgeführt, um sie zu einer einzigen Gedankenkette zusammenzufassen. Diese Kette wurde dann von demselben LLM ausgewertet, um daraus Lehren zu ziehen, die den Prompts als Leitfaden für die Gedankengenerierung in der nächsten Iteration hinzugefügt wurden.

Unser Beitrag lässt sich auf drei Arten zusammenfassen. Erstens: Im Gegensatz zur Generierung komplexerer Denkstrukturen mit Hilfe ausgefeilter Eingabeaufforderungen zeigt diese Arbeit, dass schwache Gedanken, die sich nur auf einfache anfängliche Eingabeaufforderungen stützen, schrittweise verbessert werden können, um Probleme auf der Grundlage früherer Erfahrungen zu lösen. Zweitens schlagen wir zur Umsetzung dieses Verbesserungsmechanismus ein neuartiges System namens Boosting of Thoughts (BoT) vor, das einen erfahrungsgesteuerten iterativen Prozess durchführt. Da es mit einfachen Aufforderungen beginnt, kann BoT auf eine Vielzahl von Aufgaben erweitert werden. Bei gleichzeitiger Gewährleistung der Validität ist BoT schnell, da es einfache Gedankenstrukturen parallel aufbaut und nach wenigen Iterationen zu einer Lösung konvergiert. Schließlich haben wir die Leistung von BoT bei komplexen mathematischen Problemen mit GPT-4 und LlamaV2 bewertet. Auf der Grundlage von GPT-4 OpenAI (2023) und LlamaV2 Touvron et al. (2023) haben wir die Leistung von BoT bei komplexen mathematischen Problemen evaluiert. Die Problemlösungsraten zeigen, dass BoT mit einer binären Baumstruktur den aktuellen Stand der Technik bei GSM8K und AQuA deutlich übertrifft und bei anderen Datensätzen zweitbeste Ergebnisse erzielt. Insbesondere übertrifft BoT die führende Methode ToT um 9,7% bei der neuen anspruchsvollen Aufgabe Game of 24. Unser BoT zeigt somit, dass LLMs auch ohne menschliche Annotationen eine hohe Leistung über ein breites Aufgabenspektrum hinweg beibehalten können, indem sie Hinweise ergänzen, Fehleranalysen von ungültigen Gedankenketten akkumulieren und entsprechende Vorschläge machen.

2. verwandte Arbeiten

mehrstufiger Rückschluss.. Prominente Arbeiten zu Aufforderungen zum verketteten Denken (Chained Thinking, CoT) legen nahe, dass das schrittweise Denkverhalten von LLMs durch die Bereitstellung von Zwischenschritten bei jeder Problemaufforderung stimuliert werden kann. Neuere Arbeiten, Tree of Thought (ToT), wandeln den sequentiellen Denkprozess in eine Baumstruktur um, in der jeder Gedanke (Knoten) frühere Denkwege berücksichtigen kann, um mehrere nächste Gedanken zu generieren. Durch Backtracking und erweiterte Exploration während des Denkprozesses ist ToT auch bei Problemen leistungsfähig, die selbst GPT-4 herausfordern. In Anbetracht der hohen Kapazität nutzt die zugrundeliegende Denkstruktur von BoT weitgehend die Denkbaumstruktur von ToT. Aufgrund des Boosting-Frameworks ist die von BoT bei jeder Iteration erzeugte Baumstruktur binär und flach, im Gegensatz zum komplexen Baum von ToT, bei dem jeder Knoten einer großen Anzahl von Kindknoten entspricht. Die zugrundeliegende Struktur ist jedoch nicht auf ToT beschränkt. Im Gegensatz dazu ist BoT flexibel, da die zugrundeliegende Denkstruktur ToT, GoT Besta et al. (2023) oder CR Zhang et al. (2023b) sein kann, wobei Thinking Graphs (GoT) Besta et al. (2023) die jüngste Arbeit ist, die die Denkstruktur auf ein grafisches Format erweitert. In dieser Arbeit konzentrieren wir uns nur auf ToT als zugrundeliegende Denkstruktur und überlassen die Verwendung von GoT der zukünftigen Arbeit.

Autosuggestion. Die Entlastung des Menschen von aufgabenspezifischen Aufforderungen zieht viel Aufmerksamkeit auf sich. Um die Argumentationsfähigkeit von LLMs zu gewährleisten, verlassen sich traditionelle CoTs auf menschliches A-priori-Wissen, um manuell aufgabenspezifische Demonstrationen als Aufforderungen zu erzeugen. Zero CoT zeigte jedoch, dass LLMs auch ohne manuell generierte Beispiele in der Lage waren, Schritt für Schritt zu denken, um genaue Antworten zu erhalten, indem sie den Aufforderungen einfach den Zusatz "denken wir Schritt für Schritt" hinzufügten. Diese Erkenntnisse führten zu einer Reihe von Folgestudien: Auto-CoT eliminiert den manuellen Aufwand, indem es die von Zero-CoTs erzeugte Kette brauchbarer Schlussfolgerungen abruft.Active-Prompt misst zunächst die Unsicherheit einer Reihe von Fragen und wählt so nur unsichere Fragen aus, die von einem Menschen kommentiert werden.ToT reduziert ebenfalls den manuellen Aufwand, erfordert aber für jede Aufgabe immer noch, dass der Experte in der Eingabeaufforderung die möglichen nächsten Gedanken. Unser Beitrag stellt einen neuen Ansatz für manuelles cue-free boosting vor. Ausgehend von einem einfachen Hinweis, verbessert BoT diesen iterativ auf der Grundlage von LLMs Analyse des Denkens.

Tip Engineering durch Feedback. Die Verwendung der Antworten von LLMs auf Eingabeaufforderungen als Feedback für weitere Überarbeitungen von Aufforderungen hat viel Aufmerksamkeit erregt. Diejenigen, die einen gegebenen Hinweis auf der Grundlage der von den LLMs bewerteten Beschreibung der Ausgabe kontinuierlich überarbeiten, zielen darauf ab, genaue Antworten zu erhalten. SELF-REFINE schlägt einen iterativen Selbstverfeinerungsalgorithmus vor, der es LLMs ermöglicht, Feedback zu generieren, um ihre Ausgabe weiter zu verfeinern. PHP vereinfacht diesen Prozess, indem es die Lösung der vorherigen Antwort direkt als Hinweis zu den nachfolgenden Hinweisen hinzufügt.REFINER, das sich ebenfalls auf unsere Arbeit bezieht, wertet jeden Inferenzschritt als Feedback aus, um eine vernünftigere Antwort zu erzeugen. vernünftigere Lösung. Eine andere Reihe von Studien hat sich mit der Integration beschäftigt, insbesondere mit der Verwendung von Boosting-Mechanismen. Freund et al. (1996) haben Hinweise mit Feedback aus einer Reihe von Beispielen verfeinert. Sie passten die Eingabeaufforderung an, indem sie der vorherigen Iteration mehrere unsichere Beispiele hinzufügten, oder sie stützten sich auf einen Feedback-Reflexions-Verfeinerungsprozess.APO Pryzant et al. (2023) verfeinerten iterativ Eingabeaufforderungen, indem sie die Leistung der vorherigen Eingabeaufforderung nutzten, um eine optimierte natürliche Sprache zu bilden. Diese Arbeiten zeigen die Wirksamkeit von Boosting-Mechanismen bei der Entwicklung von Hinweisen. Unsere Arbeit ist jedoch die erste, die die Bedeutung der Fehleranalyse bei der Verbesserung von Hinweisen zur Generierung effektiver Inferenzketten hervorhebt. Die vorgeschlagene BoT erweitert diese Einsicht auf einen automatisierten Prompting-Rahmen, indem sie iterativ eine Sammlung von Versuch-und-Irrtum-Erfahrungen sammelt.

3. verstärktes Denken

3.1 Hintergrund

Das Ziel des Cue-Engineerings besteht darin, einen Cue I zu entwerfen, der mehrere Sprachsequenzen enthält, die über diesen Cue als Input verwendet werden sollen, und ein vortrainiertes Large Language Model (LLM) mit der Bezeichnung pθ, das durch θ parametrisiert wird und Zugang zu den gewünschten Sprachsequenzen y bietet. Somit kann der Standard-Input-Output (IO) als y ∼ pθ (y|I (X, Q)) ausgedrückt werden, wobei I (-) den Cue bezeichnet, der die Aufgabenanweisung X und die die entsprechende Frage Q.

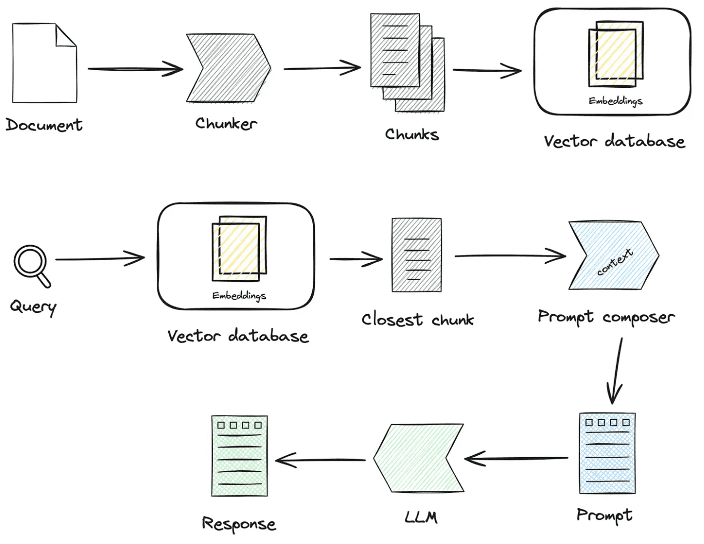

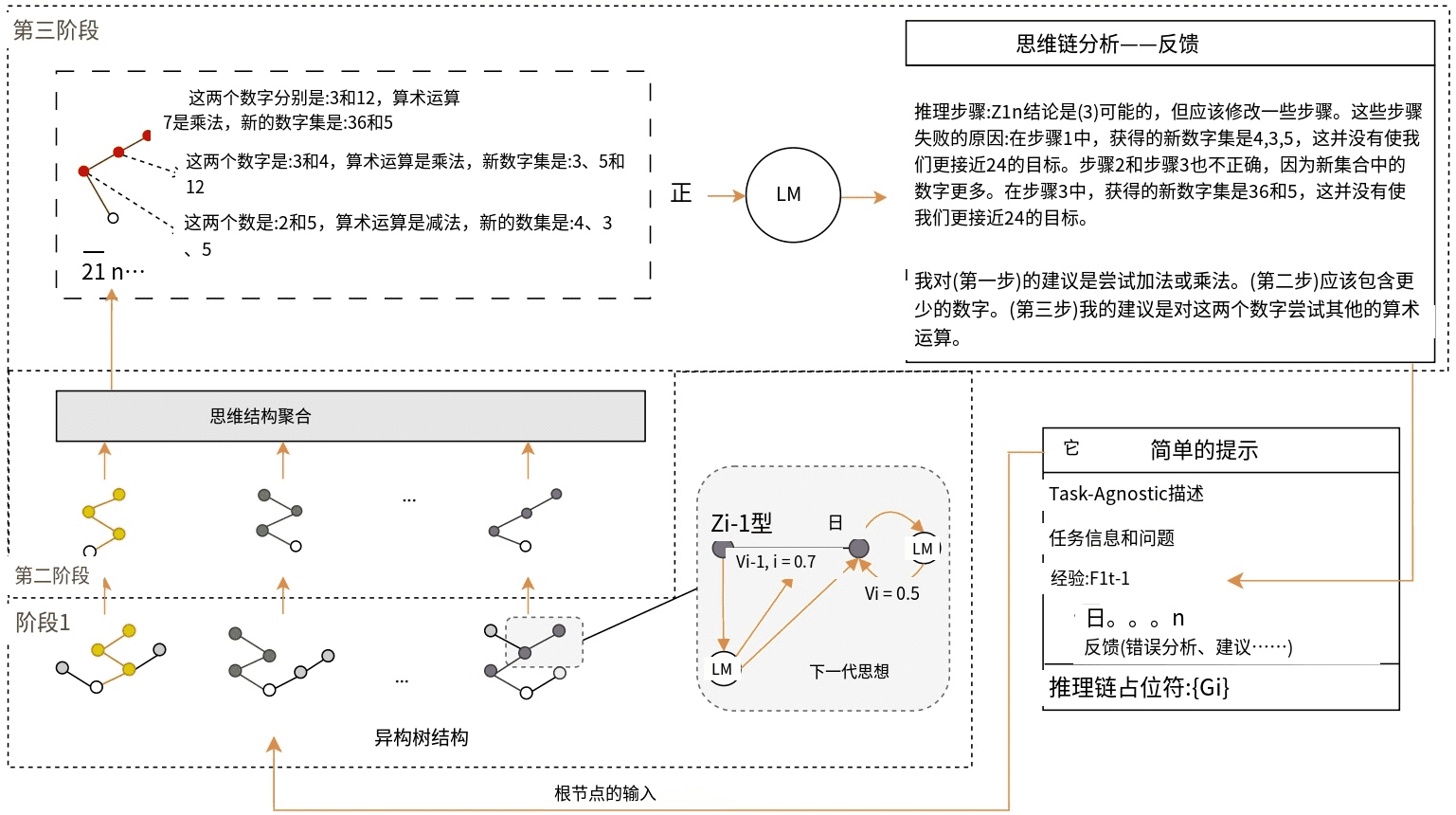

Das Bild zeigt eine visuelle Darstellung des Denkprozesses beim Lösen von Problemen mit Hilfe von Rechenoperationen. Er ist in drei Hauptteile unterteilt: Aggregation der Gedankenstruktur, Generierung des nächsten Gedankens und Analyse der Gedankenkette - Feedback.

Die Aggregation von Denkstrukturen stellt die Kombination verschiedener Stufen der Argumentation (Stufe 1, Stufe 2 und Stufe 3) dar, die jeweils eine eigene Zahlenstruktur aufweisen, die die Schritte beschreibt, die zum Erreichen einer Schlussfolgerung unternommen werden.

Die Generierung des nächsten Gedankens konzentriert sich auf eine bestimmte Phase und zeigt, wie die Sprachmodellierung (LM) zur Vorhersage des nächsten Gedankens verwendet werden kann, wobei frühere Erfahrungen (dargestellt durch die Vektoren Vi-1 und Vi) berücksichtigt werden und eine neue Argumentationskette entsteht.

Gedankenkettenanalyse - Feedback bietet eine detaillierte Analyse der durchgeführten Rechenschritte, weist auf mögliche Fehler hin und bietet Verbesserungsvorschläge. Sie kritisiert die Schritte, indem sie bewertet, ob sie den Löser näher an die Zielzahl (in diesem Fall 24) bringen, und schlägt andere Rechenoperationen vor, die er ausprobieren sollte.

Darüber hinaus gibt es einen kurzen Abschnitt mit Hinweisen auf die Inputs für den Denkprozess, zu denen aufgabenunspezifische Beschreibungen, Aufgabeninformationen und -fragen sowie Erfahrungen aus einer früheren Denkkette gehören, die als Platzhalter für die Generierung neuer Gedanken dienen.

Insgesamt zeigt das Bild einen methodisch fundierten Ansatz für das Denken und die Problemlösung, bei dem Sprachmodelle zur iterativen Optimierung und Verbesserung von Denkprozessen eingesetzt werden.

Betrachten wir insbesondere den Abschnitt Aggregation der Denkstruktur. In diesem Abschnitt sehen wir drei Stufen, jede mit einer farbigen heterogenen Baumstruktur. In Stufe 1 sehen wir einige arithmetische Operationen, und der Trend ist "vi1 - 0,5". In Stufe zwei sehen wir mehr arithmetische Operationen und die Tendenz ist "vi2 - 0,6". In der dritten Stufe schließlich sehen wir eine Reihe von arithmetischen Operationen mit einem Trend von "vi3 - 0,4".

Für den nächsten Abschnitt der Gedankengenerierung wird ein bestimmter Gedankenknoten, Zi, verfolgt und sein zugehöriges Gewicht, vi, angezeigt, was die Bedeutung dieser Gedanken im Kontext der Problemlösung angibt.

Im Abschnitt Gedankenkettenanalyse - Feedback werden mehrere Argumentationsschritte dargestellt (Z1,Z2.... .Zn) und bewertet sie. Für jeden dieser Schritte stehen "R1:-3, versuche +", "R2:+3, versuche -" und "R3: -1, versuche ×" für das Feedback zu dem jeweiligen Schritt Feedback, Bewertung der Argumentation und Vorschläge zur Verbesserung.

Im Abschnitt Einfache Hinweise sind einige Eingabehinweise zu sehen, wie z.B. "Aufgabenbeschreibung unspezifisch 'Spielen Sie ein Zahlenspiel'", "Aufgabenmeldung 'Versuchen Sie, mit den vier Zahlen 1,3,4 ,6 (jede Zahl kann nur einmal verwendet werden) und arithmetische Operationen (Addition, Subtraktion, Multiplikation und Division) zu verwenden, um die Zahl 24 zu erhalten'" sowie die vorherige Argumentationskette Gi.

Das Ergebnis dieser Pipeline erzeugt einen neuen Denkprozess für die nächste Argumentation.

Dieses Diagramm stellt den logischen Ablauf eines Denkprozesses und einer Argumentationsmethodik dar und zeigt, wie ein Sprachmodell (LM) sowie ein Feedback-/Vorschlagsmechanismus verwendet werden können, um mit dem Problem voranzukommen, mit kritischem Feedback und Bewertung bei jedem Schritt.

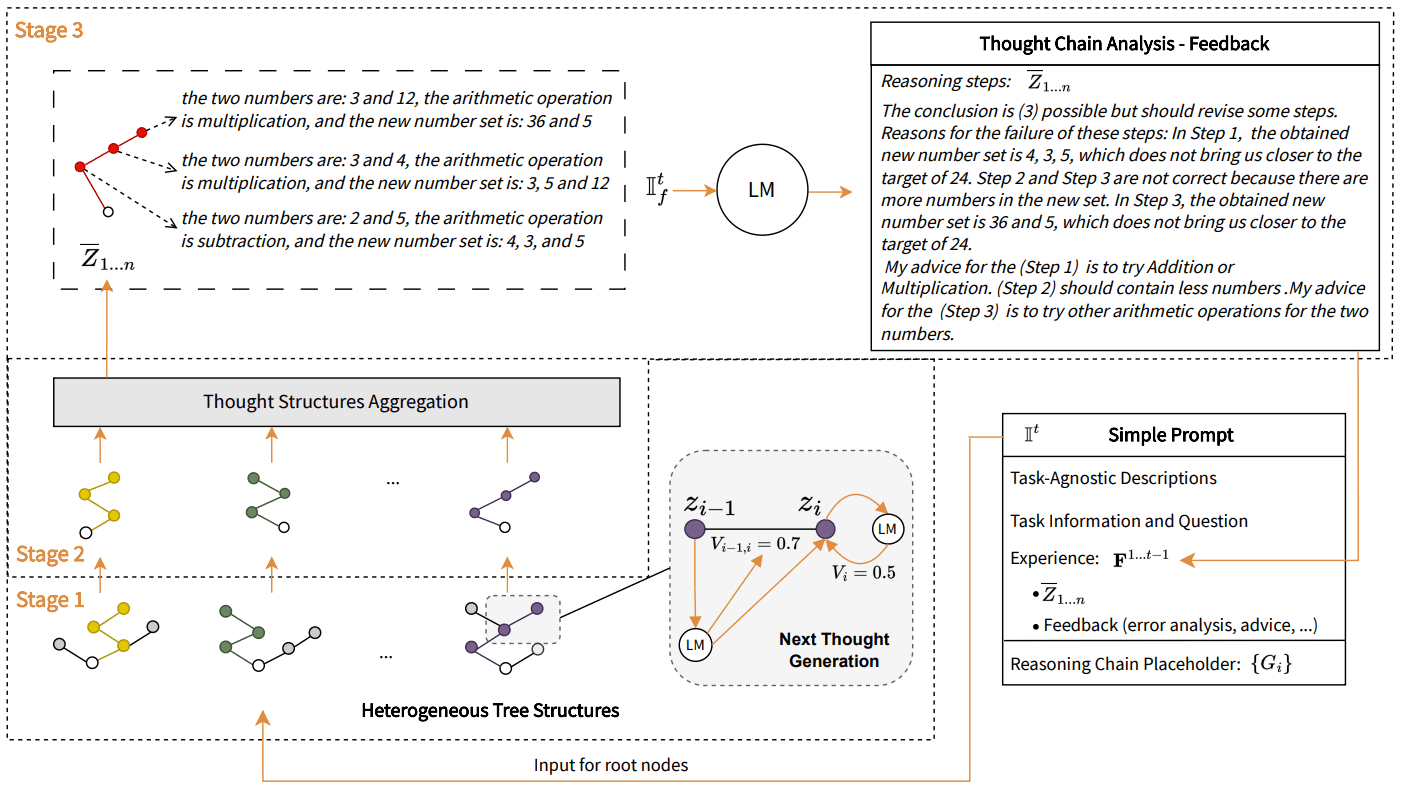

Abbildung 2: Zeigt einen Überblick über den BoT-Prozess in jeder Iteration. Um zu zeigen, wie eine Steigerung der Effektivität in diesem empirisch basierten iterativen Prozess erreicht werden kann, zeigen wir die erschöpfenden Zwischenergebnisse, die in einer Art von Experiment mit ChapGPT-4 auf dem 24-Punkte-Spiel-Datensatz erzielt wurden. Nachdem das BoT die Aufgabe Q: "Die vier vorgegebenen Zahlen sind: 2, 4, 5, 5" erhalten hat, durchläuft es drei aufeinanderfolgende Phasen. Unter Verwendung des einfachen Hinweises It als Eingabe gibt die Gedankenstruktur-Generierung (Phase 1) eine große Vielfalt an heterogenen baumförmigen Gedankenstrukturen aus. In der Gedankenstruktur-Aggregation (Stufe 2) werden diese zu einer Gedankenkette z1.... .n integriert und diese Gedankenkette anschließend in Stufe 3 analysiert, um Erfahrungen zu generieren, die zur weiteren Verstärkung des Hinweises genutzt werden können.

Die Aufforderungen können ausführlicher gestaltet werden, um LLMs anzuleiten, das Problem Schritt für Schritt zu lösen. Jeder Zwischenschritt wird als zi (auch als Gedanke bezeichnet) bezeichnet. Der CoT liefert eine Handvoll Beispiele, von denen jedes eine Kette von Gedanken z1.... .n. Dies führt zu y ∼ pθ y|I [z1 . .n]N , X, Q , wobei N die Anzahl der in der Aufforderung enthaltenen Beispiele ist.

Anstatt Beispiele im Bootstrap vorzubereiten, besteht ein flexiblerer Ansatz darin, den Bootstrap so zu gestalten, dass er den LLM dazu bringt, den Gedanken zi während des Argumentationsprozesses allmählich zu generieren. Dies kann als zi ∼ pθ (zi |I(z1.... .i-1, X, Q)). Schließlich wird die Lösung formalisiert als y ∼ pθ (y|I(z1.... .n, X, Q)).

Stellvertretend erweitern ToT Yao et al. (2024) diesen sequentiellen Denkschritt zu einer Baumstruktur, in der C nächste Gedanken generiert werden können. Die Struktur einer Überlegung kann also entweder verkettet oder baumartig sein.

3.2 Rahmen

Die vorhandene Literatur, die darauf abzielt, Hinweise mit korrekten CoT-Beispielen zu generieren oder feinkörnige Denkstrukturen zu entwerfen, leidet unter drei Einschränkungen. Erstens wird ungültiges Denken bei diesen Ansätzen in der Regel ignoriert oder verworfen. Menschen, vor allem Nicht-Experten, und insbesondere in anderen Bereichen, sind jedoch darauf angewiesen, frühere Fehler zu analysieren, um mehr Erfahrung zu sammeln, damit sie beim nächsten Versuch richtig handeln. Zweitens sind sie weniger skalierbar, da für jede Aufgabe Beispiele für die Generierung des nächsten Gedankens, z. B. I (z1|z0, X, Q), im Hinweis gegeben werden müssen. Schließlich ist die Generierung von Denkstrukturen (z.B. die Baumstruktur von Yao et al.) zu komplex, um weitere Denkschritte zu erforschen, um eine bessere Lösung zu erhalten. Dies ist vor allem darauf zurückzuführen, dass die erhaltenen Lösungen möglicherweise nicht weiter überarbeitet werden können.

In diesem Beitrag argumentieren wir, dass Aufforderungen verbessert werden können, indem kontinuierlich Analysen dieser ungültigen Gedanken (fehlerhafte Argumentationsschritte in der Gedankenkette) von LLMs gesammelt werden. So kann sogar ein einfacher Hinweis, z. B. I (X, Q), der zu ungültigem Denken führen kann, schrittweise verbessert werden, indem man sich auf solche Analysen stützt, um ein starkes Denken zu erreichen, das näher an eine Lösung führt.

Wir schlagen eine Methode vor, dieVerstärkung der Gedanken (BoT)eines automatisierten Cueing-Frameworks, das die Verbesserung von Cues durch einen erfahrungsgesteuerten, iterativen Prozess vomEinfacherden Beginn des Hinweises. Wie in Abbildung 2 dargestellt, besteht jede Iteration t von BoT aus drei Phasen. In der zweiten Phase werden diese Gedankenstrukturen zu einer Schlussfolgerungskette aggregiert, die von den LLMs in der dritten Phase analysiert wird, um ein Feedback mit Fehlerberichten und detaillierten Änderungsvorschlägen zu generieren. Die aggregierte Schlussfolgerungskette wird mit den Feedback-Ergebnissen zu einer neuen Erfahrung kombiniert, die mit Ft bezeichnet wird. Durch die Akkumulation dieser Erfahrungen über die Iterationen F1.... .t, wird der Hinweis verbessert.

Einfache Tipps. Für jede Aufgabe wird bei der Iteration t = 0 ein einfacher Anfangshinweis I0 ≡ {S, X, Q, F0, {Gi}} erstellt, wobei S die aufgabenunabhängige Beschreibung bezeichnet, während X und Q die Aufgabeninformation bzw. die Frage bezeichnen. Der empirische Teil des Prompts wird mit F0 bezeichnet und sollte zu Beginn leer sein. {Gi}} ist ein Platzhalter, der bei der Konstruktion der Gedankenstruktur ausgefüllt wird. Mit anderen Worten: Bei der Generierung des nächsten Gedankens zi wird {Gi} durch die vorherige Gedankenkette z1.... ,i-1.

Generierung von Gedankenstrukturen. Nach dem Sammeln der Erfahrung Ft-1 kann der Hinweis für Iteration t It ≡ {S, X, Q, F1, ... ,t-1, {Gi}}. Auf der Grundlage dieses Hinweises generiert BoT parallel M Gedankenstrukturen, wobei BoT im Prinzip jede beliebige Gedankenstruktur enthalten kann, z. B. verkettete Strukturen von Wei et al. oder baumartige Strukturen von Yao et al. In Anbetracht der Erforschung von Argumentationsschritten und experimentellen Ergebnissen haben wir baumartige Denkstrukturen untersucht. BoT führt jedoch zwei neue Modifikationen ein, die es für den Lifting-Rahmen besser geeignet machen.

- gewichteter Binärbaum. Durch die Verwendung einfacher Stichwörter in jeder Runde konstruiert BoT schwache Gedanken mit einfachen Strukturen und geringer Komplexität, da sie durch den Boosting-Mechanismus weiter überarbeitet werden können. Somit ist jede Gedankenstruktur von BoT ein flacher gewichteter Binärbaum. Der Einfachheit halber behalten wir die Symbole z1.... .i-1, um einen Gedanken vom Wurzelknoten zum Elternteil des Knotens i zu bezeichnen. Zusätzlich zur Ausstattung jedes Knotens i mit einem Gedanken zi und seiner Gedankenbewertungsnote Vi ∼ pθ (z1.... .i, Ia, X, Q), sondern auch eine Kantenbewertung Vi-1,i ∼ pθ (zi-1, zi, Ie, X, Q) zwischen einem Kindknoten und seinem Elternknoten, wobei sich Ia und Ie auf die Leitbeschreibungen des Gedankens bzw. die Kantenbewertung beziehen. vi-1,i bezeichnet das Vertrauensniveau der LLMs bei der Generierung dieses Argumentationsschritts. Somit ist die nächste Gedankengenerierung des BoT in dieser Baumstruktur formalisiert als pθ (zi| (Vi-1,i, Vi, It, X, Q)).

- Heterogenität der Bäume. Im Gegensatz zu ToT, bei dem Lösungen in einem großen, komplexen Baum gefunden werden sollen, zielt BoT darauf ab, sehr heterogene, baumartige Gedankenstrukturen aufzubauen. Um die Heterogenität zu erhöhen, werden bei der Generierung von Denkstrukturen verschiedene Baumwachstumsstrategien verwendet, wie z. B. schichtweises und blattweises Wachstum. Erstere betont die Exploration, nutzt aber weniger Chen & Guestrin (2016), während letztere das Gegenteil ist Ke et al. (2017). So neigt die Blatt-für-Blatt-Strategie im Vergleich zum schichtweisen Wachstum dazu, die Argumentation vom aktuell besten Gedanken bis zu einem besseren Endgedanken fortzusetzen, aber sie neigt auch dazu, monotone Argumentationsketten zu erhalten. Darüber hinaus wurden LLMs mit unterschiedlichen Temperatur- und Top p-Einstellungen angewandt. Schließlich verwendeten wir einen kleinen maximalen Tiefenwert in BoT und kennzeichneten einen Knoten als Blatt, wenn die Werte von Vi-1,i und Vi außerhalb des angegebenen Bereichs [0,3, 0,8] lagen.

Gedankenstrukturpolymerisation. Nachdem er M Gedankenstrukturen erhalten hat, fasst der BoT diese zu einer Gedankenkette zusammen, die mit z1.... .n. Um dies zu erreichen, wählt der BoT für jeden Gedankenstrukturindex m zunächst die Kette mit der höchsten Bewertungszahl aus, d. h. zm 1.... .nm := arg maxz1... .n∈Zm ∑i=1 Vi + Vi-1,i, wobei Zm die Menge aller Gedankenketten des m-ten Baums bezeichnet. Anschließend gibt es zwei Strategien, um z1.... .n.

- Best-First-Aggregation.BoT hängt von arg maxz1.... .n∈{Zm}M m=1 ∑i=1 Vi + Vi-1,i, und wählt die beste der M Gedankenstrukturen als z1.... .n. Dieser Algorithmus ist schnell, kann aber zu einer unlogischen Kette führen, die es schwierig macht, spätere Verbesserungen zu steuern.

- Aggregation der Gier. kann das BoT eine gierige Suche auf {Zm}M m=1 durchführen, um eine neue Gedankenkette zusammenzustellen, die möglicherweise nicht existiert, aber global optimal sein kann. Ausgehend vom Anfangsgedanken, in der Regel dem Wurzelknoten des Baums, erhält der BoT z1 = arg maxzj ∈ {zm 1 } M m=1 Vj + Vj-1,j. Um zi zu erhalten, sucht der BoT anschließend nach allen Gedanken in {Zm}M m=1, deren vorheriger Schritt zi-1 war.

Analyse der Gedankenkette. Um Erkenntnisse darüber zu gewinnen, was angepasst werden sollte, um den Hinweis zu verbessern und besseres Denken zu erzeugen, nutzt der BoT die Fähigkeit der LLMs, z1.... .n. Genauer gesagt, mit dem Hinweis It f (z1.. .n, X, Q) als Eingabe, gibt das LLM einen Feedback-Absatz aus, der Informationen über diese Gedankenkette z1.... .n mit einem Problembericht und detaillierten Vorschlägen. Dieses Feedback wird zu F1,... ,t-1 als eine neue Erfahrung in der Gedankengenerierung hinzugefügt, was zu F1,... ,t.

Iterative Verfeinerung.. Durch den Boosting-Mechanismus wird F1,... ,t verwendet, um den Hinweis iterativ zu verbessern, was zu dem Hinweis It+1 für die (t+1)-te Iteration ≡ {S, X, Q, F1,... ,t, {Gi}}. Im weiteren Verlauf der Iteration kann F1,... ,t viele typische, unlogische Gedankenketten enthalten, aber auch solche, die näher an der Lösung liegen, und zwar alle mit wohldefinierten analytischen Ergebnissen. Selbst wenn man mit einem einfachen Hinweis beginnt, verfeinert BoT diesen Hinweis iterativ, um die richtigen Denkschritte zu erzeugen, die zu einer genauen Lösung führen. Nach T Iterationen verwenden wir It+1 als Eingabehinweis für den LLM, um die endgültige Antwort zu erhalten.

4) Experimentieren

Datensatz. Die Experimente wurden mit Benchmark-Datensätzen durchgeführt, die eine Vielzahl von mathematischen Problemen enthielten, darunter MMLU, SVAMP, GSM8K, AQuA und MATH. Zusätzlich haben wir eine anspruchsvolle mathematische Denkaufgabe, Game of 24, einbezogen, bei der das Ziel darin bestand, 24 in einer Gleichung mit vier Zahlen und grundlegenden arithmetischen Operationen (Addition, Subtraktion, Multiplikation und Division) zu erhalten. besteht aus 3 Zwischenschritten.

Wettbewerb. Neben der Benchmark-Methode Standard Input-Output (IO) werden die Methoden Chained Thinking (CoT), CoT-SC und Complex CoT verglichen, bei denen die Eingabeaufforderungen eine Handvoll Beispiele (8) und menschliche Annotationen enthalten. Darüber hinaus wird BoT mit verwandten Arbeiten wie Thinking Trees (ToT), Progressive Prompts (PHP) und State-of-the-Art-CSVs verglichen. Wir haben Experimente mit GPT-4 und Llama2 durchgeführt. GPT-4 wurde über die OpenAI-API aufgerufen, während das Llama2-13b-Chat-Modell von MetaAI heruntergeladen wurde, um Experimente lokal durchzuführen. Um eine heterogene Baumstruktur zu konstruieren, wählte BoT zufällig Temperaturen im Temperaturbereich [0.2, 0.4, 0.6, 0.7, 0.9, 1.1, 1.5] und den oberen p-Bereich [0.1, 0.3, 0.5, 0.7, 0.9].

aufstellen. Sofern nicht ausdrücklich angegeben, führt BoT in allen Experimenten T = 10 Iterationen durch und konstruiert M = 15 Gedankenstrukturen, von denen jede ein gewichteter Binärbaum ist, da dies tendenziell die besten Ergebnisse liefert. Darüber hinaus haben wir für diese Benchmark-Datensätze die Tiefe des Baums auf 5 festgelegt, während die entsprechende Tiefe in Game of 24 3 betrug. BoT + CoT bedeutet, dass unser einfacher Hinweis 5 Beispiele aus CoT enthält. In Ablationsstudien, in denen es keine kumulative Erfahrung im BoT gibt, werden 8 CoT-Beispiele im Prompt bereitgestellt.

metrisch. Wir messen und berichten die Ergebnisse aller Experimente in Bezug auf die Lösungsrate der Aufgabe (%). Aus der BoT-Ausgabe zT1.... .n der Zielantworten haben wir formatierte Beschreibungen der Antworten speziell für die LLMs erstellt. Für häufig verwendete Datensätze wurde das Format der Antwort auf "Die Antwort ist:" festgelegt. Für das Spiel mit 24 Punkten verwenden wir "Schrittindex, aktuelle Menge:, zwei ausgewählte Zahlen:, Operation:, neue Zahl aus der Operation:, verbleibende Zahlen:, neue Zahlenmenge:". Dann vergleichen wir die Zahlen in der neuen Zahlenmenge direkt mit der Grundwahrheit. In Anlehnung an ToT Yao et al. (2024) verwenden wir die aus 100 schwierigen Spielen ermittelte Lösungsrate als Metrik.

4.1 Wichtigste Ergebnisse

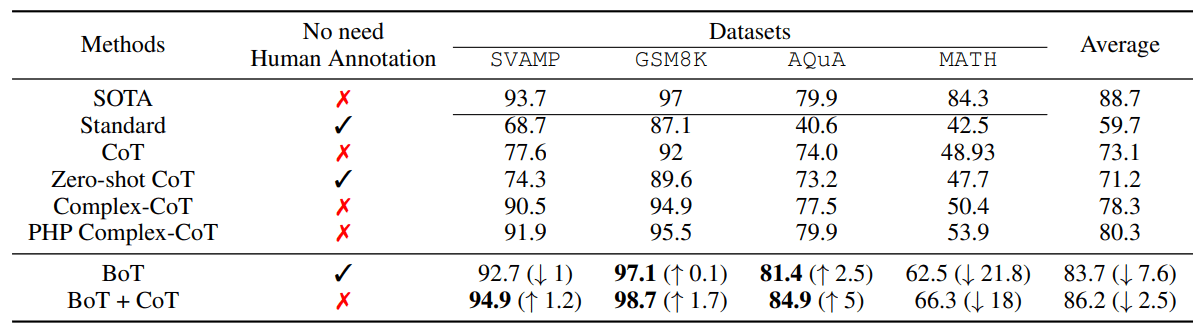

Die wichtigsten experimentellen Ergebnisse sind in Tabelle 1 und Abbildung 3 zusammengefasst, wo wir einen Einblick in die Gesamtleistung des BoT geben. Unsere Ergebnisse zeigen, dass die vorgeschlagene BoT durch Verstärkung des Mechanismus 1). wettbewerbsfähige Problemlösungsraten unabhängig von menschlichen Annotationen in den meisten Datensätzen erzielt; 2). einen neuen Stand der Technik bei der Bereitstellung von CoT-Beispielen erreicht. Die experimentellen Ergebnisse zeigen jedoch auch, dass BoT stark auf Erfahrung beruht und daher sehr empfindlich auf die Fähigkeiten von LLMs reagiert.

In Tabelle 1 beginnt BoT mit einfachen anfänglichen Hinweisen und übertrifft schließlich den aktuellen Stand der Technik CSV um 0,11 TP3T in Bezug auf die Lösungsrate auf GSM8K, die sich stark auf den GPT-4 Code-Interpreter stützt. Unter Berücksichtigung von AQuA übertrifft BoT SOTA um 2,51 TP3T. Dies zeigt, dass LLMs durch das Hinzufügen von Fehleranalysen und Vorschlägen zu den Hinweisen, ohne sich auf menschliche Annotationen zu verlassen, bei komplexer Argumentation gut abschneiden können. Der Hauptgrund dafür ist, dass einfache Hinweise schrittweise verbessert werden können, indem frühere Erfahrungen gesammelt werden, um Probleme korrekt zu lösen. Nach der Einbeziehung von CoT-Beispielen in die Eingabeaufforderungen ist BoT+CoT um 1,3% höher als SOTA. Wir argumentieren, dass CoT-Beispiele als erfolgreiche Erfahrungsfälle betrachtet werden können, die die Generierung nachfolgender Denkstrukturen in BoT direkt anleiten. Durch die iterative Verbesserung erreichte BoT+CoT eine neue SOTA.Währenddessen waren BoT und BoT+CoT, insbesondere BoT, mindestens 181 TP3T niedriger als SOTA in MATH.Diese Beobachtung impliziert, dass schwache LLMs aufgrund der geringen Fähigkeit von LLMs, Schlussfolgerungsketten für gültige Erfahrungen zu analysieren, möglicherweise nicht gut mit BoT funktionieren.

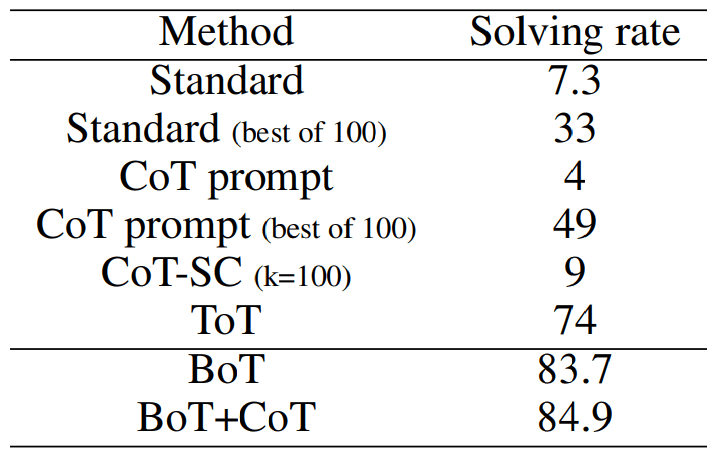

Tabelle 1: Die Verwendung von BoT in Verbindung mit GPT-4 verbessert die Leistung auch ohne manuelle Annotation erheblich.

Wenn der einfache BoT-Anfangshinweis CoT-Beispiele enthält, weist der entsprechende BoT+CoT-Ansatz höhere Lösungsraten auf. Unser Rahmenwerk wird auch mit führenden Ansätzen wie Model Selection von Zhao et al. 2023, PHP von Zheng et al. 2023 und CSV von Zhou et al. 2023 verglichen, die jeweils eine State-of-the-Art-Leistung (SOTA) auf den Datensätzen SVAMP, AQuA und GSM8K & MATH erzielen.

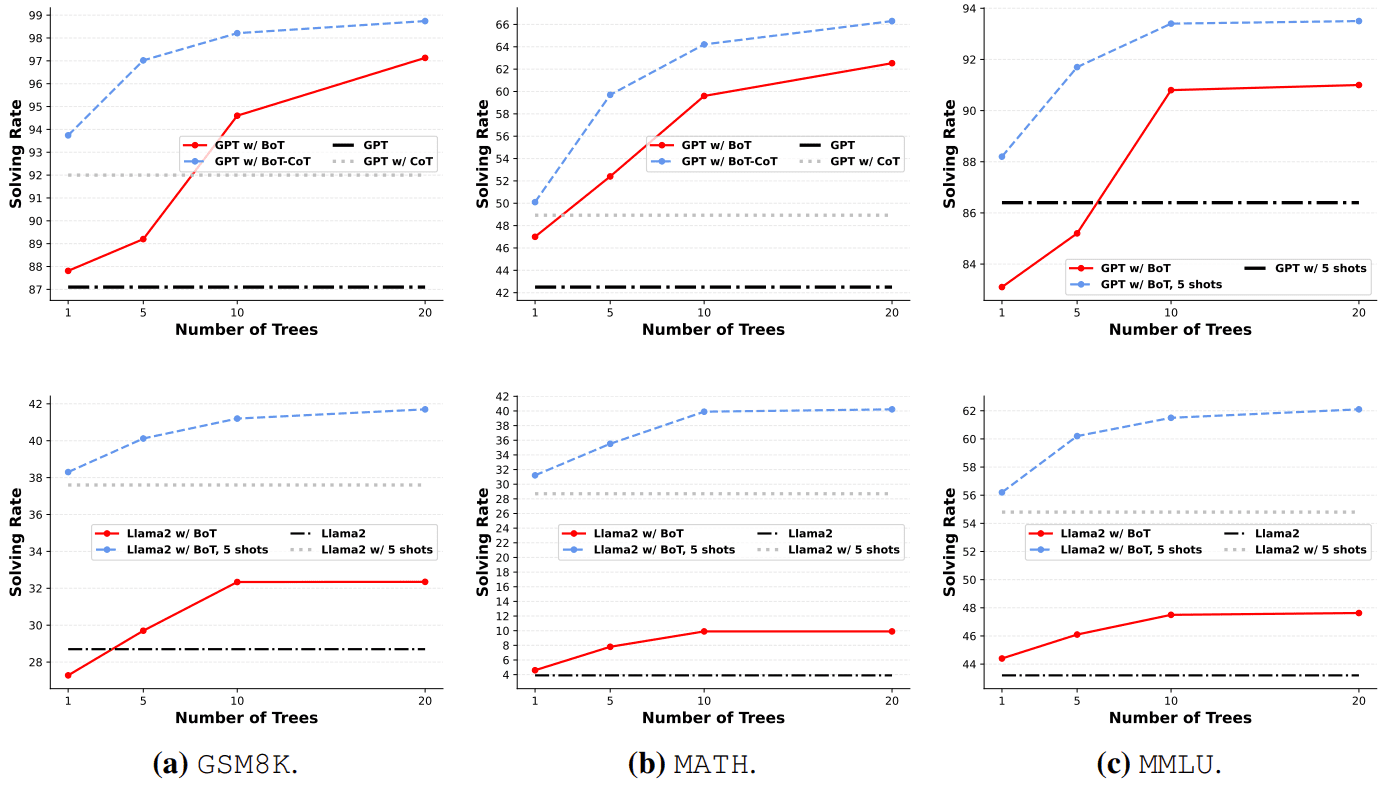

Abbildung 3: Verwendung von BoT und BoT+CoT zur Bewertung der Problemlösungsrate von GPT-4 OpenAI mit Llama2 Touvron et al. im Jahr 2023.

Wie in Abb. 3 zu sehen ist, verbessern GPT-4 und Llama2 die durchschnittliche Leistung unter BoT-Bedingungen in den drei Datensätzen um 11,61 TP3T bzw. 4,41 TP3T. Diese beiden Zahlen zeigen einen klaren Trend, dass BoT und BoT-CoT ähnlich gut abschneiden, wenn die LLMs leistungsfähiger sind, wie in Abbildung 3 dargestellt. Wenn sich die Anzahl der Bäume von 1 auf 20 ändert, zeigt sich außerdem ein ähnlicher Aufwärtstrend der Leistung. Aufgrund des schwächeren Llama2 kann BoT nicht von seinen Analysen profitieren, um einen erfahrungsgesteuerten iterativen Prozess durchzuführen, wie insbesondere in Abb. 3(a) gezeigt wird. Wenn gültige Erfolgsgeschichten vorliegen, d.h. 5 Tests, kann das BoT Llama2 immer noch helfen, mehr Probleme als die Baseline durch inkrementelle Verbesserungen zu lösen, wenn auch mit begrenzten Verbesserungen.

4.2 24-Punkte-Spiel

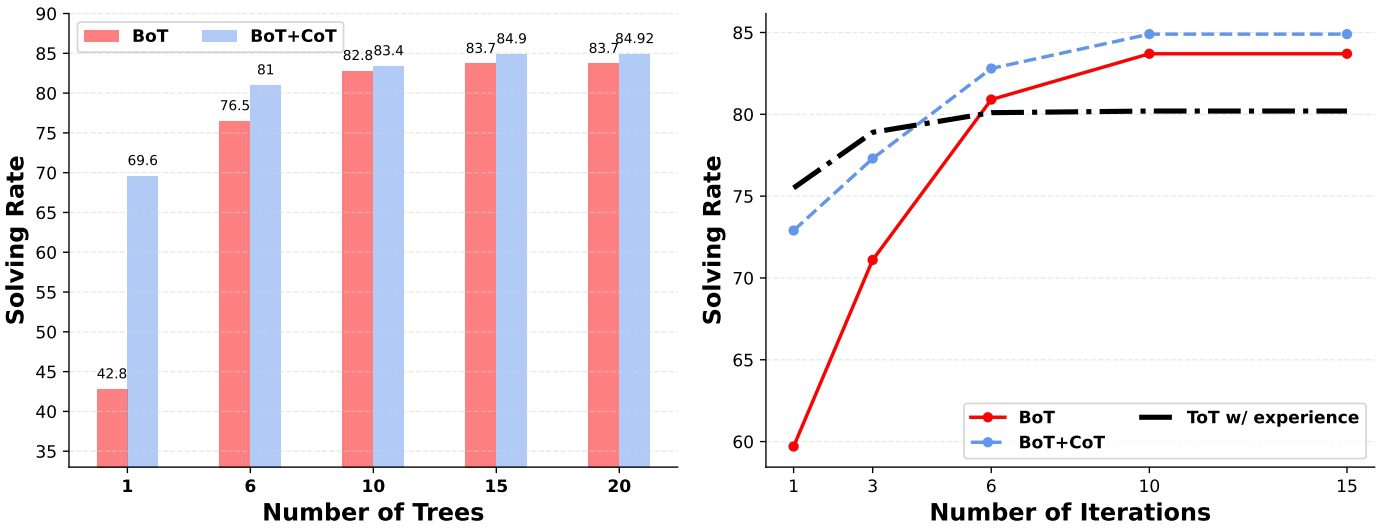

Abb. 4: Vergleich der drei Methoden bei unterschiedlicher Anzahl von Bäumen und Iterationen.

Tabelle 2: Aufbau der verschiedenen Methoden im 24-Punkte-Spiel in Anlehnung an den Aufbau in ToT Yao et al. (2024), deren Ergebnisse hier gezeigt werden.

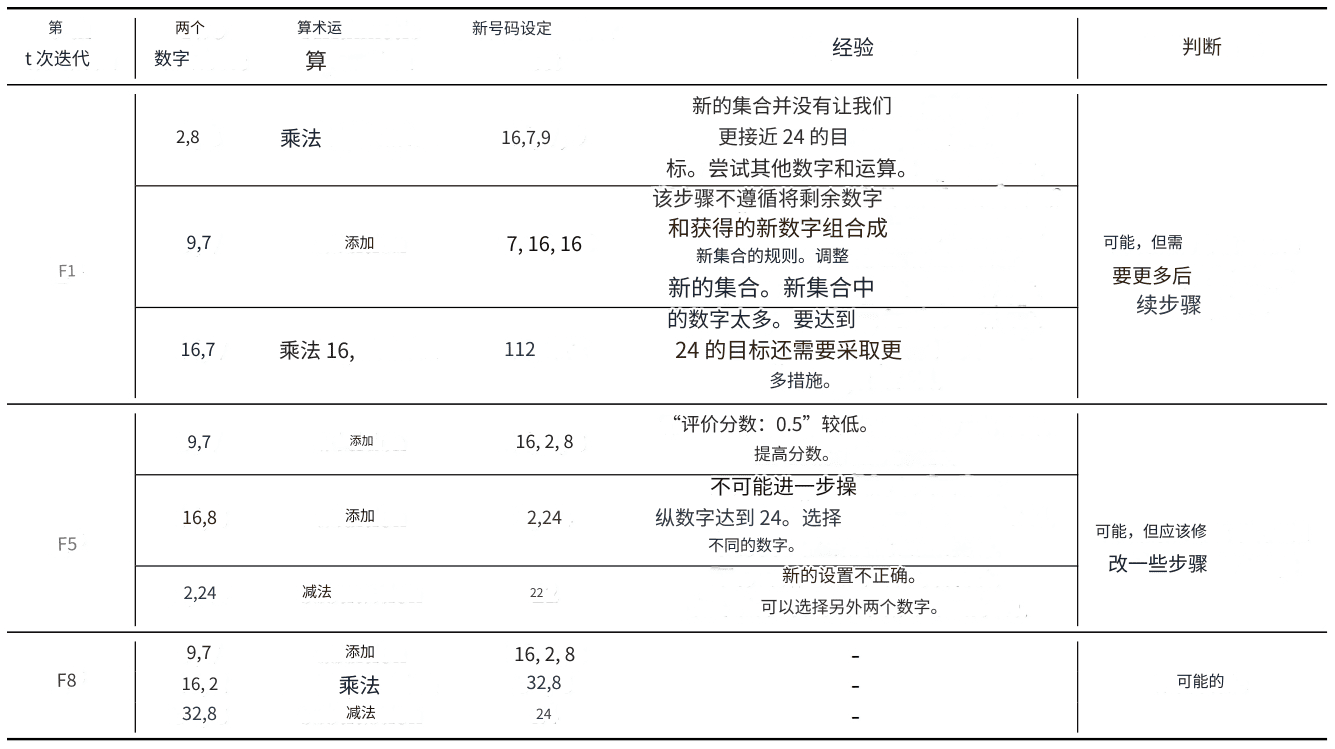

Tabelle 3: Zeigt den Denkprozess und die Erfahrungen, die während der ersten, fünften und achten Iteration gesammelt werden konnten. Die vier angegebenen Werte sind: 2, 7, 8 und 9.

Aufgrund der Schwierigkeit des Game of 24-Problems schnitten sowohl GPT-4 als auch Llama2 bei dieser Aufgabe schlecht ab, selbst bei der Kombination der Methoden CoT und CoT-SC. Das Llama2-Modell war nicht einmal in der Lage, die richtigen Regeln zur Lösung des Problems zu befolgen, was die Lösungsrate noch weiter senkte. Insbesondere bei der Anwendung von BoT, die auf Erfahrung beruht, sind alle Ergebnisse von Llama2 niedriger als 5%, ohne dass eine signifikante Verbesserung erzielt wird. Daher berichten wir nur über die Leistung von BoT mit GPT-4. Um einen fairen Vergleich zu ermöglichen, folgen wir dem von ToT Yao et al. (2024) vorgeschlagenen Aufbau.

Wie in Tabelle 2 gezeigt, übertrifft die BoT ohne menschliche Annotationen die ToT, die sich auf ein Beispiel stützt, um alle möglichen nächsten Schritte zu zeigen, um 9,71 TP3 T. Zusätzlich übertrifft die BoT+CoT, die 5 CoT-Shots enthält, die BoT um 1,21 TP3 T. Die Leistungsnähe zwischen der BoT und der BoT+CoT wird dem Boosting-Mechanismus zugeschrieben, der das schwache Denken inkrementell überarbeitet, wie in Unterabschnitt 4.1 diskutiert. Durch die Verwendung eines erfahrungsgesteuerten iterativen Prozesses weist BoT eine verbesserte Leistung auf, wenn die Anzahl der Bäume M und der Iterationen T steigt. Wie in Abb. 4 zu sehen ist, ist BoT stärker von M und T abhängig als BoT+CoT, da es Erfahrung aus besseren Gedankenketten oder längeren Iterationen erfordert. Eine weitere Beobachtung ist, dass die Problemlösungsrate von 72,51 TP3T in der ersten Iteration auf 80,21 TP3T in der zehnten Iteration ansteigt, wenn ToT mit erfahrenen Hinweisen arbeiten kann, was darauf hindeutet, dass Erfahrung - die Analyse früherer Gedankenketten - von LLMs genutzt werden kann, um die Lösungsrate deutlich zu verbessern. Dies ist auf die Tatsache zurückzuführen, dass die Aggregationsphase von BoT die repräsentativste Argumentationskette in der aktuellen Iteration hervorbringt und somit mehr aussagekräftige Erfahrung zur Verbesserung des Hinweises liefert. Wir haben dies im Abschnitt über die Ablationsstudie überprüft.

Um besser zu demonstrieren, wie BoT aus Fehlern und früheren Vorschlägen lernt, zeigen wir in Tabelle 3, dass GPT-4 in der Lage ist, frühere Fehler zu vermeiden und spezifischere Vorschläge zu generieren, wenn die Anzahl der Iterationen steigt, was schließlich zur richtigen Lösung führt. In der ersten Iteration machten die LLMs aufgrund einfacher Hinweise sogar einen Fehler bei der Befolgung der Aufgabenregeln, weil die neue Menge in Schritt 3 falsch war. Nach der Analyse machte es den richtigen Vorschlag für diesen Fehler. Die Analyse der ersten Iteration war jedoch vage, z. B. "versuchen Sie andere Zahlen und Operationen". Nach fünf Iterationen fasste der BoT mehrere solcher Analysen zusammen, was zu effektiveren Hinweisen führte, die die LLMs dazu brachten, die richtigen Zahlen 9 und 7 zu wählen. Außerdem waren die Vorschläge spezifischer und nützlicher. Für die richtige Wahl wurde vorgeschlagen, die Bewertungsnote entsprechend zu erhöhen. Durch das Sammeln solcher Erfahrungen verfeinerte BoT schrittweise die Hinweise und generierte schließlich in der 8. Iteration direkt die richtige Lösung.

4.3 Studien zur Ablation

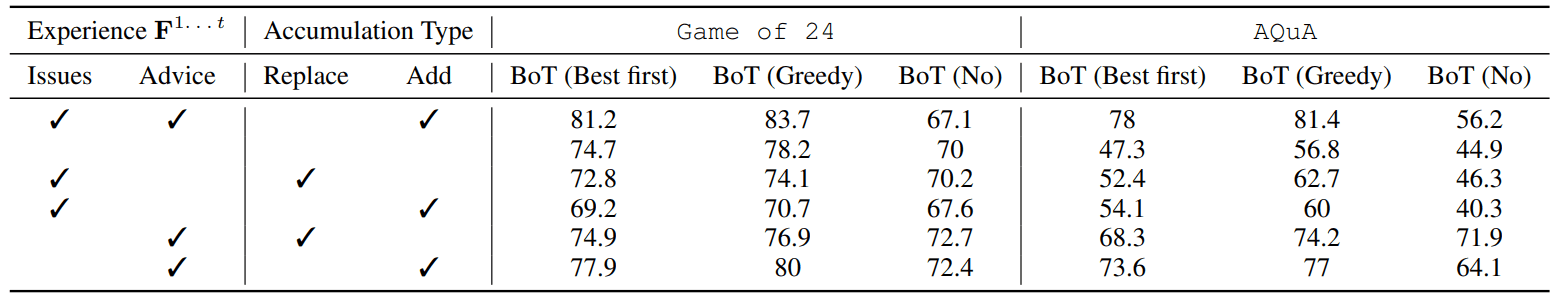

Tabelle 4: Vergleich von GPT-4 mit verschiedenen BoT-Varianten, die für das 24-Punkte-Spiel und den AQuA-Datensatz verwendet wurden.

Alle Aggregationsstrategien führen zu hohen Lösungsraten, wenn Probleme und Vorschläge in einer "additiven" Weise zusammengefasst werden. Die Aufrechterhaltung einer vollständigen Erfahrung ist besonders wichtig für revisionistisches Denken, vor allem für den AQuA-Datensatz, der ein breiteres Spektrum an mathematischen Argumentationsproblemen abdeckt. BoT(No), das alle Argumentationsketten des Spannbaums direkt und ohne Aggregation verwendet, schneidet jedoch in allen Kontexten am schlechtesten ab, vor allem, wenn die kumulative Art der Erfahrung "kumulativ" ist.BoT baut 15 Bäume pro Iteration auf, und wenn man alle in einem Hinweis zusammenfasst, können wichtige Informationen verdeckt werden, ganz zu schweigen von den meisten Informationen im Hinweis. Eine solche Erfahrung kann ungültig oder schädlich sein.

Die Einholung von Ratschlägen ist für den Anstoß zum Nachdenken entscheidender als alles andere.. In allen in Tabelle 4 genannten Beispielen erreicht die BoT-Variante, die Vorschläge als Erfahrung behandelt, die höchsten Lösungsraten. Im gleichen Fall des "additiven" Typs, ohne Vorschläge in der Erfahrung, sinkt die Leistung beispielsweise um mehr als 101 TP3T und 201 TP3T im "24-Punkte-Spiel" bzw. AQuA. BoTs mit Vorschlägen können nur dann die besten Lösungsraten erzielen, wenn sie mit Problemen gepaart sind. In AQuA zum Beispiel stieg die Lösungsrate von BoT (gierige Methode) um 4,41 TP3T.

Aus Leistungsgründen kann die Greedy Rallye die einzige Option sein, die notwendig ist. Im Gegensatz zum Ansatz der höchsten Priorität, bei dem eine der bestehenden Gedankenketten ausgewählt oder alle beibehalten werden, können gierige Agglomerationen die Baumstruktur adaptiv zu einer besseren Gedankenkette zusammenfügen, die in der aktuellen Iteration möglicherweise nicht vorkommt. Auf diese Weise kann LLM aussagekräftige Analysen einer robusteren Gedankenkette durchführen und als Ergebnis wichtige Erkenntnisse zur Ergänzung des Hinweises generieren. In AQuA, das mehr mathematische Probleme enthält, erreicht diese Zahl sogar 101 TP3 T. Wie wir in Abbildung 4 erörtert haben, liegt ToT trotz eines ähnlichen erfahrungsbasierten Boosting-Mechanismus, der 801 TP3 T erreichen kann, immer noch hinter BoT zurück, was darauf zurückzuführen sein könnte, dass es nicht in der Lage ist, gierige Agglomerationen innerhalb seiner einzigen Baumstruktur durchzuführen.

5. schlussfolgerung

In diesem Beitrag bestätigen wir, dass ein einfacher Hinweis zur Lösung komplexer Aufgaben verwendet werden kann, indem wir schrittweise Fehleranalysen der von ihm generierten Gedanken anhäufen. Wir schlagen ein neuartiges Rahmenwerk namens Boosting of Thoughts (BoT) vor, das diese allmähliche Erweiterung des Hinweises durch einen erfahrungsgesteuerten iterativen Prozess zur Erzeugung effektiver Gedankenketten ermöglicht. Eine einfache baumartige Gedankenkette, die durch iterative Erkundung und Selbsteinschätzung erzeugt wird, ermöglicht es, einen einfachen anfänglichen Hinweis durch eine Reihe von Versuch-und-Irrtum-Erfahrungen schrittweise zu erweitern, die zu einer genauen Lösung führen. Unsere umfangreichen Experimente zeigen, dass BoT in der Lage ist, bei mehreren Benchmark-Datensätzen Spitzenleistungen zu erzielen und andere führende Methoden bei der anspruchsvollen mathematischen Denkaufgabe Game of 24 zu übertreffen.

Ein BoT mit grundlegenden Hinweisen und Argumentationsprozessen

A1 BoT für die Komponente Gedankengenerierung

In diesem Abschnitt werden die grundlegenden Hinweise erwähnt, die für die Generierung von Argumenten für das vorgeschlagene Boosting of Thought (BoT) verwendet werden. Für spezifische Details können Sie die Beispieldatei des Quellcodes besuchen: /examples/BoostingOfThought/BoT reasoner.py.

System-Tipp:

Sie sind ein Experte für mathematische Probleme. Führen Sie schrittweises Problemlösen durch, indem Sie aus einer Reihe von Versuch-und-Irrtum-Problemlösungen lernen. Zu diesen Versuch-und-Irrtum-Erfahrungen gehören insbesondere Fehlerberichte sowie detaillierte Vorschläge zur Änderung früherer Argumentationsschritte. Es ist wichtig, diese aufgelisteten Erfahrungen zu überprüfen, bevor neue Argumentationsschritte entwickelt werden, um die Wiederholung von Fehlern zu vermeiden und gleichzeitig die richtigen Schritte zu verwenden, um bessere Argumentationsschritte für die Lösung von Problemen zu entwickeln.

System-Eingabeaufforderung S.

Sie sind ein Experte für mathematische Probleme und können Schritt für Schritt argumentieren.

zur Problemlösung, indem sie zunächst aus einer Reihe von Versuch-und-Irrtum-Erfahrungen lernen.

Eine solche Trial-and-Error-Erfahrung beinhaltet insbesondere Fehlerberichte und detaillierte Hinweise zu

Wie man die Schritte des historischen Denkens überarbeitet. Erinnern Sie sich immer an diese aufgelisteten Erfahrungen, bevor Sie eine

neuen Argumentationsschritt, wodurch dieselben Fehler vermieden und korrekte Schritte wiederverwendet werden, um die

bessere Argumentationsschritte zur Lösung der Aufgabe.

Erzeugen Sie eine Aufforderung für den nächsten Gedanken:

f"""

{Mission Alert} \n

Erinnern Sie sich zunächst an die vorherige Argumentationserfahrung: \n\n

{Erfahrung}

Bitte stellen Sie den nächsten möglichen Argumentationsschritt vor, und es kann nur einen geben. Dieser Argumentationsschritt sollte als sequentieller Nachfolger der folgenden geordneten Schritte verwendet werden und sollte mit einer entsprechenden Bewertungspunktzahl versehen werden (höhere Punktzahlen bedeuten eine höhere Wahrscheinlichkeit, die Aufgabe zu lösen):\n\t

(chain hint)

Erzeugen Sie auf der Grundlage der obigen Schritte für die Vorgeschichte (oder ignorieren Sie sie, wenn das obige Feld leer ist) einen eindeutigen nächstmöglichen Schritt auf der Grundlage der Aufgabenregeln. (WICHTIG: Erzeugen Sie bitte nur den nächstmöglichen Folgerungsschritt für einen bestimmten Schritt).

"""

f"""{Aufgabenstellung}. \n Zunächst einmal, erinnern Sie sich an historische Argumentationserfahrungen: \n\n {

Erfahrungen} \n\n Bitte machen Sie einen Schritt der Argumentation, um nur einen nächsten

Dieser nächste Argumentationsschritt ist der Folgeschritt von Dieser nächste Argumentationsschritt ist der Folgeschritt von

die folgenden geordneten vorangegangenen Schritte , zusammen mit ihren bewerteten Noten (A

Eine höhere Punktzahl bedeutet, dass die Aufgabe mit größerer Wahrscheinlichkeit gelöst werden kann). : \n\t{

Kette prompt}\n\n Auf der Grundlage der aufgelisteten vorherigen Argumentationsschritte (ignorieren Sie diese, wenn die

obiges Feld leer ist), erzeugen Sie einen einzigen möglichen nächsten Schritt nach der Aufgabe

Regel . (Hervorgehoben: Bitte erzeugen Sie nur einen einzigen möglichen nächsten Argumentationsschritt von

die angegebenen Schritte). """

Die Aufgabenaufforderung enthält das X und Q der Aufgabe, und die historische Erfahrung ist F1.... Der Teil "Kettenhinweis" ist {Gi}, der ein Platzhalter ist, der beim Ausführen des aktuellen Gedankens zi durch die vorherige Gedankenreihe z1...,i-1 ersetzt wird. ,i-1.

Tipps zum Nachdenken über die Bewertung:

f"""

{Mission Alert} \n\n

Nachfolgend sind die Argumentationsschritte in der richtigen Reihenfolge aufgeführt, zusammen mit den jeweiligen Bewertungsergebnissen. (Eine höhere Punktzahl bedeutet, dass der Schritt eher geeignet ist, die Aufgabe zu lösen). \n

{Ketten-Hinweis

{Das Denken}

Mit welcher Punktzahl bewerten Sie, wie logisch und korrekt diese Argumentationsschritte sind und wie hilfreich sie für die endgültige Lösung sind? Bitte wählen Sie eine von [0.1, 0.3, 0.5, 0.7, 0.9, 1.0] als Punktzahl, wobei höhere Punktzahlen für bessere Argumentationsschritte stehen. Die Punktzahl sollte für den Benutzer lesbar hinter "Bewertungspunktzahl:" stehen. """"

f"""{Aufgabenstellung}. \n\n Nachfolgend sind die generierten Argumentationsschritte in der Reihenfolge aufgeführt.

zusammen mit ihrer Bewertung (eine höhere Punktzahl bedeutet, dass der Argumentationsschritt

die Aufgabe wahrscheinlicher zu erledigen). Was ist Ihr Gedanke?

Bewertungspunkte für die Logik, die Korrektheit und den Nutzen, um zu einer endgültigen

Lösung für diese Argumentationsschritte? Bitte wählen Sie einen Wert aus [0.1, 0.3, 0.5,

0,7, 0,9, 1,0] als Punktzahl, wobei eine höhere Punktzahl bessere Argumentationsschritte bedeutet. Die

score sollte nach " Evaluation score :" stehen, damit die Benutzer es lesen können .""""

In diesem Fall ist das Denken das Denken Zi, das gerade im Gange ist.

A2 BoT für die Komponente Erlebnispädagogik

Um Feedback zu aggregierten Ketten zu erzeugen, verwenden LLMs die folgenden grundlegenden Eingabeaufforderungen. Für weitere Informationen können Sie auch den Quellcode examples/BoostingOfThought/BoT commenter.py besuchen.

System Prompt S: Sie sind ein KI-Experte für Maths Answers und arbeiten an der Bewertung der Argumentationskette, die zur Lösung eines mathematischen Problems erstellt wurde. Bitte bewerten Sie jeden Argumentationsschritt dieser Argumentationskette, indem Sie eine detaillierte Analyse erstellen, um festzustellen, ob der aktuelle Schritt eine logische Schlussfolgerung aus dem vorherigen Schritt ist und ob der Argumentationsschritt zur richtigen Lösung beiträgt. Geben Sie bitte für jeden fehlerhaften Argumentationsschritt einen Fehlerbericht und entsprechende Änderungsvorschläge an. Geben Sie für jeden korrekten Argumentationsschritt eine Beschreibung der Empfehlung oder Ablehnung.

System-Tipp:

Ihre Rolle ist die eines geschickten AI Maths Answer Reviewers, der sich darauf konzentriert, den Denkprozess beim Lösen von Matheaufgaben zu bewerten. Sie müssen jeden Argumentationsschritt durch eine erschöpfende Analyse beurteilen, um zu sehen, ob er auf der Logik des vorherigen Schritts basiert und ob dieser Schritt dazu beigetragen hat, die richtige Antwort zu finden. Wenn Sie auf einen falschen Rechenschritt stoßen, müssen Sie Vorschläge und Möglichkeiten zur Änderung machen. Bei korrekten Argumentationsschritten müssen Sie diese bejahen oder andere Optionen angeben.

System-Eingabeaufforderung S.

Sie sind ein Experte für AI-Checker für mathematische Antworten, der sich der Bewertung der

Argumentationskette, die zur Lösung des mathematischen Problems erstellt wurde. Beurteilen Sie jede Argumentation

Schritt dieser Argumentationskette, indem er detaillierte Analysen darüber liefert, ob der aktuelle Schritt ein logischer ist

Schlussfolgerung des vorangegangenen Schritts und ob der Schlussfolgerungsschritt der richtigen Lösung zuträglich ist.

Geben Sie Ratschläge und Vorschläge für jeden Argumentationsschritt mit Fehlern. Geben Sie eine Empfehlung oder

Ablehnungsbeschreibungen für jeden korrekten Argumentationsschritt.

Feedback-Tipp:

f"""

Für die gegebene Aufgabe:{Task hint}. \n

{Grundlagenketten-Hinweise}

Bitte bewerten Sie diese Argumentationskette und formulieren Sie eine ausführliche Kritik, die die folgenden Punkte umfasst. \n

1. {Ketten-Feedback-Format}. 2. {Schritt-Feedback-Format}. 3. {Vertrauens-Feedback-Format}. 4. \n\n

Caveat: {Caveat}

f"""Gegebene Aufgabe:{Aufgabenaufforderung}. \n{chain prompt}\n\n Bitte bewerten Sie diese Argumentationskette

indem sie ausführliche Kommentare mit folgendem Inhalt abgeben. \n 1.{

Format der Kettenrückmeldung }. 2.{ Format der Schrittrückmeldung }. 3.{ Format der Vertrauensrückmeldung }. \n

\n Hinweis: {Notice}.

darunter auchHinweise zur Argumentationsketteist eine aggregierte Inferenzkette z1.... .n.

Format der KettenrückmeldungKann diese Argumentationskette die Aufgabe korrekt erfüllen und das Ziel erreichen, indem sie ihre Argumentationsschritte ausführt? Warum? Schreiben Sie die abschließende Analyse unter "Analysebericht:" auf.

Schritt-für-Schritt-Feedback-FormatFür jeden Argumentationsschritt geben Sie bitte eine detaillierte Analyse, ob der aktuelle Schritt eine logische Ableitung aus dem vorherigen Schritt ist und ob der Argumentationsschritt zur richtigen Lösung beiträgt. Geben Sie bitte für jeden fehlerhaften Argumentationsschritt einen Fehlerbericht und entsprechende Empfehlungen zur Überarbeitung an. Geben Sie für jeden Argumentationsschritt eine Beschreibung der Empfehlung oder Ablehnung. Die Kommentare sollten prägnant sein und folgendem Format folgen: Argumentationsschritt ⟨idx⟩. Analysen ⟨idx⟩. Empfehlung:. Empfehlung oder Ablehnung Beschreibung:.

Format des VertrauensfeedbacksWie hoch ist Ihr Vertrauen in diese Bewertungen und Rezensionen? Bitte wählen Sie einen Wert aus [0,1, 0,3, 0,5, 0,7, 0,9, 1,0] als Wert, den der Benutzer lesen kann.

Mit Hilfe von Feedback-Hinweisen erzeugen LLMs empirische Ft, die Schlussfolgerungen und Analysen der Argumentationskette und jedes Argumentationsschritts enthalten.

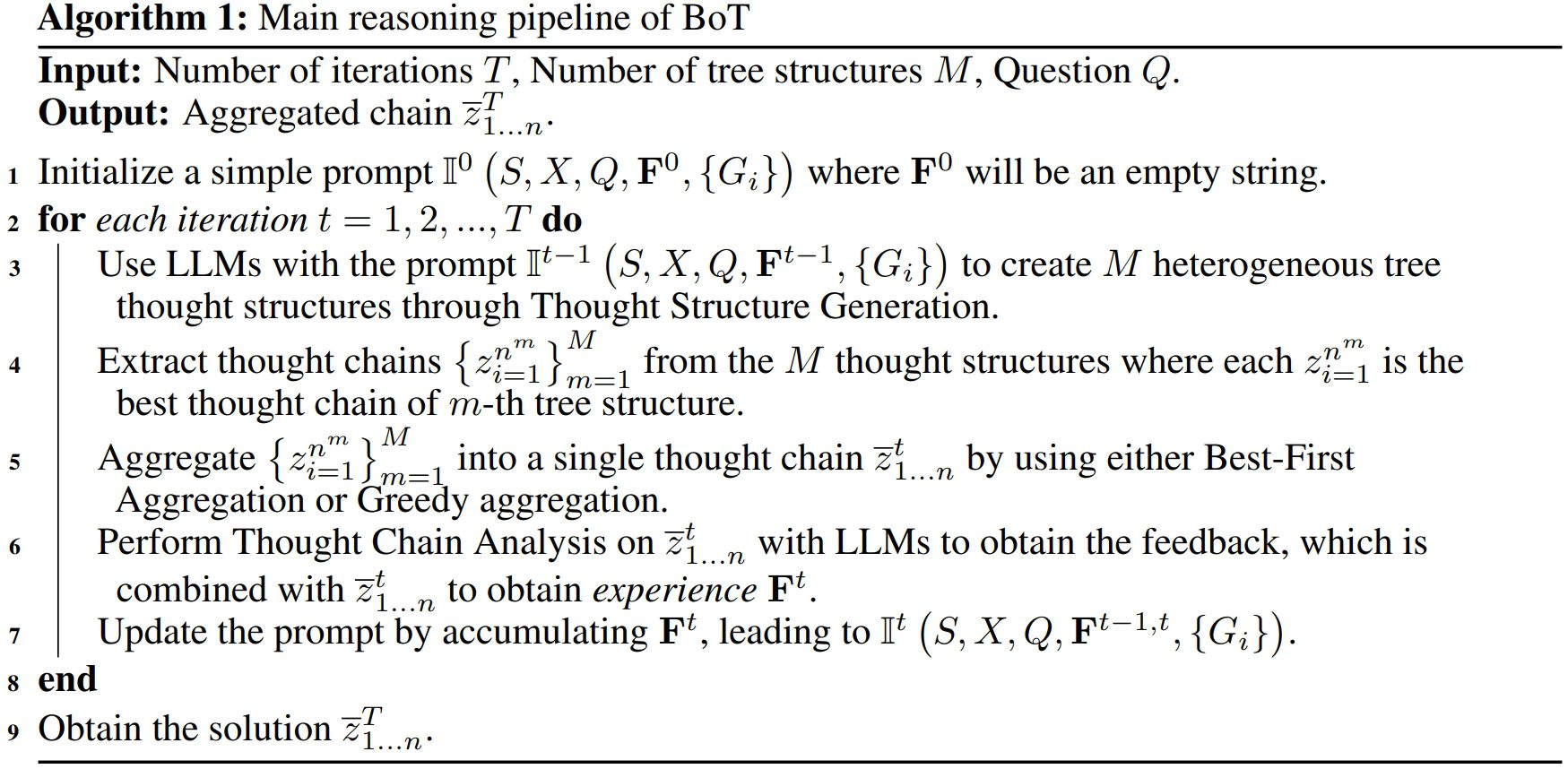

A3 Begründungsprozess

Um das Verständnis des vorgeschlagenen Boosting of Thoughts zu erleichtern, fassen wir den Inferenzfluss in Algorithmus-Tabelle 1 zusammen. Der Quellcode dieses Flusses ist in der Datei examples/BoostingOfThought/BoT core.py zu finden.

BoT Original

Der Inhalt des Bildes ist eine schrittweise algorithmische Darstellung einer Theorie, die "BoT" genannt wird, und das Folgende ist ihre chinesische Übersetzung, die den folgenden algorithmischen Schritten entspricht:

Algorithmus 1: Der Hauptschlussfolgerungsprozess von BoT

Eingaben: Anzahl der Iterationen T, Anzahl der Baumstrukturen M, Problem Q.

Ausgabe: aggregierte Kette z̄_1.... .n^T1. einen einfachen Hinweis I^0 (S, X, Q, F^0, {Gi}) initialisieren, wobei F^0 eine leere Zeichenkette sein wird.

2. jede Iteration t = 1, 2, ... , T.

3. die Stichwörter I^t-1 (S, X, Q, F^t-1, {Gi}) mit dem LLMS (Low Latent Mixed Model) zu verwenden, um M verschiedene Gedankenstrukturen in einem Prozess namens Thought Structure Generation zu erzeugen.

4. extrahiere die Gedankenkette {z̄_i=1....n^m} aus M Gedankenstrukturen, jede z̄_i=1.... .n^m}, jedes z̄_i=1... .n^m ist die beste Gedankenkette der m-ten Baumstruktur.

5. die Methode der "Best-First-Aggregation" oder "Greedy-Aggregation" anwenden, um {z̄_i=1...n^m} in eine einzige Gedankenkette z̄_1...n^m} zu überführen. .n^m} in eine einzige Gedankenkette z̄_1...n^t. .n^t.

6. verwenden Sie LLMS, um eine "Gedankenkettenanalyse" für z̄_1.... .n^t durchzuführen, eine Rückmeldung zu erhalten und diese mit z̄_1.... .n^t und kombinieren sie mit z̄_1...n^t, um die Erfahrung F^t zu erhalten.

7. den Hinweis durch Akkumulation von F^t zu I^t aktualisieren (S, X, Q, F^t-1,t, {Gi}).

8. schlussfolgerung

9. der Zugang zu Lösungen z̄_1.... .n^T

B Einblicke zur Förderung des Denkens

Die Verstärkung der Gedanken beruht auf unserer Erkenntnis, dass die Fähigkeit von Large Language Models (LLMs), mathematische Probleme zu lösen, direkt von Erfahrungen abgeleitet ist, die Analysen und Vorschläge für frühere Fehler enthalten. Sobald die Hinweise gültige historische Argumentationserfahrungen enthalten, an die sich LLMs vor der Durchführung der Argumentation erinnern können, sind die resultierenden Argumentationsschritte typischerweise logischer und rationaler, wie der Vergleich der Tabellen 5 und 6 zeigt. Diese Erkenntnisse führten uns auch zu der Überlegung, dass LLMs sich nicht in hohem Maße auf gut vorbereitete Prompts für jede Aufgabe verlassen müssen (mehrere Gedankenketten-Demonstrationen in den Prompts dienen als Beispiele). Da LLMs jedoch in der Lage sind, aus Erfahrung zu lernen, können wir mit einer einfachen Aufforderung beginnen, die keine Beispiele oder manuell gestalteten Inhalte erfordert, und nach und nach Erfahrungen sammeln, während wir argumentieren. Letztendlich erreichen LLMs durch das Sammeln von Erfahrungen mit dem Hinweis eine robuste Argumentation zur Lösung komplexer Probleme. Auf der Grundlage dieser Erkenntnisse wurde Boosting of Thoughts als automatisiertes Prompting-System entwickelt, das Probleme durch das iterative Sammeln einer Sammlung von Trial-and-Error-Erfahrungen beim Denken löst. Wir argumentieren, dass das vorgeschlagene BoT keine Anwendung von LLMs auf eine spezifische Aufgabe ist, sondern vielmehr auf der Einsicht aufbaut, dass die Argumentationskraft von LLMs direkt aus der Analyse der Fehleranalyse von fehlerhaften Inferenzketten gewonnen werden kann, ohne sich auf menschliches a priori Wissen zu verlassen.

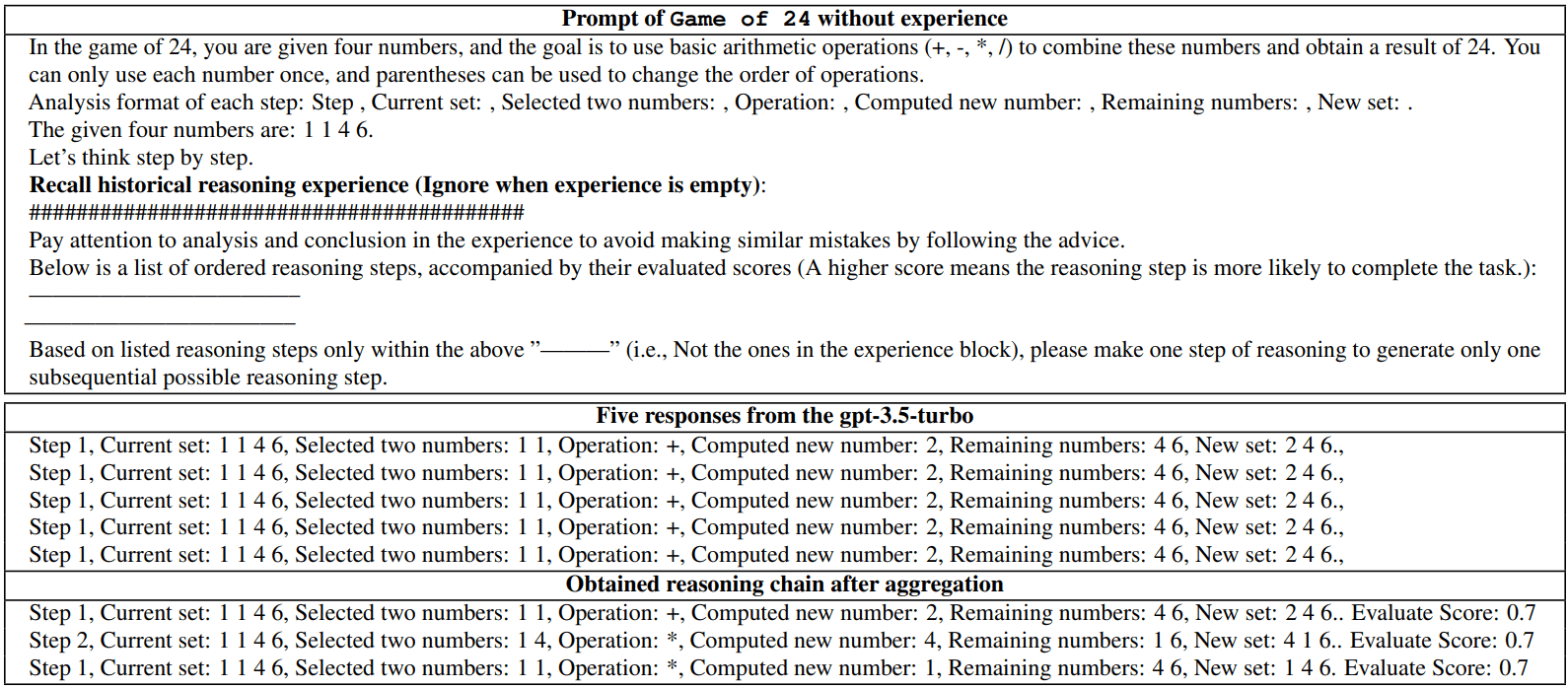

Um unsere Erkenntnisse zu verdeutlichen, teilen wir die folgenden drei Schlüsselbeobachtungen mit, die auf dem folgenden Datensatz von 24 Spielen unter Verwendung des gpt-3.5-Turbomodells mit einer Temperatur von 0,7 und einem Spitzen-P-Wert von 0,7 basieren.

Die Erfahrung in der Aufforderung ermutigt LLMs, mehr Logik in ihren Antworten zu finden.Wie aus Tabelle 5 hervorgeht, generierte das Modell fünfmal denselben Argumentationsschritt, wenn keine Erfahrung im Hinweis enthalten war. Diese Beobachtung zeigt ein häufiges Problem bei LLMs, nämlich die fehlende Eigenmotivation, verschiedene Argumentationslogiken zu erkunden. So kann es sein, dass LLMs trotz ihres starken Denkpotenzials in einem Zyklus stecken bleiben, der mit dem einfachsten Denkschritt beginnt, der möglicherweise nie zu einer endgültigen Lösung führt. Der Abschnitt "Acquired Reasoning Chains" in Tabelle 5 zeigt fehlerhafte Schlussfolgerungsketten. Wir gehen davon aus, dass solche sich wiederholenden Schlussfolgerungsschritte, wie in Tree of Thoughts Yao et al. (2024), wo die Knoten des Baums durch die Generierung mehrerer Antworten als Gedanken konstruiert werden, den Algorithmus in einigen Fällen zum Scheitern bringen können. In der zweiten Iteration von BoT führte die Einführung von Erfahrung in die Prompts jedoch zur Generierung verschiedener anfänglicher Inferenzschritte, wie in Tabelle 6 dargestellt. Die endgültige Inferenzkette kann schließlich zur richtigen Lösung führen, wenn sie von einer größeren Bandbreite möglicher Logiken ausgeht.Weng et al. (2023)

LLMs vermeiden es, ähnliche Fehler zu machen, die in der Erfahrung hervorgehoben wurden.Wenn die Erfahrung nicht in die Aufforderungen einbezogen wird, die eine Fehleranalyse beinhalten, werden die LLMs viele Fehler machen, wie z.B. das Abweichen von den Aufgabenregeln und das Zurückfallen auf den anfänglichen Argumentationsschritt im endgültigen Prozess, wie im Abschnitt "Erworbene Argumentationskette" in Tabelle 5 gezeigt. Nach der Analyse dieser Argumentationskette und der Einbeziehung des Feedbacks als Erfahrung in die Prompts für die zweite Iteration des BoT ist aus Tabelle 6 ersichtlich, dass die LLMs die Erfahrung gut lernen, bevor sie argumentieren. Erstens wiederholte keine der Antworten die gleichen fehlerhaften Argumentationsschritte wie die verschiedenen anfänglichen Argumentationsschritte, die in "Fünf Antworten von gpt-3.5-turbo" gezeigt werden. Zweitens konnten die LLMs alle zuvor identifizierten Fehler erfolgreich vermeiden, indem sie sich strikt an die Aufgabenregeln hielten, falsche Schlussfolgerungen ausschlossen und logische Schlussfolgerungsschritte durchführten. Drittens führte dies schließlich zur korrekten Lösung der Aufgabe "1 1 4 6" (Game of 24). Andere Arbeiten, wie Weng et al. (2023); Madaan et al. (2023); Zheng et al. (2023), haben ebenfalls die Bedeutung der Ergänzung von Hinweisen durch Feedback, d. h. eine Selbsteinschätzung früherer Antworten, hervorgehoben. BoT ist jedoch eine bahnbrechende Arbeit, die auf der Einsicht beruht, dass Erfahrung, die eine Fehleranalyse einschließt, zu einer starken Argumentation bei LLMs führen kann.

Ohne menschliche Anmerkungen organisieren LLMs automatisch effektive Argumentationsketten, um komplexe Probleme auf der Grundlage von Erfahrungen zu lösen.BoT ist die bahnbrechende Initiative, die ein automatisiertes Prompting-Rahmenwerk vorschlägt, das die Einsicht nutzt, dass LLMs effektive Argumentationsfähigkeiten zur Problemlösung durch Fehleranalyse und Anleitung allein durch Erfahrung erwerben können, ohne dass eine menschliche Kommentierung erforderlich ist. Wie in Tabelle 5 gezeigt, ist dies die erste Iteration von BoT, und die anfänglichen Hinweise enthalten nur grundlegende Aufgabenanleitungen und Fragen ohne kontextbezogene Lernbeispiele wie in CoT. Obwohl die Inferenzketten, die von LLMs unter Verwendung solcher Eingabeaufforderungen erhalten wurden, viele Fehler und ungültige Inferenzschritte enthalten, können ihre Fehleranalysen und Vorschläge als gelernte Lektionen in die Eingabeaufforderungen aufgenommen werden, um von der zweiten Iteration der Inferenz zu profitieren, wie in Tabelle 6 gezeigt. Es kann beobachtet werden, dass LLMs ohne menschliche Anleitung zum korrekten Schlussfolgern Wissen aus Erfahrung gewinnen können, einschließlich Fehleranalysen und Anleitungen, die aus zuvor generierten Schlussfolgerungsketten gewonnen werden, was zu inkrementellen Verbesserungen beim Lösen von Schlussfolgern führt.

Somit bietet unser BoT eine langfristige Orientierung für die Forschung, da es die Bedeutung der Analyse von Erinnerungsfehlern und Vorschlägen aufzeigt, wenn LLMs in die Lage versetzt werden, effektive Denkprozesse für komplexe Aufgaben zu entwickeln. Mit diesen Erkenntnissen kann sich die Cue-Engineering-Forschung zur Induktion von Argumentationsfähigkeiten bei LLMs darauf konzentrieren, wie man Erfahrungen generiert, anstatt mehr menschliches A-priori-Wissen einzuführen.

C Generierung von Denkstrukturen

BoT ist ein automatisiertes Prompting-System, das iterativ Erfahrungen aus Inferenzkettenanalysen sammelt. Als solches ist BoT für eine Vielzahl von Methoden zur Gedankengenerierung und LLMs verallgemeinerbar, die in der Lage sind, Schlussfolgerungsschritte zu generieren und zu bewerten, wobei die Leistung von BoT von der Effektivität seiner Gedankengenerierungsstruktur abhängt. Daher verwendet BoT die neueste Struktur, den Tree of Thought (ToT) Yao et al. (2024), als Basismodell für die Generierung von Argumentationsketten in jeder Iteration. Wie im Hauptbeitrag erwähnt, könnte das Basismodell für die Generierung von Gedanken auch ein Thinking Graph (GoT) Besta et al. (2023) sein, d.h. BoT mit GoT. Aufgrund von Zeitbeschränkungen und der Tatsache, dass der aktuelle GoT noch nicht auf mathematische Probleme angewandt wurde, verwendet der BoT-Entwurf jedoch ausschließlich ToT. Wenn er als Basismodell im Boosting-Mechanismus verwendet wird, kann die Gedankenstruktur in jeder Iteration außerdem leicht gehalten werden. Letztendlich erzeugt die vorgeschlagene BoT heterogene Baumstrukturen, von denen jede ein leicht gewichteter Binärbaum ist.

C1 Next Thinking Generation und Kantengewichtsberechnung

Unter Verwendung des in Abschnitt A besprochenen Hinweises zur Generierung des nächsten Gedankens können LLMs Hinweise generieren, indem sie die Erfahrung F1.... .t und Ersetzen von {Gi} durch z1... ,i-1 ersetzt {Gi}, um den nächsten möglichen Gedanken für einen Argumentationsschritt zi zu generieren. Für einen Argumentationsschritt zi verwenden LLMs den Gedankenbewertungshinweis, um Bewertungswerte als Kantengewichte zwischen zi und zi-1 zu erzeugen. Der Quellcode in examples/BoostingOfThought/BoT reasoner.py enthält eine detaillierte Beschreibung des Verfahrens. Als direktes Beispiel für die Anwendung von BoT auf "3 5 6 8" in Game of 24 unter Verwendung von gpt-3.5-turbo zeigen die Tabellen 7 und 8 die Generierung der Gedanken, während Tabelle 9 zeigt, wie sie berechnet werden.

C2 Der Bedarf an heterogenen Baumstrukturen

In jeder Iteration von BoT wird die heterogene Baumstruktur aufgebaut, um einen größeren Suchraum für Inferenzen zu erkunden und die Robustheit zu verbessern. Wie im Quellcode unter examples/BoostingOfThought/BoT core.py zu sehen ist, werden die Temperatur- und Top p-Werte der LLMs in jedem Baum aus den Bereichen [0.2, 0.4, 0.6, 0.7, 0.9, 1.1, 1.5] bzw. [0.1, 0.3, 0.5, 0.7, 0.9] ausgewählt. Die Baumwachstumsstrategie kann Schicht für Schicht oder Blatt für Blatt erfolgen. Wir haben die folgenden zwei Vorteile dieser Heterogenität festgestellt.

Die Heterogenität erweitert den Suchraum für die Inferenz und erhöht somit die Konvergenzgeschwindigkeit.Wenn verschiedene Bäume für unterschiedliche Zwecke konstruiert werden, z. B. unter Verwendung einer Schicht-für-Schicht-Strategie oder unter Verwendung einer Blatt-für-Blatt-Strategie und basierend auf zufälligen oder deterministischen LLMs, können die generierten Schlussfolgerungsschritte und die daraus resultierenden Schlussfolgerungsketten signifikante Unterschiede aufweisen, die effektiv eine größere Bandbreite an Schlussfolgerungsmöglichkeiten abdecken. Wenn LLMs beispielsweise in einer Iteration den nächsten Gedanken mit größerer Zuversicht generieren, werden kontinuierlich ähnliche Gedanken erforscht; andernfalls neigen LLMs mit größerer Zufälligkeit dazu, verschiedene Gedanken zu generieren. Es ist oft schwer vorherzusagen, ob deterministisches Denken oder Zufälligkeit zu einer Lösung beitragen wird. Die Gewährleistung von Heterogenität durch die Mischung verschiedener Arten von logischen Denkschritten ermöglicht es uns daher, den Denkraum in einer einzigen Iteration vollständig zu erforschen, was letztlich die nachfolgenden Iterationen erleichtert. In der Ablationsstudie vergleichen wir die BoT-Leistung zwischen heterogenen und homogenen Baumstrukturen.

Heterogenität verringert die Wahrscheinlichkeit, ungültige oder falsche Schlussfolgerungsketten zu erzeugen, und erhöht damit die Robustheit.Im Gegensatz zur Heterogenität neigen die einzelnen Bäume bei einem homogenen Aufbau dazu, einem konsistenten logisch-generativen Denken zu folgen und Schlussfolgerungsketten mit der gleichen Baumstruktur zu bilden. Wenn dann die Logik falsch ist oder die zugrunde liegende Struktur für das vorliegende Problem nicht gültig ist, können die Schlussfolgerungsketten aller Bäume, die durch BoT in jeder Iteration erhalten werden, nur verrauschte und falsche Schlussfolgerungsschritte enthalten. Selbst wenn man sie aggregiert, um eine verfeinerte Argumentationskette für die Auswertung zu erhalten, kann die Erfahrung immer noch erheblich von der Bereitstellung geeigneter Problemlösungsempfehlungen abweichen. Daher kann eine heterogene Baumstruktur dazu beitragen, die Wahrscheinlichkeit zu verringern, dass in nachfolgenden BoT-Iterationen keine gültigen Argumentationsketten zur Bewertung zur Verfügung stehen. Diese verbesserte Robustheit ermöglicht es dem BoT, Probleme mit unterschiedlichen Schwierigkeitsgraden zu lösen.

Dieses Bild zeigt den Prozess der "Aggregation mit höchster Priorität" und der "gierigen Aggregation".

Eingabe: m Inferenzketten, wobei der Inferenzschritt einer m-ten Kette mit z1i = 1m bezeichnet wird.

Ausgabe: Polymerkette z1..n.1 - Aggregation mit höchster Priorität

2 Für jede Kette m = 1, 2, ... , M tun

3 Berechnen Sie die Summe der Kantengewichte der m-ten Kette als Vm = ∑i im Bereich m1m Vi-1,i.

4 Ende

5 Ermitteln Sie die optimale Kette unter M Ketten, indem Sie m* = arg maxm {Vm}

6 Weisen Sie die aggregierte Kette als die optimale Kette zu, z1.... .n := {z1i=1n*m*}7 - Gierige Aggregation

8 z1 := z1 wobei m* = arg maxm {V1m}.

9 Für jeden Aggregationsschritt i = 2, ... , n tun

10 Für jede Kette m = 1, 2, ... , M tun

11 Sammeln Sie Jm = {j, sim(z1i-1, z1j) > 0,7; j ∈ n1m}.

12 Behalten j*,m = arg maxj∈Jm {Vj,j+1m}

13 Ende

14 Führen Sie Folgendes durch, um den optimalen nächsten Inferenzschritt zu erhalten: zi = z1j*+1 mit j* = arg maxj∈{j*m}1M {Vj,j+1m}.

15 Ende

16 Erhalt von Polymerketten z1.... .n.Dabei handelt es sich im Wesentlichen um ein algorithmisches Flussdiagramm, das beschreibt, wie eine Datenkette oder ein Knotenpunkt optimiert werden kann, um mit verschiedenen Methoden die besten Ergebnisse zu erzielen.

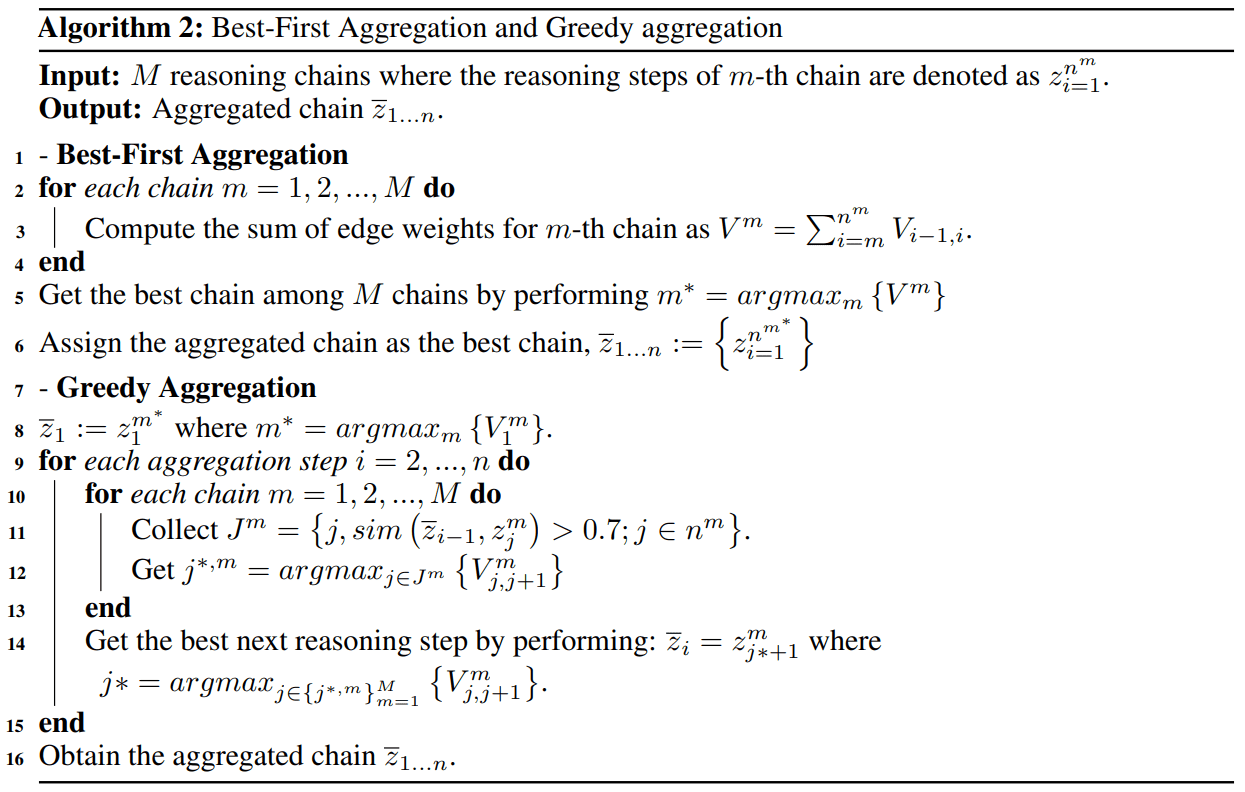

D Gedankenstruktur-Aggregation

Nach Abschluss der Argumentation in einer heterogenen Baumstruktur extrahiert der BoT-Aggregationsprozess zunächst die besten Argumentationsketten aus jedem Baum und kombiniert sie dann zu einer einzigen Argumentationskette, indem er entweder die Best-First- oder die Greedy-Aggregationsmethode verwendet. Nähere Informationen zu diesen beiden Aggregationsmethoden finden Sie im Quellcode examples/BoostingOfThought/BoT aggregator.py.

Wie im ersten Block von Algorithmus 16 gezeigt, ist die Best-First-Aggregation eine unkomplizierte Aggregationsmethode, die direkt die Kette mit der höchsten Summe der Kantengewichte extrahiert. Diese Methode ist schnell und stabil. Sie garantiert in der Regel eine wettbewerbsfähige Leistung, da durch die Analyse der erhaltenen optimalen Ketten weitere Erfahrungen gesammelt werden können. Sie kann jedoch nur bestehende Ketten ohne effiziente Abstimmung auswählen. Die Greedy-Aggregation ist fortschrittlicher, weil sie die Inferenzschritte in verschiedenen Ketten kombiniert, um eine neue und bessere Inferenzkette mit den höchsten Kantengewichten zu erzeugen. Der Greedy-Aggregationsprozess in Algorithmus 16 besteht aus zwei Schritten. Zunächst sammelt er Inferenzschritte, die dem aggregierten Inferenzschritt zi-1 ähnlich sind. Daher wird der nächste aggregierte Inferenzschritt aus dem nächsten Inferenzschritt in dieser Sammlung ausgewählt, indem die Kantengewichte maximiert werden. sim ist eine Ähnlichkeitsfunktion, die den Prozentsatz der gleichen Wörter und mathematischen Zahlen zwischen zwei Passagen unter Verwendung von LLMs bewertet. 0,7 ist ein empirischer Schwellenwert, der aus den Experimenten gewonnen wurde.

E Auswirkungen einer fehlerhaften Rückmeldung

Rückmeldungen, die durch die Auswertung aggregierter Inferenzketten erhalten werden, können eine eingeschränkte Nutzung der Analysen und völlig falsche Schlussfolgerungen und Fehlermeldungen beinhalten. Dieses Problem wird in der Regel durch die Natur von LLMs verursacht, die Sprachmodelle sind und nicht von Natur aus die Genauigkeit des generierten Textes überprüfen. Außerdem sind die Fähigkeiten von LLMs, wie gpt-3.5-turbo, begrenzt, wenn sie als Validatoren für mathematische Probleme verwendet werden.

Ein einfaches Beispiel ist in Tabelle 7 dargestellt. Die Analyse kommt zu dem Schluss, dass "das in Schritt 3 erhaltene Endergebnis 80 ist, was mathematisch gleich 24 ist. "Schlimmer noch, die Erfahrung beinhaltet weiterhin, dass "die Argumentationskette korrekt ist" und dass "keine Fehler in den Argumentationsschritten gefunden wurden". Es wurden keine Fehler gefunden." Unter Verwendung dieser Erfahrung als Eingabehinweis wird das BoT in der ersten Iteration dazu verleitet, den falschen Schlussfolgerungsschritt zu erzeugen, und die entsprechende Aggregationskette ist am Anfang von Tabelle 8 zu sehen. Es ist klar, dass die Aggregationskette logisch falsch ist und keiner der Regeln des Game of 24 entspricht.

Wir argumentieren jedoch, dass fehlerhafte Rückmeldungen nicht verstärkt werden, sondern dass ihre negativen Auswirkungen auf die generierten Argumentationsschritte in nachfolgenden Iterationen durch den iterativen Mechanismus der BoT abgeschwächt oder sogar vollständig korrigiert werden können. Der Hauptgrund dafür ist, dass die erzeugten fehlerhaften Argumentationsschritte weiter analysiert werden, um neue Erfahrungen zu generieren, die dem Hinweis hinzugefügt werden. Da diese Argumentationsschritte leicht erkennbare und offensichtliche Fehler enthalten, neigen LLMs dazu, korrekte Fehleranalysen zu erstellen und effektive Revisionsvorschläge zu liefern. Mit der neuen Erfahrung, die in den Hinweisen enthalten ist, ist der BoT in der Lage, korrekte Argumentationsschritte zu generieren. Wie die Erfahrungen in Tabelle 8 zeigen, generierte der BoT detaillierte Fehlerberichte und Revisionsvorschläge, was zu einem rationalen Gedankengenerierungsprozess führte.

Die Vorteile von BoT bei der Nutzung von Iterationen zur Abschwächung der nachteiligen Auswirkungen von Fehlerrückmeldungen sind in Abbildung 4 ersichtlich. Bemerkenswert ist, dass sich die Leistung von BoT mit zunehmender Anzahl von Iterationen stetig verbessert. Dies unterstreicht die Bedeutung der kumulativen Erfahrung und die Fähigkeit der nachfolgenden Erfahrung, frühere Fehler zu korrigieren.

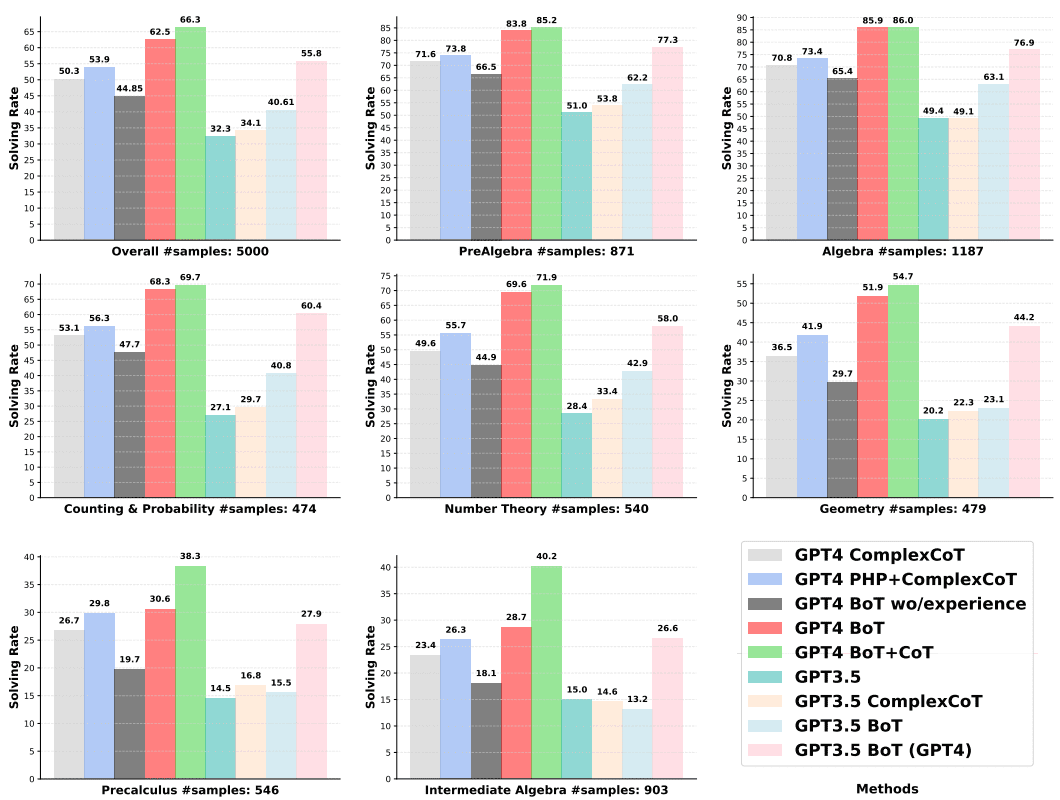

F Weitere Ergebnisse für Mathe

Abb. 5: Zeigt die Effektivität der Verwendung verschiedener Strategien zur Lösung aller im MATH-Datensatz kategorisierten Probleme. Die Strategien werden auf der Grundlage der Kategorien Voralgebra, Algebra, Zählen und Wahrscheinlichkeit, Grundlagen der Zahlentheorie, Geometrie, Vorkalkül und mittlere Algebra verglichen. Die Teilgrafik mit der Bezeichnung "insgesamt" zeigt die Gesamtlösungsrate für alle Probleme in allen Kategorien.

In Abbildung 5 sind die Lösungsraten der verschiedenen Methoden für jede Kategorie des MATH-Datensatzes dargestellt. Die Komplexität und Vielfalt der verschiedenen mathematischen Probleme in diesen Kategorien stellen eine größere Herausforderung für das mathematische Denken dar. Die Komplexität und die Vielfalt der Probleme in MATH erfordern ein breites Spektrum an logischen Fähigkeiten, um sie zu lösen. Daher kann eine detaillierte Untersuchung unseres Ansatzes und sein Vergleich mit anderen Ansätzen in unserem Kontext wertvolle Erkenntnisse liefern.

LLMs.Bei den Experimenten, die mit dem MATH-Datensatz durchgeführt wurden, kamen bekannte Large Language Models (LLMs) zum Einsatz, nämlich GPT-3.5-Turbo (im Folgenden als GPT3.5 bezeichnet) und GPT-4 (im Folgenden als GPT4 bezeichnet). Wir verwendeten direkt die von OPENAI veröffentlichte API.

Rivalen.

- GPT4 ComplexCoT. ist ein Modell von GPT4 unter Verwendung der Complex CoT Fu et al. (2022) Prompting-Methode. In den Schlussfolgerungshinweisen werden Argumentationsbeispiele verwendet, die aus der entsprechenden Complex CoT-Veröffentlichung Fu et al. (2022) stammen. Da greedy decoding verwendet wird, folgen wir nicht dem selbstkonsistenten Ansatz von Wang et al. (2022) für das Sampling von Inferenzpfaden.

- GPT3.5. werden Standardabfragen verwendet und GPT3.5-Modelle zur Generierung von Antworten eingesetzt.

- GPT3.5 ComplexCoT. Ähnlich wie GPT4 ComplexCoT, aber mit einem anderen Modell als GPT3.5.

- GPT4 PHP+ComplexCoT. Dies ist das GPT4-Modell mit PHP Zheng et al. (2023) + Complex CoTFu et al. (2022). Im Rahmen von PHP Zheng et al. (2023) werden anfängliche Basisantworten mit Hilfe von Complex CoT Prompts generiert, und dann kann PHP+Complex CoT aus diesen Basisantworten nachfolgende Antwortgenerierungs-Prompts entwickeln. So können zu Beginn einer Interaktion Basisantworten generiert werden, indem die Complex CoT-Basishinweise und die aktuelle Frage an das LLM übergeben werden. Auf der Grundlage der Complex CoT-Hinweise, die in der PHP-Version mit zusätzlichen Hinweissätzen überarbeitet wurden, führt das Schritt-für-Schritt-Hinweissystem diese Basisantwort aus, um die richtige Antwort zu generieren. Wir bezeichnen dies als das PHP+Komplexe CoT-Gegenstück zum PHP-Komplexen CoT in der ursprünglichen Arbeit. Der Komplexe CoT hat eine Schusszahl von 8.

- GPT4 BoT ohne Erfahrung. Das GPT4-Modell wird verwendet, um die Argumentation des BoT-Rahmens durchzuführen, ohne Erfahrungen zu sammeln. Der grundlegende Aufbau des BoT folgt den im Hauptbeitrag vorgestellten. Nach einer Iteration werden also aggregierte Ketten als Lösung verwendet.

- GPT4 BoT: GPT4 wird verwendet, um die vollständige Version des BoT aus dem Hauptbeitrag durchzuführen.

- GPT4 BoT + CoT.Zusätzlich zum BoT-Rahmenwerk enthielten die Prompts 5 Argumentationsbeispiele aus der CoT-Veröffentlichung von Wei et al. (2022). Somit enthalten die Prompts in jeder Iteration nicht nur die Erfahrung, sondern auch die zusätzlichen 5 CoT-Beispiele.

- GPT3.5 BoT. Ähnlich wie GPT4 BoT, aber das Modell wurde in GPT3.5 geändert.

- GPT3.5 BoT (GPT4). In diesem Experiment verwenden wir GPT3.5, um zu schlussfolgern und so Gedankenketten in der Gedankenstrukturgenerierung zu erzeugen.

Das GPT4-Modell wurde jedoch verwendet, um ein Bewertungs- und Analysefeedback zu erhalten, wenn es um die Bewertung von Gedanken und die Generierung von Erfahrungen in einer aggregierten Denkkettenanalyse ging.

Aus den Ergebnissen in Abbildung 5 lassen sich die folgenden zusätzlichen Beobachtungen ableiten.

Die herausragende Leistung von BoT bei der Lösung schwierigerer Probleme ist weitgehend auf Erfahrung zurückzuführen.BoT-verwandte Methoden wie GPT4 BoT und GPT4 BoT + CoT erreichen durchgängig die höchsten Problemlösungsraten in den verschiedenen Unterkategorien von MATH. Insbesondere führt GPT4 BoT die beste verfügbare Lösung, GPT4 PHP + ComplexCoT, um 8,61 TP3T an, während GPT4 BOT + CoT um 12,41 TP3T führt. In den insgesamt sieben Kategorien übertrifft GPT4 BoT GPT4 PHP + ComplexCoT um mindestens 0,81 TP3T, wobei das algebraische Problem Das Gleiche gilt für GPT3.5 BoT und GPT3.5 BoT + CoT. Wenn jedoch keine gesammelte Erfahrung im BoT-Rahmen vorhanden ist, wird die gesamte mathematische Problemlösungsleistung drastisch reduziert, wie das GPT4 BoT wo/ experience zeigt.

Neben der Erfahrung mit der Fehleranalyse ist die Einbeziehung von korrekten Beispielen, wie z. B. einfachen CoT-Beispielen, von wesentlicher Bedeutung, um die Effektivität des BoT bei der Lösung anspruchsvoller mathematischer Probleme zu verbessern.GPT4 BoT übertrifft GPT4 PHP+ComplexCoT signifikant beim Lösen der ersten fünf Unterkategorien des MATH-Problems, aber in den Bereichen der fortgeschrittenen und mittleren Algebra, wo der Bedarf an komplexerem Denken und komplexen logischen Schritt-für-Schritt-Lösungen höher ist, betragen die Verbesserungen von BoT nur 0,8% und 2,4%. Diese Gewinne sind relativ begrenzt im Vergleich zu den signifikanten Verbesserungen, die beim Lösen der einfacheren Problemkategorien beobachtet wurden Diese Verbesserungen sind relativ begrenzt im Vergleich zu den signifikanten Verbesserungen, die beim Lösen der einfacheren Problemkategorien beobachtet wurden. Als jedoch fünf korrekte Instanzen von CoT direkt zur Eingabeaufforderung hinzugefügt wurden, verbesserte das GPT-4 BoT + CoT seine Leistung in den Bereichen Fortgeschrittene Algebra und Mittlere Algebra erheblich und übertraf das GPT-4 BoT um 7,71 TP3T bzw. 11,51 TP3T.Die zugrundeliegende Schlussfolgerung aus diesen Beobachtungen ist, dass die Trial-and-Error-Analyse zum Erlernen des logischen Denkens nicht die einzige Möglichkeit ist, um sicherzustellen, dass das BoT die bestmögliche Leistung beim Lösen komplexer mathematischer Probleme erzielen kann. Die Fehleranalyse zum Erlernen des schlussfolgernden Denkens ist nicht ausreichend und sollte sich auf die korrekte Beantwortung der LLMs in der Eingabeaufforderung verlassen.

Obwohl der GPT3.5 fit BoT anfangs dem GPT-4 CoT leicht unterlegen sein kann, ist es möglich, dass der GPT-3.5 BoT (GPT-4) den GPT-4 Complex CoT übertrifft, wenn Erfahrungen mit dem GPT-4 als Bewertungs- und Analyseinstrument gesammelt wurden.Bei Verwendung von GPT3.5, das eine geringere Kapazität als GPT4 hat, als LLM, erhielt BoT eine Lösungsrate, die mindestens 7,71 TP3T niedriger war als GPT4 ComplexCoT (insbesondere in der Disziplin Algebra). Es ist klar, dass BoT GPT4 ComplexCoT nicht übertreffen kann, wenn die leistungsschwächeren LLMs qualitativ schlechtere Trial-and-Error-Analysen produzieren. Nachdem GPT3.5 daher nur den Inferenzschritt neben der von GPT4 generierten Erfahrung generiert hatte, zeigte GPT3.5 BoT (GPT4) eine signifikante Verbesserung in allen Kategorien, was zu einer Lösungsrate von 55,81 TP3T führte, die um einen Faktor von 5 höher ist als die von GPT4 ComplexCoT um 5,51 TP3T und sogar um 1,91 TP3T höher als der aktuelle Stand der Technik GPT4 PHP+ComplexCoT. Diese Beobachtungen sind ein weiterer Beweis dafür, dass die durch Iteration über Hinweise gewonnene Erfahrung der Hauptgrund für den Erfolg des BoT-Rahmens ist.

G Reasoning-Ergebnisse für das Spiel 24 Punkte

Zunächst zeigen wir in den Tabellen 5 bis 9 die detaillierten Hinweise, die von BoT im Argumentationsprozess verwendet werden, und vermitteln so ein umfassendes Verständnis dessen, was BoT in jeder Iteration tut. Dann, beginnend mit Tabelle 10, zeigen wir genaue Beispiele, die den gesamten Argumentationsprozess von BoT umfassen. Diese Experimente wurden unter Verwendung des GPT-3.5-Turbo-Modells mit BoT durchgeführt und folgen dem im Abschnitt "Experimente" beschriebenen Grundaufbau.

Tabelle 5: Von gpt-3.5-turbo generierte Inferenzschritte, wenn in der Eingabeaufforderung keine Erfahrung angegeben wird.Wir lassen das Modell zunächst fünf Inferenzschritte generieren, um die Diversität zu prüfen, und präsentieren dann die endgültige Inferenzkette nach Abschluss der ersten Iteration der BoT.

Tipps für das Spiel 24:00, keine Erfahrung

In 24 Punkte erhalten Sie vier Zahlen, die Sie mit Hilfe der Grundrechenarten (+, -, *, /) so kombinieren müssen, dass das Ergebnis 24 ist. Sie dürfen jede Zahl nur einmal verwenden und können die Reihenfolge der Operationen durch Klammern ändern.

Analysieren Sie jeden Schritt des Formats:

Schritt X. Derzeitige Menge: XXXX, zwei ausgewählte Zahlen: XX XX, Operation: XX, neue, durch Berechnung erhaltene Zahl: XX, verbleibende Zahlen: XXXX, neue Menge: XXXX.Die vier Zahlen lauten: 1 1 4 6.

Lassen Sie uns Schritt für Schritt denken.Erinnern Sie sich an historische Argumentationserfahrungen (ignorieren, wenn die Erfahrung null ist):

## ############### ######## ######## # # # #######

Achten Sie auf die Analysen und Schlussfolgerungen in den Erfahrungsberichten und vermeiden Sie ähnliche Fehler, indem Sie die Empfehlungen befolgen.

Nachfolgend finden Sie eine Reihe von geordneten Argumentationsschritten, begleitet von ihren Bewertungspunkten (höhere Punkte bedeuten, dass der Argumentationsschritt die Aufgabe mit größerer Wahrscheinlichkeit erfüllt). :Führen Sie bitte auf der Grundlage der oben unter "_" aufgeführten Argumentationsschritte (d. h. nicht der Schritte im empirischen Block) einen Argumentationsschritt durch, um den einzig möglichen nachfolgenden Argumentationsschritt zu erzeugen.

Fünf Antworten von gpt-3.5-turbo

Schritt 1, Aktuelle Menge: 1 1 4 6, Zwei Zahlen ausgewählt: 1 1, Operation: +, Neue Zahl berechnet: 2, Verbleibende Zahlen: 4 6, Neue Menge: 2 4 6, Bewertungspunktzahl: 0,7

Schritt 1, Aktuelle Menge: 1 1 4 6, Zwei Zahlen ausgewählt: 1 1, Operation: +, Neue Zahl berechnet: 2, Verbleibende Zahlen: 4 6, Neue Menge: 2 4 6, Bewertungspunktzahl: 0,7

Schritt 1, Aktuelle Menge: 1 1 4 6, Zwei Zahlen ausgewählt: 1 1, Operation: +, Neue Zahl berechnet: 2, Verbleibende Zahlen: 4 6, Neue Menge: 2 4 6, Bewertungspunktzahl: 0,7

Schritt 1, Aktuelle Menge: 1 1 4 6, Zwei Zahlen ausgewählt: 1 1, Operation: +, Neue Zahl berechnet: 2, Verbleibende Zahlen: 4 6, Neue Menge: 2 4 6, Bewertungspunktzahl: 0,7

Schritt 1, Aktuelle Menge: 1 1 4 6, Zwei Zahlen ausgewählt: 1 1, Operation: *, Neue Zahl berechnet: 1, Verbleibende Zahlen: 4 6, Neue Menge: 1 4 6, Bewertungsnote: 0,7Nach der Aggregation erhaltene Inferenzkette

Schritt 1, aktuelle Menge: 1 1 4 6, zwei Zahlen ausgewählt: 1 1, Operation: +, neue Zahl berechnet: 2, verbleibende Zahlen: 4 6, neue Menge: 2 4 6... Berechne den Bruch: 0.7