Welches AI-Modell verwendet ConchAsk?

Synopsis: Was ist eine Muschel fragen?

Hallo an alle, lassen Sie mich Ihnen diese erstaunliche Sache vorstellen - conch ask AI. conch ask, das ist kein Strandverkäufer, der Meeresfrüchte verkauft, sondern ein intelligenter AI-Chat-Assistent von Shanghai Ruyu Technology Co. Unterschätzen Sie diesen Kerl nicht, er ist nicht nur kostenlos, sondern kann auch unser Informationsleben erheblich erleichtern. Aber was kann er wirklich? Ich gebe Ihnen einen Überblick.

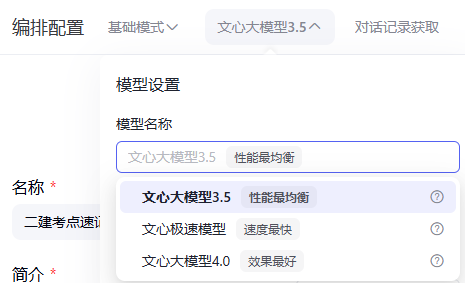

Zunächst einmal ist ConchAsk ein Produkt, das mit Hilfe eines eigenen MiniMax-Modells entwickelt wurde, das sich auf das Mixin Models of Experts (MoE) Modell konzentriert, klingt sehr großartig, oder? Keine Sorge, ich werde Ihnen mehr darüber erzählen, MoE-Modell ist wie eine Sammlung von Hunderten von großen Jungs, kann es auf der Grundlage der Art der Frage zu wählen, verschiedene "Experten", um die Frage zu beantworten. Es ist wie eine Schatztruhe des Wissens, egal ob es sich um Wissenschaft und Technologie oder den gesunden Menschenverstand handelt, es wird immer ein Experte da sein, der Ihnen eine zufriedenstellende Antwort geben kann.

Darüber hinaus kann ConchQ auch über Text und Sprache mit Ihnen kommunizieren. Egal, ob Sie eine schnelle Antwort auf eine Frage erhalten oder einfach nur chatten möchten, ConchQ kann Ihr vertrauter Assistent sein.

Technischer Hintergrund: Wie funktioniert die KI bei ConchQ?

Conch Ask ist mehr als nur ein einfacher Q&A-Bot, die dahinter stehende KI-Technologie ist fortschrittlich. Sie sind vielleicht neugierig, wie ConchQuest funktioniert? Zunächst einmal ist ConchQ auf der Grundlage des großen MiniMax-Modells tiefgreifend optimiert. Das bedeutet, dass es hochmoderne Modelle wie MiniMax integriert, um menschliche Gespräche natürlicher zu verstehen und zu generieren, und als ob das noch nicht genug wäre, fügt es einige einzigartige Optimierungen wie die Unterstützung verschiedener KI-Modelle hinzu, um es intelligenter zu machen.

Wie hört sich das an? Nehmen wir zum Beispiel an, dass ConchQ mehr kann als nur eine einfache Frage und Antwort, es kann Ideen sammeln und Sie auf eine Reise mitnehmen, um sich die Kreativität des Vereinigten Himmels vorzustellen. Oder, damit Sie auf dem Weg des kreativen Schreibens nicht mehr einsam sind, kann es Inspiration bieten und die Verwirrung beim Schreiben beantworten. Einfach ausgedrückt, ist ConchQ wie ein Hellseher plus ein nachsichtiges Ohr plus ein intelligentes Gehirn, das immer bereit ist zu helfen.

Und wie genau wird all dies erreicht? Ich verrate es Ihnen: Das Geheimnis dahinter ist die tiefgreifende Kombination aus künstlicher Intelligenz und maschinellem Lernen. Conch Ask ist in der Lage, eine große Menge an Textdaten zu analysieren, aus denen es lernt, wie man Antworten organisiert und wie man effektiv mit Nutzern kommuniziert. Das ist noch nicht alles, auch diesen Artikel von mir kann Conch Ask wahrscheinlich von Hand für Sie erstellen.

Anwendungsszenario: Was kann ich mit ConchQ tun?

Künstliche Intelligenz ist heutzutage in jeden Aspekt des Lebens eingedrungen, und ConchQ ist da keine Ausnahme. Haben Sie sich jemals gefragt, was es für Sie tun kann?

Tun wir so, als wären wir Detektive, und finden wir heraus, wofür der Conch Ask alles verwendet werden kann. In erster Linie können Sie damit natürlich alle möglichen lästigen Fragen beantworten, zum Beispiel: "Wer war Isaac Newton?" Oder: "Wie lautete das Ergebnis des gestrigen Fußballspiels?" Es ist einfach, die Antworten zu finden.

Oder nehmen wir an, Sie sind Schriftsteller und Ihre Vorstellungskraft ist wie ein ausgetrockneter Fluss, egal wie Sie graben, Sie kommen auf keine Ideen. In diesem Fall kann ConchQ Sie mit kreativen Anregungen versorgen, die Ihnen helfen, brillant zu schreiben.

Und nicht nur das, wie sieht es mit der akademischen Forschung aus? Keine Sorge, auch dabei kann dir ConchQ helfen. Wenn du Informationen brauchst oder dir über ein komplexes Konzept nicht sicher bist, kann ConchAsk es mit dir ausführlich diskutieren und dir vielleicht sogar helfen, neue Ideen für deine Forschung zu finden.

Natürlich sind die kleinen Dinge des Lebens, wie z. B. das Wetter, Tipps zu guten Restaurants in der Nähe und wie man am schnellsten durch den Verkehr kommt, seine Stärken. Sie sehen, ConchAsk ist wie Ihr persönlicher Sekretär, der immer in Bereitschaft ist und sein Bestes tut, um Ihnen in jeder Hinsicht zu helfen.

Schlussbemerkungen

Apropos, fangen Sie auch an, die Muschel zu fragen, ob diese KI ein starkes Interesse hat? Denn wer wünscht sich nicht einen solch intelligenten kleinen Assistenten. Sein Auftauchen macht unser tägliches Leben wirklich bequemer, auch Arbeit und Studium werden effizienter. Er ist nicht nur allumfassend und deckt alle Arten von Problemen ab, sondern kann auch mit Ihnen chatten.

Conch Ask ist ein Name voller Magie, wie diese makellose Muschel, die man bei einem Spaziergang am Ufer auffängt und sanft ins Ohr steckt, als könne man das ganze Meer hören. Genau wie diese Muschel hört dieser kleine Assistent auf jede Frage, die Ihnen durch den Kopf geht, und liefert Ihnen mit seiner KI-Magie personalisierte und hochwertige Antworten.

Frage und Antwort

1 F: Welche Maßnahmen ergreift ConchQ zum Schutz der Privatsphäre der Nutzer?

A: Bei Halo Ask steht die Privatsphäre der Nutzer immer an erster Stelle. Technisch gesehen schützt es die Sicherheit der Kommunikation durch Verschlüsselung und andere Mittel. Darüber hinaus hält sich die Datenverarbeitung eng an die neuesten Gesetze und Vorschriften zum Schutz der Privatsphäre und der Sicherheit der Nutzerdaten.

2. f: Stimmt es, dass HaloQuest die menschliche Sprache und Gefühle versteht?

A: Es ist vielleicht etwas übertrieben zu sagen, dass es 100 % der menschlichen Sprache und Emotionen wie ein echter Mensch versteht. Durch die kontinuierliche Optimierung des KI-Modells ist ConchQuest jedoch in der Lage, den Kern der Sprache und den Tonfall der Emotionen sehr gut zu erfassen und auf eine natürlichere und menschennähere Weise zu kommunizieren.

3. f: Kann Halo Ask Dienste in verschiedenen Sprachen anbieten? Wenn ich zum Beispiel auf Englisch mit dem Programm sprechen möchte

A: Natürlich. Egal, ob es sich um Englisch, Chinesisch oder eine andere Sprache handelt, ConchQ kann flexibel damit umgehen, schließlich ist es eine Sammlung der besten KI-Übersetzungstechnologie im Moment.

4 F: Welche Möglichkeiten bietet ConchQ neben der Textkommunikation auch für die Sprachkommunikation?

A: Die Sprachkommunikation von Halo Ask ist ebenfalls sehr gut. Es versteht nicht nur Ihre Spracheingabe, sondern beantwortet auch Ihre Fragen und liest Ihnen sogar einen bestimmten Text vor. Die Stimme ist natürlich und sanft, und es ist einfach ein Meister der verbalen Kommunikation!

5. f: Wird es in Zukunft eine Gebühr für die Abfrage von ConchQ geben?

A: Derzeit ist ConchQ ein kostenloser Dienst. Es hängt jedoch von seinem Entwicklungsplan ab, ob es in Zukunft zusätzliche Dienste und kostenpflichtige Elemente einführen wird, da es seine Funktionen weiter ausbaut und seine Dienste optimiert. Der grundlegende Chat-Assistenzdienst wird jedoch höchstwahrscheinlich kostenlos bleiben.

© urheberrechtliche Erklärung

Artikel Copyright AI-Austauschkreis Alle, bitte nicht ohne Erlaubnis vervielfältigen.

Ähnliche Artikel

Keine Kommentare...