Qual é a melhor versão para executar modelos grandes do DeepSeek-R1 com a placa de vídeo RTX 4090?

Executando o DeepSeek-R1 com uma placa de vídeo RTX 4090.Preferência recomendada para a versão de sangue total do Q4_K_M quantised 671Bseguido de uma versão quantificada do 14B ou do 32B, desde que dependa do KTransformers e se for muito difícil aprender o Sem pano Uma versão quantitativa foi introduzida, e aqui está outra Ollama Tutorial de instalação Tutorial de implantação local do DeepSeek R1 671B: baseado em Ollama e quantificação dinâmicaDepende se suas necessidades são de "potência extrema" ou "mais velocidade". Depende de suas necessidades de "potência extrema" ou "mais velocidade".

1️⃣ RTX 4090 A versão completa (671B) também executa?

Sim! A equipe de Tsinghua KTransformadores Deixe que uma única placa de vídeo 4090 execute a versão completa.

- Requisitos de memória VGAO Q4_K_M Quantised Edition requer apenas 14 GB de memória de vídeo, e os 24 GB do 4090 são perfeitamente adequados.

- ritmoVelocidade de pré-processamento de até 286 palavras/segundo e velocidades de geração de cerca de 14 palavras/segundo já são demais para a visão de uma pessoa comum.

- CenárioTarefas que exigem raciocínio complexo, como escrever código, diálogos de várias rodadas.

2️⃣ Se estiver muito lento? Tente uma versão menor

Se achar que 14 palavras/segundo é muito lento, você pode escolher um modelo menor:

- 14B versão quantificadaO requisito de memória gráfica é de cerca de 6,5 GB, gerando velocidades mais rápidas para escrita e tradução diárias.

- Versão quantificada 32BRequer 14,9 GB de memória de vídeo e suporta processamento de texto longo (por exemplo, análise de documentos inteiros).

3️⃣ Por que a versão completa é executada em seu lugar?

Aqui está um truque técnico:Descarregamento quantitativo + computacional.

- quantificávelComprimir" o modelo em um tamanho menor, por exemplo, a quantificação de 4 bits (Q4) reduz o espaço de memória em 701 TP3T.

- Calcular o descarregamentoTarefas computacionais sem importância a serem executadas pela CPU e deixar a GPU fazer o que faz de melhor.

4️⃣ Comparação com outras soluções gráficas

Novamente, execute a versão completa:

- Cluster gráfico H100Custo: custa centenas de milhares de dólares e é mais rápido, mas não é acessível para o cidadão comum.

- placa de vídeo desenvolvida internamenteCompatibilidade: A compatibilidade não é suficiente e é fácil pisar na poça.

chegar a um veredictoO 4090 é, de longe, a opção mais econômica.

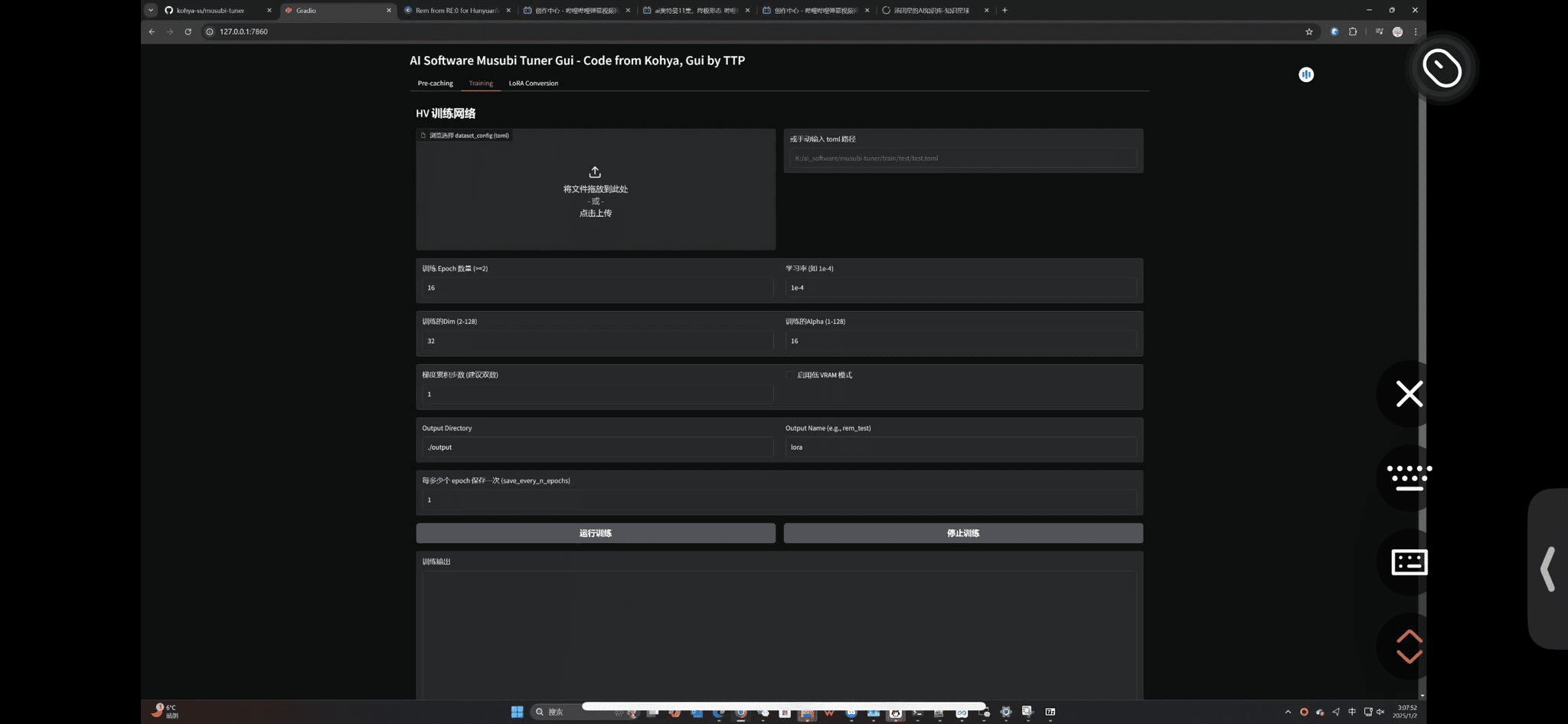

5️⃣ Dicas de implantação

- despesa ou gasto

KTransformersA estrutura pode ser implantada com um único clique e vem com a mesma interface do ChatGPT. - Se estiver com pouca memória, experimente o modo "Activate only 6 experts", que é um pouco mais rápido.

Para a IA mais inteligente, escolha o 671B Quantized, para um diálogo suave, escolha o 14B/32B, o 4090 tem tudo isso!

© declaração de direitos autorais

Direitos autorais do artigo Círculo de compartilhamento de IA A todos, favor não reproduzir sem permissão.

Artigos relacionados

Nenhum comentário...