VideoReTalking: sincronização labial acionada por áudio e sistema de edição de vídeo

Introdução geral

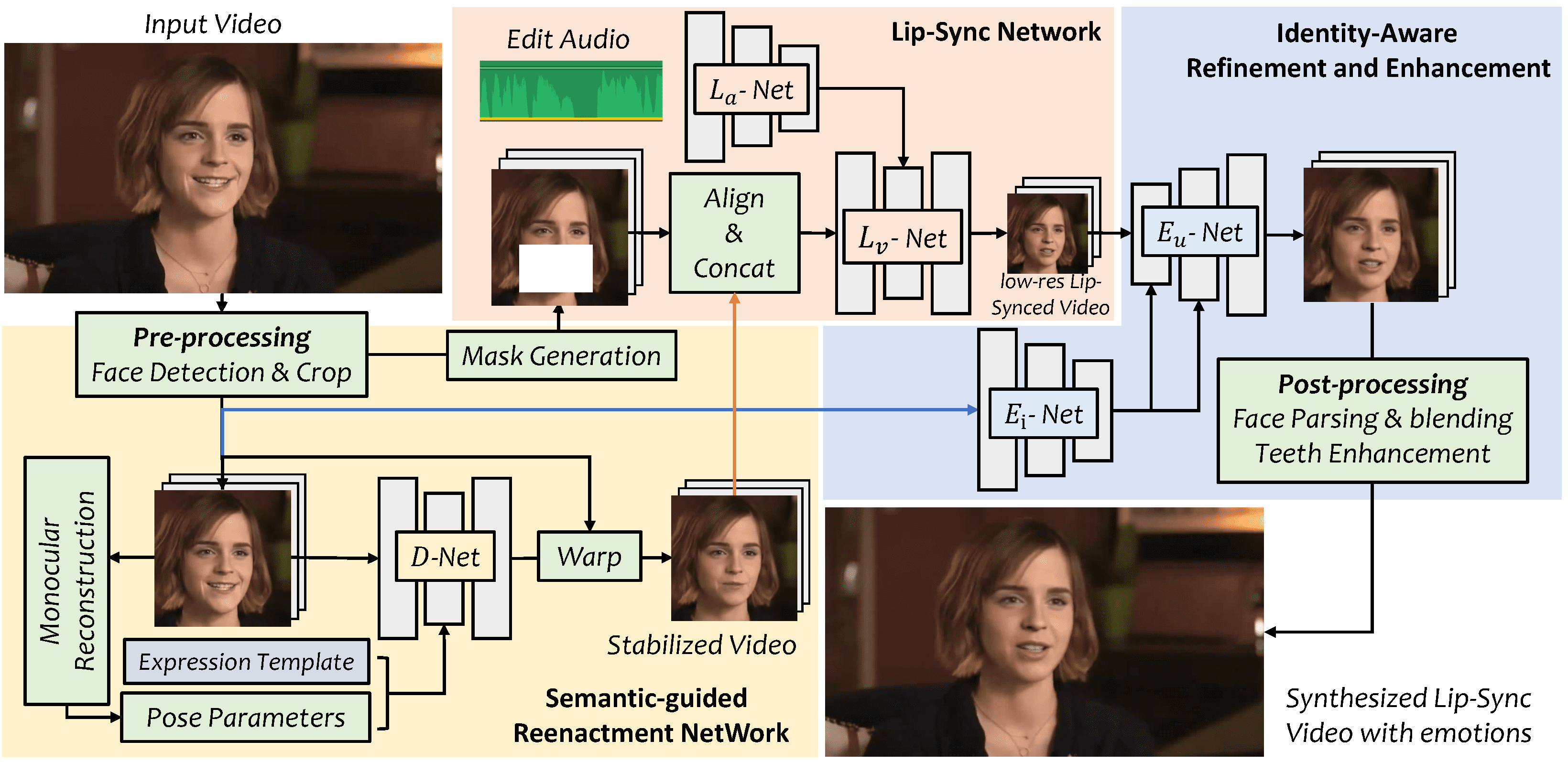

O VideoReTalking é um sistema inovador que permite aos usuários gerar vídeos faciais sincronizados com os lábios com base no áudio de entrada, produzindo vídeos de saída de alta qualidade e sincronizados com os lábios, mesmo com emoções diferentes. O sistema divide esse objetivo em três tarefas sucessivas: geração de vídeo facial com expressões típicas, sincronização labial acionada por áudio e aprimoramento facial para melhorar o foto-realismo. Ele lida com todas as três etapas usando uma abordagem baseada em aprendizado que pode ser executada sequencialmente sem a intervenção do usuário. Explore o VideoReTalking e sua aplicação à edição de vídeo de cabeça falante com sincronização labial acionada por áudio por meio do link fornecido.

(não está claro, é necessário melhorar a qualidade do vídeo duas vezes, sincronização labial um pouco ruim com o chinês)

Lista de funções

Geração de vídeo facial: gera vídeos faciais com expressões típicas com base no áudio de entrada.

Sincronização labial orientada por áudio: gera vídeo com sincronização labial com base no áudio fornecido.

Aprimoramento facial: aprimoramento do fotorrealismo de faces sintéticas por meio de uma rede de aprimoramento facial com reconhecimento de identidade e pós-processamento.

Usando a Ajuda

Faça o download do modelo pré-treinado e coloque-o em `. /checkpoints`.

Execute `python3 inference.py` para fazer uma inferência rápida do vídeo.

As expressões podem ser controladas com a adição dos argumentos `--exp_img` ou `--up_face`.

Endereço de experiência on-line

© declaração de direitos autorais

Direitos autorais do artigo Círculo de compartilhamento de IA A todos, favor não reproduzir sem permissão.

Artigos relacionados

Nenhum comentário...