Como criar um chatbot com o tutorial do recurso Chatbox do DeepSeek?

Conhecimento básico e preparação das funções do Chatbox

A funcionalidade do Chatbox fornecida pela plataforma DeepSeek é essencialmente um sistema de chamada de interface API, em que o usuário precisa interagir com o modelo por meio da API. O trabalho de preparação precisa ser concluído antes de criar um chatbot:

- Implantação local da Ollana: veja o tutorial detalhado abaixo

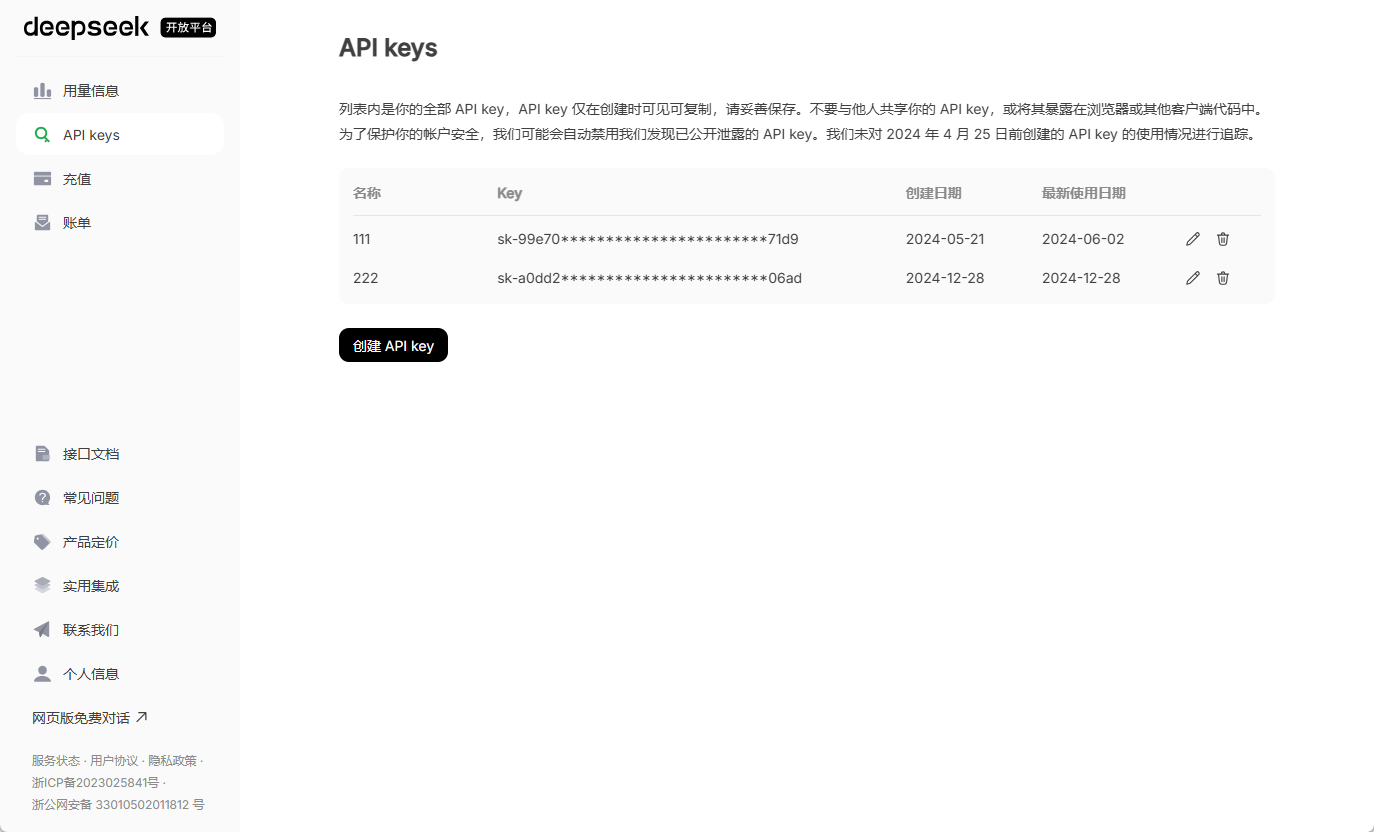

- Obter a chave oficial da APIVisite o site oficial do DeepSeek para criar uma conta e passar pela autenticação corporativa (desenvolvedores individuais escolhem o tipo individual), na seção "gerenciamento de vouchers"O módulo gera uma chave de API proprietária, geralmente no formato ds-xxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxx.

Para criar um chatbot usando o recurso ChatBox do DeepSeek, siga as etapas abaixo para combinar a implementação local com a configuração da interface para uma interação eficiente:

I. Construção básica do ambiente

- Instalação da estrutura Ollama

O Ollama é uma estrutura leve para executar modelos de IA nativos, com suporte para modelos de código aberto, como o DeepSeek.- Visite o site oficial do Ollama e escolha o pacote de instalação de acordo com seu sistema (Windows escolhe .exe, Mac escolhe .dmg).

- Após a conclusão da instalação, digite no terminal

ollama listVerifique se houve sucesso; se a lista de modelos for exibida (por exemplo, llama3), a instalação estará concluída.

- Implementação do modelo DeepSeek

- Selecione a versão do modelo de acordo com a configuração do hardware:

- equipamento de baixo perfil: Seleção

1.5Btalvez8BVersão paramétrica (requer 2 GB ou mais de memória de vídeo). - Equipamento de alto desempenho: Recomendações

16Bou superior (requer 16 GB ou mais de memória de vídeo).

- equipamento de baixo perfil: Seleção

- Execute o comando no terminal para fazer o download do modelo:

ollama run deepseek-r1:8b # 替换数字为所选参数版本A primeira execução requer o download de aproximadamente 5 GB de arquivos de modelo, e é necessária uma rede estável.

- Selecione a versão do modelo de acordo com a configuração do hardware:

Configuração da interface do ChatBox

- Instalação da ferramenta ChatBox

- Visite o site oficial do ChatBox e faça o download do pacote de instalação para o sistema correspondente (Windows, Mac ou Linux).

- Inicie o software após a instalação e entre na interface de configuração.

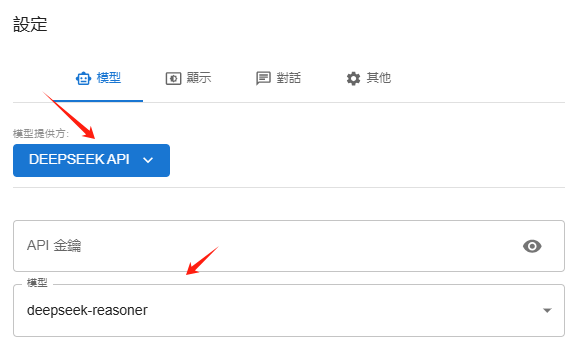

- Conexão do Ollama com o modelo DeepSeek

- Selecione "Model Provider" (Provedor de modelo) na ChatBox. API OLLAMA.

- Preencha o endereço da API como padrão

http://localhost:11434(Se não for preenchido automaticamente, digite manualmente). - Selecione a versão instalada do DeepSeek no menu suspenso "Modelo" (por exemplo

deepseek-r1:8b).

- Teste funcional

- Retorne à interface principal, digite uma pergunta (por exemplo, "Escreva uma saudação de Ano Novo") e o ChatBox gerará uma resposta por meio do modelo local, permitindo conversas independentes da rede.

- Configuração de Ollama

- Configuração da API oficial do DeepSeek

III Expansão da funcionalidade avançada

- Interação multimodal e integração da base de conhecimento

- fazer uso de Assistência à página e outros plug-ins de navegador que adicionam recursos de pesquisa em rede ao modelo local e oferecem suporte ao acesso a informações em tempo real de mecanismos específicos.

- Ao fazer upload de documentos como PDF, TXT etc. para a base de conhecimento, o modelo pode ser combinado com dados locais para gerar respostas mais precisas (modelos incorporados como o BERT precisam ser configurados).

- Recomendações de otimização de desempenho

- adaptação de hardwareSe a latência do diálogo for alta, diminua a versão do parâmetro do modelo ou atualize a placa de vídeo (recomenda-se RTX 4080 ou superior).

- PrivacidadeImplementação local: a implementação local evita uploads de dados e é adequada para lidar com informações confidenciais.

IV Soluções para problemas comuns

- Falha no download do modeloVerifique sua conexão com a Internet e desative o firewall ou o software antivírus.

- O ChatBox não está respondendoConfirme se o serviço Ollama foi iniciado (no terminal, digite

ollama serve). - Memória de vídeo insuficienteTente modelos menores ou aumente a memória virtual.

Um chatbot DeepSeek localizado e de alta privacidade pode ser criado rapidamente usando as etapas acima. Para personalização adicional (por exemplo, integração com a Web), consulte o tutorial de desenvolvimento de API.

© declaração de direitos autorais

Direitos autorais do artigo Círculo de compartilhamento de IA A todos, favor não reproduzir sem permissão.

Artigos relacionados

Nenhum comentário...