Agentes em tempo real da OpenAI: um aplicativo de interação de fala corporal multiinteligente (exemplo da OpenAI)

Introdução geral

O OpenAI Realtime Agents é um projeto de código aberto que tem como objetivo mostrar como as APIs em tempo real da OpenAI podem ser usadas para criar aplicativos de fala corporal multiinteligentes. Ele fornece um modelo de corpo inteligente de alto nível (emprestado do OpenAI Swarm) que permite aos desenvolvedores criar sistemas complexos de fala corporal multiinteligente em um curto período de tempo. O projeto mostra, por exemplo, como realizar transferências sequenciais entre inteligências, reforço em segundo plano para um modelo mais inteligente e como fazer com que o modelo siga uma máquina de estado para tarefas como a confirmação de informações do usuário, caractere por caractere. Esse é um recurso valioso para desenvolvedores que desejam criar rapidamente protótipos de aplicativos de fala em tempo real com várias inteligências corporais.

A OpenAI fornece uma implementação de referência para criar e orquestrar padrões inteligentes usando APIs em tempo real. Você pode usar esse repositório para criar um protótipo de um aplicativo de fala usando um processo de corpo multiinteligente em menos de 20 minutos! A criação com APIs em tempo real pode ser complicada devido à natureza síncrona e de baixa latência da interação por voz. Este repositório inclui as práticas recomendadas que aprendemos para gerenciar essa complexidade.

Lista de funções

- Transferência de sequência de corpo inteligentePermite a transferência sequencial de inteligências com base em gráficos de inteligências predefinidos.

- Aprimoramento do plano de fundoÉ possível atualizar a tarefa para modelos mais avançados (por exemplo, o1-mini) que lidam com decisões de alto risco.

- processamento de máquina de estadoColeta e validação de informações com precisão, como nomes de usuários e números de telefone, solicitando que o modelo siga uma máquina de estado.

- Prototipagem rápidaFornece ferramentas para criar e testar rapidamente aplicativos de fala em tempo real com várias inteligências.

- Flexibilidade de configuraçãoOs usuários podem configurar seu próprio comportamento de corpo inteligente e fluxo de interação.

Usando a Ajuda

Instalação e configuração

- armazém de clones::

git clone https://github.com/openai/openai-realtime-agents.git cd openai-realtime-agents - Configuração do ambiente::

- Certifique-se de que você tenha o Node.js e o npm instalados.

- fazer uso denpm installInstale todos os pacotes de dependência necessários.

- Iniciando o servidor local::

npm startIsso iniciará um servidor local que você pode acessar no navegador visitando o sitehttp://localhost:3000Exibir aplicativo.

Diretrizes para uso

Navegar e selecionar inteligências::

- Abra seu navegador e navegue atéhttp://localhost:3000**. **

- Você verá uma interface com um menu suspenso "Scenario" (Cenário) e um menu suspenso "Agent" (Agente) que permite selecionar diferentes cenários de inteligências e inteligências específicas.

experiência interativa::

- Selecionar cenaCenário: Selecione um cenário predefinido no menu "Scenario", por exemplo, "simpleExample" ou "customerServiceRetail ".

- Escolhendo um corpo inteligenteNo menu "Agent", selecione a inteligência com a qual deseja começar, por exemplo, "frontDeskAuthentication" ou "customerServiceRetail". customerServiceRetail".

- Iniciando um diálogoInteração com um corpo inteligente: Comece a interagir com um corpo inteligente inserindo texto por meio da interface ou diretamente por meio de entrada de voz (se compatível). A inteligência responderá à sua entrada e poderá redirecioná-lo para outra inteligência para tarefas mais complexas.

Operação detalhada das funções

- transferência sequencialQuando for necessário passar de uma Inteligência para outra, por exemplo, da autenticação da recepção para o serviço pós-venda, o sistema tratará dessa transferência automaticamente. Certifique-se de que a configuração de cada corpo inteligente esteja corretamente definida na seçãodownstreamAgents.

- Aprimoramento do plano de fundoQuando se lida com tarefas complexas ou de alto risco, as inteligências podem ser automaticamente promovidas a um modelo mais poderoso para processamento. Por exemplo, o sistema invoca o modelo o1-mini quando é necessária uma verificação detalhada da identidade de um usuário ou o processamento de uma devolução.

- processamento de máquina de estadoPara tarefas que exigem confirmação caractere a caractere, como a inserção de informações pessoais, o corpo inteligente guiará o usuário passo a passo por uma máquina de estado para garantir que cada caractere ou informação esteja correta. O usuário recebe feedback em tempo real durante o processo de entrada, como, por exemplo, "Confirme que seu sobrenome é X".

- Configuração de corpos inteligentesArquivos de configuração: Você pode encontrar os arquivos de configuração das inteligências no diretório src/app/agentConfigs/. Ao editar esses arquivos, você pode alterar o comportamento das inteligências, adicionar novas inteligências ou ajustar a lógica das inteligências existentes.

Dicas para desenvolvedores

- Para ampliar ou modificar o comportamento das inteligências, é recomendável estudar primeiro as inteligências existentes.agentConfigse, em seguida, passe o arquivotransferência_de_agentesFerramentas para permitir a transferência entre inteligências.

- Todas as interações e alterações de estado entre inteligências são exibidas na seção "Conversation Transcript" (Transcrição da conversa) da interface do usuário para facilitar a depuração e o aprimoramento.

Com essas etapas e recursos detalhados, você pode começar rapidamente e criar seu próprio aplicativo de interação de voz corporal com inteligência múltipla com o OpenAI Realtime Agents.

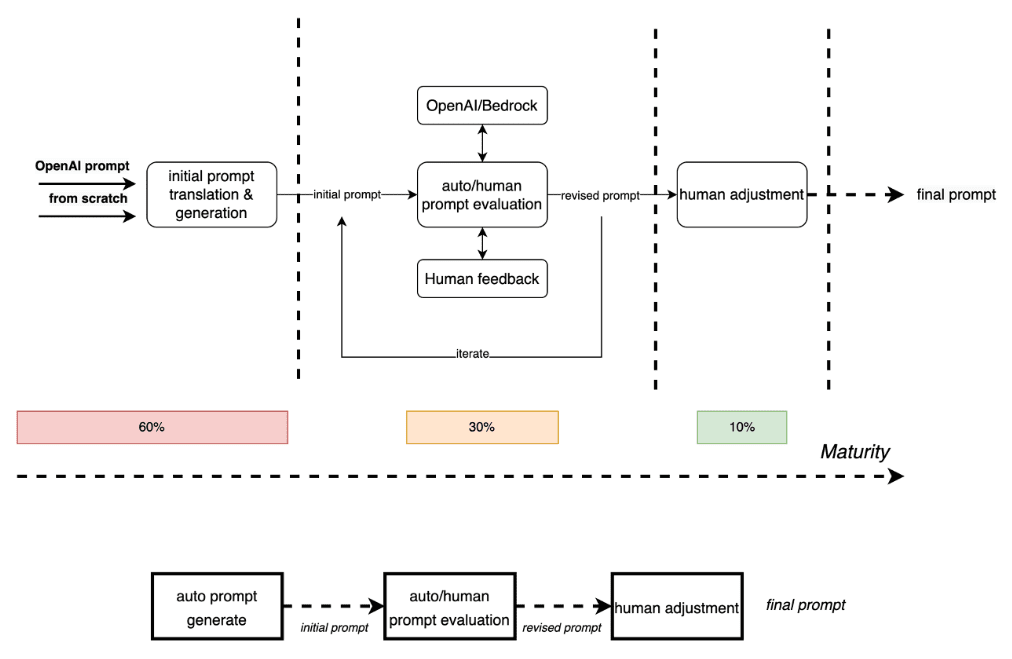

Sobre a geração de estados de diálogo

Original: https://github.com/openai/openai-realtime-agents/blob/main/src/app/agentConfigs/voiceAgentMetaprompt.txt

Example: https://chatgpt.com/share/678dcc28-9570-800b-986a-51e6f80fd241

Relacionado:Aprendizado: execução de "mudanças de estado" do fluxo de trabalho em linguagem natural (máquinas de estado)

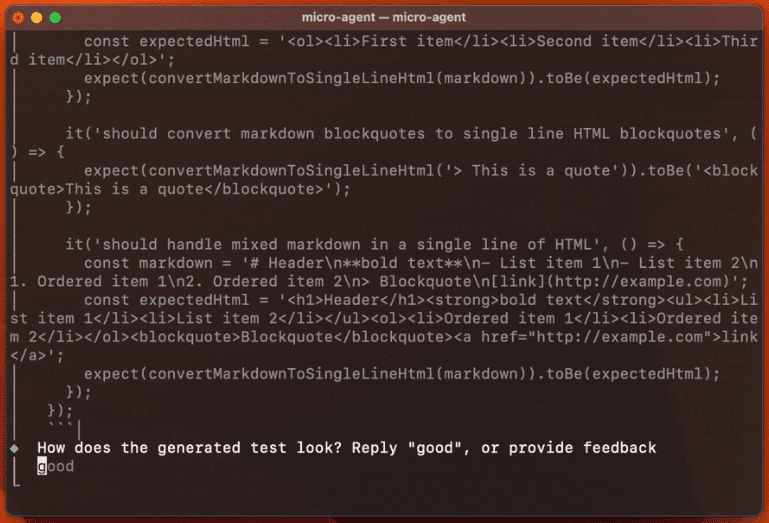

pista

// 将此**完整**文件直接粘贴到 ChatGPT 中,并在前两个部分添加您的上下文信息。 <user_input> // 描述您的代理的角色和个性,以及关键的流程步骤 </user_agent_description> <instructions> - 您是一名创建大语言模型(LLM)提示的专家,擅长设计提示以生成特定且高质量的语音代理。 - 根据用户在 user_input 中提供的信息,创建一个遵循 output_format 中格式和指南的提示。参考 <state_machine_info> 以确保状态机的构建和定义准确。 - 在定义“个性和语气”特征时要具有创造性和详细性,并尽可能使用多句表达。 <step1> - 此步骤可选。如果用户在输入中已经提供了用例的详细信息,则可以跳过。 - 针对“个性和语气”模板中尚未明确的特征,提出澄清性问题。通过后续问题帮助用户澄清并确认期望的行为,为每个问题提供三个高层次选项,**但不要**询问示例短语,示例短语应通过推断生成。**仅针对未明确说明或不清楚的特征提出问题。** <step_1_output_format> 首先,我需要澄清代理个性的几个方面。对于每一项,您可以接受当前草案、选择一个选项,或者直接说“使用你的最佳判断”来生成提示。 1. [未明确的特征 1]: a) // 选项 1 b) // 选项 2 c) // 选项 3 ... </step_1_output_format> </step1> <step2> - 输出完整的提示,用户可以直接逐字使用。 - **不要**在 state_machine_schema 周围输出 ``` 或 ```json,而是将完整提示输出为纯文本(用 ``` 包裹)。 - **不要**推断状态机,仅根据用户明确的指令定义状态机。 </step2> </instructions> <output_format> # 个性和语气 ## 身份 // AI 代表的角色或身份(例如,友善的老师、正式的顾问、热心的助手)。需要详细描述,包括其背景或角色故事的具体细节。 ## 任务 // 从高层次说明代理的主要职责(例如,“您是一名专注于准确处理用户退货的专家”)。 ## 风度 // 整体态度或性格特点(例如,耐心、乐观、严肃、富有同情心)。 ## 语气 // 语言风格(例如,热情且健谈、礼貌且权威)。 ## 热情程度 // 回应中表现的能量水平(例如,充满热情 vs. 冷静沉稳)。 ## 正式程度 // 语言风格的正式性(例如,“嘿,很高兴见到你!” vs. “下午好,有什么可以为您效劳?”)。 ## 情绪程度 // AI 在交流中表现出的情绪强度(例如,同情心强 vs. 直截了当)。 ## 语气词 // 用于让代理更加平易近人的填充词,例如“嗯”“呃”“哼”等。选项包括“无”“偶尔”“经常”“非常频繁”。 ## 节奏 // 对话的语速和节奏感。 ## 其他细节 // 任何能帮助塑造代理个性或语气的其他信息。 # 指令 - 紧密遵循对话状态,确保结构化和一致的互动 // 如果用户提供了 user_agent_steps,则应包含此部分。 - 如果用户提供了姓名、电话号码或其他需要确认拼写的信息,请始终重复确认,确保理解无误后再继续。// 此部分需始终包含。 - 如果用户对任何细节提出修改,请直接承认更改并确认新的拼写或信息值。 # 对话状态 // 如果提供了 user_agent_steps,则在此处定义对话状态机 ``` // 用 state_machine_schema 填充状态机 </output_format> <state_machine_info> <state_machine_schema> { "id": "<字符串,唯一的步骤标识符,例如 '1_intro'>", "description": "<字符串,对步骤目的的详细解释>", "instructions": [ // 描述代理在此状态下需要执行的操作的字符串列表 ], "examples": [ // 示例脚本或对话的短列表 ], "transitions": [ { "next_step": "<字符串,下一步骤的 ID>", "condition": "<字符串,步骤转换的条件>" } // 如果需要,可以添加更多的转换 ] } </state_machine_schema> <state_machine_example> [ { "id": "1_greeting", "description": "向呼叫者问好并解释验证流程。", "instructions": [ "友好地问候呼叫者。", "通知他们需要收集个人信息以进行记录。" ], "examples": [ "早上好,这里是前台管理员。我将协助您完成信息验证。", "让我们开始验证。请告诉我您的名字,并逐字母拼写以确保准确。" ], "transitions": [{ "next_step": "2_get_first_name", "condition": "问候完成后。" }] }, { "id": "2_get_first_name", "description": "询问并确认呼叫者的名字。", "instructions": [ "询问:‘请问您的名字是什么?’", "逐字母拼写回呼叫者以确认。" ], "examples": [ "请问您的名字是什么?", "您刚才拼写的是 J-A-N-E,对吗?" ], "transitions": [{ "next_step": "3_get_last_name", "condition": "确认名字后。" }] }, { "id": "3_get_last_name", "description": "询问并确认呼叫者的姓氏。", "instructions": [ "询问:‘谢谢。请问您的姓氏是什么?’", "逐字母拼写回呼叫者以确认。" ], "examples": [ "您的姓氏是什么?", "确认一下:D-O-E,是这样吗?" ], "transitions": [{ "next_step": "4_next_steps", "condition": "确认姓氏后。" }] }, { "id": "4_next_steps", "description": "验证呼叫者信息并继续下一步。", "instructions": [ "告知呼叫者您将验证他们提供的信息。", "调用 'authenticateUser' 函数进行验证。", "验证完成后,将呼叫者转接给 tourGuide 代理以提供进一步帮助。" ], "examples": [ "感谢您提供信息,我现在开始验证。", "正在验证您的信息。", "现在我将为您转接到另一位代理,她会为您介绍我们的设施。为展示不同的个性,她会表现得稍微严肃一些。" ], "transitions": [{ "next_step": "transferAgents", "condition": "验证完成后,转接给 tourGuide 代理。" }] } ] </state_machine_example> </state_machine_info> ```

© declaração de direitos autorais

Direitos autorais do artigo Círculo de compartilhamento de IA A todos, favor não reproduzir sem permissão.

Artigos relacionados

Nenhum comentário...