LocalGPT: garanta a privacidade dos dados conversando com vários documentos em dispositivos locais

Introdução geral

O LocalGPT é um projeto de código aberto desenvolvido para permitir que os usuários conversem com documentos em dispositivos locais, garantindo a privacidade dos dados. Usando uma variedade de modelos de código aberto, o LocalGPT pode processar e compreender o conteúdo de documentos sem fazer upload de dados para a nuvem. O projeto é compatível com várias plataformas, incluindo GPU, CPU, HPU e MPS, e oferece recursos avançados, como histórico de sessões, interfaces de API e GUIs. O objetivo do design do LocalGPT é oferecer aos usuários um ambiente seguro e privado de interação com documentos para cenários que exigem alta proteção da privacidade.

Lista de funções

- privacidade de dadosTodos os processamentos de dados são realizados no dispositivo local, garantindo a segurança dos dados.

- Suporte a vários modelosSuporte a vários modelos de código aberto, incluindo HF, GPTQ, GGML e GGUF.

- Incorporação múltipla: Há uma variedade de opções de incorporação de código aberto disponíveis.

- Reutilização do modeloO LLM pode ser reutilizado após o download, sem a necessidade de baixá-lo várias vezes.

- história da conversaçãoLembre-se do histórico do diálogo em uma sessão.

- Interface da APIAPI: fornece uma interface de API para facilitar a criação de aplicativos RAG.

- interface gráfica do usuário (GUI)GUI: fornece GUI baseada em API e autônoma (baseada em streamlit).

- Suporte a várias plataformasSuporte a várias plataformas, como CUDA, CPU, HPU (Intel® Gaudi®) e MPS.

Usando a Ajuda

Processo de instalação

- armazém de clonesExecute o seguinte comando em um terminal para clonar o repositório LocalGPT:

git clone https://github.com/PromtEngineer/localGPT.git

- Instalação de dependênciasInstalação de dependências: Vá para o diretório do projeto e instale as dependências necessárias:

cd localGPT

pip install -r requirements.txt

- Ambiente de configuraçãoConfigure as variáveis de ambiente e os caminhos do modelo conforme necessário.

Uso

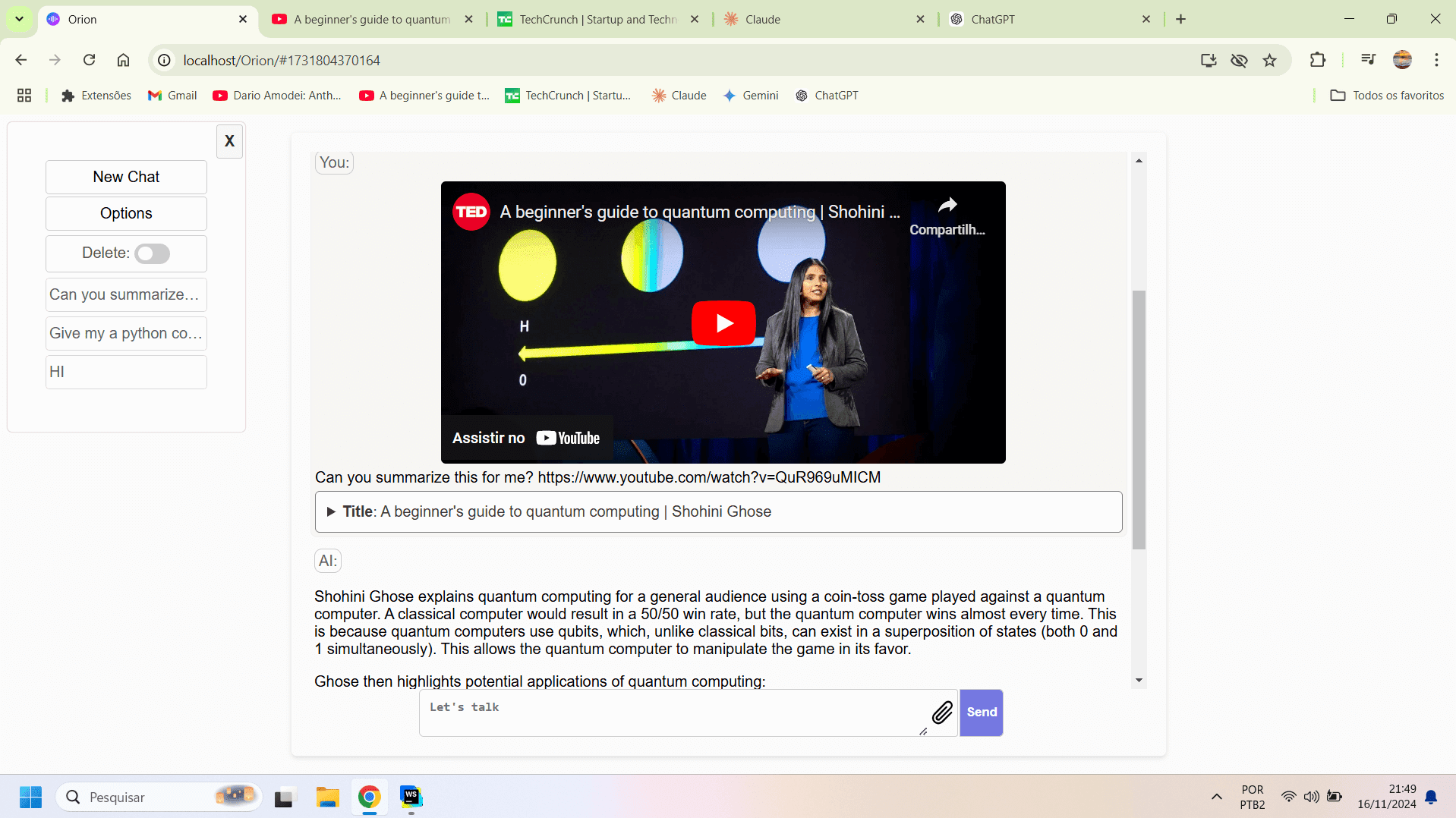

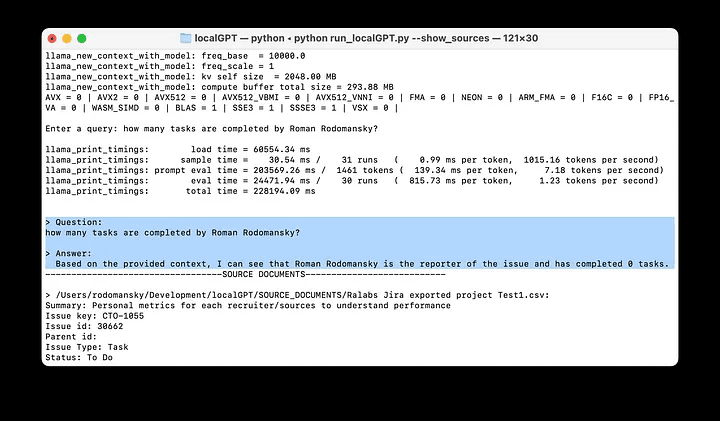

- Início dos serviçosExecute o seguinte comando para iniciar o serviço LocalGPT:

python run_localGPT.py

- interface de acessoAbra um navegador e visite o endereço local fornecido para acessar a GUI.

- Fazer upload de um documentoCarregar os documentos a serem processados na interface.

- Iniciando um diálogoDigite uma pergunta na caixa de diálogo e o LocalGPT gerará uma resposta com base no conteúdo do documento.

Operação detalhada da função

- privacidade de dadosSegurança de dados: Todo o processamento de dados é realizado em dispositivos locais, garantindo a segurança dos dados. Os usuários não precisam se preocupar com o vazamento de dados.

- Suporte a vários modelosLocalGPT: O LocalGPT oferece suporte a uma variedade de modelos de código aberto, os usuários podem escolher o modelo apropriado para o processamento de documentos de acordo com as necessidades.

- história da conversaçãoLocalGPT: O LocalGPT registra o histórico de conversas em uma sessão, facilitando aos usuários a visualização e o gerenciamento do conteúdo de conversas anteriores.

- Interface da APILocalGPT: O LocalGPT fornece interfaces de API que os desenvolvedores podem usar para criar seus próprios aplicativos RAG para maior personalização.

- interface gráfica do usuário (GUI)LocalGPT: O LocalGPT oferece uma interface gráfica de usuário baseada em streamlit que permite que os usuários realizem uploads de documentos e operações de diálogo por meio de uma interface intuitiva.

Exemplo de procedimento operacional

- Fazer upload de um documentoClique no botão "Upload Document" e selecione o arquivo do documento a ser processado.

- Problemas de entradaDigite uma pergunta na caixa de diálogo, por exemplo, "What is the main content of this document?" (Qual é o conteúdo principal deste documento?). .

- Ver respostaLocalGPT: O LocalGPT gerará a resposta com base no conteúdo do documento e a exibirá em uma caixa de diálogo.

- Gerenciar sessõesOs usuários podem visualizar e gerenciar o histórico da sessão para facilitar a referência e o uso posterior.

© declaração de direitos autorais

Direitos autorais do artigo Círculo de compartilhamento de IA A todos, favor não reproduzir sem permissão.

Artigos relacionados

Nenhum comentário...