InspireMusic: estrutura de geração de música, canção e áudio unificada e de código aberto da Ali

Introdução geral

O InspireMusic é um kit de ferramentas de código aberto baseado no PyTorch voltado para a geração de música, canções e áudio. Ele fornece uma estrutura unificada para a geração de áudio de alta qualidade com controle sobre dicas de texto, estrutura musical e estilo musical. O InspireMusic é compatível com a geração de áudio de 24kHz e 48kHz e é capaz de gerar áudio longo. O kit de ferramentas não só fornece código de inferência e treinamento, mas também suporta treinamento de precisão mista para ajuste fino e inferência de modelos. O objetivo do InspireMusic é ajudar os usuários a inovar paisagens sonoras e aprimorar a estética harmônica na pesquisa musical por meio do processo de rotulagem e desrotulagem de áudio.

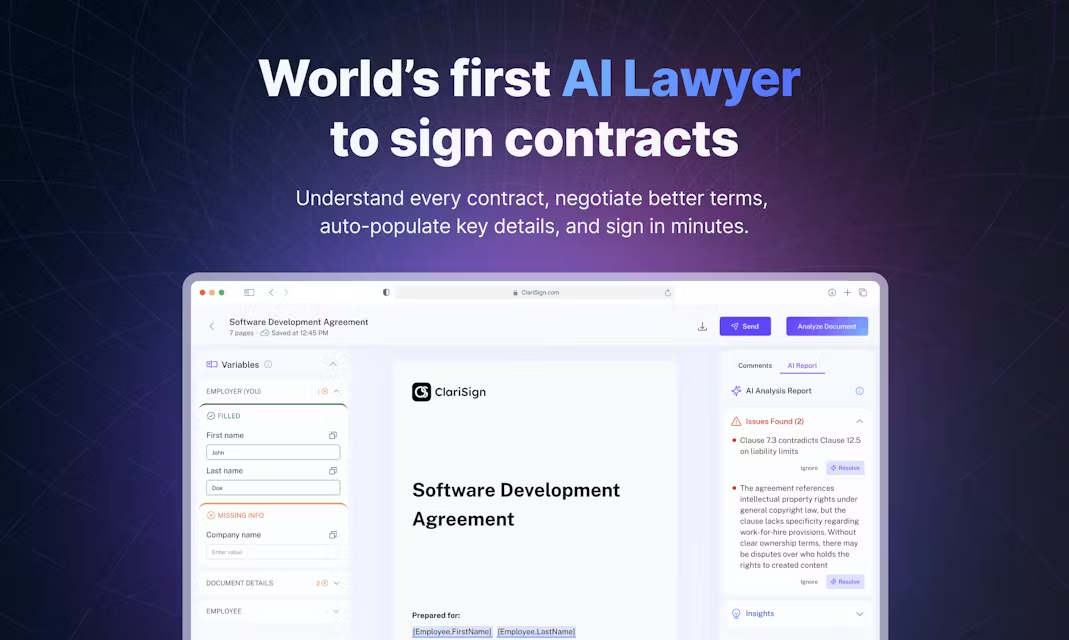

Demonstração: https://modelscope.cn/studios/iic/InspireMusic/summary

Lista de funções

- Texto para músicaGeração de música a partir de dicas de texto.

- Controle da estrutura musicalSuporte para geração de música com base em estruturas musicais.

- Controle de estilo musicalMúsica: Você pode controlar o estilo da música gerada.

- Geração de áudio de alta qualidadeSuporte para geração de áudio de 24kHz e 48kHz.

- Geração de áudio longoSuporte à geração de áudio de longa duração: suporta a geração de áudio de longa duração.

- Treinamento de precisão mistoSuporte para treinamento de precisão mista BF16, FP16/FP32.

- Ajuste fino e inferência de modelosPermite fácil ajuste fino e raciocínio sobre scripts e estratégias.

- Demonstração on-lineDemonstração on-line: Uma demonstração on-line está disponível e os usuários podem experimentá-la no ModelScope e no HuggingFace.

Usando a Ajuda

Processo de instalação

- Armazém de Clonagem:

git clone https://github.com/FunAudioLLM/InspireMusic.git

cd InspireMusic

- Instale a dependência:

pip install -r requirements.txt

- Instale o PyTorch (escolha o comando de instalação apropriado para sua versão do CUDA):

pip install torch torchvision torchaudio

Diretrizes para uso

Texto para música

- Preparar instruções de texto, por exemplo, "Generate an upbeat piece of piano music" (Crie uma música de piano animada).

- Execute o script de geração:

python app.py --text "生成一段欢快的钢琴音乐"

- A música gerada será salva no diretório de saída especificado.

Controle da estrutura musical

- Prepare um arquivo de estrutura musical que defina os ritmos, acordes etc. da música.

- Execute o script de geração:

python app.py --structure path/to/structure/file

- A música gerada será baseada no arquivo de estrutura.

Controle de estilo musical

- Selecione um estilo musical predefinido, por exemplo, "Clássico", "Jazz", etc.

- Execute o script de geração:

python app.py --style "古典"

- A música gerada corresponderá ao estilo musical selecionado.

Ajuste fino e inferência de modelos

O InspireMusic oferece scripts convenientes de ajuste fino e inferência que permitem aos usuários ajustar o modelo e a inferência de acordo com suas necessidades. Veja abaixo um exemplo simples de ajuste fino:

- Prepare o conjunto de dados de treinamento.

- Execute o script de ajuste fino:

python finetune.py --data path/to/dataset --output path/to/output/model

- Inferência usando um modelo com ajuste fino:

python app.py --model path/to/output/model --text "生成一段新的音乐"

Demonstração on-line

Os usuários podem visitar as páginas de demonstração on-line no ModelScope e no HuggingFace para experimentar o poder do InspireMusic. Basta inserir prompts de texto para gerar músicas de alta qualidade.

jian27 Pacote de integração

Quark: https://pan.quark.cn/s/4843d9c54615

Baidu: https://pan.baidu.com/s/1hKIHENqPbKRBjnbVRBni7Q?pwd=2727

© declaração de direitos autorais

Direitos autorais do artigo Círculo de compartilhamento de IA A todos, favor não reproduzir sem permissão.

Artigos relacionados

Nenhum comentário...