GLM-4.5 - Modelo SOTA de código aberto Smart Spectrum para raciocínio, código e inteligência

O que é o GLM-4.5

O GLM-4.5 é um modelo SOTA de código aberto da Smart Spectrum, projetado para aplicativos de corpo inteligente, incorporando raciocínio, geração de código e recursos de corpo inteligente. O modelo é baseado na arquitetura Mixed Expert (MoE) e consiste em duas versões, GLM-4.5 com 355 bilhões de parâmetros e GLM-4.5-Air com 106 bilhões de parâmetros e 32 bilhões e 12 bilhões de parâmetros de ativação, respectivamente. O modelo tem bom desempenho em raciocínio, geração de código e outras tarefas, suporta entradas e saídas multimodais e oferece "modo de pensar" e "modo de não pensar" para se adaptar a tarefas complexas e necessidades de resposta imediata. O modelo tem alta eficiência de parâmetros, baixo custo de chamada de API, velocidade de geração rápida e é adequado para desenvolvimento de pilha completa, assistência à programação, criação de conteúdo e outros cenários, o que o torna o melhor modelo de código aberto no momento.

Principais funções do GLM-4.5

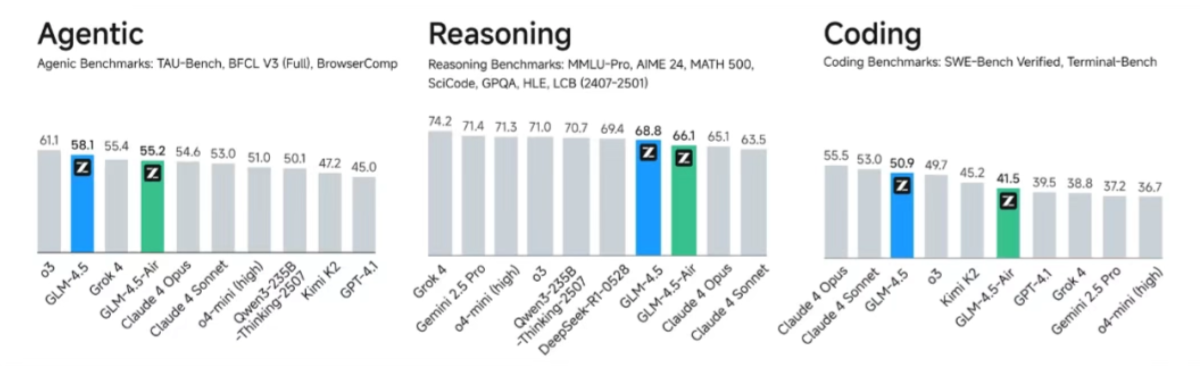

- capacidade de raciocínioGLM-4.5 é capaz de lidar com tarefas de raciocínio complexas, como raciocínio lógico, solução de problemas matemáticos etc. A capacidade de raciocínio é excelente em vários benchmarks e atinge o nível mais alto dos modelos de código aberto.

- geração de códigoO modelo gera trechos de código de alta qualidade e oferece suporte a várias linguagens de programação, ajudando os desenvolvedores a gerar rapidamente estruturas de código, corrigir erros de código, otimizar a estrutura do código, etc., e ser competentes em tarefas de desenvolvimento de pilha completa.

- Aplicativos para corpos inteligentesSuporte para invocação de ferramentas, navegação na Web e outros recursos, suporte para acessar estruturas de corpo de inteligência de código, como Claude Código e código Roo para tarefas de corpo inteligente para aplicativos complexos de corpo inteligente.

- Geração de conteúdoGeração de conteúdo: Pode gerar vários tipos de conteúdo, como artigos, relatórios de notícias, redação criativa etc. É adequado para a criação de conteúdo, redação e outros cenários, oferecendo aos usuários suporte à geração de textos avançados.

Endereço do site oficial do GLM-4.5

- Repositório do GitHub:: https://github.com/zai-org/GLM-4.5

- Armazém HuggingFace: https://huggingface.co/collections/zai-org/glm-45-687c621d34bda8c9e4bf503b

- Armazém do ModelScope:: https://modelscope.cn/collections/GLM-45-b8693e2a08984f

- Demonstração da experiência on-line::

- HuggingFace: https://huggingface.co/spaces/zai-org/GLM-4.5-Space

- Escopo do modelo:: https://modelscope.cn/studios/ZhipuAI/GLM-4.5-Demo

Como usar o GLM-4.5

- Experiência em plataformas on-line::

- Plataforma Wisdom Spectrum Clear Speech: Acessodiscurso intelectualmente estimulantepara experimentar a funcionalidade completa do GLM-4.5, incluindo geração de diálogo, geração de código e tarefas de inferência, direta e gratuitamente.

- Plataforma Z.ai: através de Z.ai Plataforma para experimentar os recursos do GLM-4.5 para testes rápidos.

- Chamadas de APISmart Spectrum AI fornece uma interface API, que os usuários podem acessar por meio do BigModel.co.uk A plataforma faz chamadas de API. A API oferece suporte a várias funções, incluindo geração de texto, geração de código e tarefas de inferência.

- Implementação por meio de código-fonte aberto::

- Repositórios do GitHubVisite o repositório GitHub do GLM-4.5 para obter o código do modelo e os recursos relacionados para implantar e usar por conta própria.

- Armazém HuggingFaceVisite o repositório HuggingFace para o GLM-4.5 para implantar e testar com as ferramentas e o ambiente fornecidos pelo HuggingFace.

- Armazém do ModelScopeAcesso ao repositório do ModelScope no GLM-4.5 para implantação de modelos e desenvolvimento de aplicativos usando a funcionalidade da plataforma do ModelScope.

- Espaço de experiência HuggingFaceVisite o Espaço de Experiência GLM-4.5 do HuggingFace para uma rápida avaliação dos recursos do modelo.

- Espaço de experiência ModelScopeVisite o GLM-4.5 Experience Space da ModelScope para experimentar e testar on-line.

Indicadores técnicos do GLM-4.5

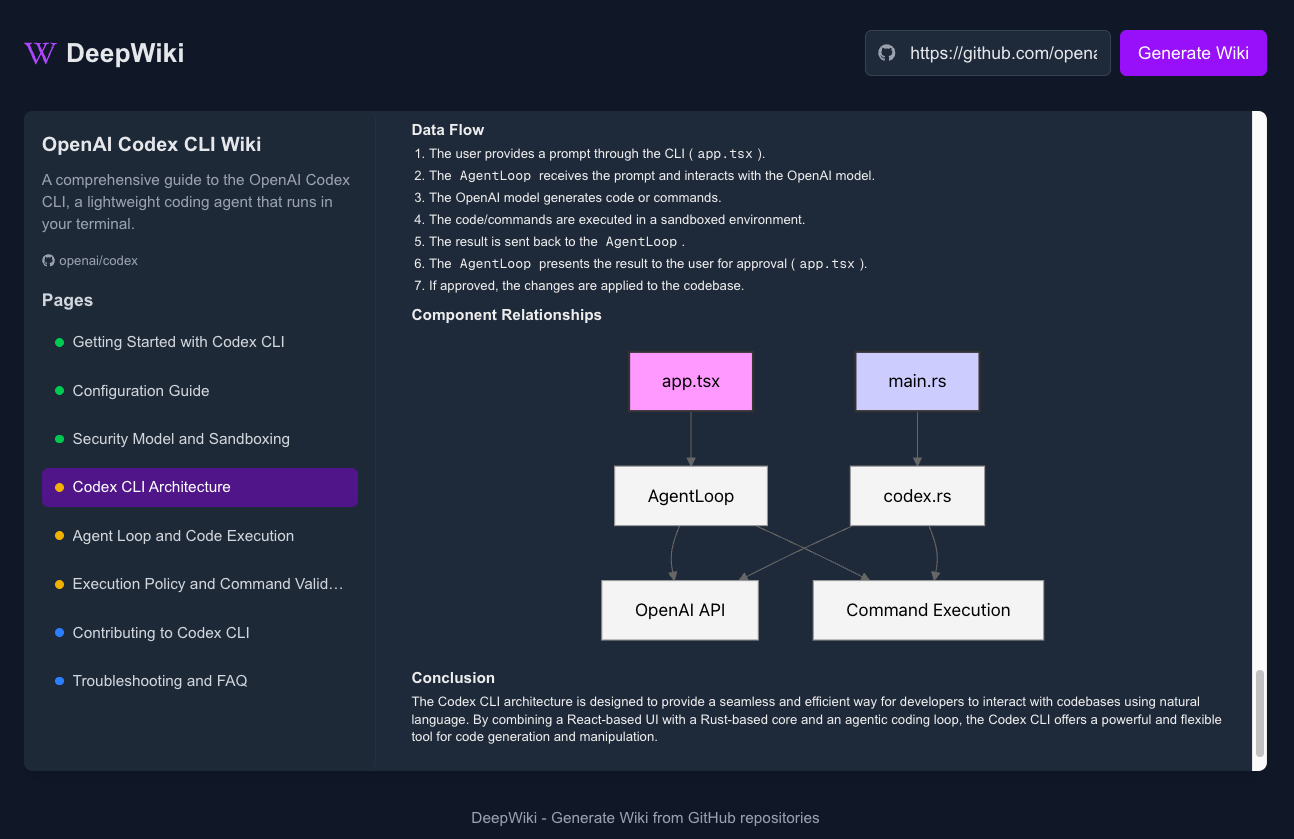

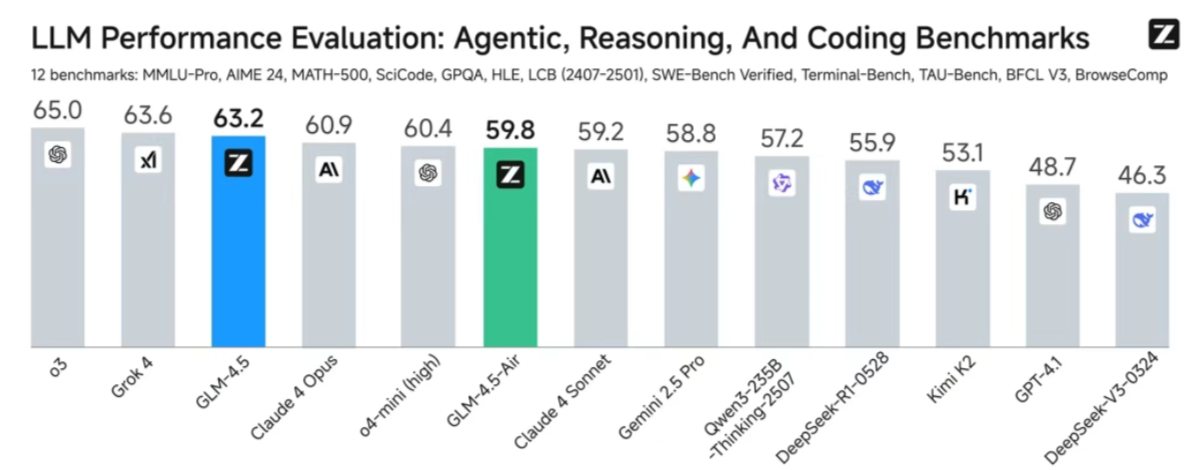

- Desempenho geral SOTAEntre 12 benchmarks de avaliação representativos, o GLM-4.5 alcançou o terceiro lugar em modelos globais, o primeiro lugar em modelos domésticos e o primeiro lugar em modelos de código aberto. Os benchmarks de avaliação incluem MMLU Pro, AIME 24, MATH 500, SciCode, GPQA, HLE, LiveCodeBench, SWE-Bench Verified, Terminal-Bench, TAU-Bench, BFCL v3 e BrowseComp, o que comprova plenamente que o GLM-4.5 pode ser usado para inferência múltipla, geração de código e aplicação de corpo inteligente. O excelente desempenho do GLM-4.5 em vários cenários, como inferência, geração de código e aplicativos de corpo inteligente.

- Maior eficiência dos parâmetrosO GLM-4.5 tem apenas 1/2 do número de parâmetros do DeepSeek-R1 e 1/3 do número do Kimi-K2, e tem um desempenho muito melhor em muitos benchmarks padrão. Na lista SWE-bench Verified, que mede a capacidade do código do modelo, a série GLM-4.5 está localizada na fronteira de Pareto da relação desempenho/parâmetro, indicando que a série GLM-4.5 obtém o melhor desempenho na mesma escala.

- Baixo custo, alta velocidadeA série GLM-4.5 alcança avanços em termos de custo e eficiência e, ao mesmo tempo, otimiza o desempenho: o preço da chamada de API é tão baixo quanto US$ 0,8/milhão de tokens para entrada e US$ 2/milhão de tokens para saída, muito inferior ao preço do modelo convencional. A versão de alta velocidade pode gerar até 100 tokens/segundo, o que permite a implementação de baixa latência e alta simultaneidade, levando em conta a relação custo-benefício e a experiência interativa.

Principais benefícios do GLM-4.5

- Integração de várias competênciasGLM-4.5 é o primeiro modelo que combina nativamente raciocínio, geração de código e recursos de corpo inteligente para atender simultaneamente às diversas necessidades de raciocínio complexo, desenvolvimento de código e tarefas de corpo inteligente.

- Excelente desempenho de inferênciaO GLM-4.5 está no topo do modelo de código aberto em vários benchmarks de raciocínio e é capaz de lidar com tarefas de raciocínio complexas, como raciocínio lógico, solução de problemas matemáticos e outras habilidades de raciocínio avançadas.

- Modelo de raciocínio híbrido eficienteO modelo oferece dois modos de raciocínio, o "modo de pensar" e o "modo de não pensar". O modo de pensamento é adequado para tarefas complexas que exigem análises aprofundadas, enquanto o modo de não pensamento permite respostas rápidas para atender às necessidades imediatas, equilibrando eficiência e desempenho.

- Alta eficiência de parâmetrosGLM-4.5 tem um pequeno número de parâmetros, mas apresenta melhor desempenho em muitos benchmarks padrão. Por exemplo, o GLM-4.5 lidera a relação desempenho/parâmetro em testes de capacidade de geração de código.

- Baixo custo e alta velocidadeAs chamadas de API do GLM-4.5 são muito acessíveis, com custos de entrada tão baixos quanto US$ 0,8/milhão de tokens e custos de saída de US$ 2/milhão de tokens, além de velocidades de geração de até 100 tokens/segundo, suportando implantações de baixa latência e alta moeda.

- suporte multimodalO GLM-4.5 é compatível com entrada e saída multimodal e pode lidar com vários tipos de dados, como texto e imagens, o que o torna mais confortável para lidar com tarefas complexas de corpos inteligentes, por exemplo, com bom desempenho em cenários de interação multimodal, como navegação na Web e invocação de ferramentas.

Pessoas a quem o GLM-4.5 se destina

- Desenvolvedores e programadoresGeração rápida de estruturas de código, correção de bugs, otimização de estruturas e aumento da eficiência do desenvolvimento com a ajuda dos recursos de geração de código e assistência à programação.

- criador de conteúdoGeração rápida de primeiros rascunhos de artigos, notícias, textos criativos e muito mais, fornecendo inspiração criativa e ajudando a superar gargalos criativos.

- Pesquisadores acadêmicosComo uma ferramenta de pesquisa para ajudar a explorar questões de ponta em processamento de linguagem natural e inteligência artificial para comparação e aprimoramento de modelos.

- usuário corporativoUtilizado para criar atendimento inteligente ao cliente, gerar relatórios de análise de dados e desenvolver ferramentas de automação para aumentar a eficiência das operações comerciais.

- Educadores e alunosOs professores geram materiais de instrução e os alunos usam suas funções de suporte ao aprendizado, como gerar anotações e explicar conceitos.

© declaração de direitos autorais

Direitos autorais do artigo Círculo de compartilhamento de IA A todos, favor não reproduzir sem permissão.

Artigos relacionados

Nenhum comentário...