Introdução geral ao DreamTalk

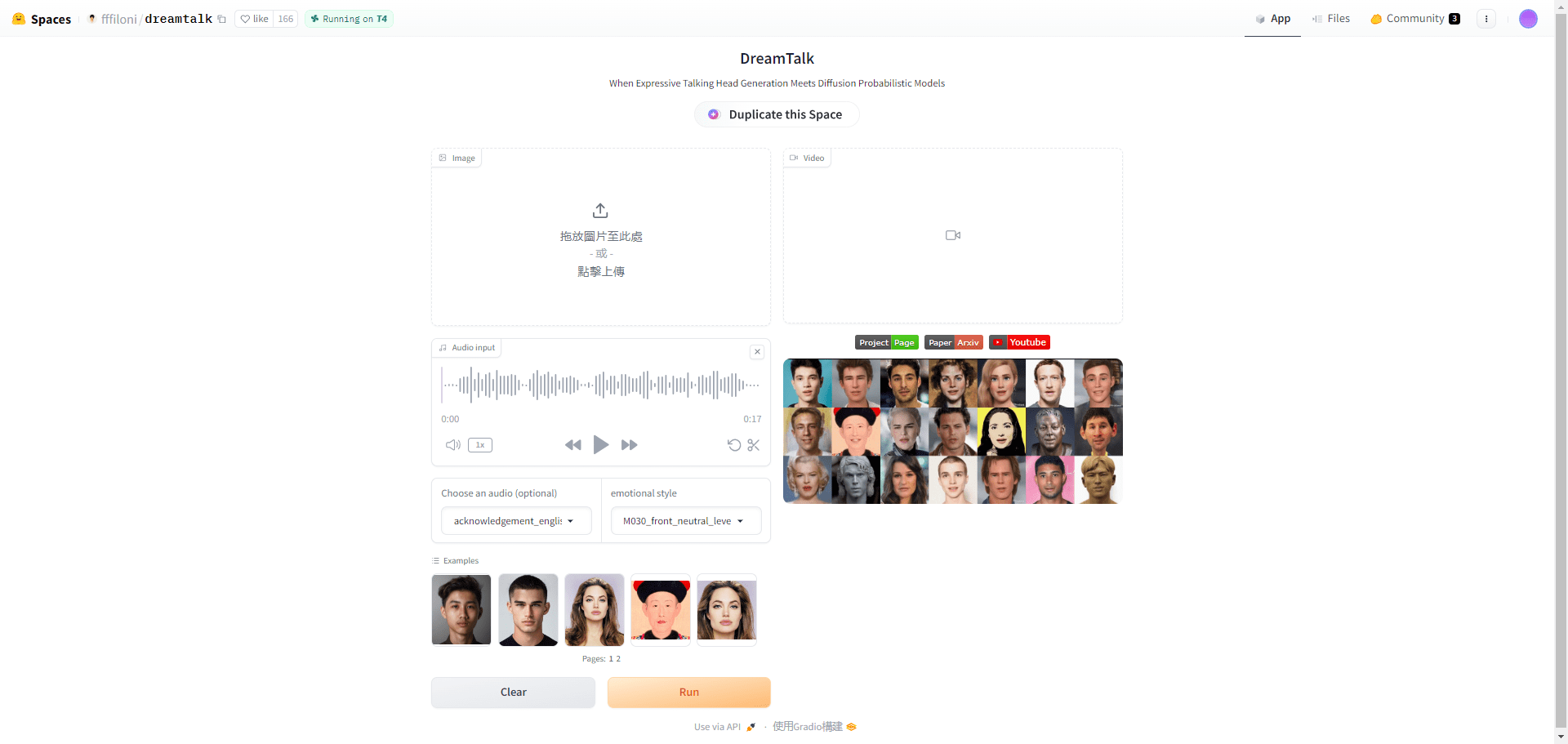

O DreamTalk é uma estrutura de geração de cabeças falantes expressivas orientada por modelos de difusão, desenvolvida em conjunto pela Universidade de Tsinghua, pelo Grupo Alibaba e pela Universidade de Ciência e Tecnologia de Huazhong. Ele consiste em três componentes principais: uma rede de redução de ruído, um especialista em lábios com reconhecimento de estilo e um preditor de estilo, e é capaz de gerar cabeças falantes diversas e realistas com base na entrada de áudio. A estrutura é capaz de lidar com áudio multilíngue e ruidoso, fornecendo movimentos faciais de alta qualidade e sincronização precisa da boca.

Lista de recursos do DreamTalk

Gerar vídeos realistas de cabeças falantes com base no áudio

Suporte a vários idiomas e entrada de voz

Suporta a saída de vários estilos e expressões

Suporte para avatares de personagens personalizados e referências de estilo

Suporte a demonstração on-line e download de código

Ajuda do DreamTalk

Visite a página inicial do projeto para obter mais informações e vídeos de demonstração

Visite o endereço do artigo para ler os detalhes técnicos e os resultados experimentais

Visite o endereço do GitHub para fazer o download do código e do modelo pré-treinado

Siga o guia de instalação para configurar o ambiente e as dependências

Execute inference_for_demo_video.py para raciocinar e gerar o vídeo

Ajuste as opções de entrada e saída de acordo com as descrições dos parâmetros