はじめに

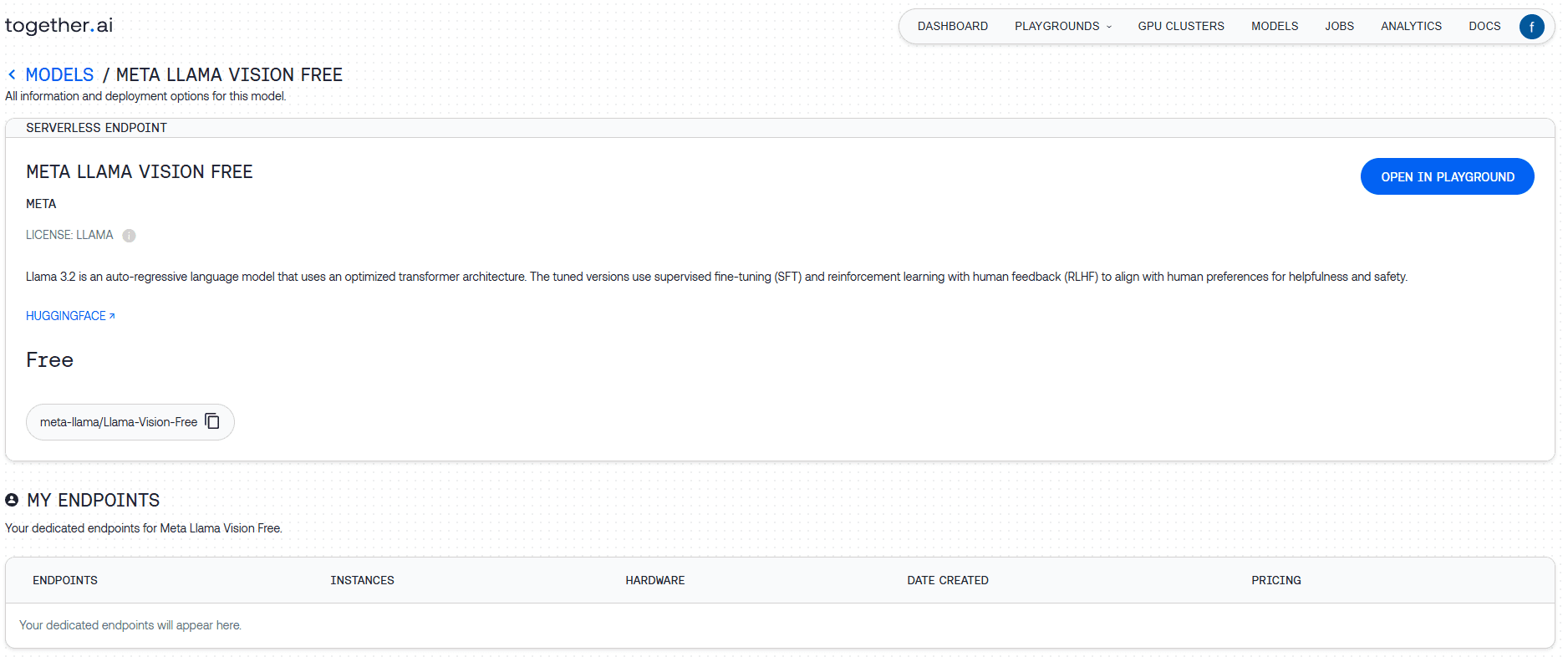

Llama OCRはLlama 3.2 VisionをベースとしたOCR(光学式文字認識)ライブラリで、ドキュメントをMarkdownフォーマットに変換します。このライブラリはNutlopeによって開発され 一緒に AIが提供する無料のLlama 3.2インターフェイスは、画像を解析し、Markdownテキストを返す。 Llama OCRは、ローカルおよびリモートの画像のOCRをサポートしており、将来的にはPDFファイルのOCRをサポートする予定である。

参考資料 ゼロックス

デモ:https://llamaocr.com/

togetherが提供するMeta Llama Visionへの無料インターフェースをご利用ください: https://api.together.ai/models/meta-llama/Llama-Vision-Free

より自由なビジュアルモデル:Smart Spectrumオープンプラットフォーム、初の無料マルチモーダルビジョンモデルGLM-4V-Flashをオンラインで、無制限に使用できます!

機能一覧

- 画像OCRローカルおよびリモート画像の光学式文字認識をサポート。

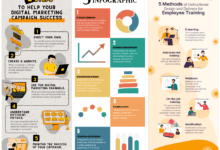

- マークダウン出力認識されたテキストをMarkdown形式に変換します。

- マルチモデル対応Llama 3.2モデルのインターフェースは、無料と有料のものがあり、さまざまな性能要件を満たすことができます。

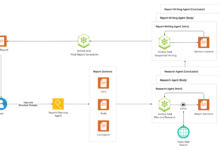

- API統合Together AIのAPIによる画像解析。

- 将来の機能このプログラムは、単一および複数ページのPDFのOCR処理と、JSON形式の出力をサポートしています。

ヘルプの使用

設置プロセス

- Node.js環境がインストールされていることを確認する。

- npm を使用して Llama OCR ライブラリをインストールします:

npm i llama-ocr

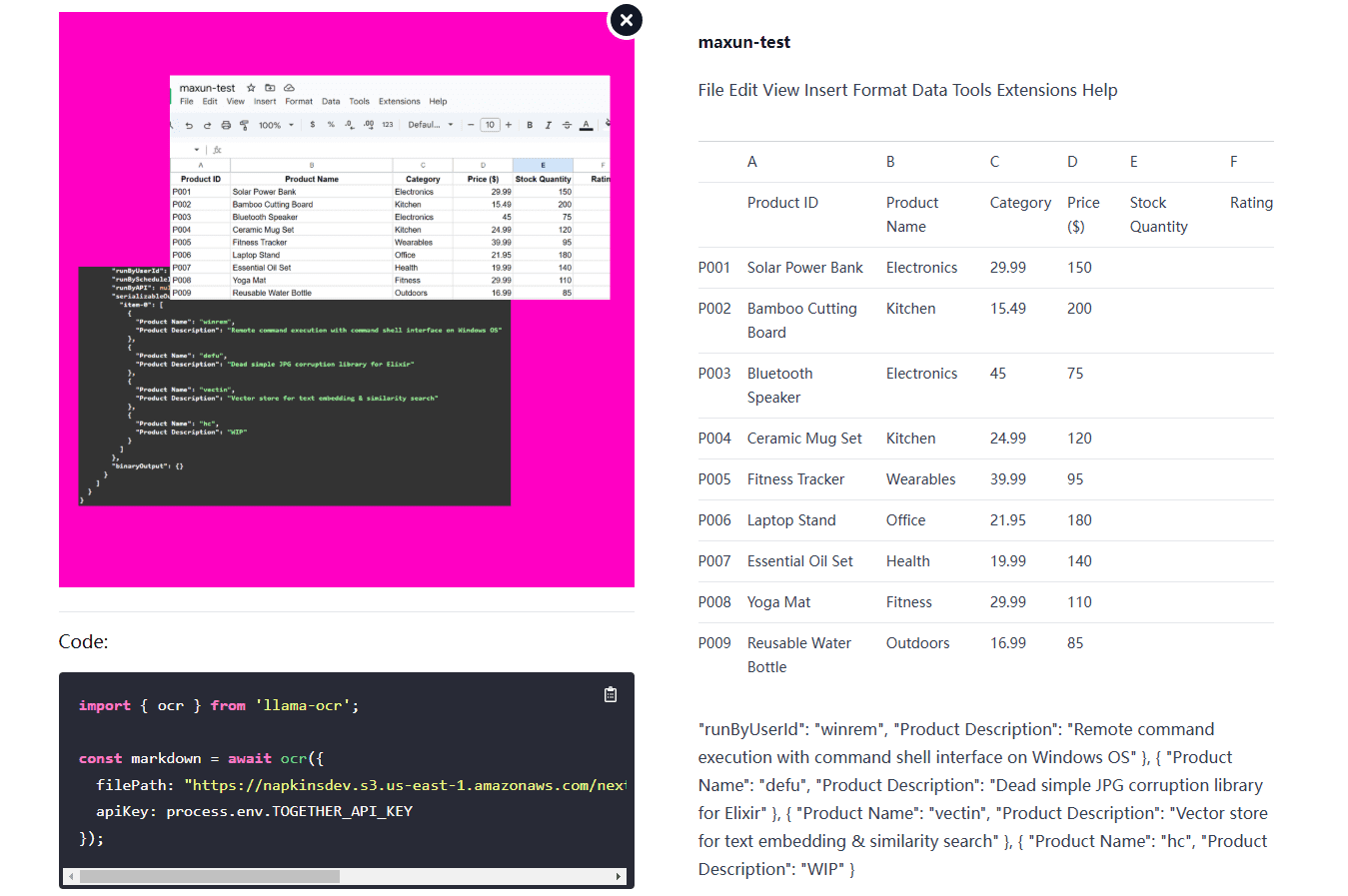

使用方法

- Llama OCRライブラリをインポートします:

llama-ocr" から { ocr } をインポートする。

- 各論

OCR関数を使用する:

const markdown = await ocr({

filePath: "./trader-joes-receipt.jpg", // 画像ファイルのパス

apiKey: process.env.TOGETHER_API_KEY, // Together AI APIキー

});

- 返されたMarkdownテキストを処理します:

console.log(markdown);

詳細な機能操作

- 画像OCR画像ファイルのパスを

OCR関数を使用すると、画像のテキストコンテンツを取得できます。 - マークダウン出力解析されたテキストは自動的にMarkdown形式に変換され、ドキュメントで簡単に使用できます。

- マルチモデル対応を設定する。

モデルパラメータで、異なるLlama 3.2モデルを選択することができる(例ラマ-3.2-90B-ビジョンもしかしたらラマ3.2-11B-ビジョン)を使用して、さまざまなパフォーマンスニーズに対応することができる。 - API統合Together AI の API キーは、画像解析用のインターフェースを呼び出すために環境変数に設定する必要があります。

サンプルコード

import { ocr } from "llama-ocr".

非同期関数 runOCR() {

const markdown = await ocr({

filePath: "./example-image.jpg"、

apiKey: "your-together-ai-api-key"、

});

console.log(markdown);

}

runOCR();

将来の機能

- PDFサポート将来のバージョンでは、単一および複数ページのPDFファイルのOCRをサポートする予定です。

- JSON出力Markdownフォーマットに加え、JSON出力もサポートされ、データ処理と統合が容易になります。

以上の手順で、ユーザーは簡単にLlama OCRライブラリをインストールして使用し、画像内のテキストコンテンツをMarkdown形式に変換し、文書処理効率を向上させることができます。