はじめに

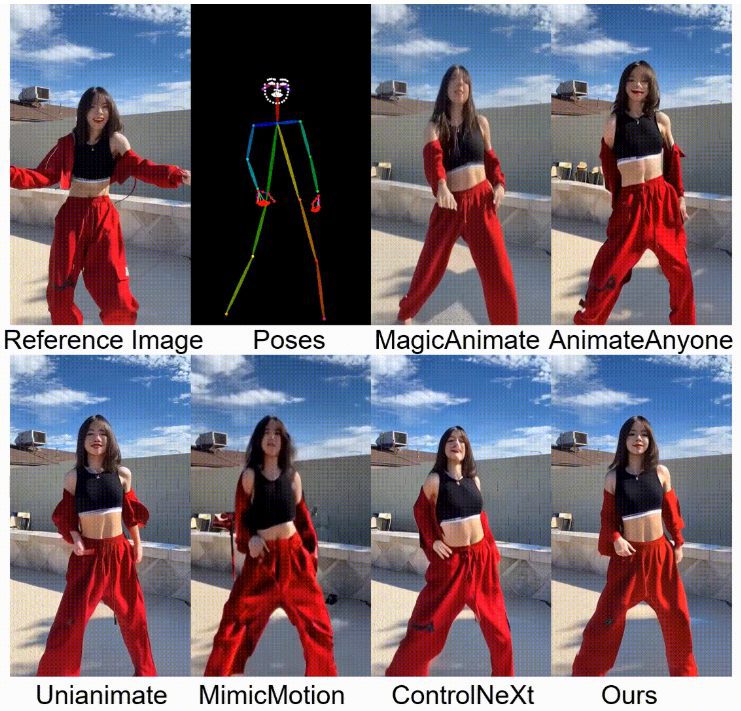

StableAnimatorは、参照画像と一連のポーズに基づき、後処理なしで高品質なビデオを合成できる、革新的なエンドツーエンドの同一性保持ビデオ拡散フレームワークです。復旦大学、マイクロソフト・リサーチ・アジア、Huya Inc、カーネギー・メロン大学の研究者と共同で開発されたStableAnimatorは、映像の同一性を保証します。アイデンティティーの一貫性を保証する。このフレームワークは、複数のベンチマークで優れた性能を発揮し、忠実度の高い、アイデンティティを保持したポートレートアニメーションを生成します。

機能一覧

- アイデンティティ保持のためのビデオ生成参照画像とポーズシーケンスに基づいて高品質のビデオを生成し、同一性の一貫性を確保します。

- 後処理なし出来上がった映像は、顔交換ツールや顔復元モデルによる後処理を必要としません。

- グローバル・コンテンツ・アウェア・フェイシャル・エンコーダー画像埋め込みとの相互作用により、顔埋め込みをさらに最適化。

- ディストリビューション・アウェア・アイデンティティ・アダプタアイデンティティの一貫性を保ちながら、タイムレイヤーの干渉を防ぐ。

- ハミルトン-ヤコビ-ベルマン最適化推論の過程でHJB方程式を解くことで、顔の質はさらに向上する。

ヘルプの使用

設置プロセス

- クローン倉庫ターミナルで以下のコマンドを実行し、StableAnimatorリポジトリをクローンする:

git clone https://github.com/Francis-Rings/StableAnimator.git

- 依存関係のインストールリポジトリディレクトリに移動し、必要な依存関係をインストールする:

cd StableAnimator

pip install -r requirements.txt

- アプリケーションの実行以下のコマンドでアプリケーションを起動します:

python app.py

使用プロセス

- 参照画像とポーズシーケンスの準備アニメーションを生成するために使用する参照画像と一連のポーズ画像があることを確認してください。

- 推論スクリプトの実行以下のコマンドを使用して推論スクリプトを実行し、ビデオアニメーションを生成します:

python inference_basic.py --reference_image path_to_reference_image --pose_sequence path_to_pose_sequence

- 生成された結果を見る生成されたビデオは、指定された出力ディレクトリに保存され、任意のビデオプレーヤーを使用して結果を表示することができます。

詳細な機能操作

- アイデンティティ保持のためのビデオ生成参照画像と一連のポーズを提供することで、StableAnimatorは高品質なビデオアニメーションを生成することができます。

- グローバル・コンテンツ・アウェア・フェイシャル・エンコーダーこのモジュールは、画像埋め込みと相互作用することで、顔の埋め込みをさらに最適化し、生成されたビデオにおける顔の詳細の高い忠実度を保証します。

- ディストリビューション・アウェア・アイデンティティ・アダプタビデオの生成中、モジュールは、時間層の干渉を防ぐアライメント技術によって、ビデオの同一性の一貫性を保証します。

- ハミルトン-ヤコビ-ベルマン最適化推論の過程でHJB方程式を解くことで、生成される映像の顔の質と一貫性がさらに向上します。