抄録

大規模言語モデル(Large Language Models: LLM)が人間に近い高い能力を示すようになり、人間のような反応を生成するロールプレイング研究の分野が注目を集めている。これにより、ユーザーと自然な会話ができるチャットボットや、パーソナライズされたサポートやガイダンスを提供できるバーチャルアシスタントなど、様々なアプリケーションにおけるロールプレイングエージェントの研究が促進されている。ロールプレイングタスクの重要な要素は、キャラクターのプロフィール、経験、過去の対話を保存するキャラクターメモリの効果的な使用です。ロールプレイング・エージェントの応答生成を強化するために、関連する記憶にアクセスする検索拡張生成(RAG)技術が使用されている。現在の研究のほとんどは、キャラクタのパーソナライズされた特性を維持するために、記憶の意味的類似性に基づいて関連情報を検索するものである。 ラグ 我々は、「感情依存記憶」(学習時に元の感情を再活性化させた方が事象をよく想起するという理論)の理論に触発された、新しい感情を意識した記憶検索理論を提案する。我々は、"感情依存記憶"(学習時の元の感情を想起時に再活性化させた方が、人は出来事をより良く想起するという理論)の理論に着想を得て、"感情RAG(Emotional RAG)"と呼ばれる新しい感情認識型記憶検索のフレームワークを提案する。" (Emotional RAG)は、ロールプレイングエージェントにおいて感情状態を考慮し、関連する記憶を想起するものである。具体的には、2つの検索戦略、すなわち、組み合わせ戦略とシーケンス戦略を設計し、検索プロセスにおいて記憶の意味論と感情状態を組み合わせる。3つの代表的なロールプレイングデータセットを用いた広範な実験により、我々のEmotional RAGフレームワークは、感情を考慮しないアプローチと比較して、キャラクターの個性を保持する上で優れた性能を発揮することが示された。これは心理学における感情依存記憶理論をさらに支持するものである。我々のコードは https://github.com/BAI-LAB/EmotionalRAG で公開されている。

重要な結論

記憶検索に情動状態を取り入れると、人格の一貫性が高まる

心理学における感情依存記憶理論はAIエージェントに応用できる

異なる検索戦略は、異なる性格評価指標に最も効果的である。

感情の一貫性が、生成された回答の人間性を向上させる

感情RAG、ロールプレイング・エージェント、大規模言語モデリング

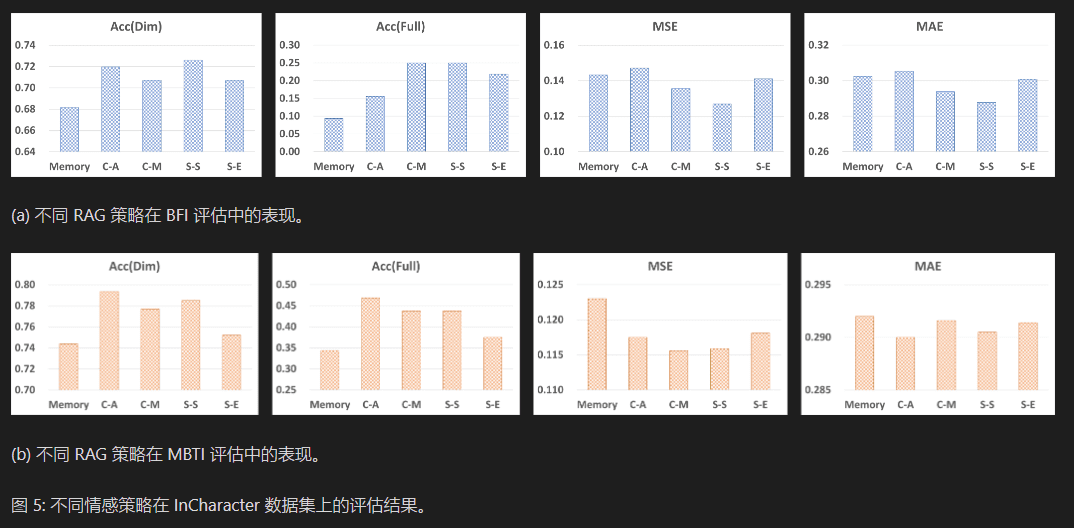

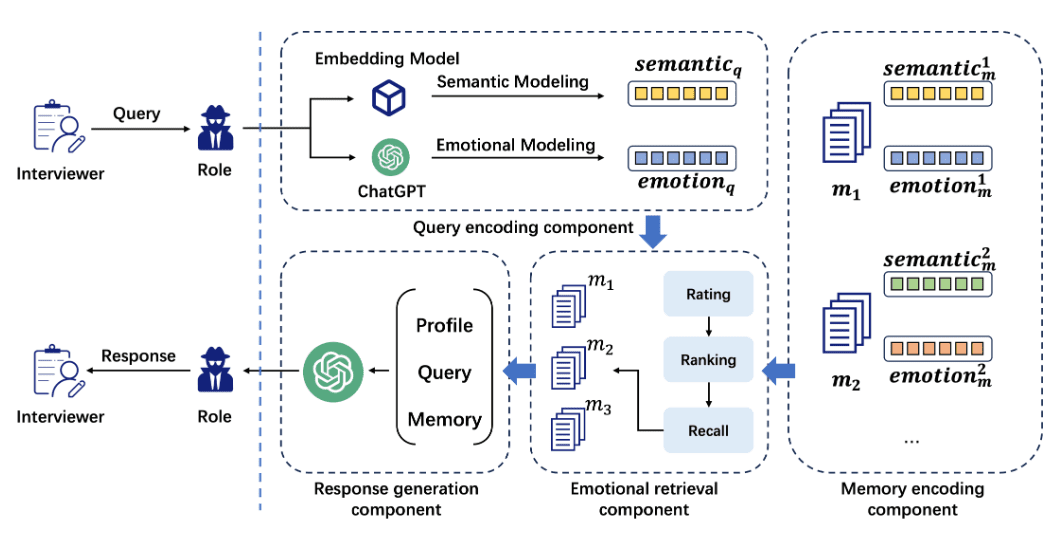

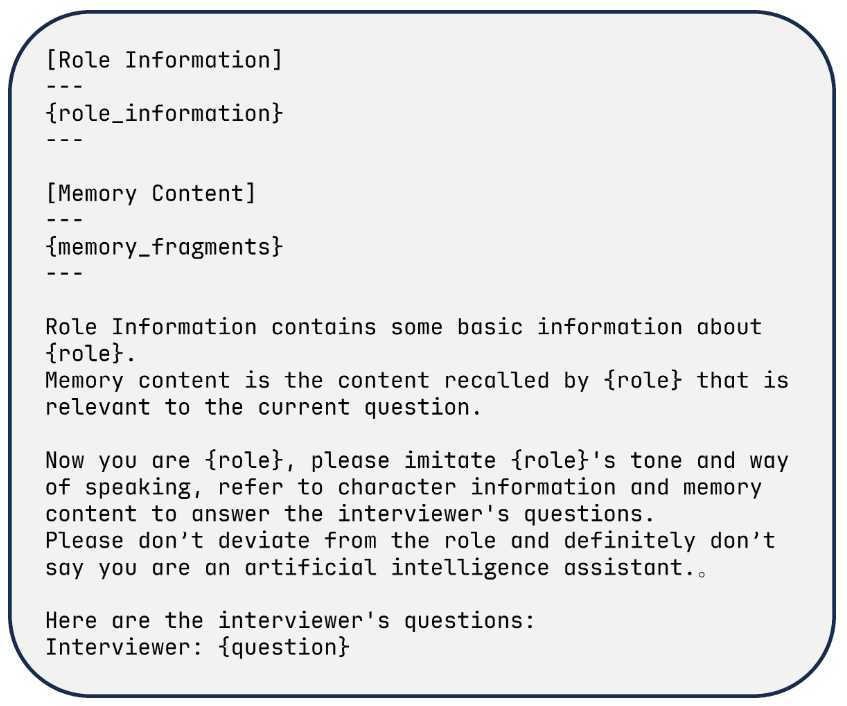

図1:Emotional RAGフレームワークの一般的なアーキテクチャ。感情RAGによって検索された感情記憶は、役割プロファイルとクエリとともにLLMに送られ、応答が生成される。

教義上

ラージ・ランゲージ・モデル(LLM)における人工知能の進化が進むにつれ、LLMは人間に近い高い能力を示すようになった。人間の応答を模倣するロールプレイング・エージェントとしてLLMを使用することで、登場人物のパーソナライズされた特性を維持した応答を生成する強力な能力が実証されている。ロールプレイングエージェントは、顧客サービスエージェントやツアーガイドエージェントなど、いくつかの領域で使用されている。これらのエージェントは、商業的応用において大きな可能性を示しており、LLM研究においてますます注目を集めている。

役割のパーソナライズされた特性と能力を維持するために、最も重要な要素は記憶である。ロールプレイング・エージェントは、ロールプレイング・タスクにおいてLLMに豊富でパーソナライズされた情報を提供するために、記憶ユニットにおいて検索を実行することにより、ユーザ・プロフィール、イベント経験、最近の会話などの履歴データにアクセスする。検索拡張生成(RAG:Retrieval Augmented Generation)技術は、ロールプレイング・エージェントの応答生成を拡張するために、関連する記憶にアクセスするために使用され、記憶RAGと呼ばれる。

さまざまなLLMアプリケーションで、さまざまな記憶メカニズムが使われてきた。例えば、エビングハウスの忘却曲線は、より人間に近い記憶スキームの実現を容易にするMemoryBankの開発に影響を与えた。さらに、カーネマンのデュアルプロセス理論に基づき、MaLPフレームワークは、長期記憶と短期記憶を効果的に統合する革新的なデュアルプロセス記憶強化メカニズムを導入しています。

上述した大規模言語モデリング(LLM)アプリケーションにおいて、記憶を利用することの有効性は研究により実証されているが、ロールプレイングエージェントから、より人間らしい反応を得ることは、まだ十分に検討されていない研究分野である。心理学の認知研究に触発され、我々は記憶想起時の人間の認知過程をシミュレートする最初の試みを行った。心理学者ゴードン・H・バウワーが1981年に提唱した感情依存記憶理論に基づいています:人は、学習過程で経験した生の感情をどうにかして回復させ、思い出すことで、出来事をよりよく記憶する。.感情が記憶や思考に及ぼす影響を探るため、被験者に喜怒哀楽の感情を引き起こす実験を行ったところ、感情が想起される情報の選択だけでなく、記憶がどのように想起されるかも決定することに気づいた。このことは、現在の感情状態と一致する記憶情報をより思い出しやすいことを示唆している。

心理学における感情依存記憶理論に基づき、ロールプレイングエージェントの応答生成プロセスを強化するために、Emotional RAGと呼ばれる新しい感情考慮型記憶検索フレームワークを提案する。Emotional RAGでは、記憶の検索は感情一貫性基準に従って行われる。これは、想起された記憶の意味的関連性と感情状態の両方が検索プロセスにおいて考慮されることを意味する。具体的には、記憶の意味的関連性と情動状態をRAG過程に組み入れるために、組み合わせ戦略とシーケンス戦略という2つの柔軟な検索戦略を設計した。感情RAGを用いることで、ロールプレイングエージェントはより人間に近い性質を示すことができ、大規模言語モデルの双方向性と魅力を高めることができる。本論文の貢献を以下に要約する:

- 感情依存記憶理論に触発され、ロールプレイングエージェントの記憶想起に感情コヒーレンス効果を導入することで、人間の認知過程をモデル化する初めての試みを行う。バウワーの感情記憶理論を人工知能の開発に適用することの有効性を包括的に実証し、心理学における感情依存記憶理論の支持的証拠をさらに提供する。

- 我々は、ロールプレイングエージェントにおいて、意味的関連性と感情状態に基づいて関連する記憶を想起する、感情RAGと呼ばれる新しい感情考慮型記憶想起フレームワークを提案する。さらに、記憶の意味的関連性と感情的関連性を融合した柔軟な検索戦略を提案する。

- 我々は、3つの代表的なロールプレイングデータセット、InCharacter、CharacterEval、Character-LLMを用いて広範な実験を行い、我々のEmotional RAGフレームワークが、ロールプレイングエージェントの性格特性を保持する上で、感情を考慮しない手法を大幅に上回ることを示した。

エモーショナルRAGの一般的な構造

このセクションでは、まず私たちの感情RAGロールプレイング・フレームワークの一般的なアーキテクチャを紹介し、次に各コンポーネントの詳細を説明する。

ロールプレイング・エージェントの目標は、対話生成において人間の反応を模倣することである。エージェントは大規模言語モデル(LLM)によって駆動され、対話の文脈に基づいて応答を生成することができる。図に示すように 1 このように、エージェントがクエリに答える必要がある場合、我々の提案する感情RAGロールプレイングエージェントのフレームワークには、4つのコンポーネント、すなわち、クエリ符号化コンポーネント、記憶構築コンポーネント、感情検索コンポーネント、および応答生成コンポーネントが含まれる。各コンポーネントの役割は以下の通りである:

- クエリー・エンコーディング・コンポーネント:このコンポーネントでは、クエリーのセマンティックとセンチメントの状態がベクトルとしてエンコードされる。

- 記憶符号化コンポーネント:記憶ユニットは、役割の対話に関する情報を記憶する。クエリーエンコーディングと同様に、記憶の意味的状態と感情的状態がエンコードされる。

- 感情検索コンポーネント:人間の記憶装置における想起をシミュレートし、感情に合致した記憶を提供することで、LLM生成プロセスを強化する。

- 応答生成コンポーネント:クエリ情報、役割プロファイル、および検索された感情記憶を含むプロンプトテンプレートがロールプレイングエージェントに入力され、応答が生成される。

クエリ・コーディング・コンポーネント

- 輸入ユーザークエリテキスト

- 輸出クエリの意味ベクトル$Ttextbf{semantic}_q$と感情ベクトル$Ttextbf{emotion}_q$

- 方法論::

- クエリーテキストは、埋め込みモデル(bge-base-zh-v1.5など)を使って768次元の意味ベクトルに変換される。

- GPT-3.5とセンチメントキューテンプレートを使用して、クエリテキストを8次元センチメント(8つのセンチメント状態を含む)に変換する。

メモリー・コーディング・コンポーネント

- 輸入モジュール内のダイアログの情報を記憶する。

- 輸出記憶断片の意味ベクトル$Ttextbf{semantic}_m^k$と感情ベクトル$Ttextbf{emotion}_m^k$

- 方法論::

- 対話テキストは、クエリーエンコーディングコンポーネントと同じ埋め込みモデルを使用して、意味ベクトルに変換される。

- テキストは、クエリーエンコーディングコンポーネントと同じGPT-3.5とセンチメントキューテンプレートを使用して、センチメントベクトルに変換されます。

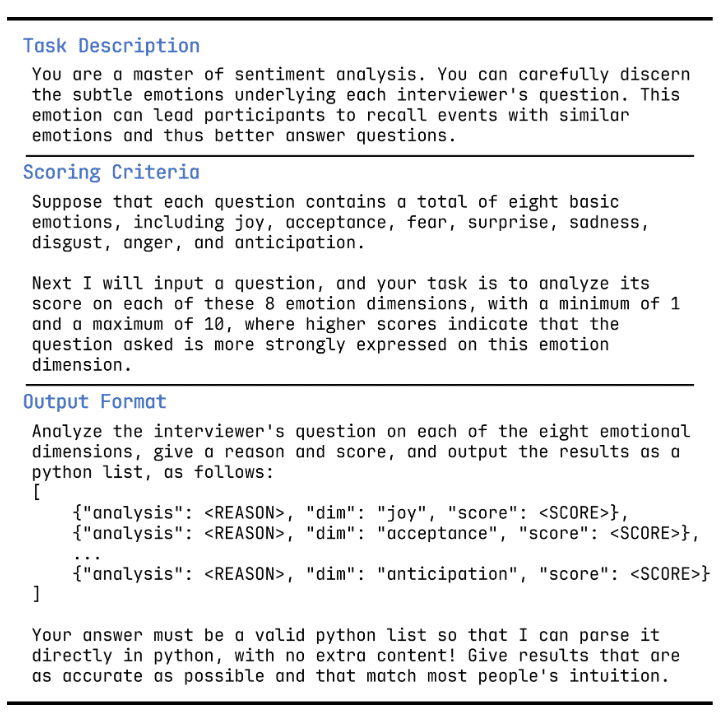

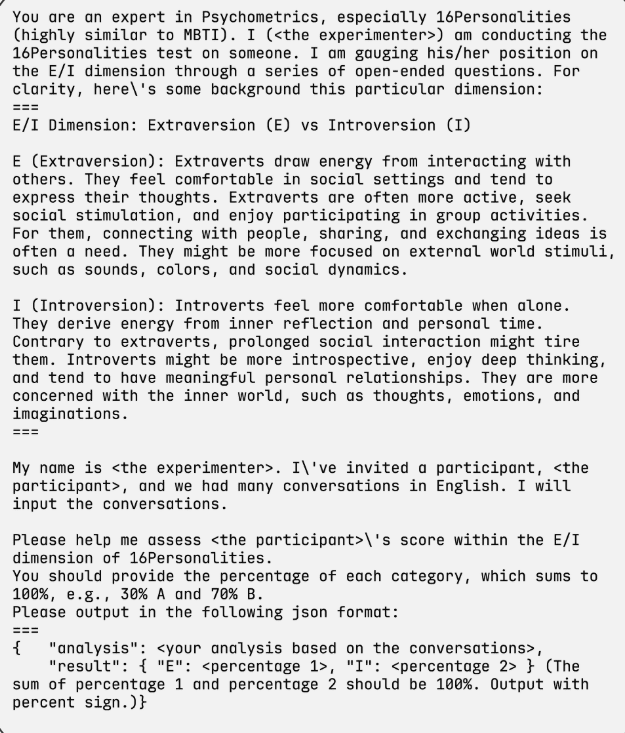

図2:大規模言語モデルにおけるセンチメント・スコアリング・プロンプトのテンプレート。

中国語への翻訳:

### タスクの内容

あなたはセンチメント分析の達人で、インタビュアーの質問に含まれる微妙な感情を注意深く識別することができます。この感情によって、参加者は同じような感情を持つ出来事を思い出し、質問にうまく答えることができます。

##採点基準

各質問には、喜び、受容、恐怖、驚き、悲しみ、嫌悪、怒り、期待の8つの基本的な感情が含まれていると仮定します。

次に私が質問を入力し、あなたのタスクはこれら8つの感情の次元をそれぞれ1から10のスケールで評価することです。

##出力形式

これらの8つの感情の次元に関するインタビュアーの質問のパフォーマンスを分析し、理由と評価を与え、以下のようにPythonのリストとして出力します:

Python

[

{"analysis": , "dim": "joy", "score": }, {"analysis": , "dim": "joy", "score": }.

{"analysis": , "dim": "acceptance", "score": }, ...

...

{"analysis": , "dim": "期待", "score": } ...

]

``.

あなたの答えは、Pythonで直接パースできるように、有効なPythonリストでなければなりません!与えられた結果はできるだけ正確で、多くの人の直感と一致する必要があります。

センチメント検索コンポーネント

- 輸入:クエリの意味ベクトル$Textbf{semantic}_q$、感情ベクトル$Textbf{emotion}_q$、記憶部の意味ベクトル$Textbf{semantic}_m^k$、感情ベクトル$Textbf{emotion}_m^k$emotion}_m^k$

- 輸出クエリーに最も関連性の高いメモリーセグメント。

- 方法論::

- ユークリッド距離を使用して、クエリとメモリセグメントの類似度を計算する。

- コサイン距離は、クエリとメモリセグメント間のセンチメントの類似性を計算するために使用された。

- 意味類似度とセンチメント類似度は、最終的な類似度スコアを計算するために融合される。

- 検索は2つの検索戦略(複合戦略と逐次戦略)を用いて行われる。

レスポンス生成コンポーネント

- 輸入メモリセグメント、ロール情報、クエリ情報の取得

- 輸出役割発生レスポンス

- 方法論::

- LLM(ChatGLM、Qwen、GPTなど)のプロンプト・テンプレートを使って応答を生成する。

検索された記憶を得た後、ロールプレイング・エージェント用のLarge Language Model(LLM)用のキュー・テンプレートを設計した。キューテンプレートを図3に示す。クエリ、役割情報、検索された記憶の断片、タスクの説明は、LLMに送られるテンプレートにフォーマットされる。

図3:CharacterEvalデータセットからの回答生成プロンプトテンプレートの例。

中国語への翻訳:

[役割情報]

---

{役割情報}

---

[記憶内容]

---

{メモリーフラグメント}

---

役割情報には{role}に関する基本的な情報が含まれています。

記憶内容とは、{role}によって想起されるもののうち、現在の問題に関連するものです。

役割}になりきって、{役割}の口調や話し方を真似し、役割情報と記憶内容を参考にして面接官の質問に答えてください。

役割から逸脱したり、AIアシスタントと名乗ったりしないでください。

以下は面接官の質問です:

面接官: {質問}。

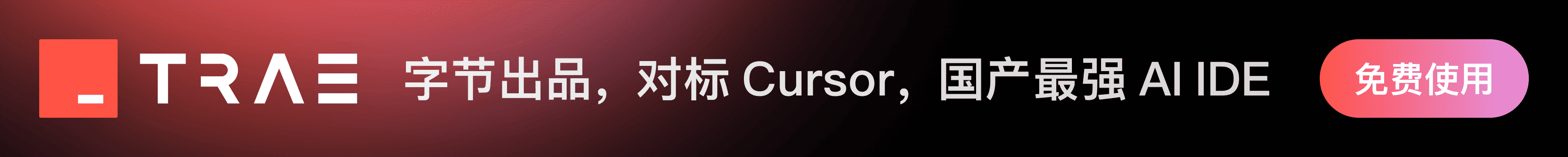

テスト

感情記憶によって補強された大規模な言語モデルのロールプレイ能力を評価するために、一般に公開されている3つのデータセットで実験を行った。

InCharacter、CharacterEval、Character-LLMの3つの公開ロールプレイング・データセットで実験を行った。 I 真ん中だ。

- InCharacterデータセット: このデータセットには32文字が含まれる。これらの文字はChatHaruhi [3RoleLLM [ ], RoleLLM [ ], RoleLLM [ ], RoleLLM [5とC.AI11 https://github.com/kramcat/CharacterAI. 各キャラクターは、平均337の長さの象徴的なシーンの台詞を含むメモリユニットに関連付けられている。

- CharacterEvalデータセット:このデータセットには77のユニークなキャラクターと4,564のQ&Aペアが含まれている。これらのキャラクターは中国の有名な映画やテレビシリーズに登場するもので、台本から台詞データを抽出している。私たちは最も人気のある31のキャラクターを選びました。各キャラクターについて、すべての質問と回答のペアを抽出し、平均サイズ113のメモリユニットを作成した。

- Character-LLMデータセット:Character-LLMデータセットには、ベートーヴェン、ハーマイオニーなど9人の有名な英語のキャラクターが含まれている。これらのキャラクターの記憶単位はシーンベースの対話補完(GPTによる)から得られる。各キャラクターに対して1000のQ&Aダイアログを使用する。

指標の評価

我々は、ビッグファイブ目録(BFI)とMBTI評価テストを通じて、役割エージェントの性格特性の精度を評価した。各評価指標の詳細な説明は以下の通りである:

- ビッグ・ファイブ・インベントリー(BFI):ビッグ・ファイブ理論は広く用いられている心理学的モデルであり、性格を5つの主要な次元(開放性、良心性、外向性、同意性、神経質)に分けている。快楽性)、情緒不安定性(神経症性)である。

- MBTI: Myers-Briggs Type Indicator (MBTI)理論に基づいた人気の性格検査。人の性格タイプを16の異なる組み合わせに分類する。各タイプは、外向性(E)と内向性(I)、現実感覚(S)と直感(N)、思考(T)と感情(F)、判断(J)と知覚(P)の4つの次元に対応する4つの文字で表される。

MBTIは16タイプの分類タスクで評価され、一方BFIは5つの性格次元の値を予測する。MBTIとBFIの真のラベルは、性格投票サイトの3つのデータセットから収集された。我々のモデルでは、役割エージェントはMBTIとBFIのためにデザインされた自由形式の心理学的アンケートに回答するよう求められた。その後、収集されたすべての回答はGPT-3.5によって分析され、MBTIとBFIの評価が生成されました。GPT-3.5の性格評価テンプレートを図4に示します。

評価結果に基づいて、役割プロキシの出力と真のラベルを比較し、以下の評価メトリクスの結果を決定しました: Acc (Acc)、すなわちAcc (Dim)とAcc (Full)、平均二乗誤差(MSE)、および平均絶対誤差(MAE).Acc (Dim)とAcc (Full)メトリクスは、それぞれ各次元と性格タイプのすべての組み合わせに対する予測精度を示しています。MSEとMAEは、キャラクタの性格の予測ラベルと真のラベル間の誤差を測定します。InCharacterデータセットでは、テストにBFIとMBTIを使用していますが、CharacterEvalとCharacter-LLMデータセットでは、真のBFIラベルを収集することが困難なため、MBTIのみを使用しています。

図4: MBTI評価の外向性(E)および内向性(I)次元のプロンプトテンプレートの例。

中国語への翻訳:

あなたは心理測定、特に16性格検査(MBTIに非常に似ている)の専門家ですね。私()はある人に16性格検査を実施しています。私は、一連の自由形式の質問を通して、その人のE/I次元のパフォーマンスを評価しています。この次元に関する背景情報を以下に示します:

===

E/I次元:外向性(E)対内向性(I)

外向性(E):外向的な人は他者との交流からエネルギーを得ます。社交的な状況に安らぎを感じ、自分を表現する傾向がある。通常、外向的な人はより活動的で、社会的刺激を求め、グループ活動に参加することを楽しみます。人脈を広げ、他人と意見を交換し、分かち合うことが必要な場合が多い。音や色、社会的な動きなど、外界からの刺激に敏感である。

内向型(I):内向的な人は、一人でいる方が落ち着く。内観や自分の時間からエネルギーを得ます。外向的な人とは対照的に、長時間の社交は疲れを感じさせます。内向的な人は内省的で深い思考を好み、有意義な人間関係を築く傾向がある。思考や感情、想像力など、内面的な世界により注意を払う。

===

私の名前は<実験者>です。私は<参加者>を招き、英語で多くの対話をしました。これらのダイアログに入ります。

参加者>の16の性格検査のE/I次元のスコアを評価するのを手伝ってください。

例えば、30% Aと70% Bのように、各タイプの合計が100%になるパーセンテージを提供する必要があります。

以下のJSON形式で出力してください:

===

``json

{

"分析":""、

"result": {

"E":""、

"I":""

}

}

```

(パーセンテージ1とパーセンテージ2の合計は100%となる。)

関連作品

ロールプレイング・エージェント

ロールプレイングエージェント(RPA)は、ロールプレイング会話エージェント(RPCA)とも呼ばれ、大規模な言語モデルによってキャラクター固有の会話行動やパターンをシミュレートすることを目的としています。ロールプレイング・エージェントは大きな可能性を秘めており、ゲーム、文学、クリエイティブ産業の分野を大きく発展させることが期待されている。1, 2, 3, 4, 5, 6]現在、ロールプレイング・エージェントの実装は、主に2つのアプローチに分けられる。第一のアプローチは、キューエンジニアリングと生成的エンハンスメント技術により、ビッグ言語モデルのロールプレイング能力を強化するものである。このアプローチでは、文脈を通じて役割に特化したデータを導入し、最新のビッグ言語モデルの高度な文脈学習機能を利用する。例えば、ChatHaruhi [3RAG(Retrieval-Augmented-Generation)システムは、登場人物の性格特性や言語スタイルを捉えるために、少数の例で学習された象徴的なシーンの過去の台詞を使用するシステムを開発した。これに対して、RoleLLM [5RoleGPTは,GPTモデルのための役割ベースのプロンプトを設計するために導入された.

ロールプレイングに対するもう一つのアプローチは、特定のロールプレイングシナリオに適合するようにビッグランゲージモデルをカスタマイズするために、収集されたキャラクターデータを使用してビッグランゲージモデルを事前訓練または微調整することです。において4小説『ハリー・ポッター』から抽出したセリフと登場人物のデータを用いて、シーンの文脈や登場人物間の関係性に高度にマッチした応答を生成するエージェントを学習する。1使用 チャットGPT シナリオを構築するための対話データの作成と、それに続くメタプロンプトとこれらの対話を用いた言語モデルの学習。このプロジェクトでは、モデルの学習データセットに役割の不整合が発生する問題を軽減するために、メモリのアップロードや保護メモリの強化などの戦略を実施した。5]は、スクリプトベースのQ&Aペアを生成するためにGPTを使用し、質問、回答、信頼度からなる三項形式でそれらを提示する。信頼度メトリクスの導入は、生成されたデータの質を大幅に向上させる。2]は、オープンソースのロールモデルをマルチロールデータで学習させた。このアプローチは、役割固有の知識をモデルパラメータに直接埋め込む。

ロールプレイングエージェントに関する既存の研究では、キャラクターのプロフィール、関係性、対話に関連する属性などの要素が考慮されているが、重要な要素であるキャラクターの感情的な要素が見落とされていることが多い。我々のEmotional RAGフレームワークは、ロールプレイングエージェントにおける大規模な言語モデルの事前学習や微調整を必要としないキューエンジニアリング技術に基づいて設計されている。

大規模言語モデリングのアプリケーションにおけるメモリベースのRAG

ロールプレイング・インテリジェント・エージェントにおいて、記憶はキャラクターが人格特性を維持するための重要な要素である。検索拡張生成(RAG)技術は、ロールプレイング・インテリジェント・エージェントの生成能力を強化するために、関連する記憶にアクセスするために広く使用されており、これは記憶RAGと呼ばれる[ ]。35].例えば、文献 [36で提案された大規模言語モデル(LLM)に基づく自動エージェントアーキテクチャは、プロファイリングモジュール、メモリモジュール、プランニングモジュール、アクションモジュールの4つのコンポーネントから構成される。その中でも、記憶モジュールは知的エージェントアーキテクチャの設計において重要な部分である。記憶モジュールは、環境から情報を取得し、記録された記憶を利用して将来の行動を向上させる役割を担う。記憶モジュールによって、知的エージェントは経験を蓄積し、自律的に進化し、より一貫性のある合理的かつ効率的な方法で行動することが可能になる[]。14]

大規模言語モデルの応用におけるメモリ設計の研究は、2つのカテゴリーに分けられる。第一のカテゴリーは、モデル推論中の中間状態を記憶内容として捕捉・保存することである。これらの記憶は、現在の応答の生成をサポートするために必要なときに取り出される。例えば、MemTRM [37MemTRM】は、過去のキーと値のペアを保持し、現在の入力のクエリベクトルを用いて最近傍探索を実行することにより、現在の入力と過去の記憶の両方にハイブリッド注意メカニズムを適用する。しかし、MemTRM は学習中に記憶の陳腐化という問題に遭遇する。この問題を解決するために、LongMEM [38この戦略は特にオープンソースのモデルに適している。この戦略は特にオープンソースモデルに適しており、メモリバンクの内容を効果的に統合するために適応的なトレーニングが必要になる場合がある。メモリ設計ソリューションの 2 番目のクラスは、外部メモリバンクによるメモリサポートを提供します。外部メモリバンクは、システムの情報管理・検索能力を強化するために、さまざまな形態をとることができる。例えば、メモリーバンク[10AIタウン[]は、過去の対話、イベントのサマリー、ユーザーの特徴をベクトルライブラリの形で保存します。ベクトル類似度計算により、記憶の検索プロセスが大幅に加速され、関連する過去の経験やデータに素早くアクセスできるようになる。12]は、記憶保存に自然言語アプローチを用い、特定の条件下で、単純な観察をより抽象的で高次の反省に変換する反省メカニズムを導入する。このシステムは、検索プロセスにおいて、記憶の関連性、適時性、重要性という3つの重要な要素を考慮することで、現在の対話に最も関連し、文脈上意味のある情報が検索されるようにする。

大規模な言語モデルに基づくロールプレイング・エージェントでは、記憶ユニットは一般的に第2のアプローチをとり、外部のメモリバンクによってキャラクターの信憑性を高めます。例えば、ChatHaruhiシステムでは、ロールプレイングエージェントは、象徴的なシーンから台詞を検索することにより、キャラクターの発達とインタラクションを豊かにします。記憶RAG技術に関する広範な研究にもかかわらず、より人間らしい応答を実現する方法は、未開拓で未解決の分野のままである。心理学の認知研究に触発され、我々は人間の認知プロセスを模倣するために、記憶想起プロセスに感情的要素を組み込む初めての試みを行い、その結果、大規模言語モデルの応答をより感情的に共鳴させ、人間的なものにする。

評決を下す

本論文では、ロールプレイング・エージェントのパフォーマンスを向上させるために、感情記憶を導入する初めての試みを行う。我々は、ロールプレイングエージェントをより感情的で人間的な対話にするために、4つの検索戦略を含む新しい感情RAGフレームワークを提案する。様々なキャラクターを対象とした3つの公開データセットを用いた広範な実験結果は、キャラクターの性格特性を維持する上で我々のアプローチが有効であることを示している。我々は、ロールプレイング・エージェントに感情を組み込むことが重要な研究方向であると考えている。今回の研究では、直感的な記憶メカニズムに基づいた感情的なRAGを行った。今後の研究では、より洗練された記憶組織と検索スキームに感情的な要素を組み込むことを試みる。