X-Dyna : Still Portrait Reference Video Pose Generation Video to Make Missy's Photos Dance

Introduction générale

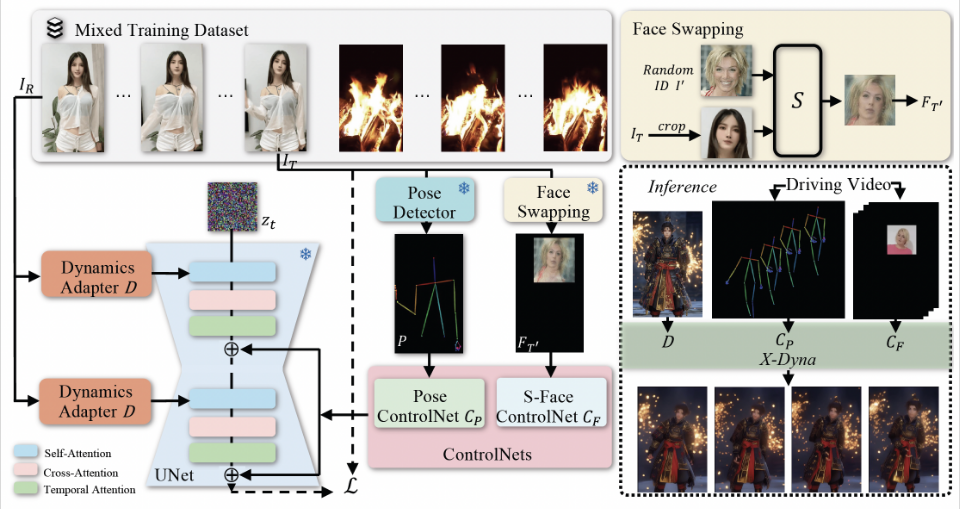

X-Dyna est un projet open source développé par ByteDance pour générer des animations de portraits dynamiques grâce à des techniques de diffusion sans échantillonnage. Le projet utilise les expressions faciales et les mouvements du corps dans la vidéo de conduite pour animer des images de portrait individuelles, générant ainsi des animations réalistes et sensibles au contexte. x-Dyna améliore la vivacité et le détail des animations de portrait vidéo en introduisant un module adaptateur dynamique qui intègre de manière transparente le contexte d'apparence de l'image de référence dans l'attention spatiale du réseau dorsal de diffusion.

Recommandation connexe :StableAnimator : génère des animations vidéo de haute qualité qui conservent les caractéristiques du personnage. ,DisPose : production de vidéos avec contrôle précis de la posture humaine, création de dames dansantes ,Vidéo MOFA : la technologie d'adaptation du champ de mouvement convertit les images fixes en vidéo

Liste des fonctions

- Génération d'animations de portraits dynamiques : générez des animations de portraits dynamiques réalistes en utilisant les expressions faciales et les mouvements du corps dans la vidéo d'entraînement.

- Technique de diffusion sans échantillon : génère des animations de haute qualité sans données de pré-entraînement.

- Module adaptateur dynamique : intégration du contexte de l'image de référence pour améliorer les détails et la vivacité de l'animation.

- Transfert d'expression faciale : capture de l'expression faciale grâce au module de contrôle local pour un transfert d'expression précis.

- Codes d'évaluation : fournir une variété de mesures d'évaluation (par exemple DTFVD, Face-Cos, Face-Det, FID, etc.) pour évaluer la qualité de l'animation.

- Code et modèles open source : un code d'inférence complet et des modèles pré-entraînés sont fournis pour faciliter l'utilisation et le développement secondaire.

Utiliser l'aide

Processus d'installation

- Clonage de l'entrepôt de projets :

git clone https://github.com/bytedance/X-Dyna.git

cd X-Dyna

- Installer la dépendance :

pip install -r requirements.txt

- Installez l'environnement PyTorch 2.0 :

bash env_torch2_install.sh

Utilisation

- Préparer l'image d'entrée et la vidéo d'entraînement :

- Image d'entrée : une seule image de portrait.

- Vidéo d'entraînement : vidéo contenant les expressions faciales et les mouvements du corps de la cible.

- Exécutez le code d'inférence pour générer l'animation :

python inference_xdyna.py --input_image path_to_image --driving_video path_to_video

- Évaluer la qualité de l'animation générée :

- La qualité des animations générées a été évaluée à l'aide du code d'évaluation et de l'ensemble de données fournis.

python evaluate.py --generated_video path_to_generated_video --metrics DTFVD,Face-Cos,Face-Det,FID

Fonction détaillée du déroulement des opérations

- Génération d'animations dynamiques de portraits: :

- Sélectionnez une image de portrait statique comme entrée.

- Sélectionnez une vidéo d'entraînement qui contient les mouvements et les expressions de la cible.

- Exécuter le code d'inférence pour générer une animation dynamique du portrait.

- transfert de l'expression faciale: :

- Capturez les expressions faciales dans les vidéos de conduite à l'aide du module de contrôle local.

- Transférez l'expression capturée vers l'image d'entrée pour une animation précise de l'expression.

- Module adaptateur dynamique: :

- Le module d'adaptation dynamique intègre de manière transparente le contexte d'apparence de l'image de référence dans l'attention spatiale du réseau de diffusion.

- De cette manière, l'animation générée conserve plus de détails et de vivacité.

- Code d'évaluation: :

- Diverses mesures d'évaluation (par exemple, DTFVD, Face-Cos, Face-Det, FID, etc.) sont fournies pour évaluer la qualité des animations générées.

- Les utilisateurs peuvent évaluer pleinement les animations générées sur la base de ces paramètres.

- Code source ouvert et modélisation: :

- Le projet fournit un code d'inférence complet et des modèles pré-entraînés, qui peuvent être facilement utilisés par les utilisateurs pour le développement secondaire et les applications personnalisées.

Questions fréquemment posées.

- L'animation n'est pas fluide: Essayer d'augmenter le nombre d'heures de travail

num_mixou des ajustementsddim_steps. - décalage dans l'expression facialeLe choix d'un produit ou d'un service doit être fait en tenant compte de la nature du produit ou du service en question.

best_framecorrespond à l'image de la vidéo d'entraînement dont l'expression est la plus proche de celle de l'image source.

Utilisation avancée.

- optimiser les performancesLa vitesse de génération peut être améliorée en réduisant le nombre d'étapes d'inférence en utilisant le modèle LCM LoRA.

- Modèles personnalisésSi vous avez des besoins spécifiques, vous pouvez modifier ou étendre le modèle en suivant les instructions du fichier README.

En suivant ces étapes, les utilisateurs peuvent facilement commencer à utiliser X-Dyna pour générer des animations de portraits dynamiques de haute qualité et pour évaluer et optimiser les animations générées.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...