Déploiement sous Windows d'un chatbot intelligent WeChat basé sur DeepSeek-R1

Bonne année ! Je vous salue tous ! Récemment, mon cercle d'amis a été Profondeur de l'eau-R1 Je suis sûr que vous avez tous entendu parler de DeepSeek, notre modèle open source national ! Je pense que vous avez entendu parler de notre modèle domestique open source - DeepSeek. En ligne sur la façon de déployer localement DeepSeek-R1 les tutoriels ont été assez nombreux, aujourd'hui faisons quelque chose de différent, combiné avec des exemples pratiques, main dans la main pour vous amener à jouer autour de DeepSeek-R1, voir à quel point il est vraiment puissant ! La première étape est d'utiliser DeepSeek-R1 pour déployer un nouveau système dans un environnement local !

Ce numéro partage principalement comment utiliser le DeepSeekR1 local pour accéder à WeChat afin de faire un chatbot intelligent WeChat ! Les étapes de mise en œuvre sont divisées en trois grandes parties : déploiement local d'Ollama, accès à WeChat, modification de la configuration.

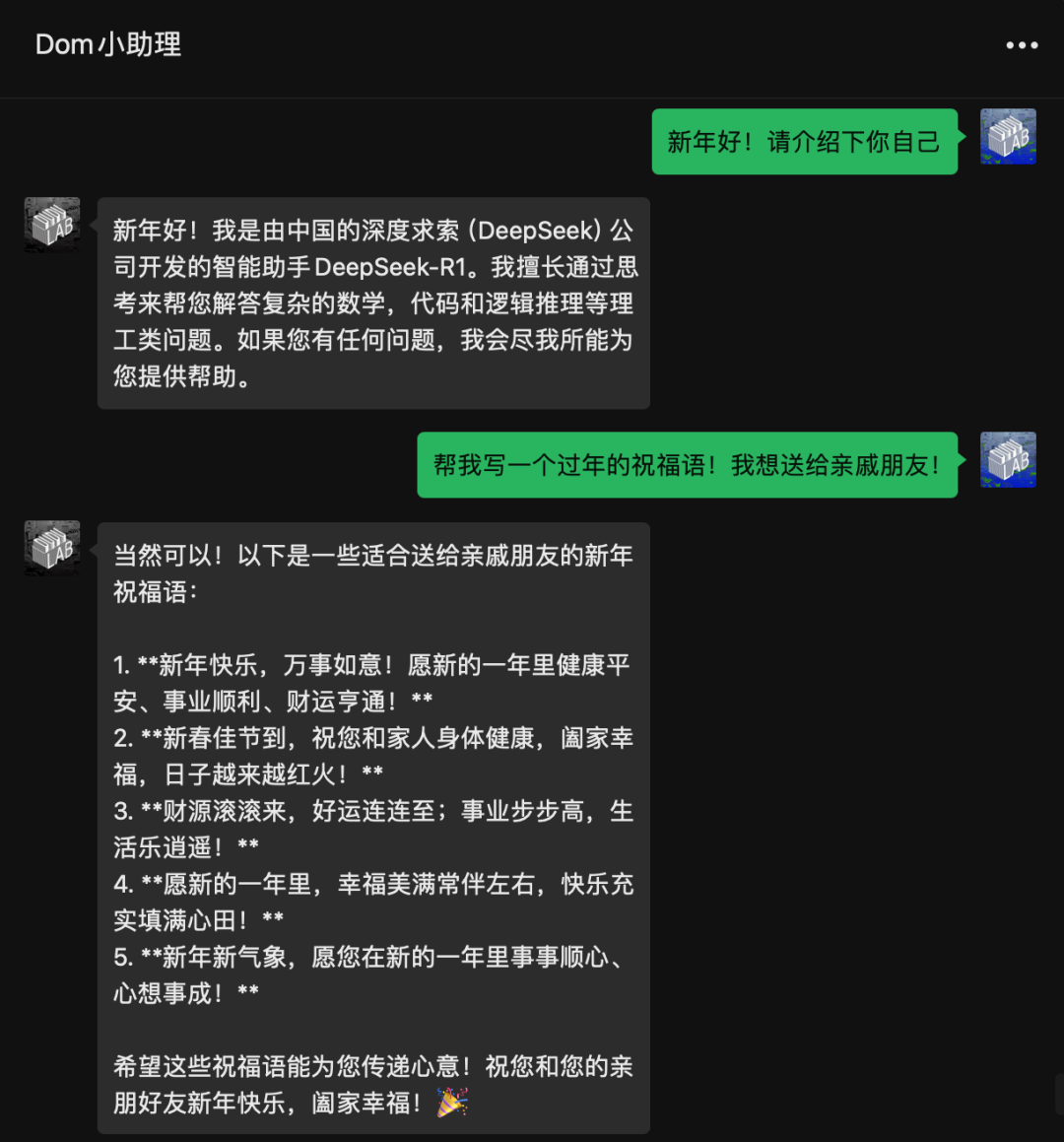

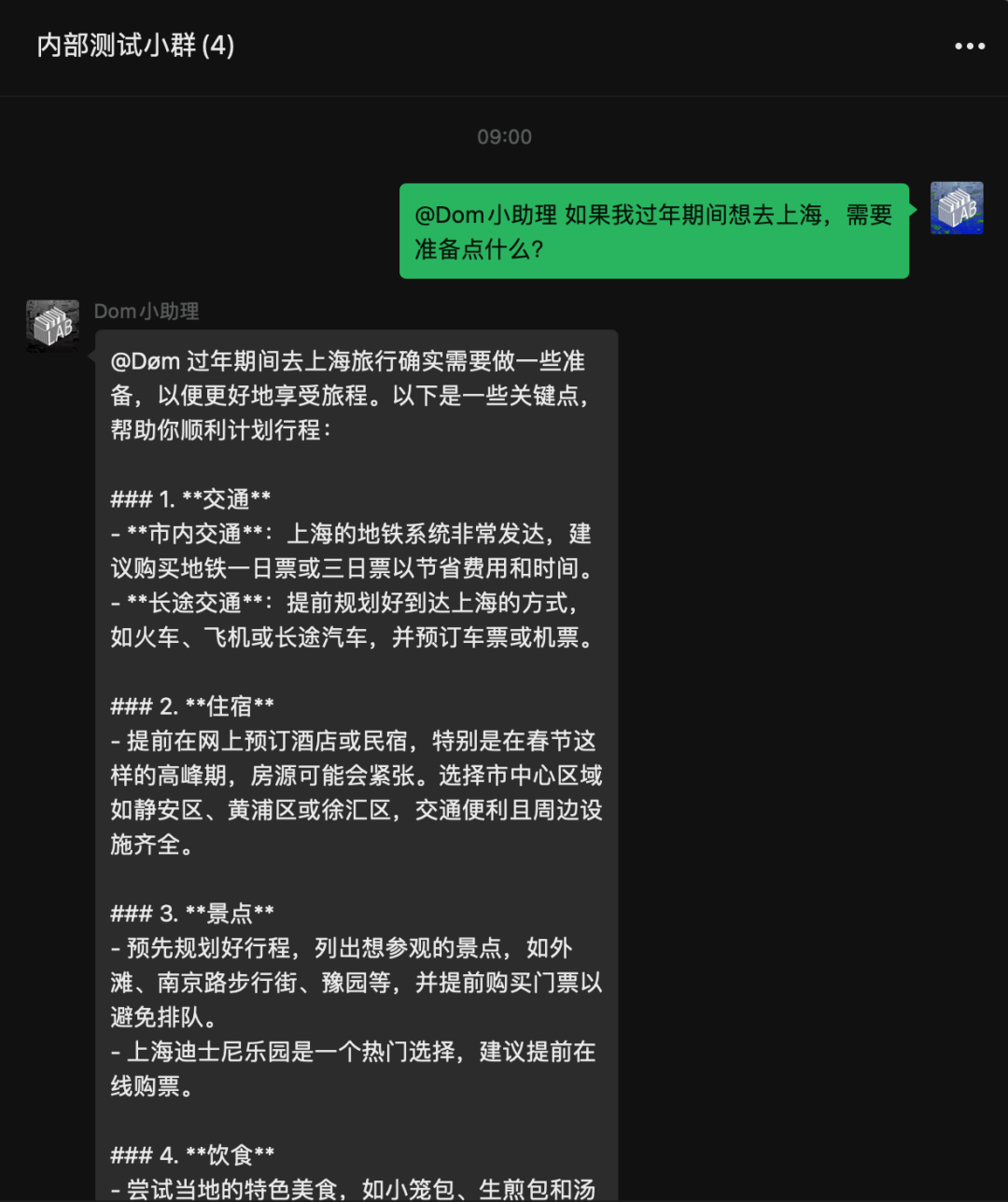

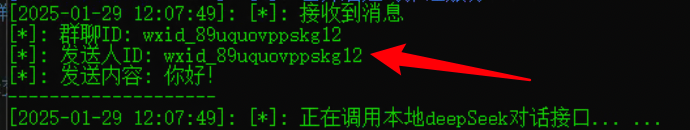

Voici l'effet de l'accès ! Tout est localisé ! Pas besoin d'accéder à l'api de DeepSeek.

L'ensemble du processus n'est pas difficile et prend environ 10 minutes. J'ai encapsulé toute la complexité du travail, de sorte que tout ce que vous avez à faire est de le télécharger, de l'installer et de le faire fonctionner !

Déploiement local de DeepSeek-R1

Tout d'abord, vous devez déployer DeepSeek-R1 localement. Si vous ne pouvez pas installer DeepSeek-R1 localement, veuillez passer à l'étape suivante :Déploiement en ligne du modèle open-source DeepSeek-R1 avec une puissance GPU gratuite

Il convient de noter que les versions 1.5B, 7B, 8B, etc. sont des versions "distillées" de Qwen/llama qui sont améliorées par le raisonnement R1, et non le véritable R1, vous pouvez simplement comprendre qu'il ne s'agit pas d'un R1 pur sang, et que l'expérience est un mélange de Qwen2.5-1.5B ou de llama+R1. La version 671B en volume complet est le vrai R1, bien sûr, notre carte graphique grand public n'est pas capable de prendre la version 671B en volume complet, alors utilisez d'abord la version distillée pour jouer.

Installation d'Ollama

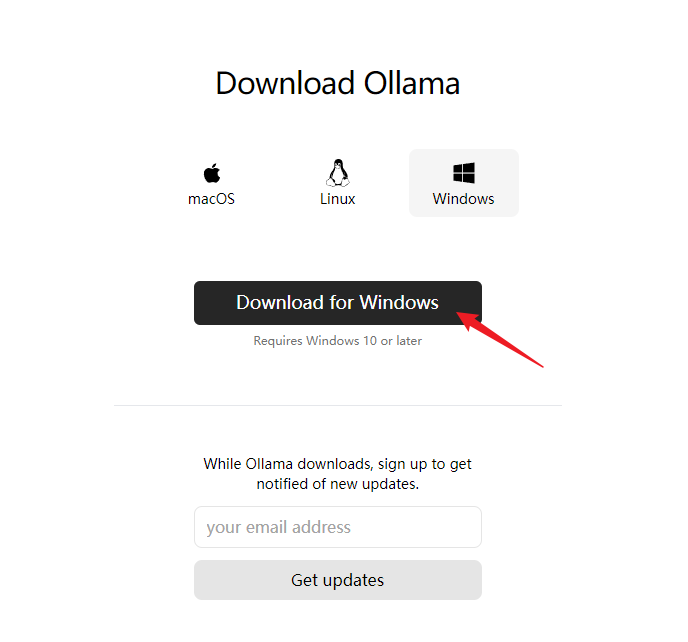

Nous utilisons ici l'outil Ollama, que j'ai placé sur mon disque dur, ou que vous pouvez télécharger sur le site officiel.

site officiel

https://ollama.com/

Télécharger la version Windows (pour l'instant, en raison des limitations de WeChat, l'accès à WeChat ne prend en charge que la plate-forme Windows).

Définition des chemins d'installation et du modèle

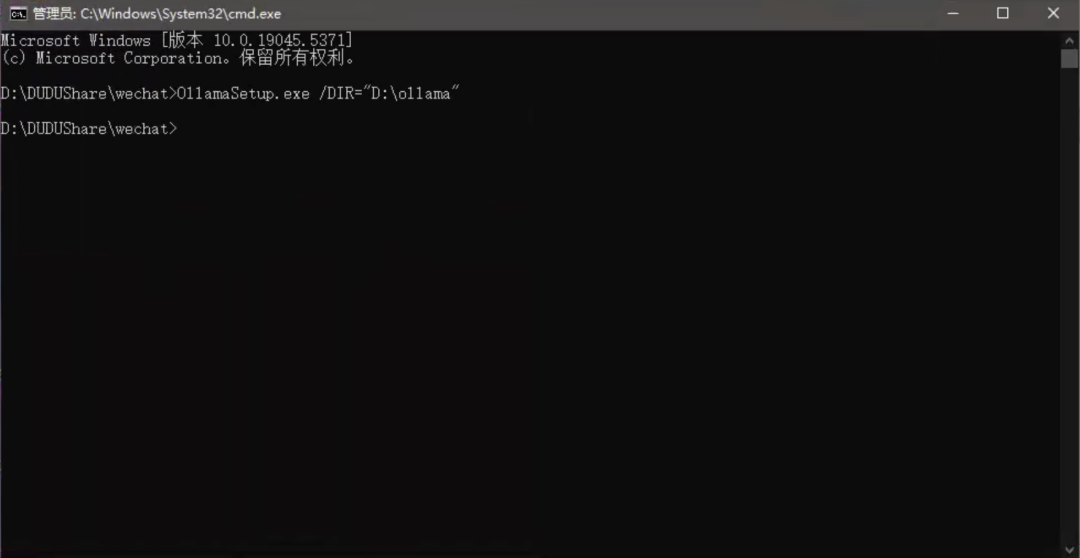

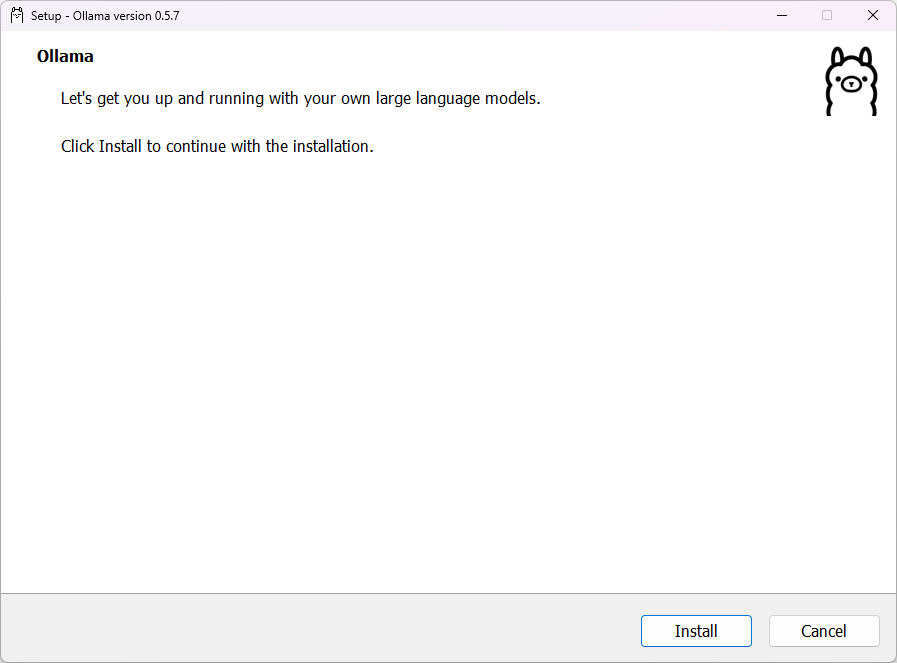

Ouvrez le programme d'installation pour l'installer. Par défaut, il est installé sur le lecteur C. Vous pouvez le faire en tapant dans la ligne de commande plus/DIR=pour spécifier le chemin d'installation.

OllamaSetup.exe /DIR="D:ollama"

Si vous avez déjà installé Ollama sur votre disque C, mais que vous souhaitez changer le répertoire d'installation.

En définissant ce chemin d'accès àOllamaDéplacez le dossier dans le répertoire où vous souhaitez installer le logiciel.

C:Users你的用户名AppDataLocalProgramsOllama

par exemple

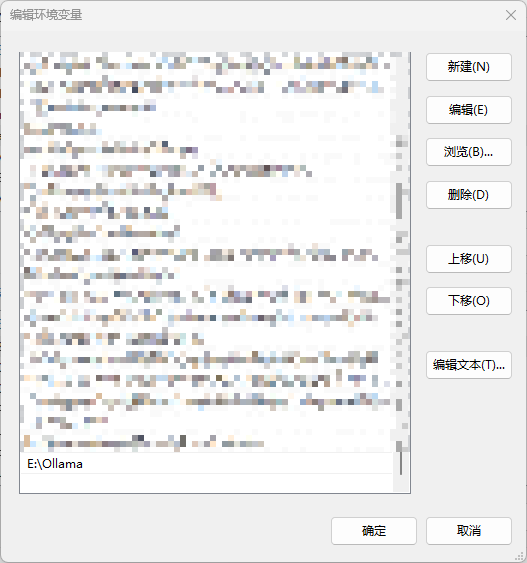

E:Ollama

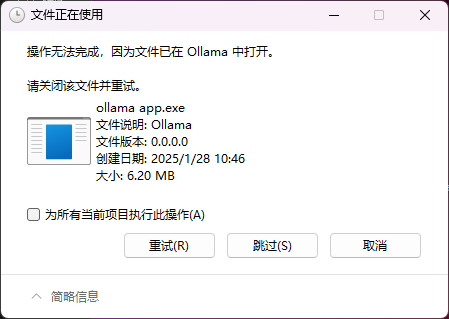

Il se peut que vous rencontriez le problème suivant lors d'un déplacement, ceci est dû au fait qu'après l'installation duOllamaIl est déjà lancé par défaut.

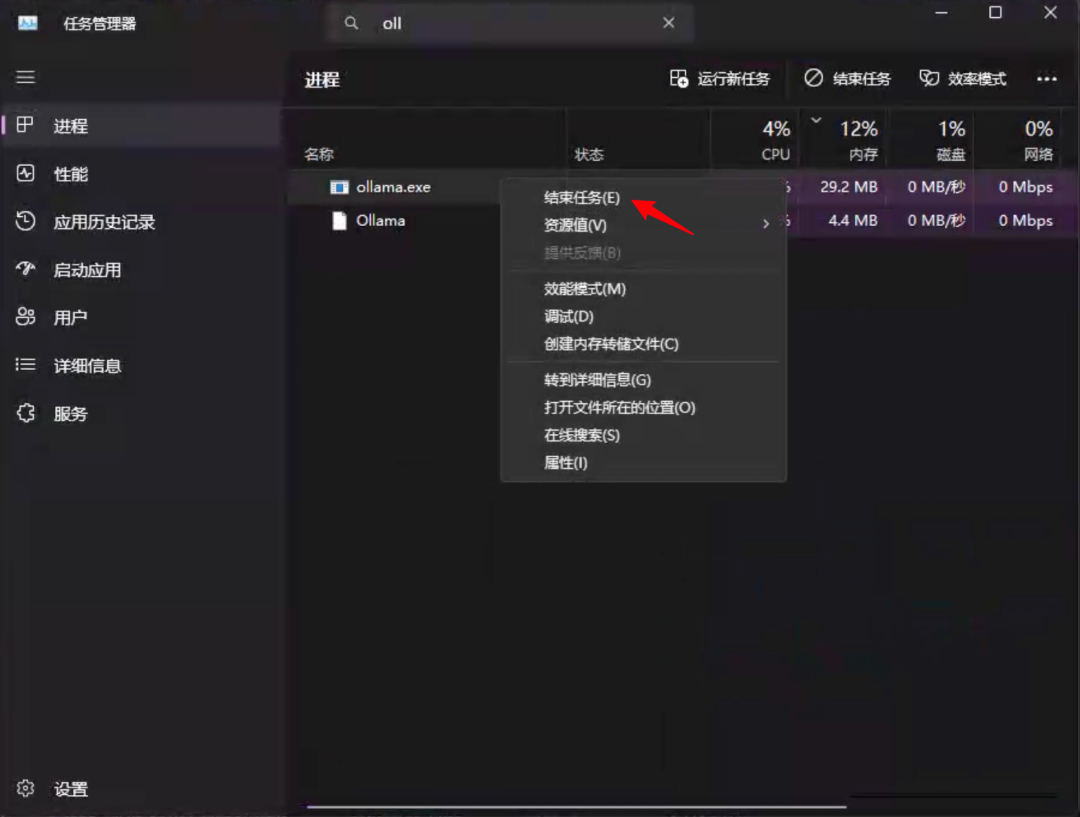

Il doit être trouvé dans le gestionnaire des tâchesOllamarépondre en chantantollama.exePour les deux processus, cliquez avec le bouton droit de la souris sur结束任务. Il doit d'abord être ferméOllamarefermetureollama.exe.

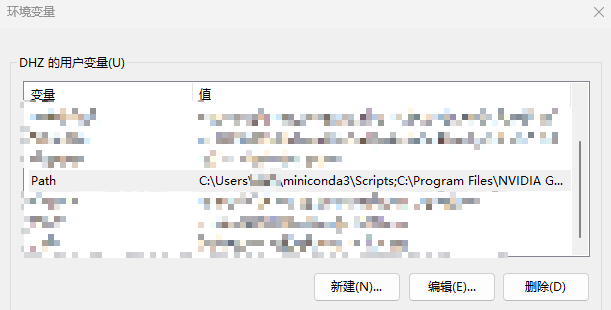

Vous devez ensuite modifier les variables d'environnement

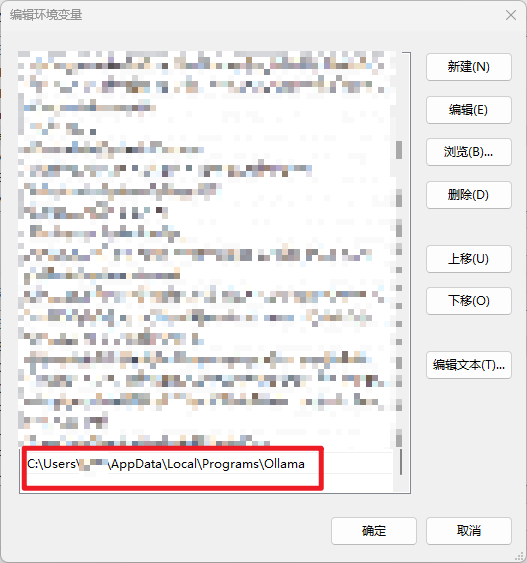

Ouvrez Paramètres - Paramètres système avancés - Variables d'environnement - Chemin de recherche, double-cliquez pour modifier.

Il se trouve sur le lecteur C.Ollamasentiers

Accédez au répertoire que vous avez spécifié

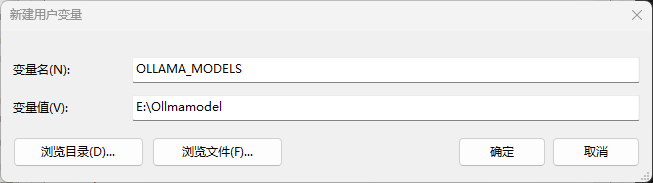

Ajouter une nouvelle variable utilisateurOLLAMA_MODELSIl s'agit de l'emplacement où le modèle téléchargé est stocké. Si vous ne le définissez pas, il se trouve par défaut dans le dossier de l'utilisateur sur le lecteur C.

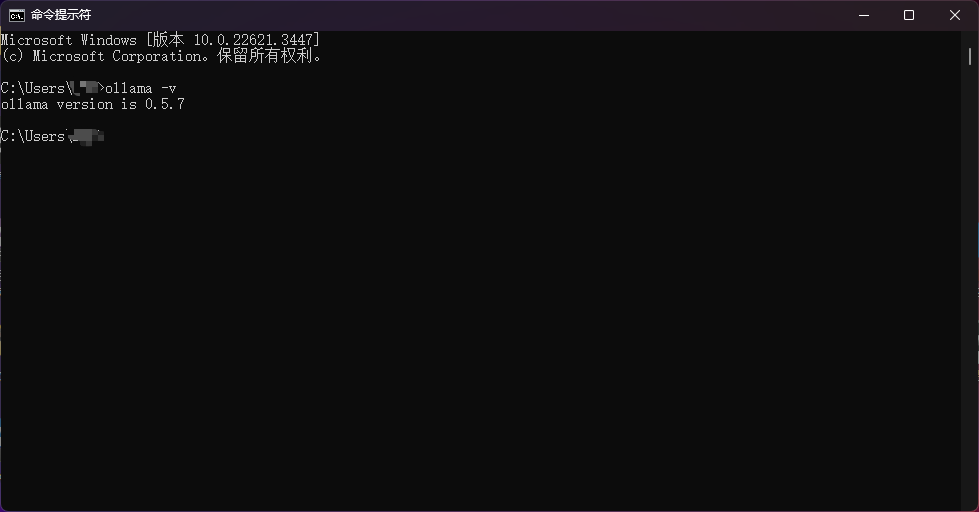

Une fois que tous les éléments ci-dessus sont mis en place, tapez sur la ligne de commandeollama -vVérifier qu'il a fonctionné.

Télécharger les modèles

https://ollama.com/library/deepseek-r1:1.5b

Aller à la page pour voir tous les modèles actuellement disponibles pour la R1

Voici la mémoire vidéo correspondante nécessaire pour faire fonctionner le modèle.

- deepseek-r1:1.5b - 1-2g de mémoire vidéo

- deepseek-r1:7b - 6-8G de mémoire graphique

- deepseek-r1:8b - 8G de mémoire vidéo

- deepseek-r1:14b - 10-12G de mémoire vidéo

- deepseek-r1:32b - 24G-48 mémoire vidéo

- deepseek-r1:70b - Mémoire vidéo 96G-128

- deepseek-r1:671b - nécessite 496GB de mémoire vidéo ou plus !

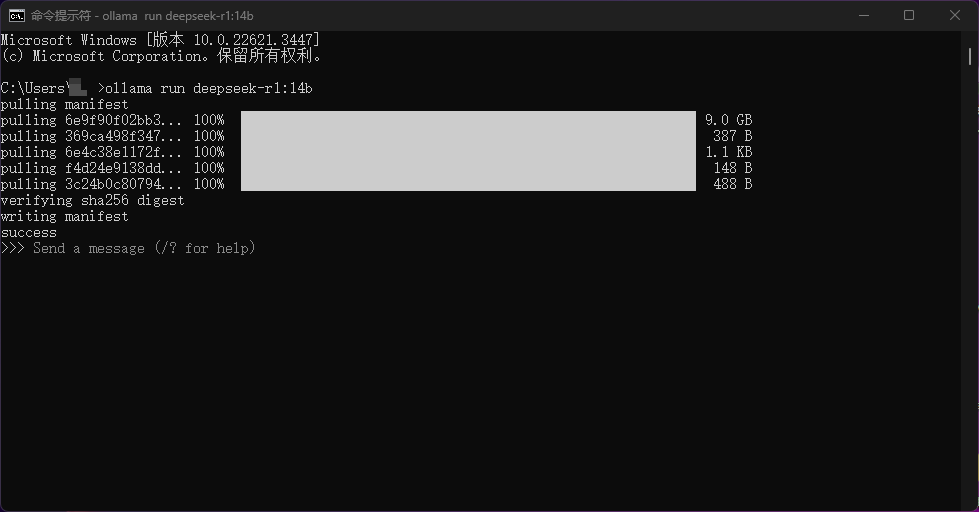

Sélectionnez le modèle correspondant à la configuration de votre ordinateur, collez la commande dans la ligne de commande et exécutez-la, le modèle sera téléchargé automatiquement. Par exemple, ce que j'ai exécuté ici estollama run deepseek-r1:14b

J'ai également préparé un modèle de 1.5B et un modèle de 14B dans le répertoire web, si vous n'avez pas une bonne connexion internet, vous pouvez directement dézipper le modèle dans votre chemin de modèle et l'exécuter, pas besoin de l'utiliser à nouveau !ollamaTélécharger.

Déployer un BOT pour accéder à WeChat

Une fois cette étape franchie, vous vous rapprochez de la réussite ! Les autres étapes sont très simples !

Nous devons utiliser leNGCBotCe projet, qui vise à mettre en place un système d'information local, a pour but de faciliter l'accès à l'information.DeepSeekAccès à WeChat

Adresse du projet :

https://github.com/ngc660sec/NGCBot

Le projet original permet d'accéder à l'api de plateformes telles que Xunfei Starfire, kimi, gpt, deepseek, etc.Mais pour les accès locaux à DeepSeek qui ne sont pas pris en charge, j'ai apporté les modifications suivantes au projet original avec le code source ouvert !Vous êtes les bienvenus pour participer à la maintenance !

- Soutien à la recherche approfondie locale

- Le bouclier pense

- Soutien au dialogue contextuel

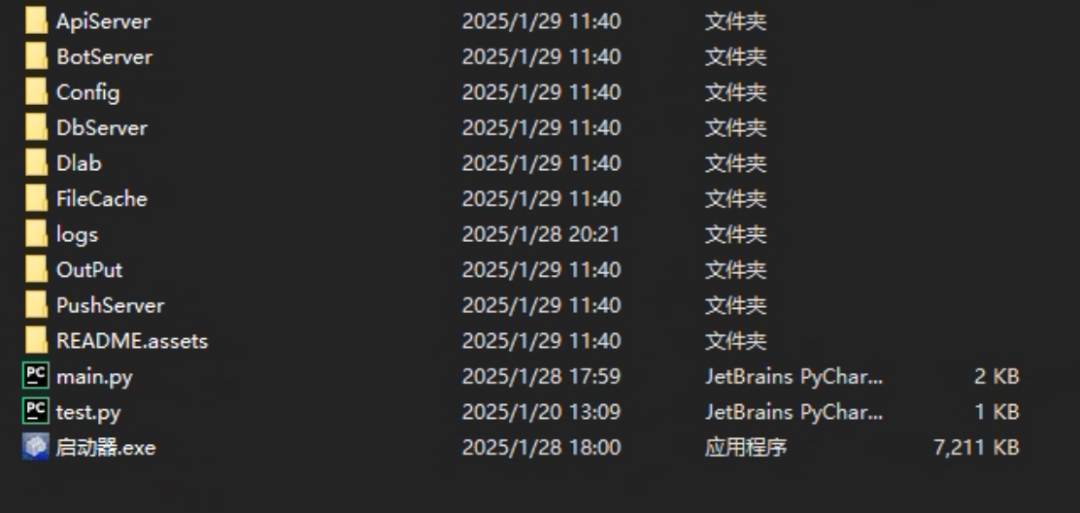

Placez le netbook dans leNGCBot.zipDéballage

Décompressez et double-cliquez sur le lanceur pour ouvrir le projet.

Le projet ouvrira automatiquement votre WeChat, qui vous invitera à le faire :只支持64位微信ou当前微信版本不支持

Cela est dû au fait que la version de WeChat installée sur nos ordinateurs est trop récente.NGCBotUne version spécifique doit être installée.

Installez la version de WeChat que j'ai préparée et ouvrez à nouveau l'applicationNGCBotProjet, glisser pour se connecter à WeChat, c'est fait !

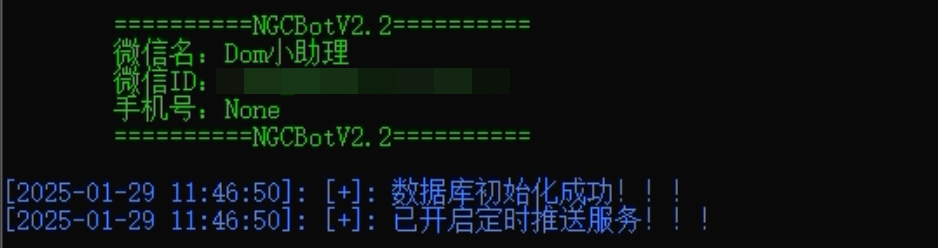

Lorsque le message suivant s'affiche sur l'initiateur, cela prouve que le service a été initialisé avec succès.

À ce stade, nous envoyons un message à la personne connectée à WeChat pour la tester.

C'est fait !

Modifier la configuration du BOT

Non, le robot est fini ! Ne soyez pas si heureux ! Il y a autre chose que tu dois savoir.NGCBotles paramètres de configuration !

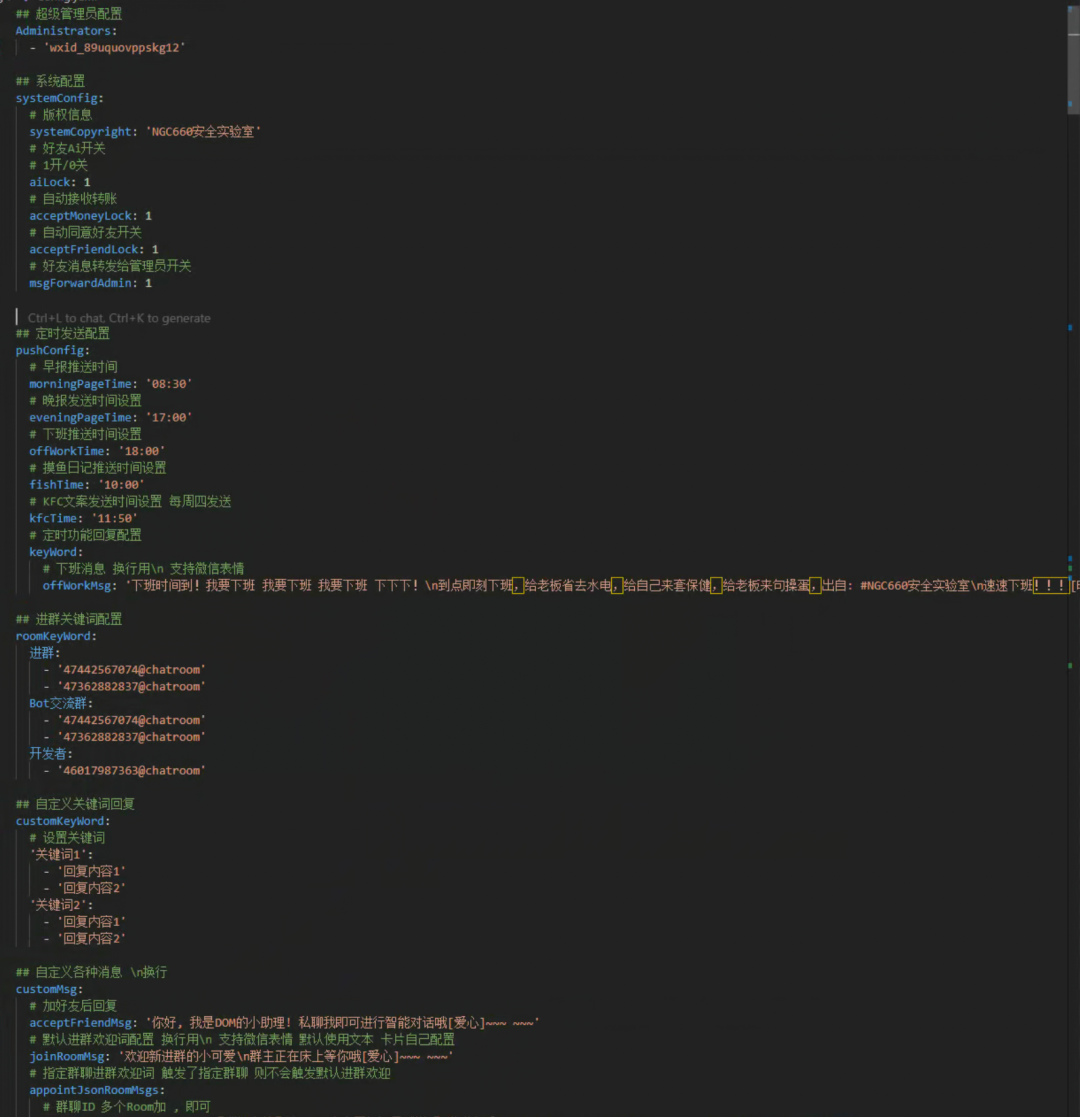

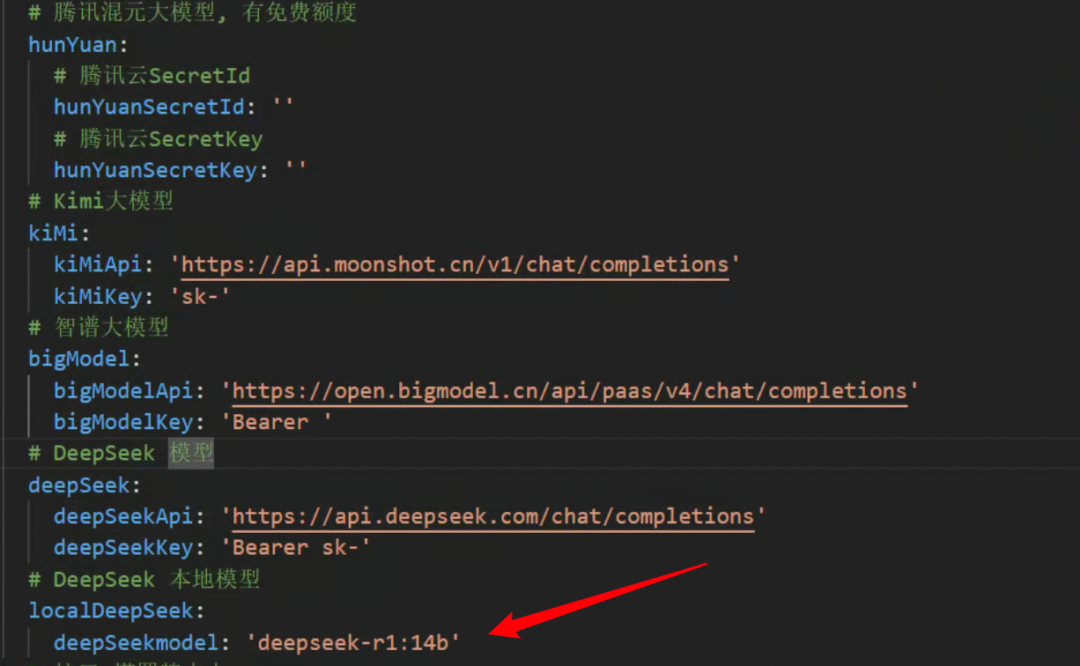

spectacle (un billet)NGCBotdans le répertoire racine du projet.Config/Config.yamlpapiers

Seuls deux paramètres nécessaires sont décrits ici, et vous pouvez consulter les détails officiels pour le reste.

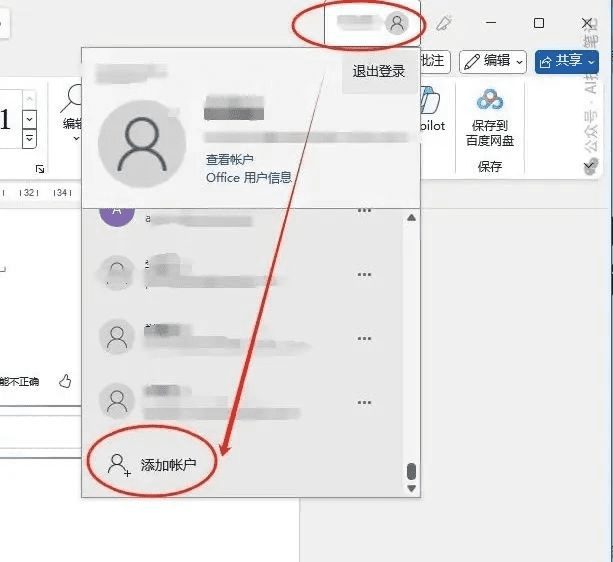

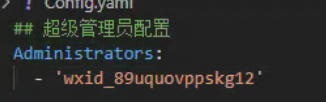

La première est une modification超级管理员配置Pour cela, indiquez l'identifiant de votre autre weibo, le weibo de l'administrateur.

L'identifiant peut être obtenu en copiant tout message envoyé au robot à partir d'un autre micro-signal vers ce micro-signal.

La deuxième solution consiste à modifierlocalDeepSeekinférieurdeepSeekmodelLe nom du modèle dans la base de données

Le modèle que vous avez installé avec ollama est indiqué ici.

Après avoir complété les étapes ci-dessus, alors félicitations, vous avez une version locale de DeepSeek-R1 microsoft chatbot.

questions

- Q : Peut-on accéder au MAC ?

- A : Non.

NGCBotLe projet n'est compatible qu'avec Windows, mais Ollama peut être déployé. - Q : Dois-je être connecté en permanence à WeChat ? Ne puis-je pas l'éteindre ?

- R : Oui, cela équivaut à se connecter à la version Windows de WeChat, le téléphone portable peut discuter normalement, mais il ne peut certainement pas fonctionner normalement après avoir éteint l'ordinateur. Si vous souhaitez que le système fonctionne en continu, il est recommandé de le déployer sur un serveur en nuage.

- Q : S'agit-il de la même chose que la précédente

chatgpt-on-wechatQuelle est la différence ? - R : Les protocoles sont différents, et il y a quelque temps, le microfilm a enveloppé le

chatgpt-on-wechatutilisée, de sorte qu'actuellement cette interface basée sur HookNGCBotLe projet est toujours très stable.

Acquisition d'un pack d'intégration

Version Tootsie Lab :

Quark : https://pan.quark.cn/s/bc26b60912da

Baidu:https://pan.baidu.com/s/1QKFWV1tMti9s4m9K_HAPFg?pwd=428a

écrire à la fin

Il y a un an, j'ai reçu un message privé disantchatgpt-on-wechatCette interface de projet a été bloquée par les responsables de WeChat et était destinée à être combinée avec l'applicationCOZEPartager.NGCBotCe projet, hahaha juste ce qu'il fautDeepSeek-R1Dans tous les domaines ! Et donc . ...COZE, mettons-le en veilleuse pour l'instant ! Bonne année à tous, je pars manger des boulettes .....

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...