ViTLP : Extraction de données structurées à partir de documents PDF typographiquement complexes et génération guidée visuellement de modèles pré-entraînés pour la mise en page de textes

Introduction générale

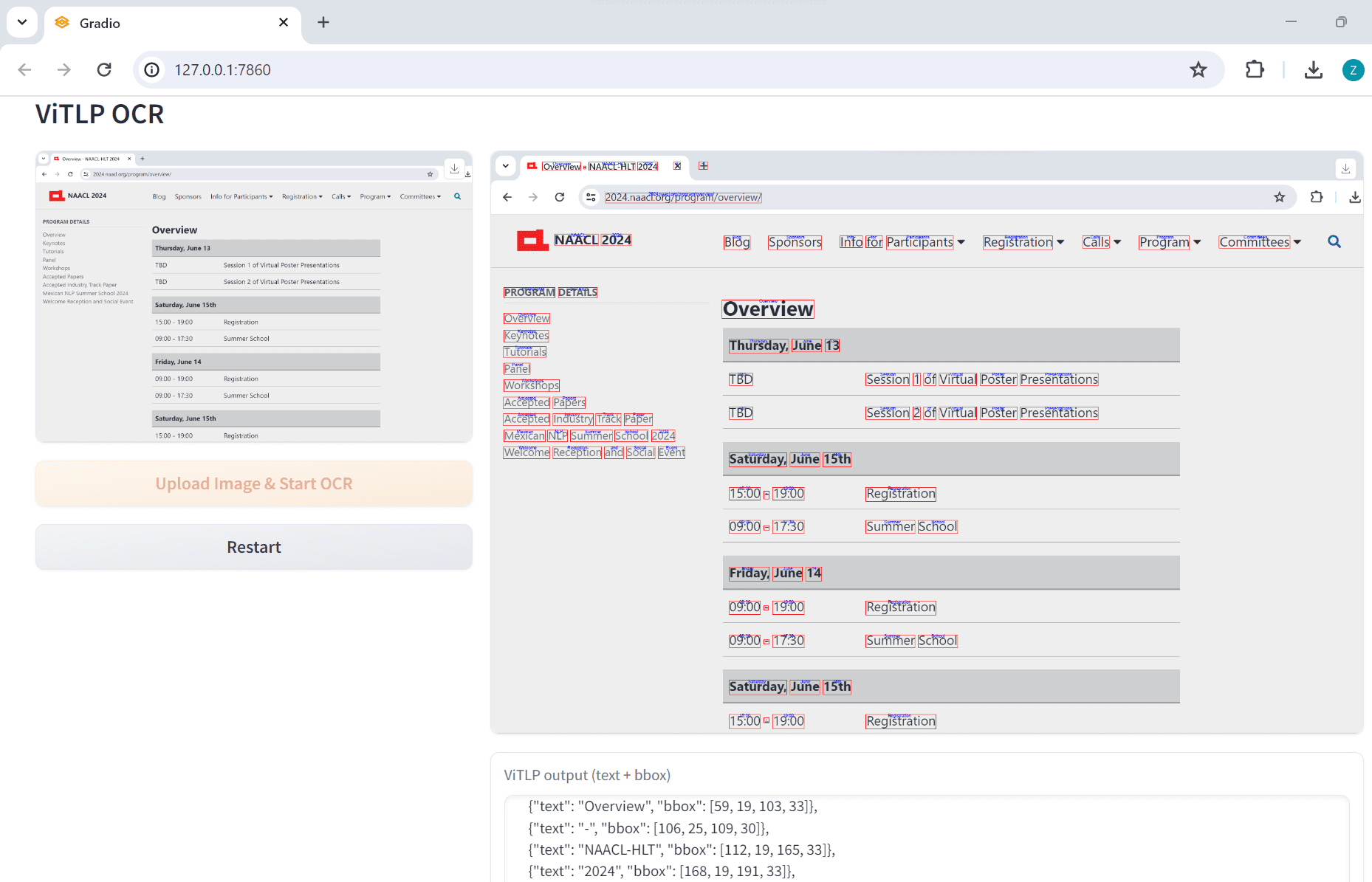

ViTLP (Visually Guided Generative Text-Layout Pre-training for Document Intelligence) est un projet open-source qui vise à améliorer le traitement de l'intelligence documentaire grâce à des modèles de pré-entraînement de disposition de texte génératif guidés visuellement. Le modèle ViTLP, qui est capable de localiser et de reconnaître du texte OCR, fournit des points de contrôle ViTLP-medium (380M) pré-entraînés, auxquels les utilisateurs peuvent accéder sur Huggingface. Le code et les poids du modèle pour le projet sont disponibles sur GitHub et prennent en charge le traitement OCR des images de documents et la génération de la mise en page du texte.

Liste des fonctions

- Localisation et reconnaissance de texte OCRLe modèle ViTLP permet une localisation et une reconnaissance efficaces des textes OCR.

- Modèle de pré-entraînementLes points de contrôle de pré-entraînement ViTLP-medium (380M) sont fournis et peuvent être utilisés directement ou affinés par l'utilisateur.

- Traitement des images de documentsSupport pour le téléchargement d'images de documents et le traitement OCR.

- Modélisation de la mise au pointLes outils de mise au point pour la formation ultérieure sur les ensembles de données OCR et les ensembles de données VQA.

- Outils de composition de documents: Fournit des outils de synthèse de documents avec des métadonnées de boîtes de positionnement.

Utiliser l'aide

Processus d'installation

- Cloner le code du projet ViTLP :

git clone https://github.com/Veason-silverbullet/ViTLP

cd ViTLP

- Installer la dépendance :

pip install -r requirements.txt

- Télécharger les points de contrôle préalables à la formation :

mkdir -p ckpts/ViTLP-medium

git clone https://huggingface.co/veason/ViTLP-medium ckpts/ViTLP-medium

Processus d'utilisation

- Reconnaissance de texte OCR: :

- Exécutez le script OCR :

python ocr.py- Téléchargez l'image d'un document et le modèle effectuera automatiquement le traitement OCR et produira les résultats.

- Modélisation de la mise au point: :

- consultation

./finetuningdans le répertoire pour la formation ultérieure sur l'ensemble de données OCR et l'ensemble de données VQA. - Utilisez l'outil de synthèse de documents pour générer des documents synthétiques avec des métadonnées de boîtes de positionnement afin d'améliorer l'apprentissage du modèle.

- consultation

- Décodage par lots: :

- Utiliser des scripts de décodage par lots :

bash

bash decode.sh - Le script traitera par lots les images de documents et produira les résultats de l'OCR.

- Utiliser des scripts de décodage par lots :

Fonctionnement détaillé

- Localisation et reconnaissance de texte OCRAprès avoir téléchargé l'image du document, le modèle détecte et reconnaît automatiquement la zone de texte et fournit le contenu du texte et les informations relatives à l'emplacement.

- Modélisation de la mise au pointLes utilisateurs peuvent utiliser les outils de mise au point fournis pour perfectionner le modèle en fonction des exigences de leurs ensembles de données et améliorer les résultats de la reconnaissance dans des scénarios spécifiques.

- Outils de composition de documentsLes modèles d'évaluation de la qualité de l'eau : Générer des documents avec des métadonnées de boîtes de positionnement via un outil de synthèse pour aider les modèles à mieux comprendre la disposition et la structure du texte pendant l'entraînement.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...