VideoReTalking : Système de synchronisation labiale et de montage vidéo piloté par le son

Introduction générale

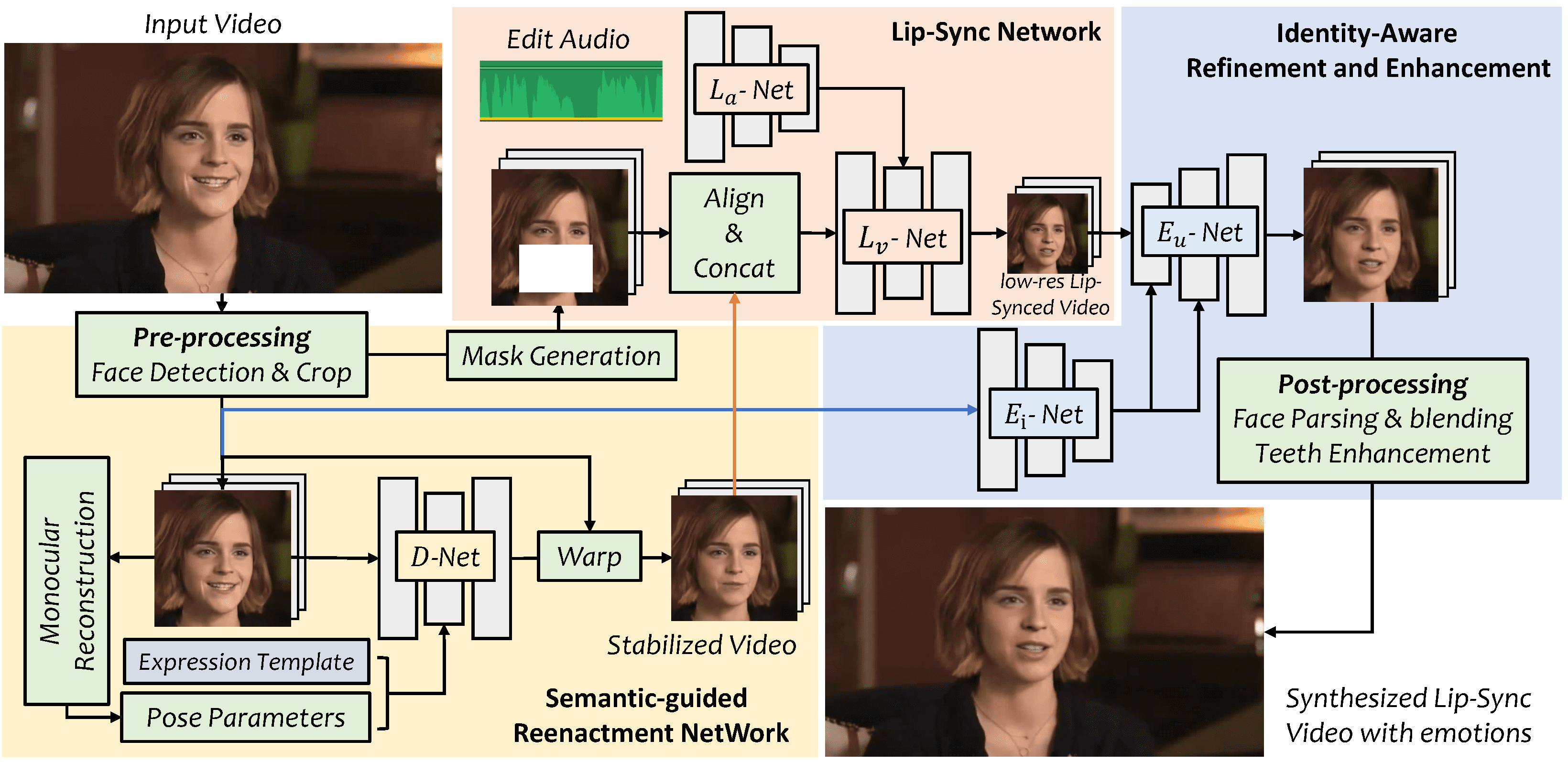

VideoReTalking est un système innovant qui permet aux utilisateurs de générer des vidéos faciales synchronisées avec les lèvres sur la base d'un fichier audio d'entrée, produisant des vidéos de sortie de haute qualité et synchronisées avec les lèvres, même avec des émotions différentes. Le système décompose cet objectif en trois tâches successives : la génération de vidéos faciales avec des expressions typiques, la synchronisation labiale basée sur l'audio et l'amélioration du visage pour améliorer le photoréalisme. Il gère ces trois étapes en utilisant une approche basée sur l'apprentissage qui peut être exécutée de manière séquentielle sans intervention de l'utilisateur. Découvrez VideoReTalking et son application au montage vidéo de têtes parlantes avec synchronisation labiale pilotée par l'audio en cliquant sur le lien fourni.

(manque de clarté, nécessité d'améliorer deux fois la qualité de la vidéo, synchronisation labiale légèrement médiocre en chinois)

Liste des fonctions

Génération de vidéos faciales : génère des vidéos faciales avec des expressions typiques sur la base de l'audio d'entrée.

Synchronisation labiale pilotée par l'audio : génère une vidéo avec synchronisation labiale sur la base de l'audio donné.

Amélioration faciale : amélioration du photoréalisme des visages synthétiques grâce à un réseau d'amélioration faciale tenant compte de l'identité et à un post-traitement.

Utiliser l'aide

Téléchargez le modèle pré-entraîné et placez-le dans `. /checkpoints`.

Lancez `python3 inference.py` pour une inférence rapide de la vidéo.

Les expressions peuvent être contrôlées en ajoutant les arguments `--exp_img` ou `--up_face`.

Adresse de l'expérience en ligne

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...