VideoRAG : un cadre RAG pour comprendre les vidéos ultra-longues avec un support pour la recherche multimodale et la construction de graphes de connaissances.

Introduction générale

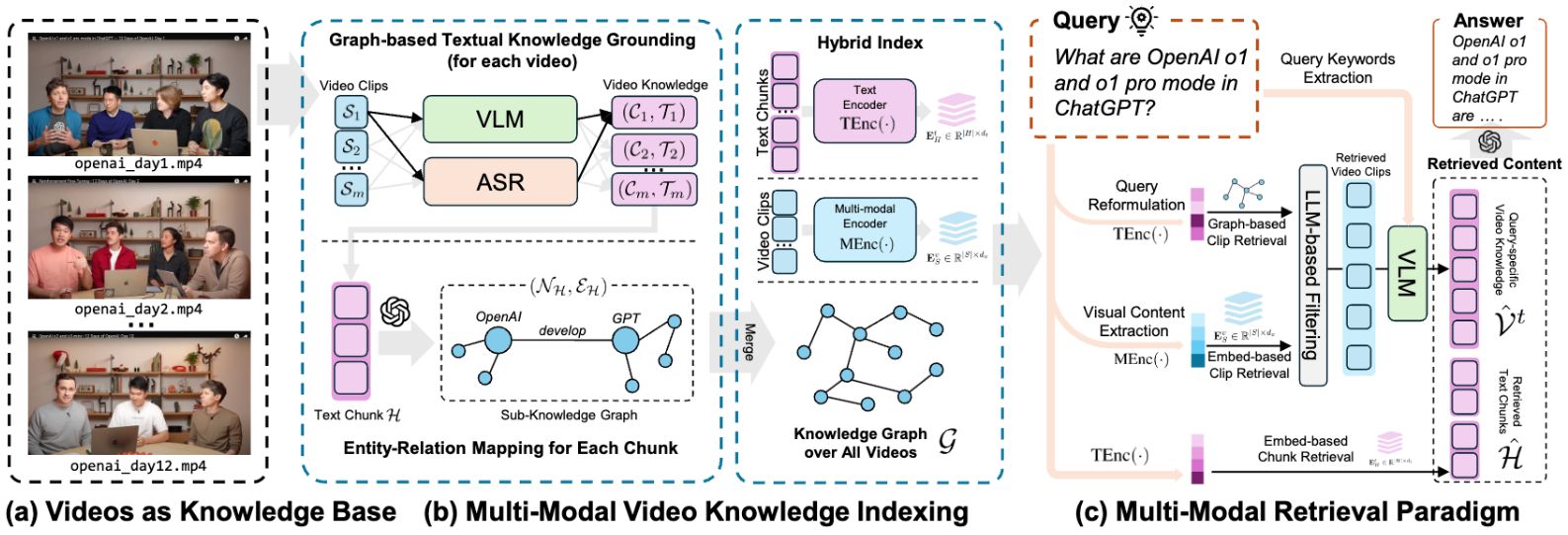

VideoRAG est un cadre génératif amélioré par la recherche d'informations, conçu pour traiter et comprendre de très longues vidéos contextuelles. L'outil associe une base de connaissances textuelles orientée graphe à un encodage contextuel multimodal hiérarchique pour traiter efficacement des centaines d'heures de contenu vidéo sur un seul GPU NVIDIA RTX 3090. VideoRAG maintient la cohérence de la sémantique vidéo et optimise l'efficacité de l'extraction en construisant dynamiquement un graphe de connaissances. Développé par le département de science des données de l'université de Hong Kong, le projet vise à fournir aux utilisateurs un outil puissant pour traiter des données vidéo complexes.

Liste des fonctions

- Traitement efficace des vidéos contextuelles très longuesLa solution NVIDIA RTX 3090 : Traitez des centaines d'heures de contenu vidéo avec un seul GPU NVIDIA RTX 3090.

- Index des connaissances vidéo structuréesLes vidéos : Distiller des centaines d'heures de contenu vidéo dans un graphe de connaissances concis.

- recherche multimodaleLe système d'information sur les vidéos : combine la sémantique textuelle et le contenu visuel pour identifier les vidéos les plus pertinentes afin de fournir une réponse complète.

- Référence LongerVideos nouvellement crééeLe site contient plus de 160 vidéos, soit 134 heures de cours, de documentaires et de divertissements.

- architecture à double canalLa cohérence sémantique : Combinaison d'une base de connaissances textuelles pilotée par un graphe et d'un encodage multimodal hiérarchique du contexte pour maintenir la cohérence sémantique d'une vidéo à l'autre.

Utiliser l'aide

Processus d'installation

- Créer et activer l'environnement conda :

conda create --name videorag python=3.11

conda activate videorag

- Installez les paquets Python nécessaires :

pip install numpy==1.26.4 torch==2.1.2 torchvision==0.16.2 torchaudio==2.1.2

pip install accelerate==0.30.1 bitsandbytes==0.43.1 moviepy==1.0.3

pip install git+https://github.com/facebookresearch/pytorchvideo.git@28fe037d212663c6a24f373b94cc5d478c8c1a1d

pip install timm==0.6.7 ftfy regex einops fvcore eva-decord==0.6.1 iopath matplotlib types-regex cartopy

pip install ctranslate2==4.4.0 faster_whisper neo4j hnswlib xxhash nano-vectordb

pip install transformers==4.37.1 tiktoken openai tenacity

- Installer ImageBind :

cd ImageBind

pip install .

- Téléchargez les fichiers de points de contrôle nécessaires :

git clone https://huggingface.co/openbmb/MiniCPM-V-2_6-int4

git clone https://huggingface.co/Systran/faster-distil-whisper-large-v3

mkdir .checkpoints

cd .checkpoints

wget https://dl.fbaipublicfiles.com/imagebind/imagebind_huge.pth

cd ..

Processus d'utilisation

- Extraction de connaissances vidéoVideoRAG : Plusieurs vidéos sont introduites dans VideoRAG et le système extrait et construit automatiquement un graphe de connaissances.

- Réponse à la demande de renseignementsLes utilisateurs peuvent saisir une requête et VideoRAG fournira une réponse complète basée sur le graphe de connaissances construit et le mécanisme de recherche multimodale.

- Prise en charge multilingueActuellement VideoRAG n'a été testé que dans un environnement anglais, si vous devez traiter des vidéos multilingues, il est recommandé de modifier le WhisperModel dans asr.py.

Principales fonctions

- Téléchargement de vidéosLes fichiers vidéo peuvent être téléchargés dans le système, qui les traitera automatiquement et en extraira les connaissances.

- Demande de renseignementsLe système fournit une réponse détaillée basée sur le graphe de connaissances et le mécanisme de recherche multimodale.

- Vitrine des résultatsLe système affiche des clips vidéo pertinents et des réponses textuelles sur lesquelles les utilisateurs peuvent cliquer pour obtenir des détails.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...