UltraLight Digital Human : humain numérique ultra-léger open source fonctionnant en temps réel avec un paquet d'installation en un clic.

Introduction générale

Ultralight Digital Human est un projet open source visant à développer un modèle humain numérique ultra-léger pouvant fonctionner en temps réel sur des appareils mobiles. Le projet permet un fonctionnement fluide sur les appareils mobiles en optimisant les algorithmes et les structures des modèles pour une variété de scénarios tels que les applications sociales, les jeux et la réalité virtuelle. Les utilisateurs peuvent facilement former et déployer leurs propres modèles humains numériques pour profiter d'expériences personnalisées et immersives.

En ce qui concerne le fait qu'il fonctionne bien sur mobile, il suffit de réduire un peu le nombre de canaux de ce modèle actuel et d'utiliser wenet pour les fonctions audio et tout ira bien.

Liste des fonctions

- fonctionnement en temps réelLes modèles peuvent fonctionner en temps réel sur les appareils mobiles et sont réactifs.

- Conception légèreLa structure de modèle optimisée pour les appareils mobiles à ressources limitées.

- projet open sourceLe code et le modèle sont entièrement libres et peuvent être librement modifiés et utilisés par les utilisateurs.

- application multi-scénariosLes applications sociales, les jeux, la réalité virtuelle et bien d'autres encore.

- Extraction de caractéristiques audioIl prend en charge les schémas d'extraction des caractéristiques audio de wenet et hubert.

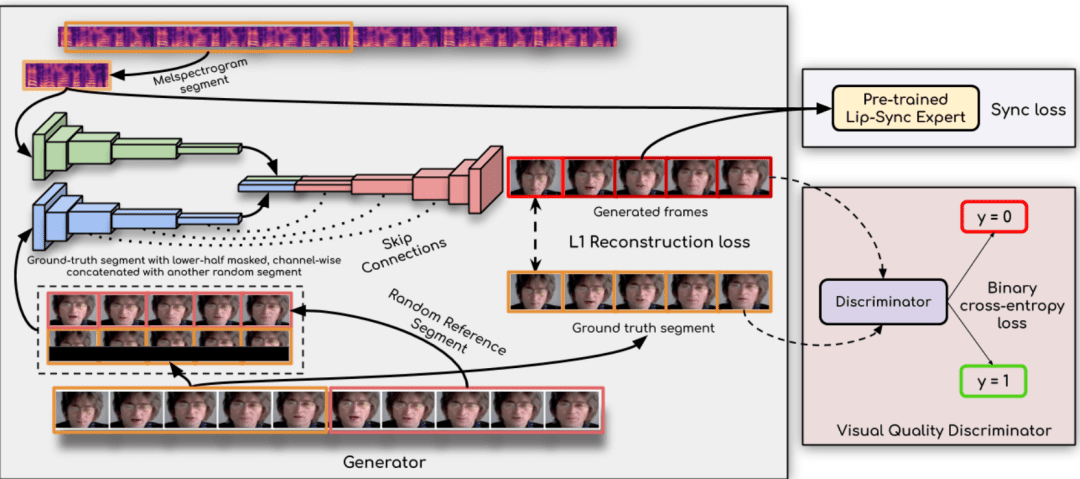

- réseau synchroneSynchronisation labiale améliorée grâce à la technologie syncnet.

- Tutoriel détailléLes utilisateurs ont accès à une formation détaillée et à des tutoriels d'utilisation pour les aider à démarrer rapidement.

Utiliser l'aide

Processus d'installation

- Préparation de l'environnement: :

- Installez Python 3.10 et plus.

- Installer PyTorch 1.13.1 et les autres dépendances :

conda create -n dh python=3.10 conda activate dh conda install pytorch==1.13.1 torchvision==0.14.1 torchaudio==0.13.1 pytorch-cuda=11.7 -c pytorch -c nvidia conda install mkl=2024.0 pip install opencv-python transformers numpy==1.23.5 soundfile librosa onnxruntime

- Télécharger les fichiers modèles: :

- Téléchargez le fichier wenet encoder.onnx à partir du lien suivant et placez-le dans le répertoire

data_utils/Catalogue : lien de téléchargement

- Téléchargez le fichier wenet encoder.onnx à partir du lien suivant et placez-le dans le répertoire

Processus d'utilisation

- Préparer la vidéo: :

- Préparez une vidéo de 3 à 5 minutes, en veillant à ce que chaque image présente une exposition complète du visage et que le son soit clair et sans bruit.

- Placez la vidéo dans un nouveau dossier.

- Extraction des caractéristiques audio: :

- Utilisez les commandes suivantes pour extraire les caractéristiques audio :

cd data_utils python process.py YOUR_VIDEO_PATH --asr hubert

- Utilisez les commandes suivantes pour extraire les caractéristiques audio :

- Modèles de formation: :

- Entraînez le modèle syncnet pour obtenir de meilleurs résultats :

cd .. python syncnet.py --save_dir ./syncnet_ckpt/ --dataset_dir ./data_dir/ --asr hubert - Former le modèle humain numérique en utilisant le point de contrôle de la perte la plus faible :

python train.py --dataset_dir ./data_dir/ --save_dir ./checkpoint/ --asr hubert --use_syncnet --syncnet_checkpoint syncnet_ckpt

- Entraînez le modèle syncnet pour obtenir de meilleurs résultats :

- déduction: :

- Extraction de caractéristiques audio de test :

python extract_test_audio.py YOUR_TEST_AUDIO_PATH --asr hubert - Raisonnement en cours d'exécution :

python inference.py --dataset ./data_dir/ --audio_feat ./your_test_audio_hu.npy --save_path ./output.mp4 --checkpoint ./checkpoint/best_model.pth

- Extraction de caractéristiques audio de test :

mise en garde

- Veillez à ce que la fréquence d'images vidéo corresponde au schéma d'extraction des caractéristiques audio choisi : 20 images par seconde pour wenet et 25 images par seconde pour hubert.

- Au cours du processus de formation et d'inférence, la valeur de perte du modèle est régulièrement contrôlée et le point de contrôle optimal est sélectionné pour la formation.

Pack d'intégration Monkey One Click

https://pan.baidu.com/s/19DcRlR0kJVg4bLb7snUrBQ?pwd=tct1

Pour votre commodité, j'ai consolidé et encapsulé le processus ci-dessus (Inclut les poids des modèles et les cas de test) :

Il suffit de s'amuser :

étape 0 : installer les dépendances :

conda create -n udh python=3.10 conda activate udh pip install -r requirements.txt

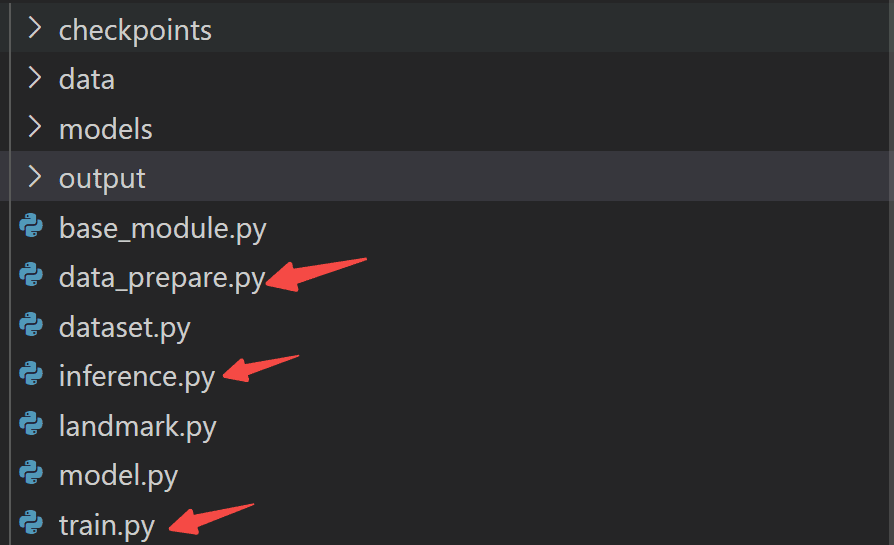

étape 1 : préparation des données :

python data_prepare.py

ÉTAPE 2 : Formation par le modèle :

python train.py

ÉTAPE 3 : Modélisation du raisonnement :

python inference.py

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...