StableAnimator : génère des animations vidéo de haute qualité qui conservent les caractéristiques du personnage.

Introduction générale

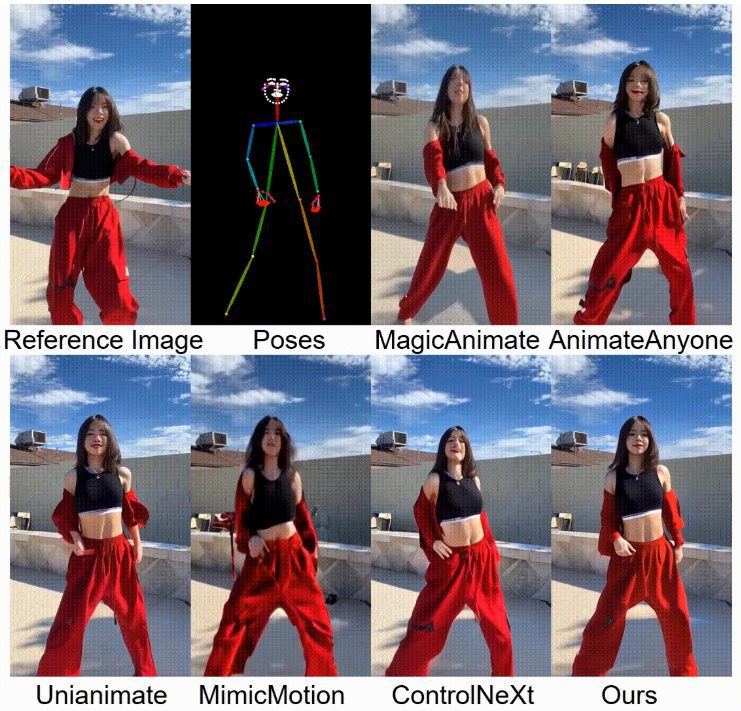

StableAnimator est un cadre innovant de diffusion vidéo de bout en bout préservant l'identité et capable de synthétiser une vidéo de haute qualité sur la base d'une image de référence et d'une série de poses sans aucun post-traitement. Développé en collaboration avec des chercheurs de l'université de Fudan, de Microsoft Research Asia, de Huya Inc et de l'université de Carnegie Mellon, StableAnimator garantit la cohérence de l'identité vidéo. la cohérence de l'identité vidéo. Le cadre a obtenu de bons résultats dans de nombreux tests de référence et génère des animations de portrait très fidèles et préservant l'identité.

Liste des fonctions

- Préservation de l'identité génération de vidéosLes vidéos de haute qualité sont générées à partir d'images de référence et de séquences de pose afin de garantir la cohérence de l'identité.

- Pas de post-traitementLa vidéo obtenue ne nécessite pas de post-traitement avec des outils d'échange de visages ou des modèles de restauration de visages.

- Encodeur facial global tenant compte du contenuOptimisation de l'intégration du visage par interaction avec l'intégration de l'image.

- Adaptateur d'identité tenant compte de la distributionLes données de la couche temporelle : Prévenir l'interférence de la couche temporelle tout en maintenant la cohérence de l'identité.

- Optimisation Hamilton-Jacobi-BellmanLa qualité faciale est encore améliorée par la résolution de l'équation HJB au cours du processus de raisonnement.

Utiliser l'aide

Processus d'installation

- entrepôt de clonesCloner le dépôt StableAnimator : Cloner le dépôt StableAnimator en exécutant la commande suivante dans un terminal :

git clone https://github.com/Francis-Rings/StableAnimator.git

- Installation des dépendancesPour cela, il faut se rendre dans le répertoire du référentiel et installer les dépendances nécessaires :

cd StableAnimator

pip install -r requirements.txt

- Exécution de l'applicationLancement de l'application : Utilisez la commande suivante pour lancer l'application :

python app.py

Processus d'utilisation

- Préparation des images de référence et des séquences de poseLes images de référence : Assurez-vous de disposer d'une image de référence et d'une série d'images de pose qui seront utilisées pour générer l'animation.

- Exécution de scripts d'inférenceLa commande suivante permet d'exécuter le script d'inférence afin de générer l'animation vidéo :

python inference_basic.py --reference_image path_to_reference_image --pose_sequence path_to_pose_sequence

- Voir les résultats générésLa vidéo générée sera enregistrée dans le répertoire de sortie spécifié et vous pourrez visualiser le résultat à l'aide de n'importe quel lecteur vidéo.

Fonctionnement détaillé

- Préservation de l'identité génération de vidéosStableAnimator : En fournissant une image de référence et une séquence de poses, StableAnimator est capable de générer des animations vidéo de haute qualité, en s'assurant que l'identité des personnes dans la vidéo est cohérente avec l'image de référence.

- Encodeur facial global tenant compte du contenuCe module optimise encore l'intégration du visage en interagissant avec l'intégration de l'image afin de garantir une grande fidélité des détails du visage dans la vidéo générée.

- Adaptateur d'identité tenant compte de la distributionPendant la génération de la vidéo, le module assure la cohérence de l'identité dans la vidéo grâce à des techniques d'alignement qui empêchent l'interférence de la couche temporelle.

- Optimisation Hamilton-Jacobi-BellmanLa qualité et la cohérence des visages dans la vidéo générée sont encore améliorées par la résolution de l'équation HJB au cours du processus d'inférence.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...