SiliconCloud x FastGPT : permettre à 200 000 utilisateurs de créer une base de connaissances exclusive en matière d'IA

FastGPT est un système de questions-réponses basé sur le modèle LLM, développé par l'équipe Circle Cloud, qui fournit un traitement de données prêt à l'emploi, l'invocation de modèles, et d'autres capacités. FastGPT a reçu 19.4k étoiles sur Github.

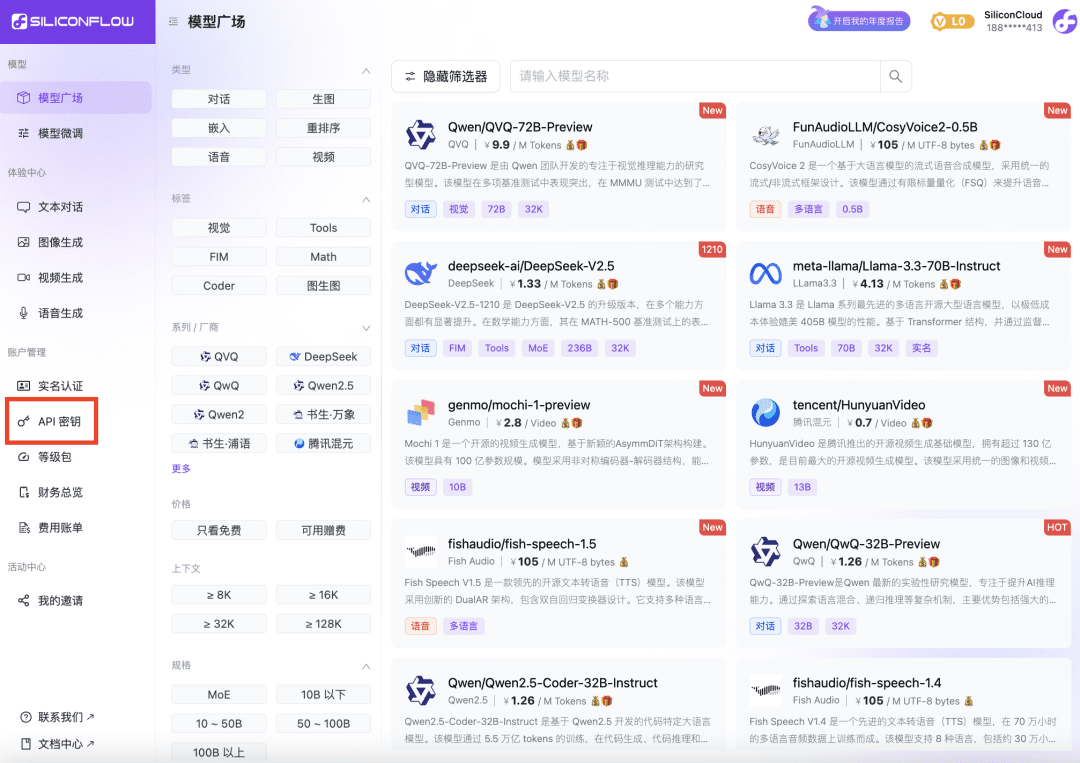

SiliconCloud de Silicon Flow est une grande plateforme de services de modèles en nuage dotée de son propre moteur d'accélération. SiliconCloud peut aider les utilisateurs à tester et à utiliser des modèles open source de manière rapide et peu coûteuse. L'expérience actuelle montre que la vitesse et la stabilité de leurs modèles sont très bonnes, et qu'ils sont très variés, couvrant des dizaines de modèles tels que les langues, les vecteurs, la réorganisation, le TTS, le STT, la cartographie, la génération de vidéos, etc. qui peuvent satisfaire tous les besoins en matière de modèles dans FastGPT.

Cet article est un tutoriel écrit par l'équipe FastGPT pour présenter une solution pour déployer FastGPT dans le développement local en utilisant exclusivement les modèles SiliconCloud.

1 Obtention de la clé API de la plate-forme SiliconCloud

- Ouvrez le site web de SiliconCloud et créez un compte.

- Une fois l'enregistrement terminé, ouvrez API Key, créez une nouvelle clé API et cliquez sur la clé pour la copier en vue d'une utilisation ultérieure.

2 Modifier les variables d'environnement de FastGPT

OPENAI_BASE_URL=https://api.siliconflow.cn/v1 # 填写 SiliconCloud 控制台提供的 Api Key CHAT_API_KEY=sk-xxxxxx

Documentation sur le développement et le déploiement de FastGPT : https://doc.fastgpt.cn

3 Modifier le fichier de configuration FastGPT

Les modèles dans SiliconCloud ont été sélectionnés en tant que configurations FastGPT. Ici, Qwen2.5 72b est configuré avec des modèles de langage et de vision purs ; bge-m3 est sélectionné comme modèle vectoriel ; bge-reranker-v2-m3 est sélectionné comme modèle de réarrangement. Choisissez fish-speech-1.5 comme modèle vocal ; choisissez SenseVoiceSmall comme modèle d'entrée vocal.

Remarque : le modèle ReRank doit encore être configuré une fois avec la clé API.

{

"llmModels": [

{

"provider": "Other", // 模型提供商,主要用于分类展示,目前已经内置提供商包括:https://github.com/labring/FastGPT/blob/main/packages/global/core/ai/provider.ts, 可 pr 提供新的提供商,或直接填写 Other

"model": "Qwen/Qwen2.5-72B-Instruct", // 模型名(对应OneAPI中渠道的模型名)

"name": "Qwen2.5-72B-Instruct", // 模型别名

"maxContext": 32000, // 最大上下文

"maxResponse": 4000, // 最大回复

"quoteMaxToken": 30000, // 最大引用内容

"maxTemperature": 1, // 最大温度

"charsPointsPrice": 0, // n积分/1k token(商业版)

"censor": false, // 是否开启敏感校验(商业版)

"vision": false, // 是否支持图片输入

"datasetProcess": true, // 是否设置为文本理解模型(QA),务必保证至少有一个为true,否则知识库会报错

"usedInClassify": true, // 是否用于问题分类(务必保证至少有一个为true)

"usedInExtractFields": true, // 是否用于内容提取(务必保证至少有一个为true)

"usedInToolCall": true, // 是否用于工具调用(务必保证至少有一个为true)

"usedInQueryExtension": true, // 是否用于问题优化(务必保证至少有一个为true)

"toolChoice": true, // 是否支持工具选择(分类,内容提取,工具调用会用到。)

"functionCall": false, // 是否支持函数调用(分类,内容提取,工具调用会用到。会优先使用 toolChoice,如果为false,则使用 functionCall,如果仍为 false,则使用提示词模式)

"customCQPrompt": "", // 自定义文本分类提示词(不支持工具和函数调用的模型

"customExtractPrompt": "", // 自定义内容提取提示词

"defaultSystemChatPrompt": "", // 对话默认携带的系统提示词

"defaultConfig": {}, // 请求API时,挟带一些默认配置(比如 GLM4 的 top_p)

"fieldMap": {} // 字段映射(o1 模型需要把 max_tokens 映射为 max_completion_tokens)

},

{

"provider": "Other",

"model": "Qwen/Qwen2-VL-72B-Instruct",

"name": "Qwen2-VL-72B-Instruct",

"maxContext": 32000,

"maxResponse": 4000,

"quoteMaxToken": 30000,

"maxTemperature": 1,

"charsPointsPrice": 0,

"censor": false,

"vision": true,

"datasetProcess": false,

"usedInClassify": false,

"usedInExtractFields": false,

"usedInToolCall": false,

"usedInQueryExtension": false,

"toolChoice": false,

"functionCall": false,

"customCQPrompt": "",

"customExtractPrompt": "",

"defaultSystemChatPrompt": "",

"defaultConfig": {}

}

],

"vectorModels": [

{

"provider": "Other",

"model": "Pro/BAAI/bge-m3",

"name": "Pro/BAAI/bge-m3",

"charsPointsPrice": 0,

"defaultToken": 512,

"maxToken": 5000,

"weight": 100

}

],

"reRankModels": [

{

"model": "BAAI/bge-reranker-v2-m3", // 这里的model需要对应 siliconflow 的模型名

"name": "BAAI/bge-reranker-v2-m3",

"requestUrl": "https://api.siliconflow.cn/v1/rerank",

"requestAuth": "siliconflow 上申请的 key"

}

],

"audioSpeechModels": [

{

"model": "fishaudio/fish-speech-1.5",

"name": "fish-speech-1.5",

"voices": [

{

"label": "fish-alex",

"value": "fishaudio/fish-speech-1.5:alex",

"bufferId": "fish-alex"

},

{

"label": "fish-anna",

"value": "fishaudio/fish-speech-1.5:anna",

"bufferId": "fish-anna"

},

{

"label": "fish-bella",

"value": "fishaudio/fish-speech-1.5:bella",

"bufferId": "fish-bella"

},

{

"label": "fish-benjamin",

"value": "fishaudio/fish-speech-1.5:benjamin",

"bufferId": "fish-benjamin"

},

{

"label": "fish-charles",

"value": "fishaudio/fish-speech-1.5:charles",

"bufferId": "fish-charles"

},

{

"label": "fish-claire",

"value": "fishaudio/fish-speech-1.5:claire",

"bufferId": "fish-claire"

},

{

"label": "fish-david",

"value": "fishaudio/fish-speech-1.5:david",

"bufferId": "fish-david"

},

{

"label": "fish-diana",

"value": "fishaudio/fish-speech-1.5:diana",

"bufferId": "fish-diana"

}

]

}

],

"whisperModel": {

"model": "FunAudioLLM/SenseVoiceSmall",

"name": "SenseVoiceSmall",

"charsPointsPrice": 0

}

}

4 Redémarrer FastGPT

5 Test d'expérience

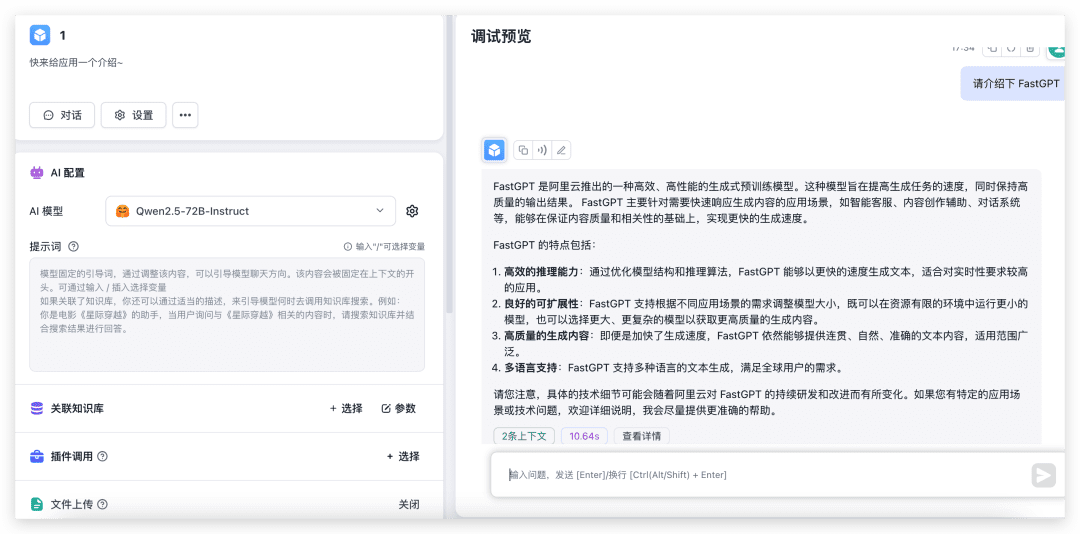

Tester le dialogue et la reconnaissance des images

N'hésitez pas à créer une nouvelle application simple, à sélectionner le modèle correspondant et à la tester en activant le téléchargement d'images.

Comme vous pouvez le voir, le modèle 72B est très rapide, mais s'il n'y a pas quelques 4090 locaux, sans parler de la configuration de l'environnement, je crains que la sortie ne prenne que 30s.

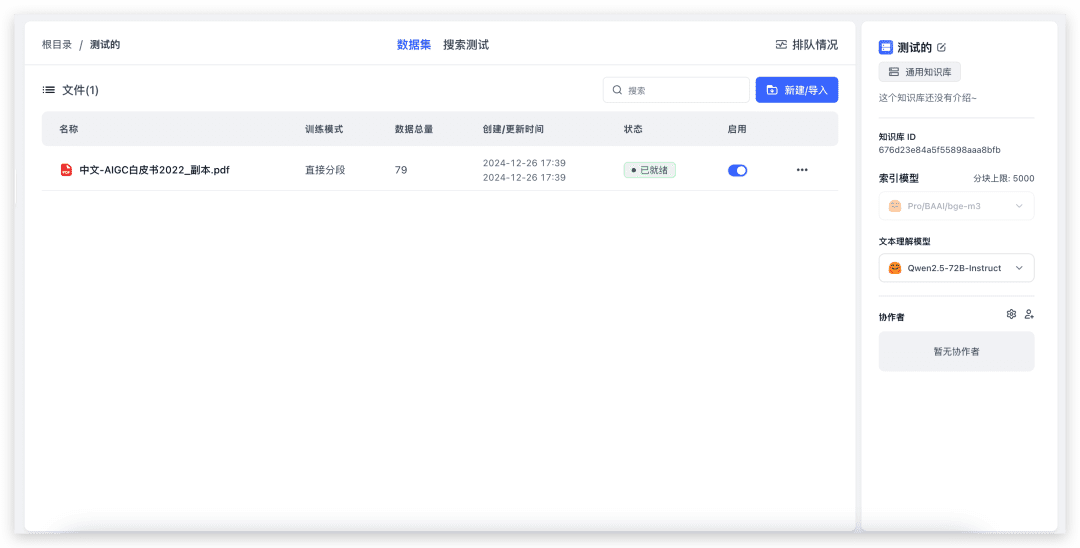

Test d'importation de la base de connaissances et Quiz sur la base de connaissances

Créer une nouvelle base de connaissances (étant donné qu'un seul modèle vectoriel est configuré, la sélection du modèle vectoriel ne sera pas affichée sur la page).

Pour importer un fichier local, il suffit de sélectionner le fichier et de passer à l'étape suivante. 79 index et cela a pris environ 20 secondes. Maintenant, testons le quiz de la base de connaissances.

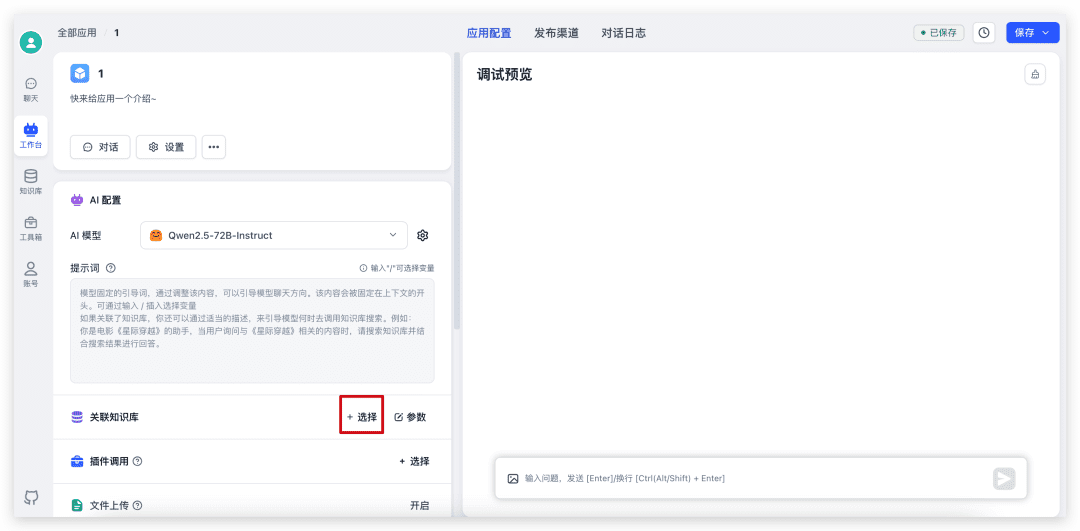

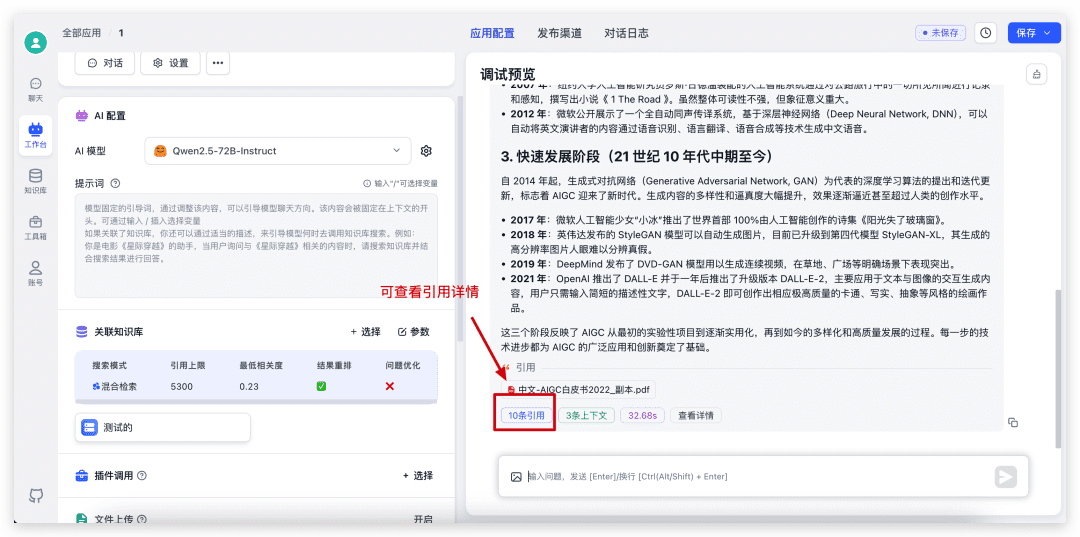

Retournez d'abord à l'application que nous venons de créer, sélectionnez Base de connaissances, ajustez les paramètres et lancez le dialogue.

Une fois le dialogue terminé, cliquez sur la citation en bas de page pour afficher les détails de la citation, ainsi que les résultats de la recherche et de la réorganisation.

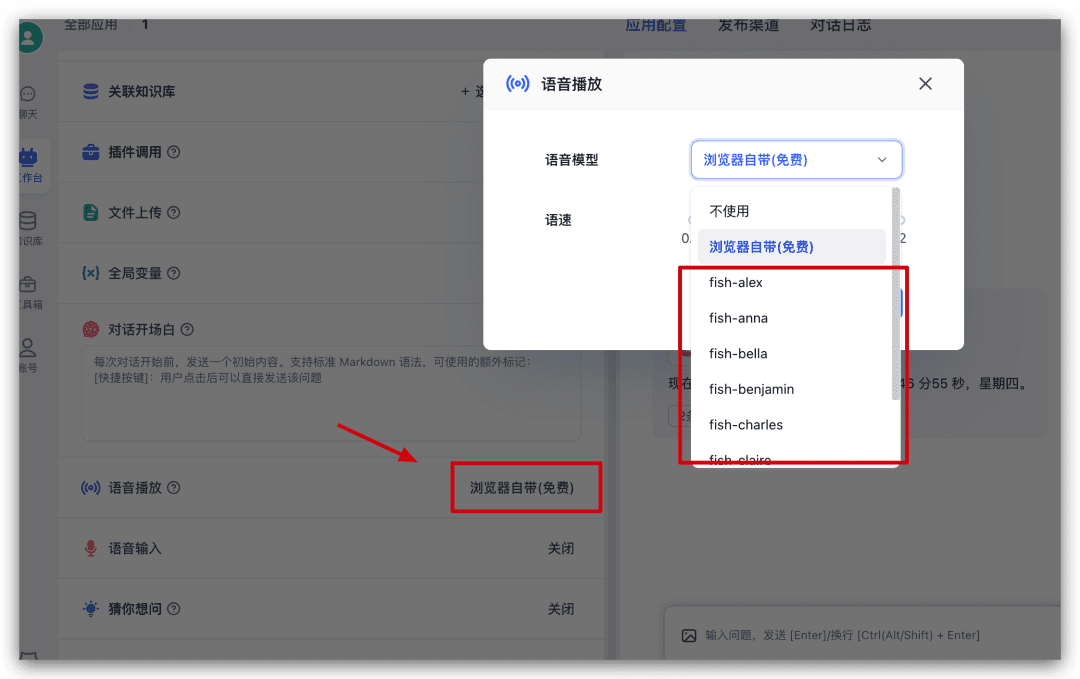

Tester la lecture vocale

En continuant dans l'application, trouvez Voice Play sur le côté gauche de la configuration et cliquez dessus pour sélectionner un modèle de voix dans la fenêtre pop-up et l'essayer.

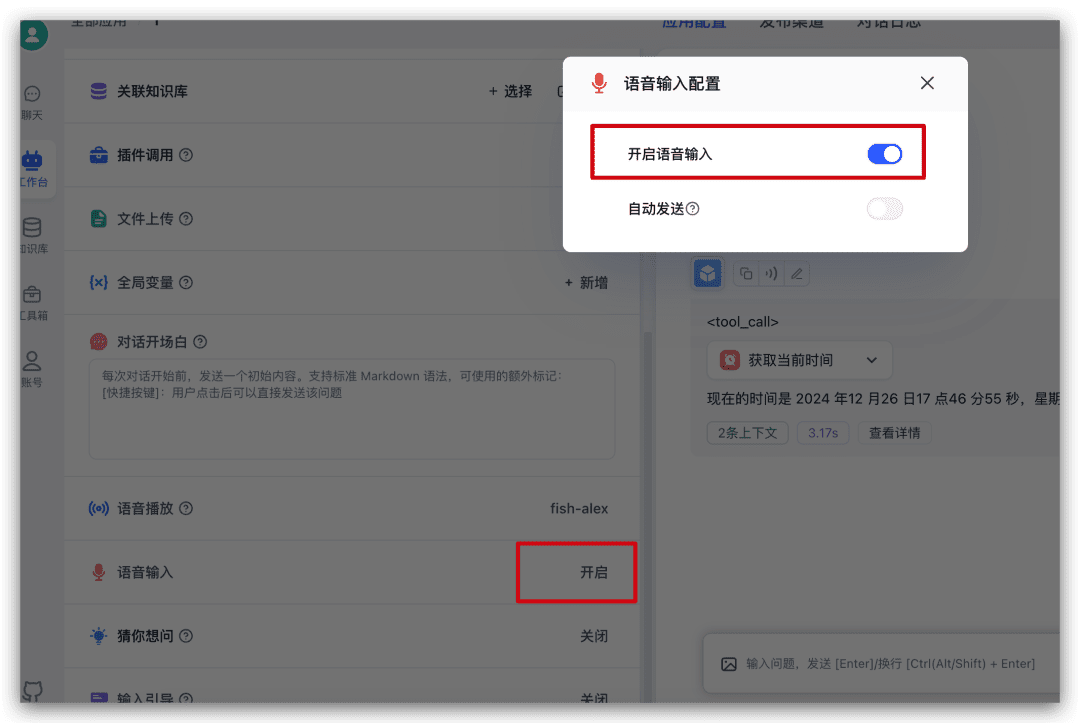

Saisie de la langue du test

Recherchez la saisie vocale dans la configuration de gauche de l'application et cliquez dessus pour activer la saisie linguistique dans la fenêtre qui s'affiche.

Lorsqu'elle est activée, une icône de microphone est ajoutée dans la boîte de saisie du dialogue et vous pouvez cliquer dessus pour effectuer une saisie vocale.

résumés

Si vous souhaitez expérimenter rapidement le modèle open source ou utiliser rapidement FastGPT, et que vous ne voulez pas demander toutes sortes de clés API à différents fournisseurs de services, vous pouvez choisir le modèle de SiliconCloud pour une expérience rapide.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...