Déploiement en ligne du modèle open-source DeepSeek-R1 avec une puissance GPU gratuite

Merci à Tencent Cloud Cloud Studio et DeepSeek DeepSeek-R1.

Avec le développement rapide des technologies d'IA et de Big Model, de plus en plus de développeurs et de chercheurs souhaitent expérimenter et affiner les Big Models par eux-mêmes afin de mieux comprendre et appliquer ces technologies avancées. Cependant, le coût élevé de l'arithmétique GPU devient souvent un goulot d'étranglement qui empêche tout le monde d'explorer. Heureusement, Tencent Cloud Studio fournit des ressources arithmétiques GPU gratuites, et combiné avec les grands modèles DeepSeek-R1 introduits par DeepSeek, nous pouvons facilement déployer et exécuter ces puissants modèles dans le nuage sans dépenser un centime.

Cet article explique en détail comment utiliser Tencent Cloud Cloud Studio de ressources GPU gratuites pour déployer et interagir avec le macromodèle DeepSeek-R1. Nous commencerons par l'utilisation de Cloud Studio et nous irons pas à pas dans l'installation et la configuration d'Ollama, en montrant comment déployer le macromodèle DeepSeek-R1. Profondeur de l'eau-R1 et lui parler, et vous vous retrouverez avec un DeepSeek-R1 complet et gratuit + un ensemble de Code Roo Programme de portefeuille de programmation libre.

1) Cloud Studio

1.1 Introduction à Cloud Studio

Tencent Cloud Cloud Studio est un environnement de développement intégré (IDE) basé sur le cloud qui fournit une multitude d'outils et de ressources de développement pour aider les développeurs à coder, déboguer et déployer plus efficacement. Récemment, Cloud Studio a lancé des ressources informatiques GPU gratuites, les utilisateurs peuvent utiliser gratuitement 10 000 minutes de serveurs GPU par mois, configurés avec 16G de mémoire vidéo, 32G de RAM et un CPU à 8 cœurs. Il s'agit sans aucun doute d'une grande aubaine pour les développeurs qui ont besoin de ressources informatiques de haute performance. (N'oubliez pas de fermer la machine après l'avoir utilisée, lors de la prochaine mise au point, puis de l'ouvrir, l'environnement est automatiquement sauvegardé, 10 000 minutes par mois ne peuvent tout simplement pas être utilisées)

1.2 Inscription et connexion

Pour utiliser Cloud Studio, vous devez d'abord créer un compte Tencent Cloud. Une fois l'enregistrement terminé, connectez-vous à Cloud Studio et vous verrez une interface utilisateur propre qui fournit une variété de modèles de développement à choisir. Ces modèles couvrent un large éventail de scénarios, du développement Python de base aux déploiements complexes de grands modèles. N'oubliez pas d'entrer dans la version Pro.

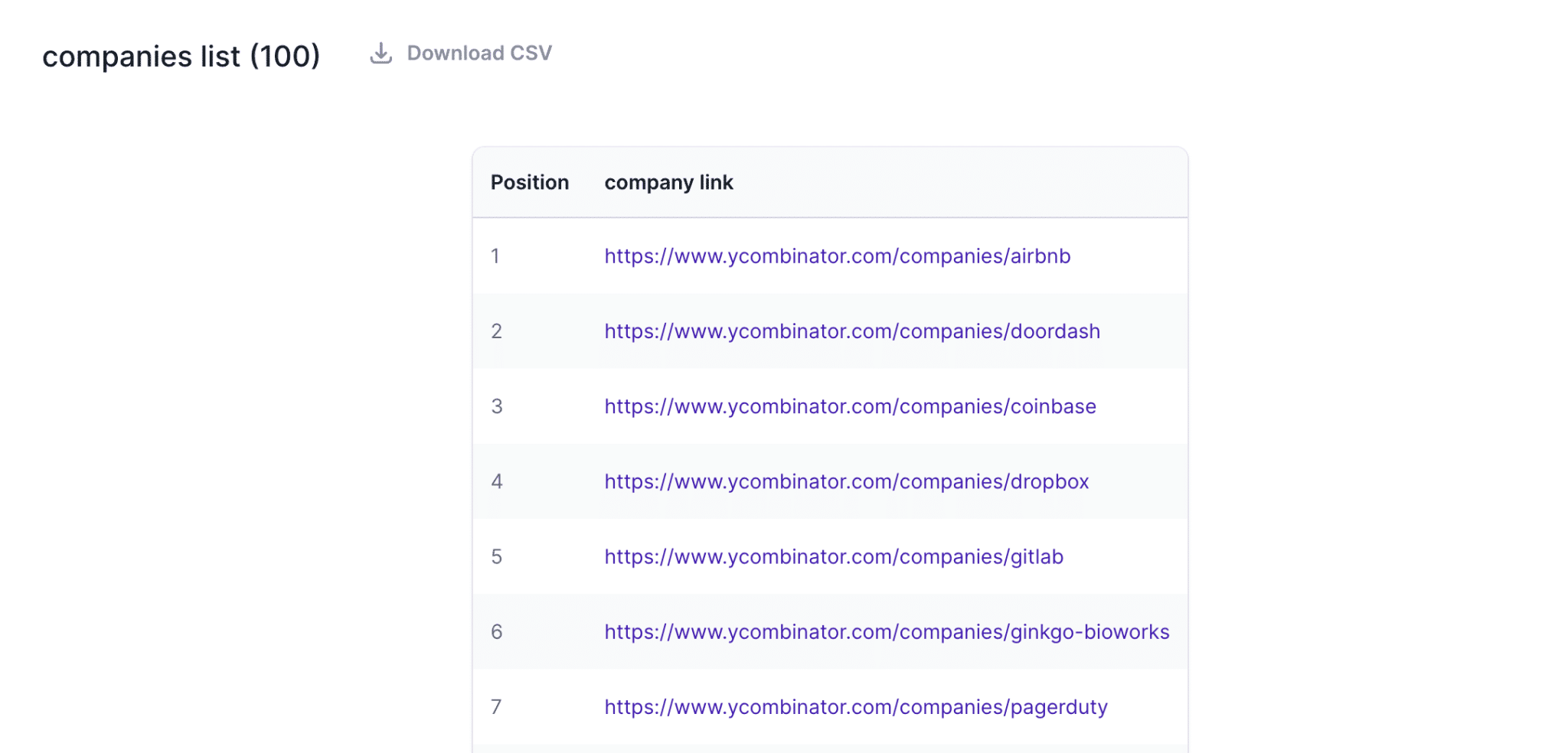

1.3 Sélection du modèle Ollama

Puisque notre objectif est de déployer Profondeur de l'eau-R1 grand modèle, nous pouvons donc simplement choisir Ollama Templates.Ollama est un outil de gestion et d'exécution de grands modèles qui simplifie le processus de téléchargement, d'installation et d'exécution des modèles. Après avoir sélectionné un modèle Ollama, Cloud Studio configure automatiquement l'environnement Ollama pour nous, éliminant ainsi le besoin d'une installation manuelle.

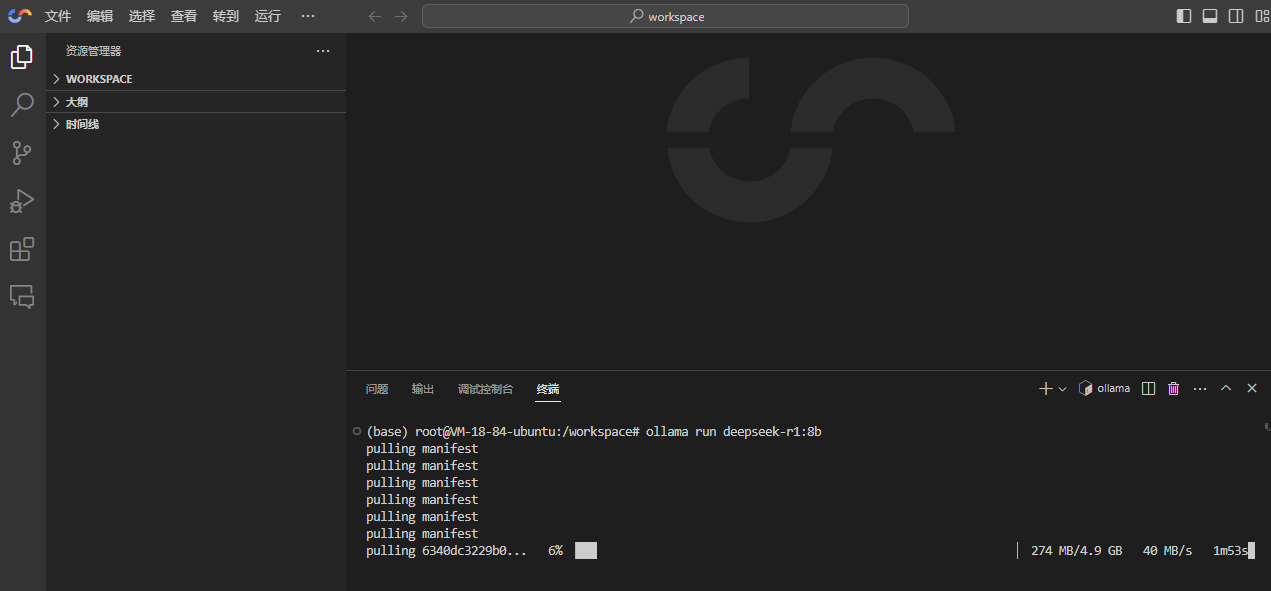

Attendre le démarrage, cliquer sur entrée (Ollama est déjà déployé dans l'environnement, il suffit de lancer la commande d'installation directement).

2) Ollama

2.1 Présentation d'Ollama

Ollama est un outil open source spécialement conçu pour la gestion et l'exécution de divers modèles de grande taille. Il supporte une variété de formats de modèles et peut gérer automatiquement les dépendances des modèles, ce qui rend le déploiement et l'exécution des modèles très simples. Le site officiel d'Ollama fournit une richesse de ressources de modèles, les utilisateurs peuvent choisir le bon modèle en fonction de leurs besoins pour le télécharger et l'exécuter.

2.2 Paramètres du modèle et sélection

Sur le site officiel d'Ollama, le nombre de paramètres de chaque modèle est indiqué en bas de chaque modèle, par exemple 7B, 13B, 70B, etc. Le "B" signifie ici milliard et indique le nombre de paramètres du modèle. Plus le nombre de paramètres est élevé, plus la complexité et la capacité du modèle sont importantes, mais plus il consomme de ressources informatiques.

Pour les ressources GPU gratuites (16G de mémoire vidéo, 32G de RAM, CPU à 8 cœurs) fournies par Tencent Cloud Studio, nous pouvons choisir des modèles 8B ou 13B pour le déploiement. Si vous disposez d'une configuration matérielle supérieure, vous pouvez également essayer des modèles avec des paramètres plus importants pour obtenir de meilleurs résultats.

2.3 Installation d'Ollama

Après avoir sélectionné le modèle Ollama dans Cloud Studio, le système installera automatiquement Ollama pour nous. Si vous utilisez Ollama dans d'autres environnements, vous pouvez l'installer avec la commande suivante :

curl -fsSL https://ollama.com/install.sh | shUne fois l'installation terminée, vous pouvez vérifier qu'Ollama a été installé avec succès en utilisant la commande suivante :

ollama --versionL'étape suivante consiste pour Ollama à déployer DeepSeek-R1 ...

3. déploiement gratuit de DeepSeek-R1

3.1 Introduction à DeepSeek-R1

DeepSeek-R1 est un grand modèle haute performance de DeepSeek qui donne de bons résultats dans un certain nombre de tâches de traitement du langage naturel, en particulier dans les domaines de la génération de texte, des systèmes de dialogue et des questions-réponses. Le nombre de paramètres de DeepSeek-R1 varie de 8B à 70B, ce qui permet aux utilisateurs de choisir le bon modèle pour le déploiement en fonction de leur configuration matérielle.

3.2 Téléchargement et déploiement

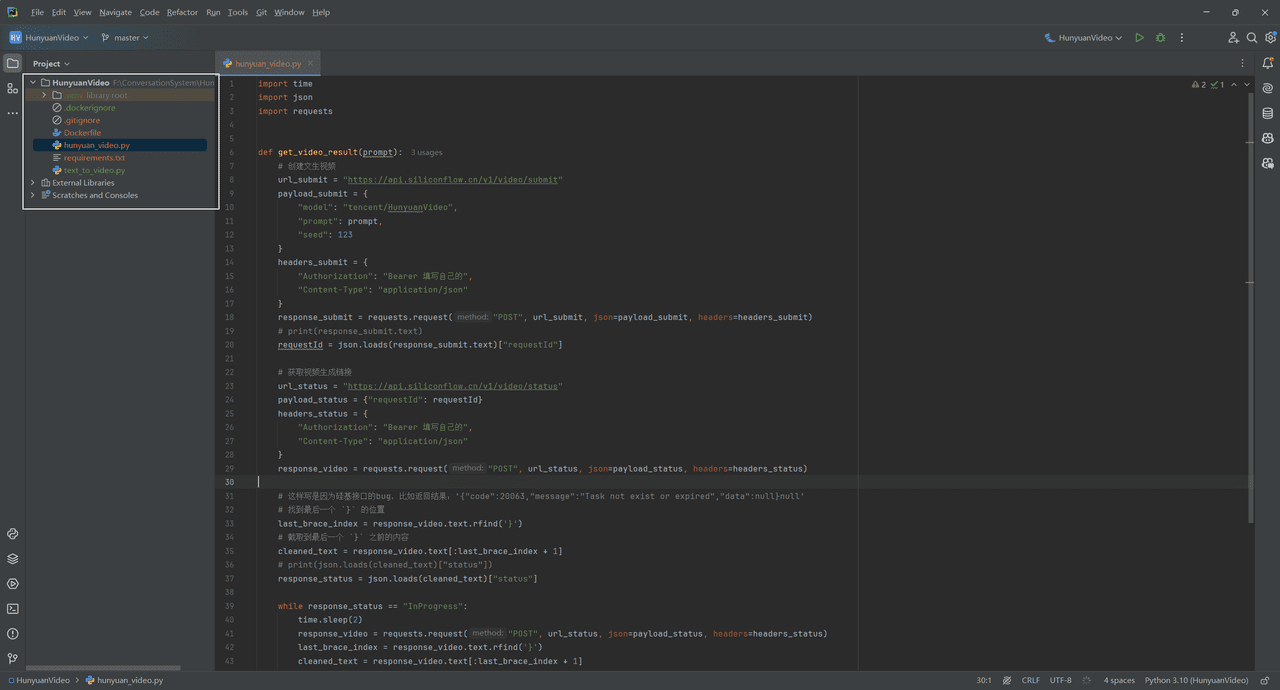

Le déploiement de DeepSeek-R1 est très simple puisque Cloud Studio installe déjà Ollama automatiquement. Il suffit d'exécuter la commande suivante :

ollama run deepseek-r1:8b

Tous les modèles disponibles pour DeepSeek-R1 sont ici : https://ollama.com/library/deepseek-r1 , recommandé ! ollama run deepseek-r1:14b (Il s'agit du modèle Qwen distillé).

3.3 Exécution du modèle

Après avoir attendu la fin du téléchargement du modèle, Ollama lancera automatiquement DeepSeek-R1 et entrera en mode interactif. A ce stade, vous pouvez saisir des questions ou des commandes directement dans le terminal pour dialoguer avec DeepSeek-R1.

4) Commencer à discuter avec DeepSeek-R1

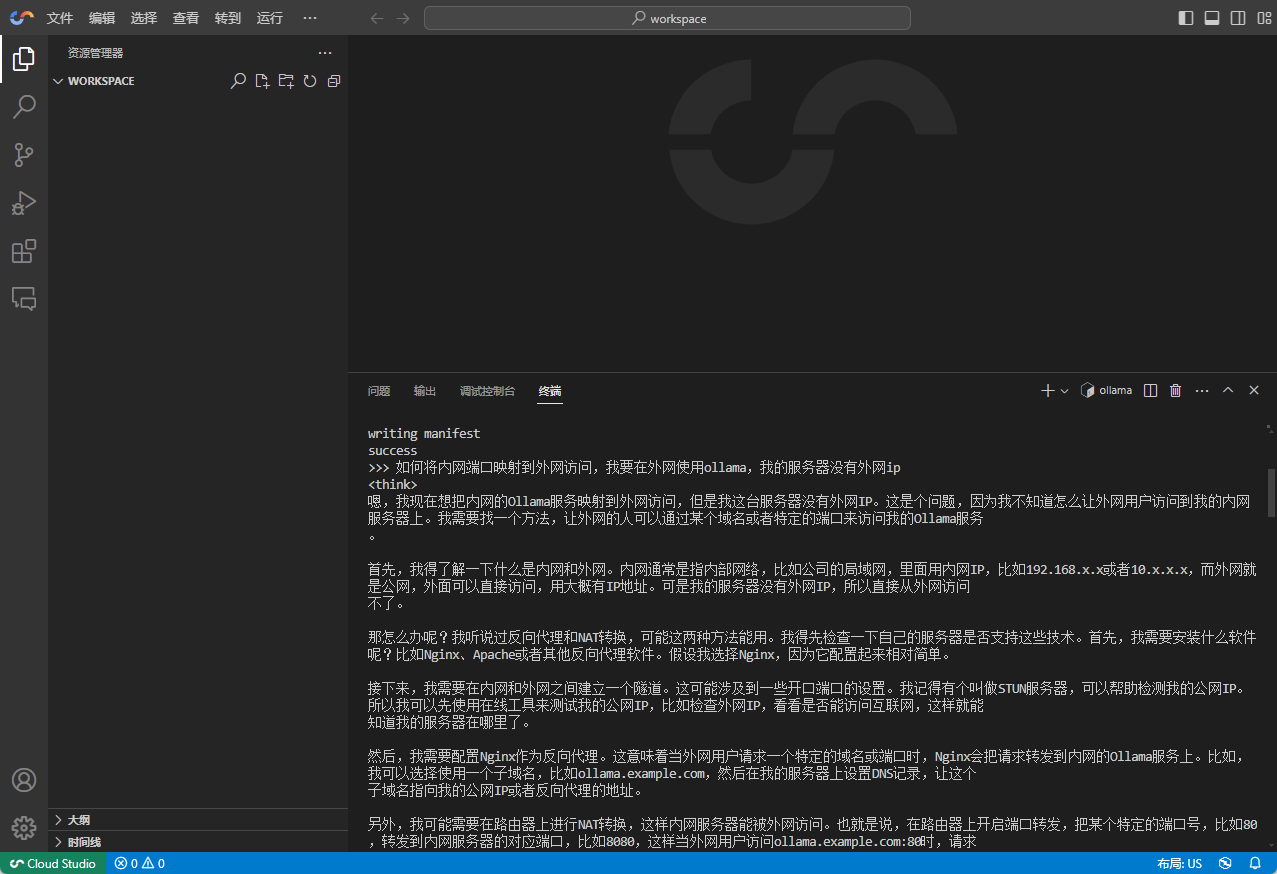

4.1 Dialogue de base

Le dialogue avec DeepSeek-R1 est très simple, il vous suffit d'entrer votre question ou votre instruction dans le terminal et le modèle génère une réponse immédiatement.

4.2 Tâches complexes

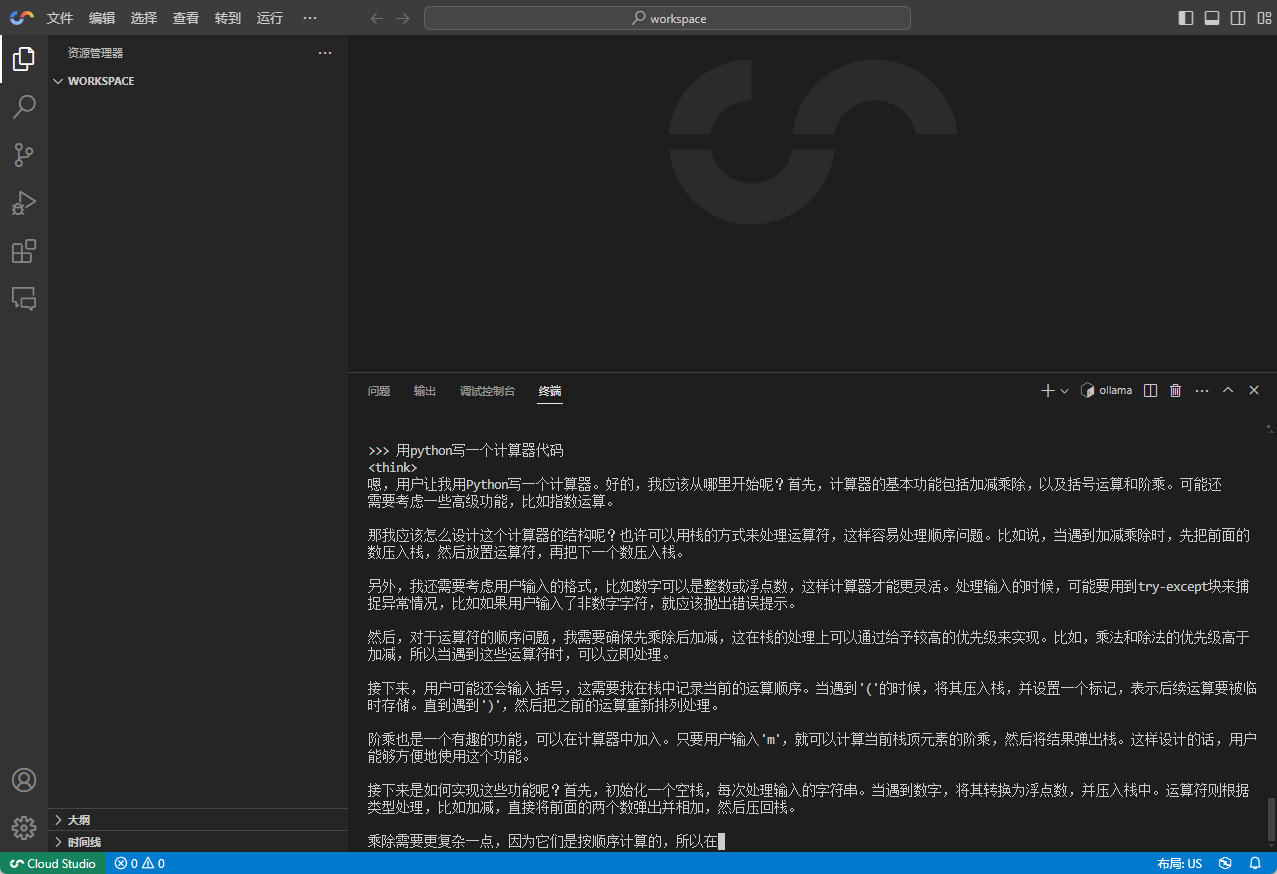

- Par exemple, la génération de code avec DeepSeek-R1

4.3 Mise au point du modèle

Si vous n'êtes pas satisfait des performances de DeepSeek-R1, ou si vous souhaitez que le modèle soit plus performant sur certaines tâches spécifiques, vous pouvez essayer d'affiner le modèle. Le processus de réglage fin implique généralement la préparation de certains ensembles de données spécifiques au domaine et le réentraînement du modèle en utilisant ces ensembles de données.Ollama fournit des interfaces simples pour aider les utilisateurs à effectuer le réglage fin du modèle.

4.4 Utilisation dans les outils de programmation de l'IA

L'utilisation du service dans le terminal n'est certainement pas le scénario principal, nous devons utiliser le service dans d'autres outils de chat ou de programmation d'IA pour le rendre pratique. Cloud Studio ne fournit pas d'adresse d'accès externe. Dans ce cas, ngrok/Cpolar est une bonne solution.

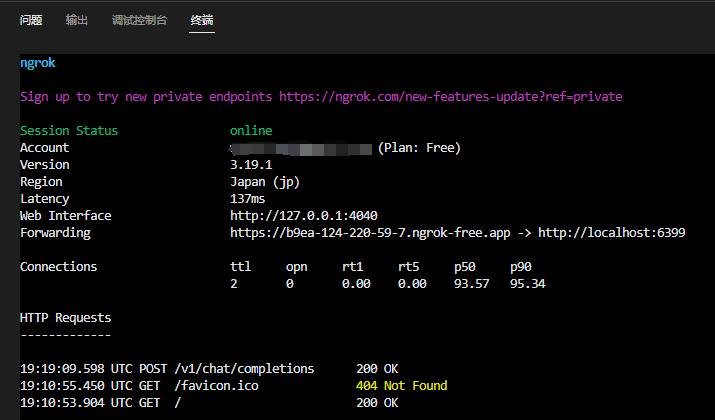

Je ne donne que des idées, pas d'explications détaillées : la première étape consiste à interroger le port Ollama de l'intranet, la deuxième étape consiste à installer ngrok, la troisième étape consiste à mapper le port Ollama à ngrok, le service démarre et vous obtenez l'adresse suivante :

Note : Il est supposé que votre ollama serve Le service est déjà en 6399 à exécuter, vous pouvez utiliser la commande suivante pour démarrer Ngrok et associer le port à l'extranet :ngrok http 6399

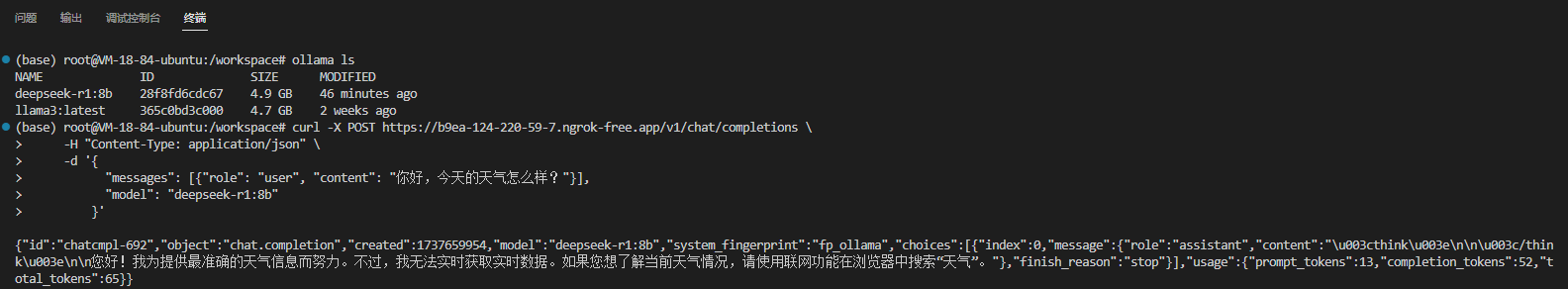

Vérifier que l'extranet fonctionne : (pour épisser l'adresse complète)

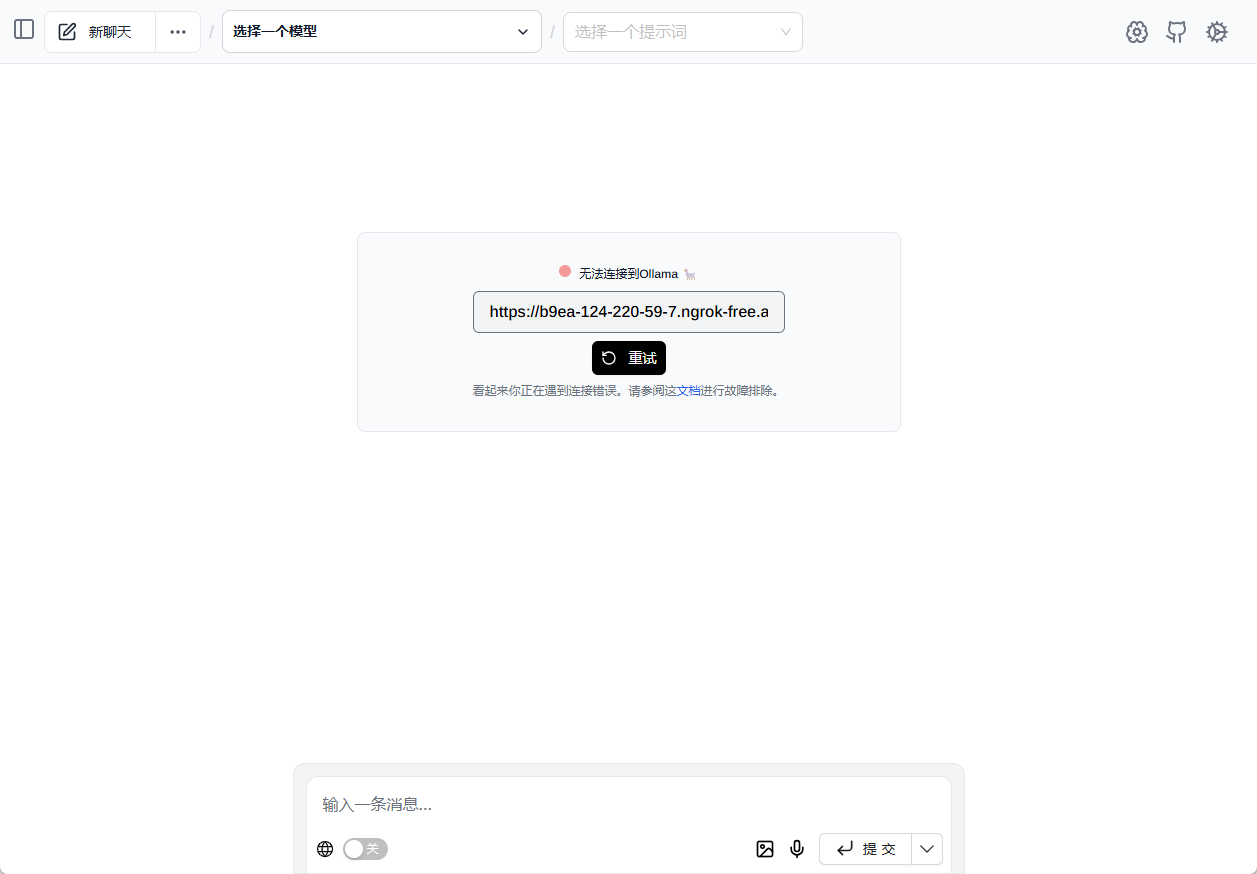

Nous recommandons l'utilisation d'un plug-in de navigateur natif pour profiter des fonctionnalités liées à Ollama. Page Assist (remplir directement https://xxx.ngrok-free.app/ pour charger automatiquement tous les modèles Ollama)

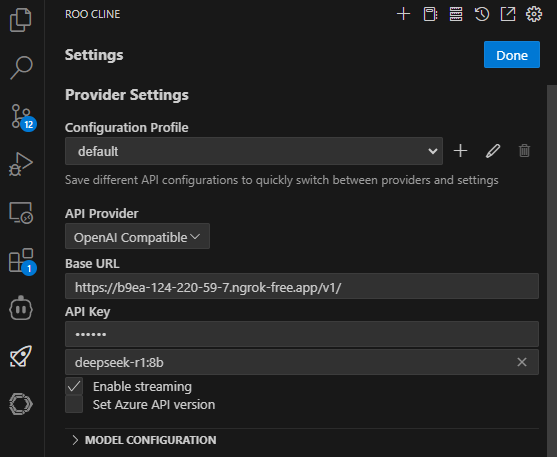

existent Roo Code (Roo Cline) Configurer l'API dans le client : (Roo Code est un excellent plugin de programmation d'IA)

Notez l'ajout de v1 à l'URL d'origine et à la clé API.

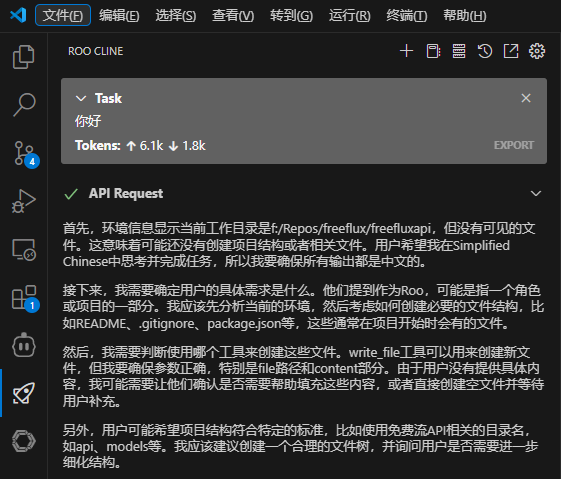

Sauvegardez et testez le dialogue :

5. résumé

Avec les ressources GPU gratuites de Tencent Cloud Studio, combinées à Ollama et DeepSeek-R1, nous pouvons facilement déployer et exécuter de grands modèles dans le nuage sans nous soucier des coûts élevés du matériel. Que vous ayez une simple conversation ou que vous travailliez sur une tâche complexe, DeepSeek-R1 fournit un support puissant. Nous espérons que cet article vous aidera à déployer DeepSeek-R1 en douceur et à commencer votre voyage d'exploration de grands modèles.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...