roop-unleashed : un outil d'échange de visages tout-en-un basé sur l'optimisation Roop

Introduction générale

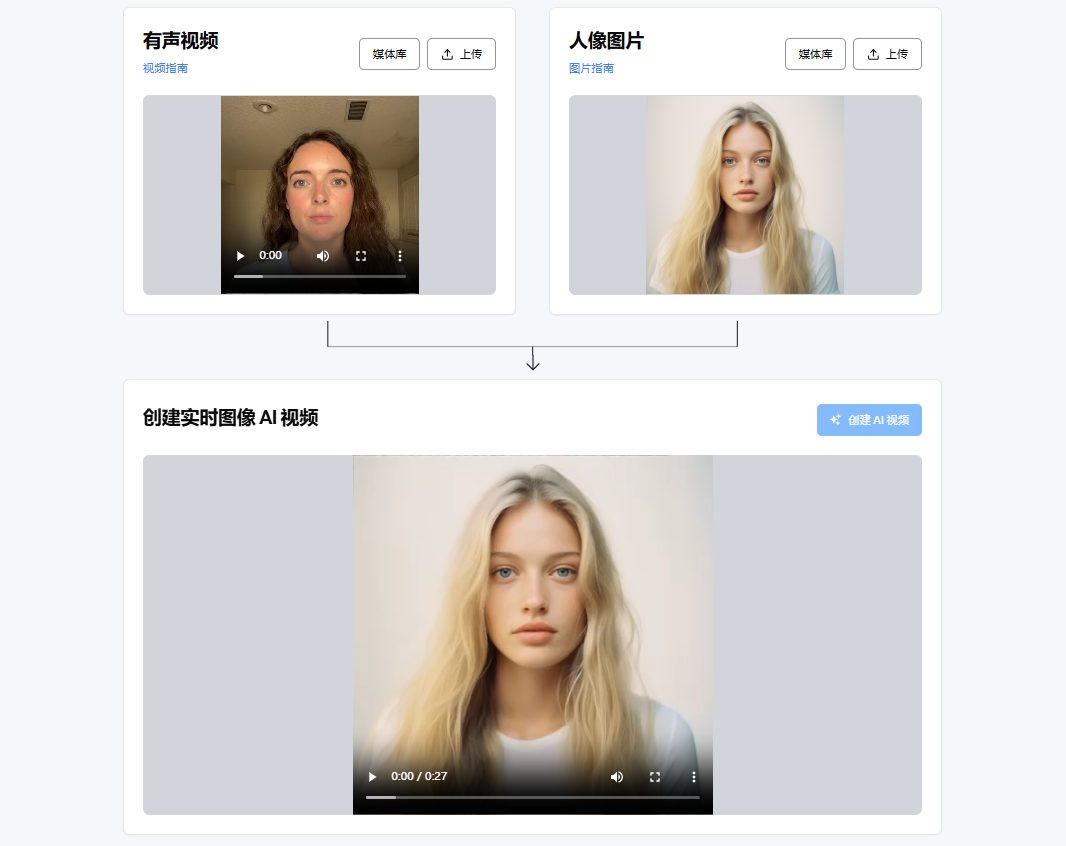

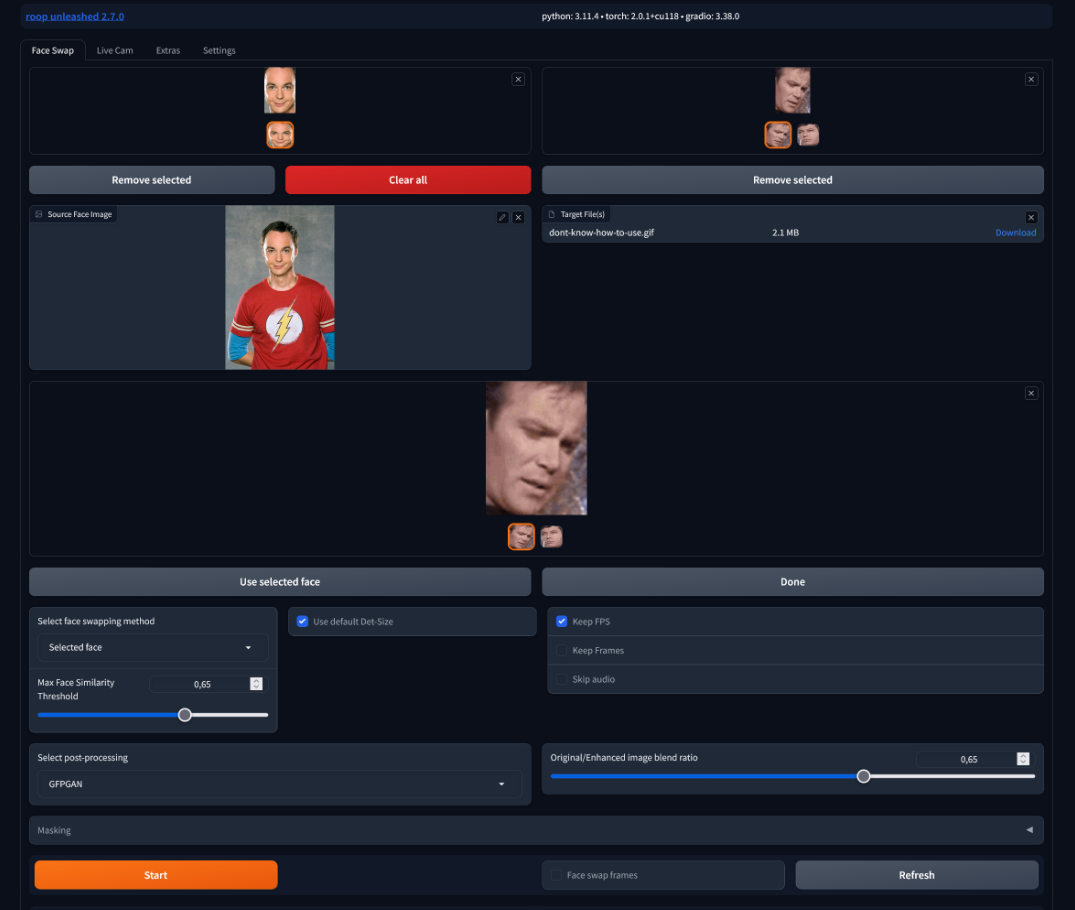

Roop-Unleashed est un outil de remplacement de visage IA open source basé sur Python, hérité du projet Roop de s0md3v, maintenu par le développeur C0untFloyd et renommé Roop-Unleashed, qui permet de remplacer les visages dans les images et les vidéos grâce à la technologie d'apprentissage en profondeur, avec des effets réalistes et un fonctionnement simple. Les utilisateurs n'ont qu'à télécharger le matériel et à sélectionner le visage cible pour générer un contenu de remplacement de visage de haute qualité. L'outil prend en charge l'accélération GPU NVIDIA et est également compatible avec le fonctionnement du CPU, ce qui le rend adapté à différentes configurations matérielles.Roop-Unleashed offre le traitement par lots, le remplacement de visage en temps réel et la prise en charge des scènes VR, et est largement utilisé dans les loisirs et la création de contenu. Toutefois, en raison de problèmes éthiques et juridiques potentiels, le projet original et certaines de ses branches ont été désactivés sur GitHub, de sorte que les utilisateurs doivent les utiliser avec prudence et se conformer aux réglementations en vigueur.

Liste des fonctions

- Échange de visages de haute précision Les photos et les vidéos sont prises en charge pour générer des effets de remplacement de visage naturels et réalistes.

- Changements dans la diffusion en direct Les services d'aide à la décision : remplacement dynamique du visage pendant les émissions en direct pour les vidéoconférences ou les divertissements en direct.

- lifting du lot Gestion de plusieurs images ou de plusieurs vidéos dans un dossier en un seul clic, pour plus d'efficacité.

- Prise en charge de l'échange de visages VR Le système d'échange de visages : Conçu pour la réalité virtuelle, il offre une expérience immersive d'échange de visages.

- Masque intelligent Les changements de visage sont transparents grâce à la gestion automatique de l'occlusion des cheveux, des mains ou des objets.

- Compatible avec les GPU et CPU NVIDIA L'accélération CUDA est prise en charge, le mode CPU est adapté aux périphériques à faible profil.

- Support multiplateforme Les environnements Windows, Linux et macOS sont disponibles.

- amélioration du visage GFPGAN : Intégrer GFPGAN et CodeFormer pour améliorer la qualité des images après l'échange de visages.

Utiliser l'aide

Processus d'installation

Roop-Unleashed est un outil basé sur Python dont l'installation nécessite quelques compétences techniques. Voici les étapes détaillées de l'installation pour Windows (Linux et macOS sont similaires) :

- Installation de Python

Assurez-vous que Python 3.8 ou une version ultérieure est installé sur votre système. Visitez python.org pour télécharger le paquet d'installation, et cochez la case "Add Python to PATH" pendant l'installation. - Installation de Git

Téléchargez et installez Git (git-scm.com) pour cloner le code du projet. - projet de clonage

Comme le dépôt zullum/roop-unleashed est désactivé, il est recommandé d'utiliser le dépôt original C0untFloyd/roop-unleashed ou une autre branche active (par exemple Hillobar/Rope). Ouvrez un terminal et exécutez la commande suivante pour cloner le code :git clone https://github.com/C0untFloyd/roop-unleashed.git cd roop-unleashed - Installation des dépendances

Le projet nécessite l'installation de plusieurs bibliothèques et outils Python. Exécutez la commande suivante :pip install -r requirements.txtS'assurer qu'il est installé

ffmpegLes utilisateurs de Windows peuvent le télécharger à partir de ffmpeg.org et l'ajouter au PATH du système. - Installation de CUDA (facultatif)

Si vous disposez d'un GPU NVIDIA, installez CUDA et cuDNN pour accélérer le traitement. Visitez le site web de NVIDIA pour télécharger les versions correspondantes. - Télécharger le modèle pré-entraîné

Lors de la première exécution, l'outil télécharge automatiquement environ 2 Go de modèles pré-entraînés (tels que le modèle face cachée (Modèle). Assurez-vous que la connexion au réseau est stable. - procédure de déclenchement

Exécutez-le dans le répertoire du projet :python run.pyLe programme démarre un serveur web local à l'adresse par défaut de

http://localhost:8000. Visitez cette adresse dans votre navigateur pour accéder à l'interface opérateur.

Principales fonctions

Échange de visages d'images

- Ouvrez l'interface web, cliquez sur le bouton "Upload" et sélectionnez l'image cible (contenant le visage à remplacer) et l'image du visage source.

- Sélectionnez la zone du visage ciblée dans l'interface et l'outil la détectera automatiquement et la mettra en évidence.

- Ajustez les paramètres (par exemple, Fusion, Contraste) et cliquez sur le bouton "Générer".

- Une fois le traitement terminé, téléchargez l'image obtenue. Le traitement d'une image prend généralement de 2 à 5 secondes (en mode GPU).

Vidéo échange de visages

- Téléchargez la vidéo cible et l'image faciale source.

- Sélectionnez le visage cible dans la vidéo pour prendre en charge la détection de plusieurs visages.

- Activez l'option Smart Mask pour gérer les occlusions telles que les cheveux ou les mains.

- Définissez la résolution de sortie et la fréquence d'images, puis cliquez sur "Démarrer le traitement".

- Le temps de traitement des vidéos dépend de la longueur et des performances du matériel (environ 10 à 20 secondes par minute en mode GPU).

- Téléchargez la vidéo générée sur l'échange de visages.

lifting du lot

- Sélectionnez le mode "Traitement par lots" dans l'interface.

- Téléchargez un dossier contenant plusieurs images ou vidéos.

- Mise en place d'une source uniforme d'images faciales et de paramètres de traitement.

- Cliquez sur "Batch Generate", l'outil traitera automatiquement tous les fichiers du dossier.

- Une fois le traitement terminé, les résultats sont enregistrés dans le dossier de sortie spécifié.

Changements dans la diffusion en direct

- Assurez-vous que la caméra est connectée et entrez dans le mode "Live Face Change".

- Téléchargez l'image du visage source et l'outil détectera le visage dans la caméra en temps réel.

- Ajustez les paramètres de mélange pour obtenir un effet naturel d'échange de visage.

- Prend en charge la sortie d'images en direct vers des logiciels de diffusion en direct tels que OBS ou Zoom, une caméra virtuelle est nécessaire.

VR Face Swap (échange de visages)

- Entrez dans le "mode VR" et connectez un dispositif VR (par exemple, Oculus Quest).

- Téléchargez une photo du visage de la source et réglez l'angle de vue et les paramètres d'éclairage.

- L'outil rend les effets d'échange de visages en temps réel dans un environnement VR, adapté aux réunions virtuelles ou aux jeux.

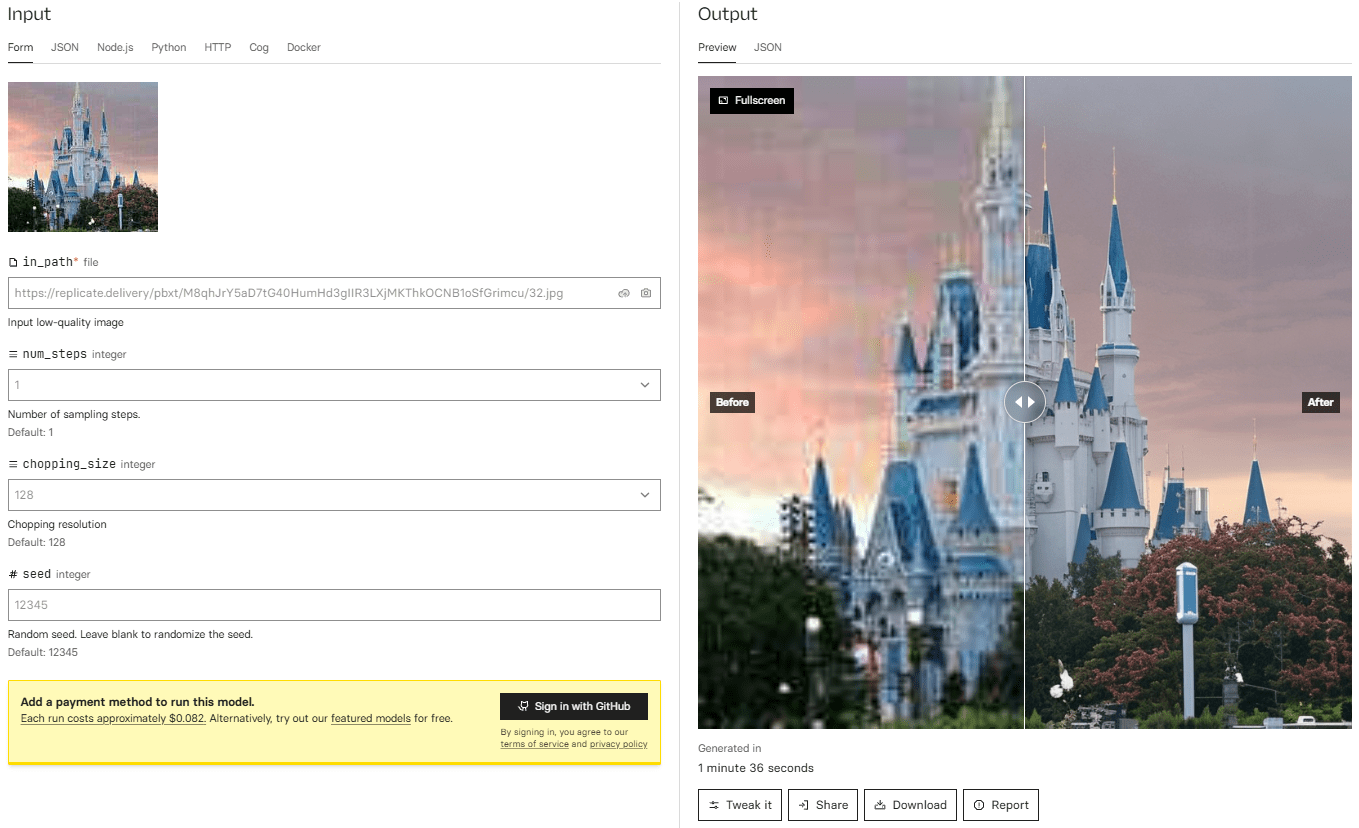

amélioration du visage

- Activez l'option Amélioration du visage lorsque vous travaillez avec des photos ou des vidéos.

- Sélectionnez GFPGAN ou CodeFormer afin d'améliorer les détails et la clarté du visage.

- Les résultats améliorés conviennent à une sortie haute résolution ou à une utilisation professionnelle.

mise en garde

- exigences en matière de matériel Le mode GPU nécessite une carte graphique NVIDIA (au moins 4 Go de RAM), tandis que le mode CPU convient aux ordinateurs ordinaires, mais est plus lent.

- Modèle à télécharger Les fichiers volumineux doivent être téléchargés lors de la première exécution, il est donc recommandé de disposer d'une connexion internet stable.

- question éthique La technologie d'échange de visages peut comporter des risques juridiques et de protection de la vie privée et il est recommandé de ne l'utiliser qu'à des fins légitimes telles que le divertissement ou la création artistique.

- Problèmes de débogage Si l'application signale une erreur, vérifiez la version de Python, l'installation des dépendances et la configuration de l'interface utilisateur.

ffmpegConfiguration.

scénario d'application

- Création de contenu de divertissement

Les utilisateurs peuvent utiliser Roop-Unleashed pour créer des contenus hilarants de substitution de visage pour de courtes vidéos ou des emojis. Par exemple, remplacez le visage d'un ami dans un clip vidéo pour plus de fun. - post-production

Les professionnels du cinéma et de la télévision peuvent utiliser la fonction de remplacement des visages par lots pour remplacer les visages des personnages et réduire les coûts des effets spéciaux. Le masquage intelligent garantit des effets naturels dans les scènes complexes. - présentateur virtuel (TV)

Les présentateurs peuvent jouer différents rôles lors de la diffusion en direct grâce à la fonction de changement de visage en temps réel, ce qui renforce l'interactivité avec le public et convient aux jeux diffusés en direct ou aux représentations virtuelles d'idoles. - Expérience virtuelle VR

Les utilisateurs de la RV peuvent remplacer les visages dans les réunions ou les jeux virtuels pour une meilleure immersion, pour la collaboration à distance ou les plateformes sociales. - Éducation et présentation

Les enseignants ou les formateurs peuvent créer des vidéos pédagogiques en utilisant la technologie d'échange de visages pour remplacer les visages des personnages historiques par des acteurs afin d'ajouter de l'intérêt et de l'attrait.

QA

- Quels sont les formats de fichiers pris en charge par Roop-Unleashed ?

Les images sont compatibles avec les formats JPG, PNG et autres formats courants, les vidéos avec les formats MP4, AVI, MOV, etc. Il est recommandé d'utiliser des clips haute résolution pour obtenir les meilleurs résultats. - Peut-il fonctionner sans une carte graphique NVIDIA ?

Oui, le mode CPU est compatible avec les ordinateurs bas de gamme, mais la vitesse de traitement est lente. Il est recommandé d'avoir au moins 8 Go de RAM. - Que dois-je faire si les résultats de la greffe de visage ne sont pas naturels ?

Ajustez les paramètres de fusion et d'éclairage ou activez l'amélioration des visages (GFPGAN/CodeFormer). Veillez à ce que les visages source et cible soient éclairés et inclinés de la même manière. - Comment éviter les risques juridiques ?

Ne l'utilisez qu'à des fins de divertissement personnel ou de contenu autorisé et évitez d'utiliser l'image d'autres personnes sans autorisation. Respecter les réglementations locales en matière de protection de la vie privée. - Pourquoi les dépôts GitHub sont-ils désactivés ?

En raison de l'abus potentiel de la technologie d'échange de visages, GitHub a désactivé certains des dépôts concernés pour violation des conditions d'utilisation. Il est recommandé d'obtenir du code à partir de branches actives ou de sauvegardes communautaires.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...