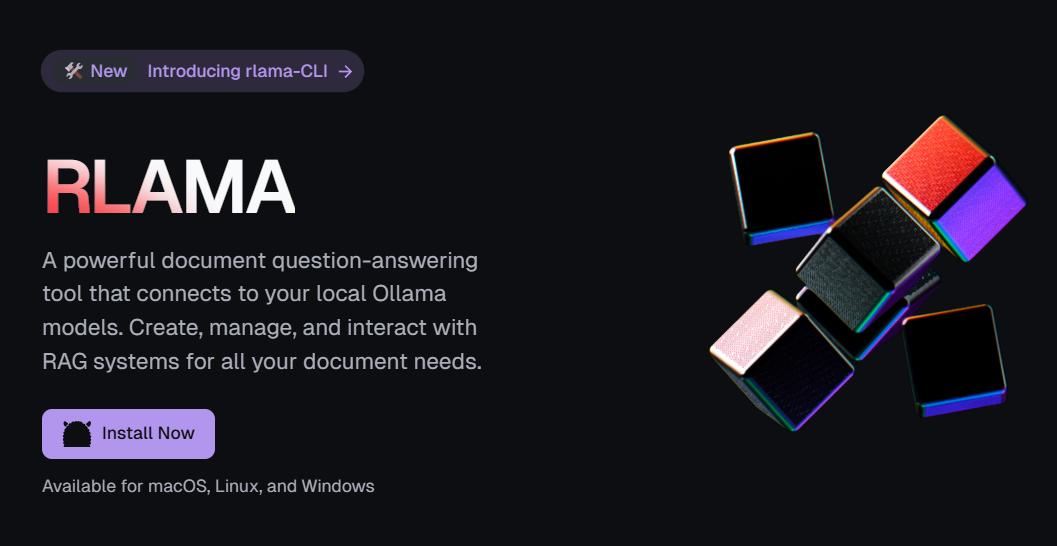

RLAMA : Un système RAG pour l'interrogation intelligente de documents locaux opérée à partir de la ligne de commande

Introduction générale

RLAMA est un système RAG (Retrieval Augmentation Generation) pour l'intelligence documentaire développé par DonTizi et hébergé sur GitHub, dont la caractéristique principale est la fonctionnalité par le biais d'opérations en ligne de commande. Les utilisateurs peuvent se connecter à des Ollama qui indexe rapidement les documents dans des dossiers pour en faire une base de connaissances interactive avec des questions-réponses intelligentes. Qu'il s'agisse d'un fichier de code, d'un document technique ou d'un document bureautique, RLAMA est à la hauteur de la tâche et fonctionne entièrement en local, ce qui élimine le besoin de services en nuage et préserve la confidentialité des données. Grâce à la prise en charge de plusieurs formats de fichiers et à une installation facile, RLAMA est un choix puissant pour la gestion de documents localisés, en particulier pour les développeurs et les passionnés de technologie qui sont habitués aux opérations en ligne de commande.

Liste des fonctions

- Création d'un système RAG en ligne de commandeLes commandes : Générer une base de connaissances de quiz intelligents en indexant les documents d'un dossier avec des commandes.

- Interaction en ligne de commande Q&R: Utiliser la session du terminal pour interroger les RAG Le contenu du document dans le système.

- Administration du système RAGLes systèmes RAG peuvent être facilement mis à jour en listant et en supprimant les systèmes RAG à l'aide de commandes.

- Intégration du modèle localLe système de gestion de l'information : Il se connecte de manière transparente aux modèles locaux d'Ollama, tout en conservant une localisation complète.

- Gestion des versions et des mises à jourCommande de vérification de la version : Utilisez la commande pour vérifier la version ou mettre à jour le système à l'état le plus récent.

- Support multiformatCompatible avec un large éventail de formats, y compris le texte, le code et les documents de bureau.

- Désinstallation en ligne de commandeLe site de l'Agence européenne pour l'environnement (AEE) : fournit des outils et des données sur le nettoyage des commandes.

Utiliser l'aide

Processus d'installation

RLAMA est une implémentation en ligne de commande de Document Intelligence Quiz pour macOS, Linux et Windows, et les étapes suivantes sont détaillées :

1. les conditions préalables

- Installer OllamaLe modèle Ollama doit être exécuté localement. Visitez le site web d'Ollama pour le télécharger et l'installer, puis exécutez le programme

ollama run llama3(ou d'autres modèles) pour confirmer la disponibilité, l'adresse par défauthttp://localhost:11434. - connexion au réseauL'installation nécessite une connexion internet pour télécharger les scripts ou les dépendances.

- Dépendances optionnellesPour prendre en charge davantage de formats (par exemple, .pdf, .docx), il est recommandé d'exécuter le programme

install_deps.shOutils d'installation (par exemplepdftotext).

2. installation via un script de ligne de commande (recommandé)

Saisissez-le dans le terminal :

curl -fsSL https://raw.githubusercontent.com/dontizi/rlama/main/install.sh | sh

- Le script achève automatiquement le téléchargement et la configuration et, une fois terminé, exécute la commande

rlama --versionVérifiez la version (par exemplev0.1.0) Confirmation du succès.

3. installation manuelle du code source (optionnel)

Si une personnalisation est nécessaire :

- Entrepôt de clonage :

git clone https://github.com/DonTizi/rlama.git cd rlama - Compiler et installer (environnement Go requis) :

go build go install - Déplacer l'exécutable dans le PATH (par ex.

/usr/local/bin), exécuterrlama --helpValidation.

4. vérification de l'installation

La course à pied :

rlama --help

L'affichage d'une liste de commandes est considéré comme réussi.

Principales fonctions

Création d'un système RAG à partir de la ligne de commande

Convertir les documents en une base de connaissances intelligente. Par exemple, le dossier ./docs incorporer readme.md répondre en chantant guide.pdf: :

- S'assurer que le modèle Ollama fonctionne (par ex.

ollama run llama3). - Entrez la commande :

rlama rag llama3 mydocs ./docsllama3Nom du modèle.mydocsNom du système : nom du système RAG../docs: Chemin d'accès au document.

- Exemple de sortie :

Indexing documents in ./docs... Processed: readme.md Processed: guide.pdf RAG system "mydocs" created successfully!

Questions et réponses interactives via la ligne de commande

Se renseigner sur les systèmes RAG existants :

- Démarrer la session :

rlama run mydocs - Saisissez la question :

如何安装 rlama? - Obtenir des réponses :

可通过终端运行 `curl -fsSL https://raw.githubusercontent.com/dontizi/rlama/main/install.sh | sh` 安装。 - importation

exitSortie.

Gestion du système RAG

- Système d'inscription: :

rlama listExemple de sortie :

Available RAG systems: - mydocs - Suppression du système: :

rlama delete mydocsou sauter la confirmation :

rlama delete mydocs --force

Versions et mises à jour

- Vérifier la version: :

rlama --versionpeut-être

rlama -vL'affichage est le suivantv0.1.0. - Mise à jour du système: :

rlama update(botanique) coca (mot emprunté)

--forceMises à jour obligatoires.

Désinstallation du système

- Outils de suppression: :

rlama uninstall - Nettoyage des donnéesLes données sont stockées dans le

~/.rlamaLa course à pied :rm -rf ~/.rlama

Fonctions vedettes

1. opérations en ligne de commande

Toutes les fonctions de rlama sont implémentées via la ligne de commande, ce qui est simple et efficace. Par exemple, une ligne de commande rlama rag mistral docs ./project Indexation instantanée de dossiers entiers, adaptée aux utilisateurs maîtrisant la ligne de commande.

2. prise en charge des documents multiformats

Plusieurs types de fichiers sont pris en charge :

- Texte :

.txt,.md,.html,.json,.csvetc. - Code :

.go,.py,.js,.java,.cppetc. - Documentation :

.pdf,.docx,.pptx,.xlsxetc.

être en mouvement./scripts/install_deps.shSoutien renforcé. Exemple :

rlama rag gemma code-docs ./src

3. opération localisée

Les données sont traitées localement tout au long du processus, sans avoir recours à l'informatique en nuage, ce qui convient aux documents sensibles. Par exemple, l'indexation de documents d'entreprise confidentiels :

rlama rag llama3 contracts ./legal

Conseils et dépannage

- Commandement de précision: Saisir le paramètre complet, par exemple

rlama run mydocsplutôt qu'une sténographie pour garantir l'exactitude des données. - Question d'OllamaSi la connexion échoue, vérifiez le

http://localhost:11434La course à piedollama psVoir le statut. - Support de formatSi l'extraction échoue, lancez

install_deps.shInstaller la dépendance. - Mauvaise réponse: Confirmez que le document est indexé et essayez d'être plus précis sur le problème.

- appel (à l'aide)Les problèmes peuvent être soumis à GitHub Issues avec les commandes et les versions.

Grâce aux commandes ci-dessus, les utilisateurs peuvent rapidement maîtriser rlama, gérer les documents locaux et mettre en œuvre des questions-réponses intelligentes.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...