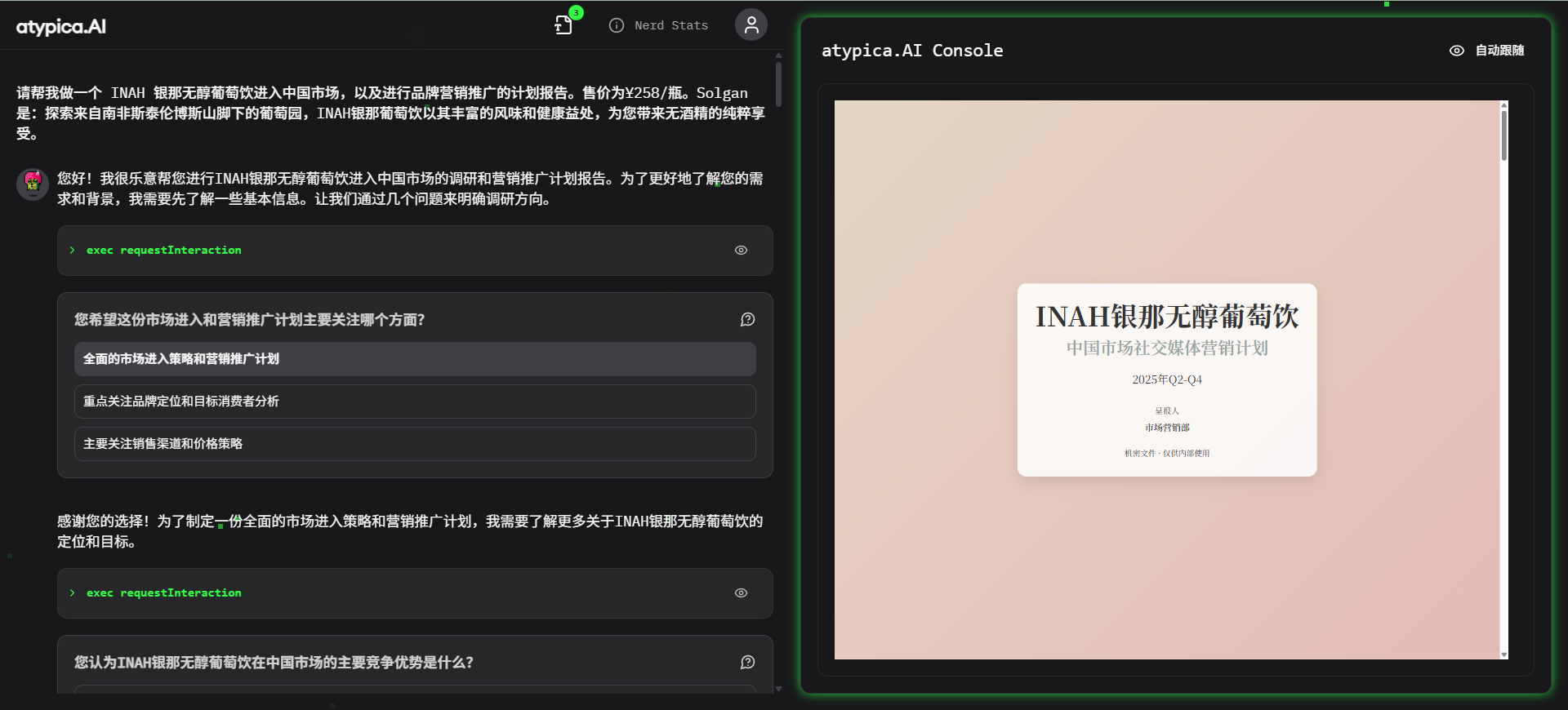

R1-V : Apprentissage par renforcement à faible coût pour la capacité de généralisation des modèles de langage visuel

Introduction générale

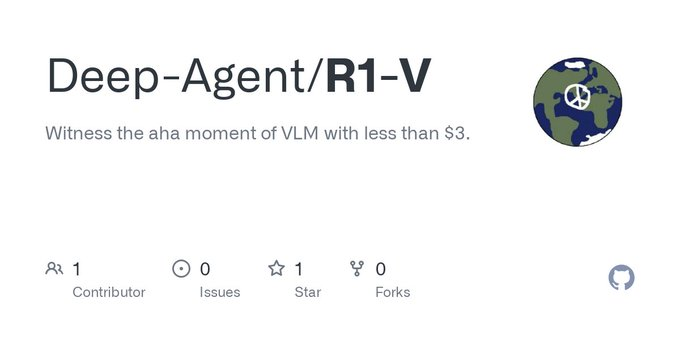

R1-V est un projet open source qui vise à réaliser des percées dans la modélisation du langage visuel (VLM) grâce à l'apprentissage par renforcement (RL) à faible coût. Le projet utilise un mécanisme de récompense vérifiable pour motiver les VLM à apprendre des capacités génériques de comptage. Étonnamment, le modèle 2B de R1-V surpasse un modèle 72B après seulement 100 étapes d'apprentissage, tout en coûtant moins de 3 dollars. L'ensemble du processus d'entraînement n'a pris que 30 minutes sur 8 GPU A100 pour un coût total de 2,62 dollars. Le projet R1-V est entièrement open source et les utilisateurs peuvent explorer le potentiel illimité de l'IA en expérimentant et en développant les modèles R1-V en accédant et en contribuant au code via la plateforme GitHub.

Liste des fonctions

- modèle de langage visuel: Combinaison d'images et de données textuelles pour le traitement et l'analyse.

- Apprentissage intensif: Amélioration de la généralisation des modèles grâce à des mécanismes de récompense vérifiables.

- Une formation peu coûteuseLes formations : une formation efficace en peu de temps et à moindre coût.

- apprentissage profondLes tâches complexes d'apprentissage profond et l'amélioration de la précision et de l'efficacité des modèles sont prises en charge par le programme.

- le traitement du langage naturel (NLP)La recherche sur la santé publique : Traitement et compréhension de textes en langue naturelle avec support multilingue.

- vision par ordinateurLe logiciel d'analyse d'images : il analyse et comprend le contenu des images et prend en charge des tâches telles que la classification d'images et la détection de cibles.

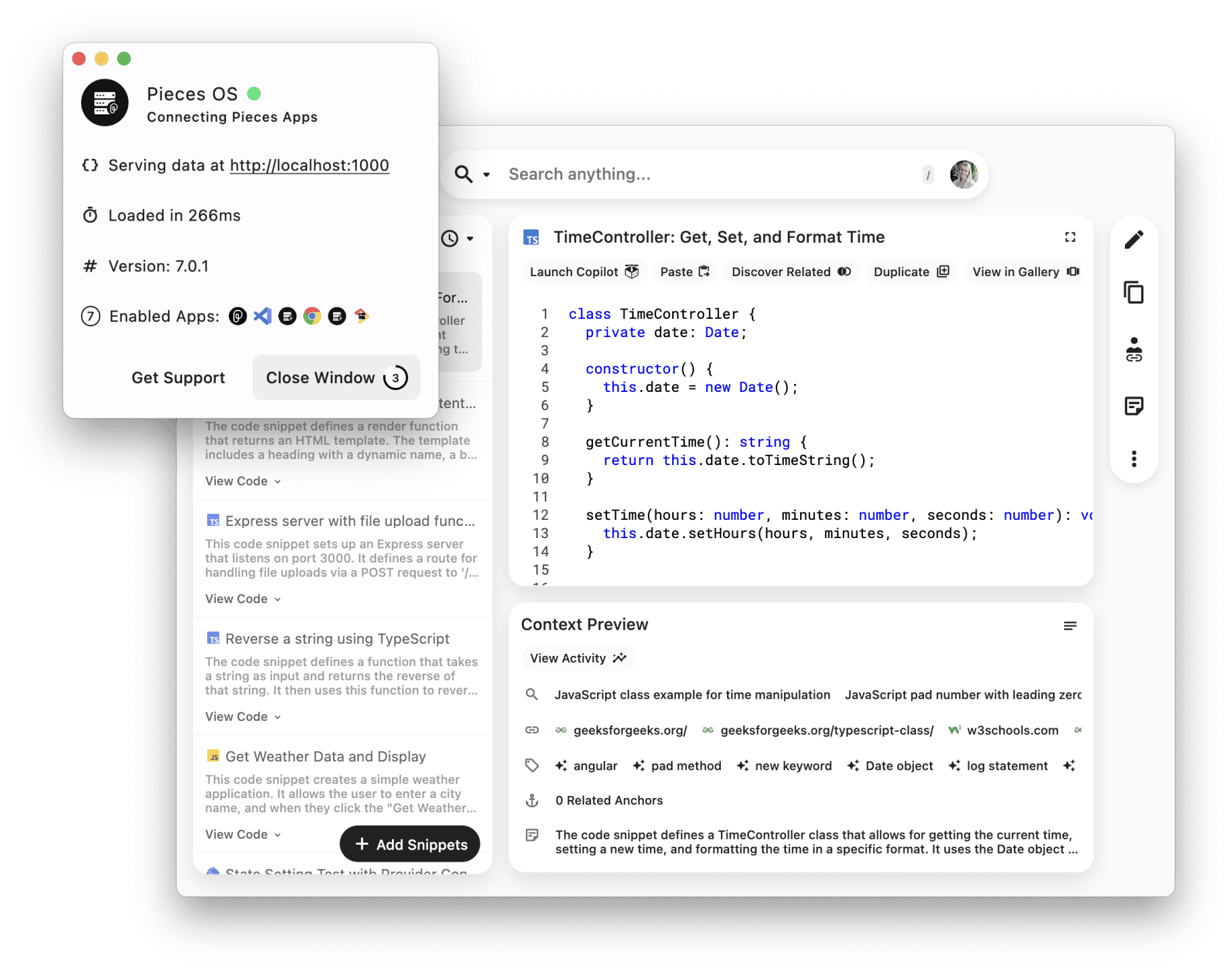

- source ouverteLe code source complet est disponible pour faciliter le téléchargement, la modification et la contribution.

- Soutien communautaireLe site Web de l'Agence européenne pour l'environnement (AEE) : une communauté active de développeurs qui fournit une assistance technique et une plate-forme de communication.

Utiliser l'aide

Processus d'installation

- entrepôt de clonesLe projet doit être cloné : Exécutez la commande suivante dans un terminal pour cloner le référentiel du projet :

git clone https://github.com/Deep-Agent/R1-V.git

- Installation des dépendancesLe projet doit être installé dans le répertoire du projet et les dépendances nécessaires doivent être installées :

cd R1-V

pip install -r requirements.txt

- Environnement de configurationLes données de la base de données de l'entreprise sont utilisées dans le cadre d'un projet de recherche.

Utilisation

- Modèles de chargementChargement du modèle R1-V dans le code : Chargement du modèle R1-V dans le code : Chargement du modèle R1-V dans le code :

from r1v import R1VModel

model = R1VModel()

- Traitement des images et du texteLes modèles : Utiliser des modèles pour traiter des images et des données textuelles :

image_path = 'path/to/image.jpg'

text = '描述图像的文本'

result = model.process(image_path, text)

print(result)

- Modèles de formationLes modèles d'évaluation de la qualité de l'air : former le modèle selon les besoins pour qu'il s'adapte à une tâche spécifique :

model.train(data_loader)

Fonction détaillée du déroulement des opérations

- classification des imagesChargement de l'image : Chargement de l'image et utilisation du modèle pour la classification :

from PIL import Image

image = Image.open('path/to/image.jpg')

classification = model.classify(image)

print(classification)

- détection des cibles: Détection de cibles à l'aide de modèles :

detections = model.detect_objects(image)

for detection in detections:

print(detection)

- Génération de texte: Générer un texte descriptif à partir d'images :

description = model.generate_text(image)

print(description)© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...