"Abus de l'IA : 13 préoccupations majeures concernant la nouvelle orientation de la Chine en matière de gouvernance de l'IA

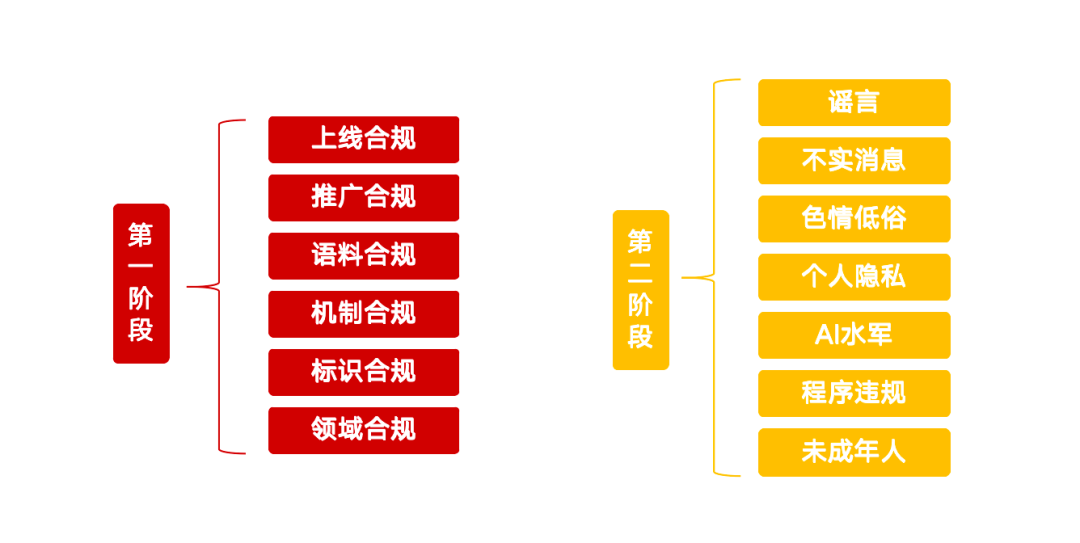

Récemment, le Bureau central des technologies de l'information sur Internet a lancé une action spéciale intitulée "Clear - Rectify the Abuse of AI Technology", qui trace une ligne rouge claire pour la gouvernance d'un certain nombre de questions qui ont surgi dans le développement actuel de l'intelligence artificielle. Cette initiative vise à guider le développement sain de la technologie de l'IA et à prévenir les risques potentiels. L'action spéciale se concentre sur 13 orientations clés et est divisée en deux phases, avec des exigences détaillées pour les produits, les services, le contenu et les normes comportementales de l'IA.

Phase I : Gouvernance et infrastructure des sources

La première phase de l'action se concentre sur la gestion de la source de la technologie d'IA, dans le but de nettoyer les applications d'IA offensantes, de renforcer la gestion de l'étiquetage du contenu et d'améliorer la capacité de la plateforme à détecter et à identifier les contrefaçons.

Les produits d'IA non conformes doivent faire l'objet d'une mise en conformité en ligne

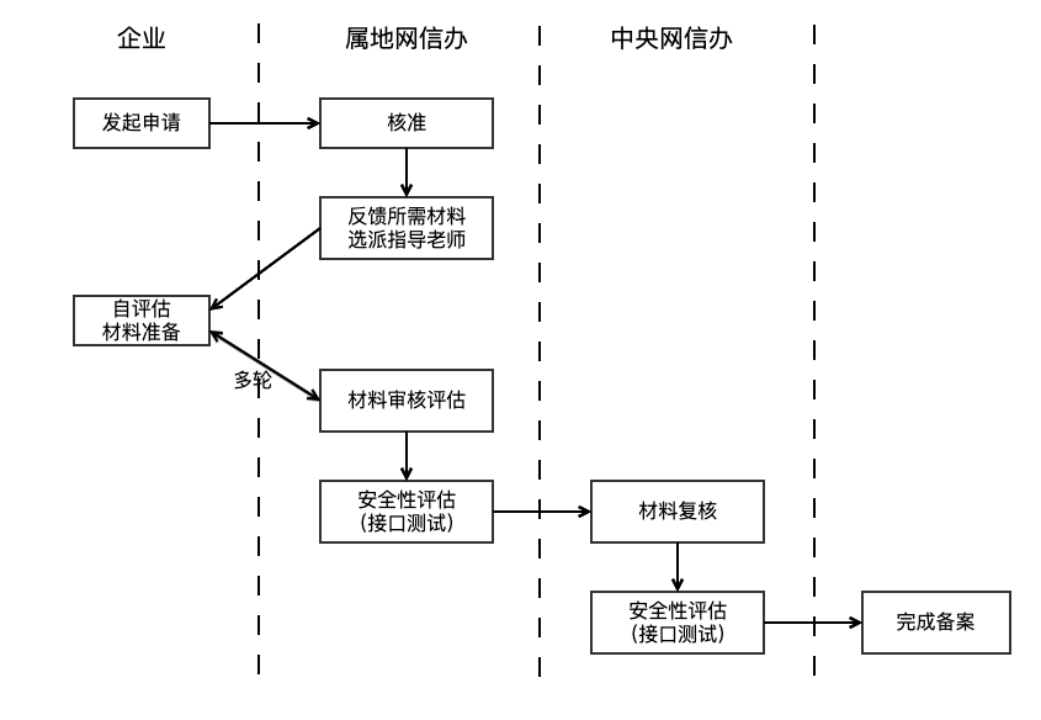

Le régulateur a noté que les applications qui utilisent la technologie de l'IA générative pour fournir des services au public doivent remplir la procédure de dépôt ou d'enregistrement d'un grand modèle. Cette exigence se fonde sur l'article 17 des mesures provisoires pour l'administration des services d'intelligence artificielle générative (ci-après dénommées "mesures provisoires"), qui précise que les produits d'intelligence artificielle doivent faire l'objet d'une évaluation de sécurité avant d'être officiellement lancés. Le cycle de dépôt prend généralement de trois à six mois. En outre, il est illégal de fournir des fonctions illégales et contraires à l'éthique, telles que le "déshabillage en un clic", ou de cloner ou de modifier les caractéristiques biométriques d'autres personnes (voix et visages, par exemple) sans autorisation.

L'identification et la réglementation des services d'IA non enregistrés sont devenues un défi. Les régulateurs peuvent utiliser des moyens techniques, tels que des robots d'indexation, pour surveiller diverses plateformes en déterminant si les services font appel à des interfaces API de type "big model" (par exemple, génération de dialogues, synthèse d'images) et leurs caractéristiques techniques. En ce qui concerne la conformité de la conception fonctionnelle, outre l'évaluation juridique interne des entreprises et les audits des boutiques d'applications, la réglementation des services de canaux informels repose actuellement davantage sur le signalement des plaintes des utilisateurs. Les prestataires de services doivent vérifier eux-mêmes si les produits d'IA ont fait l'objet d'un double dépôt (dépôt de modèles de grande taille et dépôt d'algorithmes) et s'assurer que la conception fonctionnelle est conforme aux spécifications.

Promotion de la conformité : répression des didacticiels et produits illégaux en matière d'IA

L'action spéciale se concentre également sur la promotion des produits d'IA. Les tutoriels qui enseignent l'utilisation de produits d'IA non conformes pour créer des vidéos de changement de visage et de voix, la vente de produits non conformes tels que les "synthétiseurs de voix" et les "outils de changement de visage", ainsi que la commercialisation et la promotion de produits d'IA non conformes sont tous inclus dans l'action corrective. Les promoteurs ont la responsabilité de vérifier la conformité des produits d'IA avant de choisir de les promouvoir. Les plateformes doivent renforcer la vérification du contenu, non seulement pour s'assurer que le contenu lui-même est légal, mais aussi pour avoir la capacité d'identifier et de vérifier la conformité des produits d'IA promus dans le contenu, par exemple, par le biais d'une vérification initiale des modèles sémantiques, complétée par une intervention manuelle.

Conformité du corpus : les sources et la gestion des données de formation en point de mire

La conformité des données d'entraînement est le fondement de la sécurité des modèles d'IA. L'article 7 des mesures provisoires souligne que les fournisseurs de services doivent utiliser des données et des modèles sous-jacents provenant de sources légitimes. Les exigences de base pour la sécurité des services d'IA générative (ci-après dénommées "exigences de base") sont encore plus précises et stipulent que si le corpus contient plus de 51 TP3T d'informations illégales et indésirables, la source ne doit pas être exploitée. Dans le même temps, la diversité des sources de données, les protocoles de source ouverte à suivre, les enregistrements des données récoltées par les utilisateurs eux-mêmes et les procédures légales pour l'acquisition de données commerciales sont tous clairement définis.

En raison de la confidentialité des données et de la confidentialité technique, la réglementation des corpus de formation est assez difficile et prend généralement la forme d'une interrogation et d'une preuve matérielle. Les entreprises sont également confrontées à de grands défis dans la gestion de quantités massives de données de formation avec des sources complexes et une qualité variable. Les exigences de base recommandent aux entreprises de combiner le filtrage par mot-clé, le filtrage par modèle de classification et l'échantillonnage manuel pour nettoyer les informations illégales et indésirables dans le corpus.

Conformité du mécanisme : mesures de gestion de la sécurité renforcées

Les entreprises doivent mettre en place des mécanismes de sécurité tels que l'audit de contenu et la reconnaissance d'intention adaptés à l'échelle de leur activité, ainsi qu'un processus de gestion efficace des comptes non conformes et un système d'auto-évaluation régulière de la sécurité. En ce qui concerne les services tels que les réponses automatiques de l'IA accessibles via des interfaces API, les plateformes sociales doivent être attentives et strictes. Le chapitre 7 des exigences de base impose aux fournisseurs de services de surveiller les données saisies par les utilisateurs et de prendre des mesures telles que la restriction des services pour les utilisateurs qui saisissent de manière répétée des informations illégales. En outre, les entreprises doivent disposer d'un personnel de supervision correspondant à l'échelle de leurs services, chargé de suivre les politiques et d'analyser les plaintes afin d'améliorer la qualité et la sécurité du contenu. Un mécanisme solide de contrôle des risques est une condition préalable au lancement de produits d'IA.

Conformité de l'étiquetage : mise en œuvre des exigences d'étiquetage pour le contenu généré par l'IA

Pour améliorer la transparence, les Mesures de marquage des contenus synthétiques générés par l'intelligence artificielle (ci-après dénommées "Mesures de marquage") stipulent que les fournisseurs de services sont tenus d'ajouter des marquages explicites ou implicites aux contenus profondément synthétisés et de veiller à ce que les marquages explicites soient inclus dans le fichier et que les marquages implicites soient ajoutés aux métadonnées lorsque l'utilisateur télécharge ou copie le fichier. Cette approche s'accompagne de la norme nationale "Network Security Technology Artificial Intelligence Generated Synthetic Content Identification Method", qui entrera en vigueur à partir du 1er septembre 2025. Les entreprises sont tenues de procéder à des autocontrôles sur la base de cette norme et de déployer des moyens techniques pour détecter les contenus générés par l'IA sur leurs plateformes et fournir des alertes en cas de contenu suspect. Les régulateurs peuvent également renforcer l'éducation des utilisateurs afin d'améliorer la reconnaissance par le public des contenus générés par l'IA.

Conformité des domaines : l'accent est mis sur les risques de sécurité dans les secteurs clés

Les produits d'IA qui ont été déposés pour fournir des services de questions et réponses dans des domaines clés tels que les soins de santé, la finance et les mineurs doivent mettre en place des audits de sécurité et des mesures de contrôle spécifiques à l'industrie. Empêcher le phénomène de "prescription de l'IA", d'incitation à l'investissement ou d'utilisation de "l'illusion de l'IA" pour tromper les utilisateurs. La gouvernance de la conformité dans ces domaines spécifiques est complexe et segmentée, nécessitant des connaissances d'experts du domaine et un corpus de conformité spécialisé. Les régulateurs du secteur et les grandes entreprises joueront un rôle clé dans l'établissement de normes et la mise en place de mesures de sécurité. Les solutions génériques comprennent la détection des hallucinations, l'approbation manuelle des opérations clés, etc. pour se prémunir contre le risque de perte de contrôle de l'IA.

Phase II : répression de l'utilisation de l'IA à des fins illégales et illicites

La deuxième phase de l'action spéciale se concentrera sur l'utilisation de la technologie de l'IA pour produire et diffuser des rumeurs, des informations inexactes, des contenus pornographiques et vulgaires, ainsi que pour usurper l'identité d'autres personnes et se livrer à des activités de cybersquade.

Lutter contre l'utilisation de l'IA pour créer et publier des rumeurs

Le champ d'application de la remédiation comprend la fabrication de rumeurs liées aux affaires courantes et aux moyens de subsistance des personnes à partir de rien, l'interprétation malveillante des politiques, la fabrication de détails sur la base d'urgences, la présentation d'informations officielles, ainsi que l'orientation malveillante en exploitant le biais cognitif de l'IA. La plateforme commune chinoise de dissipation des rumeurs sur Internet fonctionne depuis longtemps, mais à l'ère de l'IA, la réduction du coût de production des rumeurs et l'augmentation de leur fidélité posent un nouveau défi en matière de gouvernance. La réglementation repose principalement sur la surveillance de l'opinion publique et les rapports des utilisateurs, et les sanctions pour les rumeurs liées à l'IA dans des domaines clés pourraient être renforcées. Les fournisseurs de services doivent améliorer leur capacité à détecter les rumeurs générées par l'IA, notamment en utilisant des outils d'IA pour calibrer l'exactitude du contenu, en surveillant les comportements anormaux des comptes et en vérifiant manuellement le contenu des points chauds.

Nettoyer l'utilisation de l'IA pour produire et publier des informations inexactes

Il s'agit notamment d'assembler et d'éditer des graphiques et des vidéos sans rapport les uns avec les autres pour générer des informations mixtes, de brouiller et de modifier des éléments factuels, de reprendre de vieilles nouvelles, de publier des contenus exagérés ou pseudo-scientifiques liés à des domaines professionnels, de répandre des superstitions à l'aide de la divination et de la cartomancie par IA, etc. Comparées aux rumeurs, les informations inexactes peuvent être moins subjectives et malveillantes, mais leur nature cachée et leur impact potentiel ne peuvent être ignorés. La gouvernance s'appuie principalement sur les plateformes de contenu pour renforcer la construction écologique, identifier les contenus de mauvaise qualité par des moyens techniques et prendre des mesures pour restreindre la diffusion des contenus et des créateurs pertinents ou imposer des sanctions.

Rectification de l'utilisation de l'IA pour produire et diffuser des contenus pornographiques et vulgaires

L'utilisation de l'IA pour générer des images et des vidéos pornographiques ou indécentes, telles que le "déshabillage en un clic" et le dessin par l'IA, ainsi que la production de pornographie douce, d'images pornographiques de deuxième génération, de violence sanglante, d'images grotesques et de "petit texte jaune", font toutes l'objet de mesures de répression. Si la technologie de l'IA améliore l'efficacité de la production de contenu, elle peut également être utilisée à mauvais escient pour créer ce type de contenu indésirable. Les méthodes traditionnelles de vérification, telles que les bibliothèques de mots clés, les modèles sémantiques et la classification des images ("modèles d'identification de la pornographie"), sont relativement mûres pour identifier les contenus générés par les utilisateurs (CGU). Toutefois, la distribution des caractéristiques des contenus générés par l'IA peut être différente de celle des contenus générés par les utilisateurs, et les fournisseurs de services doivent veiller à mettre à jour les données d'entraînement des modèles afin de maintenir la précision de l'identification.

Enquêter et traiter l'utilisation de l'IA pour usurper l'identité d'autres personnes afin de commettre des infractions

Des actes tels que l'usurpation de l'identité de personnalités publiques par le biais de l'IA (échange de visages, clonage de voix et autres techniques de falsification approfondies) à des fins de tromperie ou de profit, l'usurpation et le discrédit de personnalités publiques ou historiques, l'utilisation de l'IA pour usurper l'identité d'amis et de parents à des fins de fraude, ainsi que l'utilisation inappropriée de l'IA pour "ressusciter les morts" et l'utilisation abusive d'informations sur les morts, font tous l'objet d'une remédiation. Ces risques découlent de la fuite et de l'utilisation abusive de données relatives à la vie privée. Il est important de sensibiliser le public à la protection de la vie privée et, à long terme, de mettre en place un mécanisme de traçabilité des données pour garantir le respect de la législation tout au long de la chaîne des données.

Lutter contre l'utilisation de l'IA pour des activités cyber-mercenaires

L'"armée de l'eau de l'IA" est une nouvelle variante de l'armée de l'eau du réseau. L'utilisation de la technologie de l'IA pour "élever" l'enregistrement et le fonctionnement en masse des comptes sociaux, l'utilisation de fermes de contenu de l'IA ou de lavage de manuscrits de l'IA pour générer du contenu homogénéisé de faible qualité en masse afin de balayer le flux, ainsi que l'utilisation de logiciels de contrôle de groupe de l'IA, de robots sociaux pour balayer la quantité de contrôle et d'évaluation et d'autres comportements seront sévèrement réprimées. La gouvernance doit commencer par les deux dimensions du contenu et du compte, en détectant le contenu de faible qualité et AIGC au sein de la plateforme, en surveillant les caractéristiques comportementales des comptes qui publient du contenu AIGC, et en automatisant une intervention rapide pour augmenter le coût des actes malveillants de l'armée de l'eau.

Réglementer le comportement des services et des applications des produits d'IA

La production et la diffusion de sites web et d'applications d'IA contrefaits et fictifs, la fourniture de fonctions non conformes par des applications d'IA (par exemple, la fourniture de "recherche rapide et d'extension de liste rapide" par des outils de création), la fourniture de services de dialogue vulgaire et de pornographie douce par des logiciels de dialogue social d'IA, ainsi que la vente et la promotion d'applications, de services ou de cours d'IA non conformes qui détournent les gens de l'utilisation des produits d'IA, sont toutes couvertes par le champ d'application de la mesure corrective. Cette dernière met à nouveau l'accent sur la conformité du lancement et de la diffusion des produits d'IA et ajoute la définition de la "coquille" et des fonctions illégales. Les prestataires de services devraient s'en tenir à l'objectif initial de la technologie, qui est de servir les gens.

Protection des droits et des intérêts des mineurs contre l'IA

Les modèles d'IA sont basés sur des statistiques probabilistes et le contenu qu'ils génèrent est imprévisible, ce qui peut produire des valeurs erronées et poser un risque potentiel pour la croissance des mineurs. Par conséquent, l'application de l'IA dans les scénarios d'éducation des mineurs nécessite une prudence accrue et un contrôle strict de l'utilisation des scénarios ; dans d'autres produits avec lesquels les mineurs entrent fréquemment en contact, le mode mineur doit être renforcé et les droits d'application de l'IA doivent être restreints.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...