Open WebUI : Interface Web de chat AI hébergée localement

Introduction générale

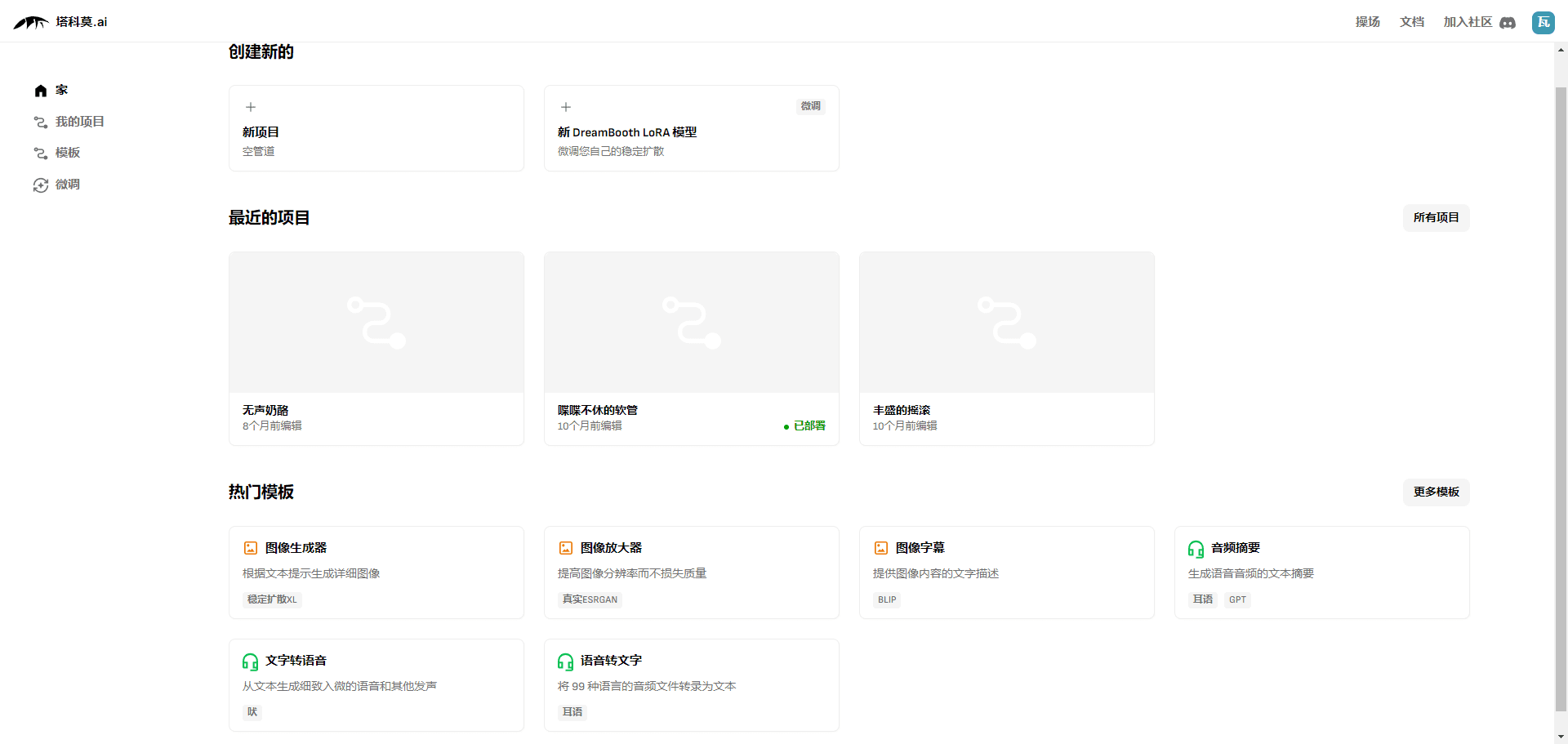

Open WebUI (anciennement connu sous le nom d'Ollama WebUI) est une interface utilisateur interactive AI conviviale conçue pour les LLM (Large Language Models). Elle est évolutive, riche en fonctionnalités et fonctionne complètement hors ligne. les caractéristiques exceptionnelles d'Open WebUI comprennent la conception d'une interface bavarde, une réactivité élevée, une installation facile à l'aide de Docker ou Kubernetes, la mise en évidence du code, la prise en charge de Markdown et LaTeX, l'intégration RAG locale et distante, la fonctionnalité d'appel vocal/vidéo, l'intégration de la génération d'images, et bien d'autres encore ! et bien d'autres choses encore.

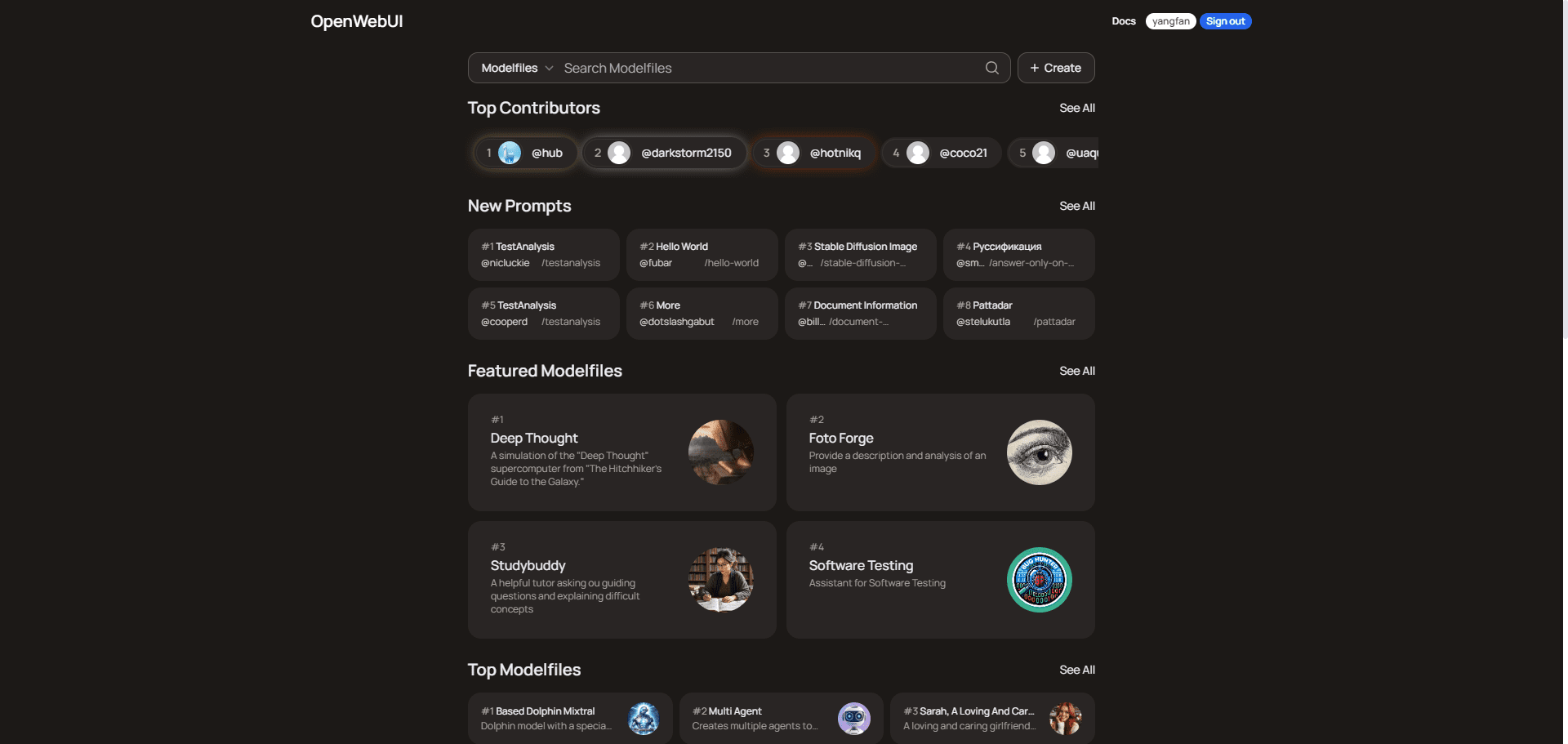

A propos d'OpenWebUI :

OpenWebUI est une plateforme communautaire d'utilisateurs qui fournit des fichiers modèles polyvalents couvrant la programmation, l'écriture, la productivité, l'éducation, les affaires et l'analyse de données. Les utilisateurs peuvent explorer et télécharger ces fichiers modèles pour améliorer l'efficacité de leurs tâches et de leurs projets. La plateforme compte plus de 15 000 utilisateurs et est basée sur le classement des contributeurs et sur le partage de journaux de discussion intelligents pour la communication et l'apprentissage.

Pour la méthode de déploiement en nuage libre, veuillez vous référer à Déploiement d'un ensemble personnalisé d'outils de chat miniatures sur des ordinateurs à profil bas Voici une description du déploiement d'Open WebUI par Koyeb.

Liste des fonctions

- Une installation sans failleLes fonctionnalités suivantes sont disponibles : installation facile via Docker ou Kubernetes, avec prise en charge d'Ollama et d'images étiquetées CUDA.

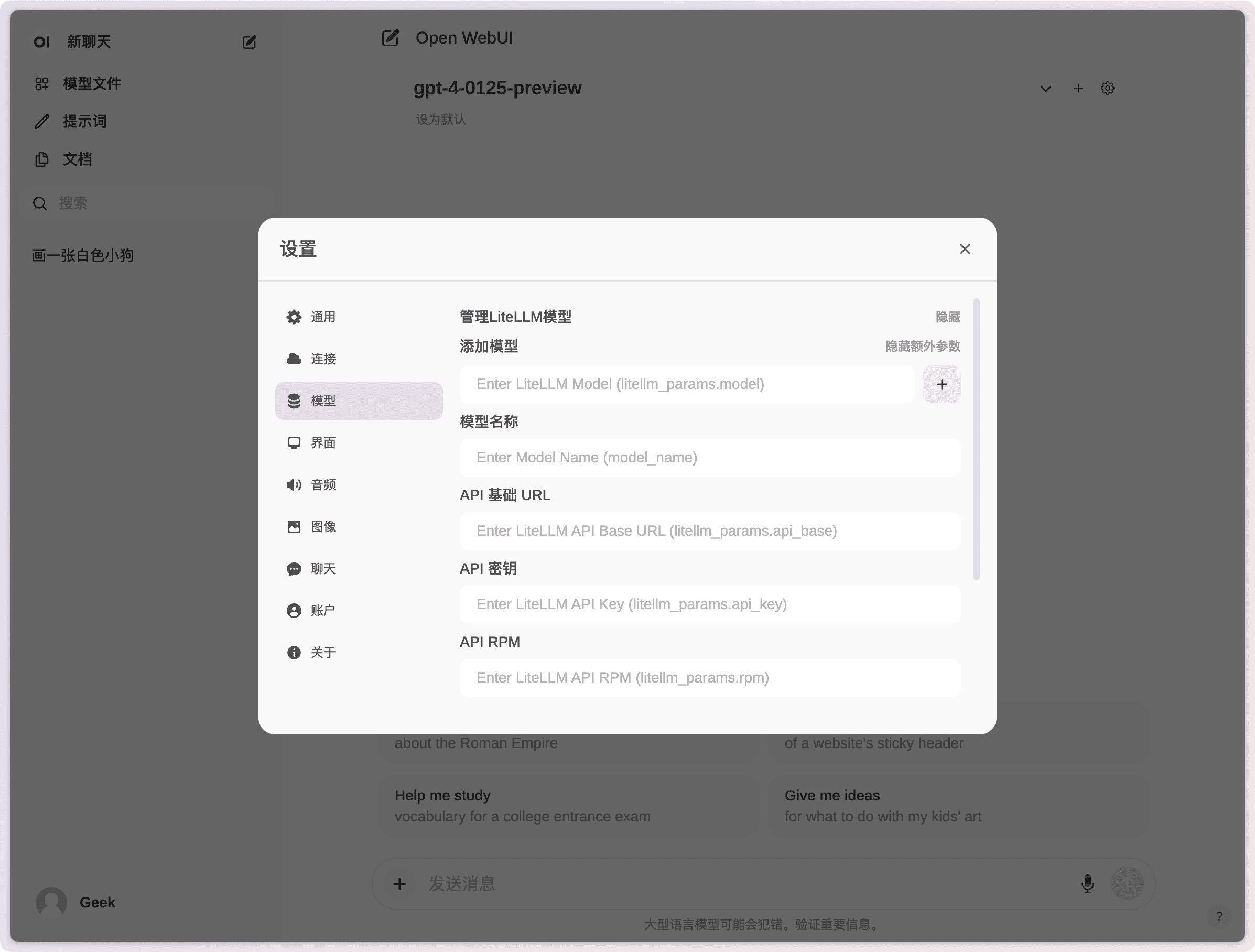

- Intégration de l'APILes modèles de dialogue : intégration facile avec les API compatibles avec OpenAI et prise en charge de plusieurs modèles de dialogue.

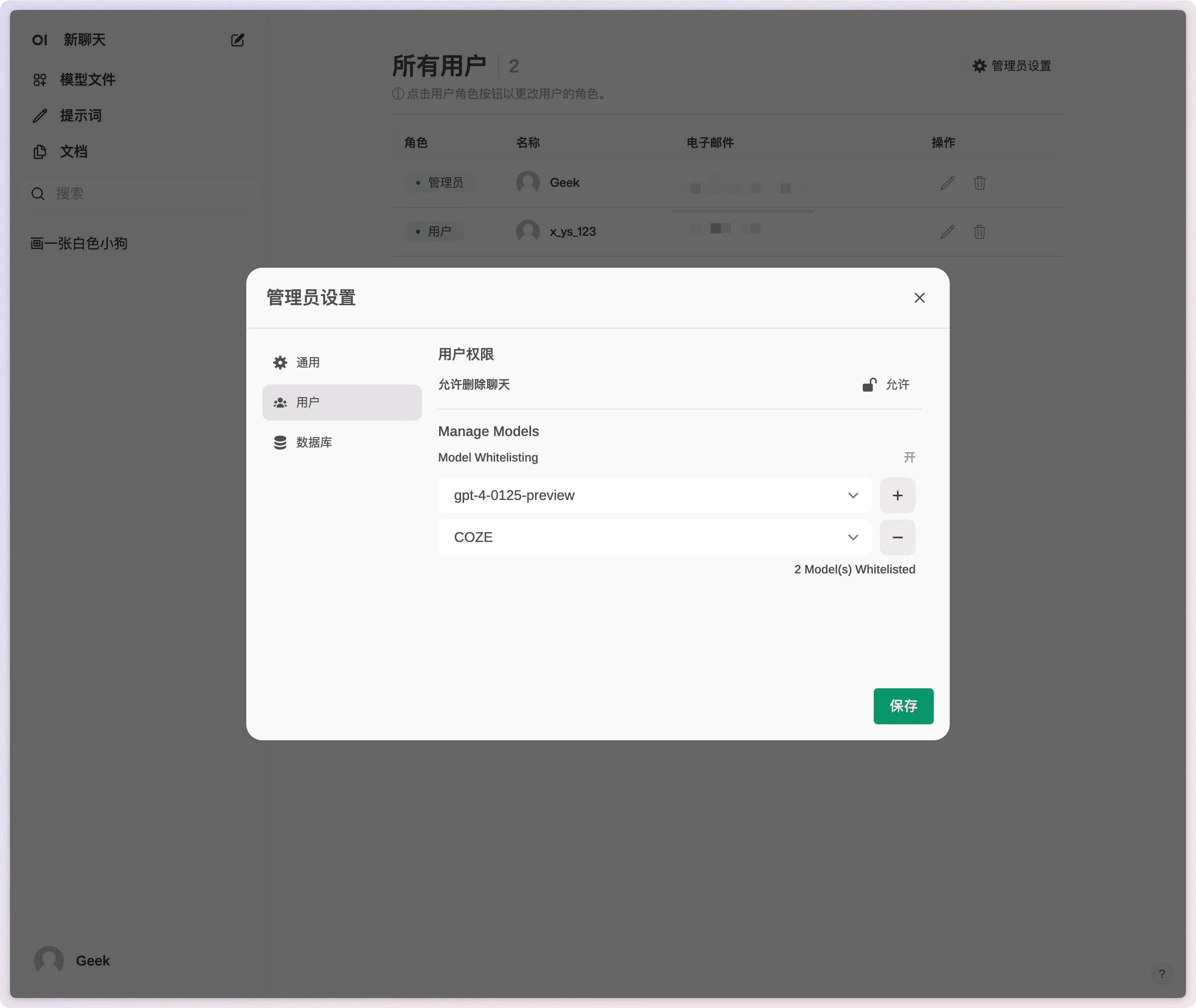

- Autorisations et groupes d'utilisateurs à granularité fineLes administrateurs peuvent créer des rôles et des autorisations détaillés pour les utilisateurs afin de garantir un environnement sécurisé.

- conception réactiveLes services d'information et de communication (SIP) : Profitez d'une expérience transparente sur les ordinateurs de bureau, les ordinateurs portables et les appareils mobiles.

- Applications web progressives (PWA)Les services d'aide à la décision : Ils offrent une expérience similaire à celle d'une application native sur les appareils mobiles et permettent l'accès hors ligne.

- Prise en charge de Markdown et LaTeXLes fonctionnalités Markdown et LaTeX permettent d'améliorer l'expérience interactive.

- Appels vocaux/vidéoLes appels vidéo et les appels vocaux mains libres sont intégrés pour un environnement de discussion plus dynamique.

- constructeur de modèlesLes modèles Ollama : Créez facilement des modèles Ollama et ajoutez des rôles/agents personnalisés via l'interface Web.

- Intégration locale du RAGPrise en charge de Retrieval Augmented Generation (RAG) pour intégrer de manière transparente l'interaction avec les documents dans l'expérience de chat.

- Intégration de la génération d'imagesLa version anglaise du logiciel : Supports AUTOMATIC1111 API, ComfyUI et OpenAI's DALL-E pour enrichir l'expérience de chat.

- dialogue multimodèleLe modèle de l'utilisateur : Il interagit avec plusieurs modèles en même temps, en tirant parti de leurs points forts respectifs pour fournir la meilleure réponse possible.

- Contrôle d'accès basé sur les rôles (RBAC)Les accès sont sécurisés, seules les personnes autorisées ayant accès à Ollama et aux permissions de création et d'extraction de modèles.

- Prise en charge multilingueLes utilisateurs peuvent choisir leur langue préférée grâce à la prise en charge de l'internationalisation.

- Support de plug-inLes fonctionnalités suivantes sont disponibles : intégration transparente d'une logique personnalisée et de bibliothèques Python grâce au cadre de plugins Pipelines.

Utiliser l'aide

Processus d'installation

Installation avec Docker

- Tirer les miroirsPour ce faire, vous devez exécuter la commande suivante dans un terminal pour extraire la dernière image Docker Open WebUI du registre de conteneurs de GitHub :

docker pull ghcr.io/open-webui/open-webui:main - Exécution des conteneursLe conteneur doit être exécuté avec les paramètres par défaut afin de garantir la persistance du stockage des données :

docker run -d -p 3000:8080 -v open-webui:/app/backend/data --name open-webui ghcr.io/open-webui/open-webui:main- cartographie des volumesLes données sont stockées de manière persistante afin d'éviter toute perte de données en cas de redémarrage du conteneur.

- cartographie des portsL'interface WebUI s'ouvre sur le port 3000 de la machine locale.

Installation avec Python

- Installation d'Open WebUIPour ce faire, vous devez utiliser Python 3.11 afin d'éviter tout problème de compatibilité. Exécutez la commande suivante dans le terminal :

pip install open-webui - Exécution de l'Open WebUIUne fois l'installation terminée, exécutez la commande suivante pour démarrer Open WebUI :

open-webui serveCela démarrera le serveur Open WebUI, que vous trouverez à l'adresse http://localhost:8080访问.

Guide d'utilisation des fonctions

Appels vocaux/vidéo

- lancer un appelAppel vocal : Cliquez sur le bouton Appel vocal ou vidéo dans l'écran de chat pour sélectionner un contact et démarrer l'appel.

- contrôle des appelsPendant un appel, vous pouvez utiliser les boutons de commande de l'interface pour couper le son et raccrocher.

Génération d'images

- Sélectionner l'outil Générateur d'imagesPour cela, sélectionnez AUTOMATIC1111 API, ComfyUI ou OpenAI's DALL-E dans l'écran de chat.

- Description de l'entréeLa description de l'image : Saisissez la description de l'image dans le champ de saisie et cliquez sur le bouton Générer.

- Voir les résultatsL'image générée sera affichée dans l'interface de discussion et pourra être sauvegardée ou partagée par l'utilisateur.

Intégration locale du RAG

- Chargement des documentsPour charger des documents ou ajouter des fichiers à la bibliothèque de documents, utilisez la commande # dans l'interface de dialogue en ligne.

- récupérerLe système récupère automatiquement les informations pertinentes dans les documents chargés et génère une réponse.

problèmes courants

- problème de connectivitéSi vous rencontrez des problèmes de connexion, assurez-vous que le conteneur Docker a accès au serveur Ollama. Utilisez la commande suivante pour le résoudre :

docker run -d --network=host -v open-webui:/app/backend/data -e OLLAMA_BASE_URL=http://127.0.0.1:11434 --name open-webui --restart always ghcr.io/open-webui/open-webui:main - Mise à jour de l'installation DockerPour plus d'informations sur la mise à jour de votre installation Docker locale, consultez le site Watchtower :

docker run --rm --volume /var/run/docker.sock:/var/run/docker.sock containrrr/watchtower --run-once open-webui

Déployer Open WebUI en un clic chez Cuddleface

https://codeberg.org/fossandroid/Open-WebUI.git

https://linux.do/t/topic/274417

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...