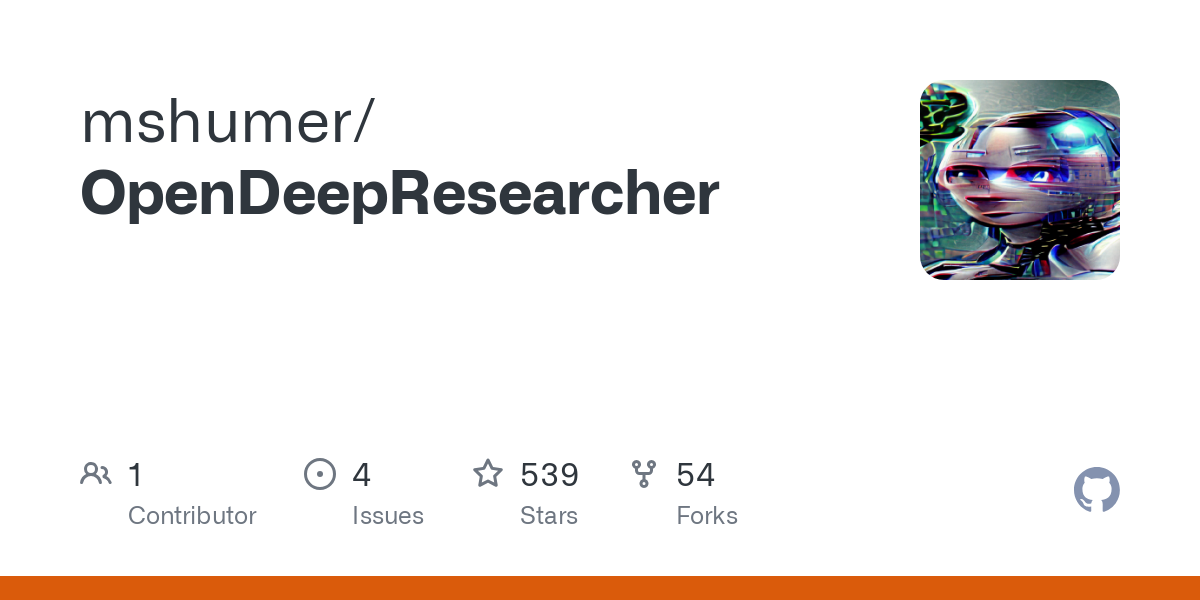

OpenDeepResearcher : outil automatisé de recherche approfondie pour rédiger des rapports de recherche complets

Introduction générale

OpenDeepResearcher est un outil open source de recherche approfondie automatisée conçu pour améliorer l'efficacité de la recherche grâce à des techniques d'intelligence artificielle. Le projet a été développé par mshumer et est hébergé sur GitHub. Le projet a été développé par mshumer et est hébergé sur GitHub. OpenDeepResearcher s'appuie sur une variété de services et de technologies, y compris SERPAPI, Jina et OpenRouter, pour effectuer des recherches sur Google, l'extraction de contenu web et l'analyse contextuelle. Sa fonction principale est d'optimiser en permanence les requêtes de recherche par le biais d'une boucle de recherche itérative jusqu'à ce que le système soit convaincu d'avoir rassemblé toutes les informations nécessaires. L'outil prend également en charge le traitement asynchrone, le filtrage itératif et la prise de décision basée sur le LLM, garantissant ainsi l'efficacité et l'exhaustivité du processus de recherche.

Liste des fonctions

- Cycle de recherche itératifLe système optimise la requête de recherche par plusieurs itérations afin de garantir une collecte d'informations complète.

- traitement asynchroneLa recherche, l'extraction de pages web, l'évaluation et l'extraction contextuelle sont effectuées simultanément pour augmenter la vitesse.

- Filtre de duplicationLes liens sont agrégés et dédupliqués à chaque itération afin d'éviter le traitement en double des mêmes liens.

- Décisions de conduite pour le LLMLes résultats de l'étude ont été publiés dans un rapport de la Commission européenne sur l'état d'avancement de la mise en œuvre de la politique de l'Union européenne en matière d'environnement et de développement durable.

- Interface GradioLe système de gestion de l'information : il offre une interface utilisateur fonctionnelle et facile à utiliser.

Utiliser l'aide

Processus d'installation

- Cloner ou ouvrir l'ordinateur portableTélécharger le fichier du carnet de notes ou directement à l'adresse suivante Google Colab Ouvrir en.

- Installer le nidasyncioLa première cellule à mettre en place le nidasyncio.

- Configuration des clés API: Remplace les valeurs de remplacement dans le carnet par la clé d'API réelle, y compris les valeurs de remplacement de la clé d'API. OPENROUTERAPICLÉ, SERPAPIAPIKEY et JINAAPICLÉ.

Étapes d'utilisation

- Cellules du carnet de notes en cours d'exécution: Exécute toutes les cellules de manière séquentielle. Le bloc-notes demande une requête/un sujet de recherche et un nombre maximum d'itérations (10 par défaut).

- Génération d'une requête et d'une recherche initialesLe bloc-notes utilise LLM pour générer la requête de recherche initiale.

- Recherche et extraction asynchronesLes recherches SERPAPI sont effectuées en parallèle, en regroupant les liens uniques et en traitant chaque lien en parallèle afin de déterminer l'utilité de la page et d'extraire le contexte pertinent.

- Optimisation itérativeAprès chaque tour, LLM analyse le contexte de l'agrégation et décide si d'autres requêtes de recherche sont nécessaires.

- Produire un rapport finalLorsque le LLM indique qu'il n'est plus nécessaire de poursuivre les recherches (ou que la limite d'itération a été atteinte), un rapport final est généré sur la base de tous les contextes collectés.

- Voir le rapport finalLe rapport de synthèse final sera imprimé dans la sortie.

Procédure d'utilisation détaillée

- Génération d'entrées et de requêtesL'utilisateur saisit un sujet de recherche et LLM génère jusqu'à quatre requêtes de recherche différentes.

- Recherche et traitement simultanésChaque requête de recherche est envoyée à SERPAPI en même temps.

- diminuer l'importance: Agréger et dédupliquer tous les liens récupérés dans l'itération en cours.

- extraction contextuelleLes liens : traiter chaque lien pour déterminer l'utilité de la page et en extraire le contexte pertinent.

- Optimisation itérativeLe système d'agrégation des données : analyse le contexte de l'agrégation et décide s'il est nécessaire d'effectuer d'autres recherches.

- Production du rapport finalLe rapport final consolidé est établi sur la base de tous les contextes de collecte.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Postes connexes

Pas de commentaires...