OpenAI publie une nouvelle génération d'API de modèles audio, une amélioration majeure de la technologie d'interaction vocale

OpenAI a récemment annoncé le lancement de sa nouvelle génération d'API de modélisation audio, conçue pour permettre aux développeurs de créer des assistants vocaux plus puissants et plus intelligents. Cette initiative est considérée comme une avancée majeure dans le domaine de la technologie de l'interaction vocale, indiquant que l'interaction vocale entre l'homme et l'ordinateur entrera dans une nouvelle phase plus naturelle et plus efficace.

Cette version comprend deux mises à jour essentielles : un modèle de synthèse vocale plus avancé et un modèle de synthèse vocale plus expressif, qui, selon OpenAI, établit une nouvelle référence en matière de précision et de fiabilité, en particulier dans des scénarios difficiles avec des accents complexes, des environnements bruyants et des vitesses d'élocution variables. Les améliorations de performance sont particulièrement significatives dans les scénarios difficiles, tels que les accents complexes, les environnements bruyants et les vitesses d'élocution variables. Cela signifie que le nouveau modèle améliorera considérablement la qualité et l'efficacité de la transcription dans des applications telles que les centres d'appels clients et la transcription des comptes rendus de réunions.

En particulier, pour la première fois, OpenAI permet aux développeurs d'ordonner aux modèles de synthèse vocale de parler d'une certaine manière. Par exemple, les développeurs peuvent configurer le modèle pour qu'il "parle comme un agent de service à la clientèle empathique", ce qui donne aux assistants vocaux des possibilités de personnalisation sans précédent. Cette capacité ouvre de nouvelles portes pour toute une série de scénarios, allant d'un service client plus humain à une narration créative plus expressive.

OpenAI a lancé son premier modèle audio, Whisper, en 2022 et a continué à investir dans l'amélioration de l'intelligence, de la précision et de la fiabilité du modèle depuis lors. La publication d'un nouveau modèle audio est le point culminant de cet effort de longue haleine. Les développeurs peuvent désormais créer des systèmes de synthèse vocale plus précis, ainsi que des sons de synthèse vocale plus distinctifs et plus vivants par le biais de l'API.

Une nouvelle génération de modèles de conversion de la parole au texte : gpt-4o-transcribe et gpt-4o-mini-transcribe

OpenAI a publié deux nouveaux modèles, gpt-4o-transcribe et gpt-4o-mini-transcribe, qui sont des modèles plus récents que les précédents. Chuchotement ils montrent des améliorations significatives dans le taux d'erreur de mots (WER), la reconnaissance de la langue et la précision.

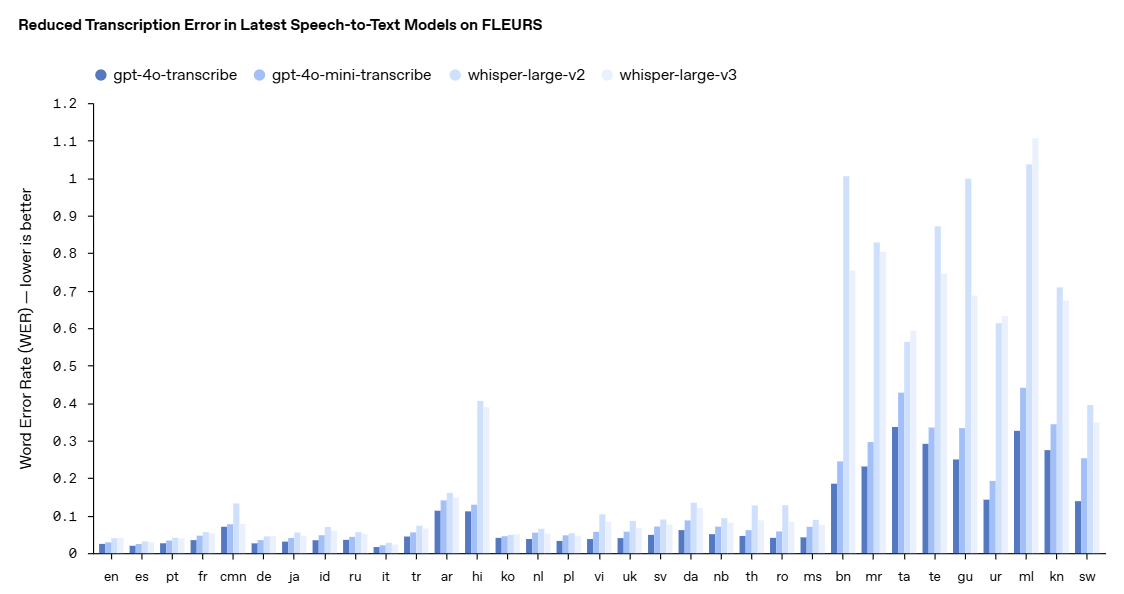

- Le taux d'erreur sur les mots (WER) mesure la précision d'un modèle de reconnaissance vocale en calculant le pourcentage de mots incorrectement transcrits par rapport à une transcription de référence - plus le WER est bas, mieux c'est, moins il y a d'erreurs. Notre dernier modèle de conversion de la parole au texte atteint un faible WER dans divers tests de référence, notamment FLEURS (Learning Evaluation of Speech Universal Representation with Small Samples) - un test de référence multilingue qui couvre plus de 100 langues à l'aide d'échantillons audio retranscrits manuellement. Ces résultats démontrent une plus grande précision de transcription et une meilleure couverture linguistique. Comme nous le montrons ici, notre modèle surpasse systématiquement Whisper v2 et Whisper v3 dans toutes les évaluations linguistiques.

gpt-4o-transcribe a démontré que le taux d'erreur sur les mots était supérieur à celui du modèle Whisper sur un certain nombre de points de référence faisant autorité. Le taux d'erreur sur les mots est une mesure clé de la précision d'un modèle de reconnaissance vocale, des valeurs plus faibles représentant moins d'erreurs. OpenAI affirme que ces améliorations résultent d'innovations ciblées en matière d'apprentissage par renforcement et d'entraînement intérimaire à grande échelle utilisant des ensembles de données audio diversifiés et de haute qualité.

Par conséquent, les nouveaux modèles de conversion de la parole au texte sont mieux à même de saisir les nuances de la parole, de réduire les erreurs de reconnaissance et d'améliorer la fiabilité de la transcription, en particulier dans des situations complexes telles que les accents, les environnements bruyants et les vitesses d'élocution variables. Ces modèles peuvent désormais être utilisés dans l'API de conversion de la parole au texte.

Pour démontrer l'amélioration des performances de manière plus visuelle, OpenAI cite FLEURS (Few-shot Learning Evaluation of Universel Résultats du benchmark FLEURS (Representations of Speech), un benchmark multilingue couvrant plus de 100 langues et utilisant des échantillons audio transcrits manuellement. Les résultats montrent que le nouveau modèle d'OpenAI a des taux d'erreurs de mots inférieurs à ceux de Whisper v2 et Whisper v3 dans les évaluations inter-langues, ce qui démontre une plus grande précision de transcription et une couverture linguistique plus large.

Une nouvelle génération de modèles de synthèse vocale : gpt-4o-mini-tts

Outre le modèle de synthèse vocale, OpenAI a également introduit le nouveau modèle de synthèse vocale gpt-4o-mini-tts, dont le point fort est sa plus grande contrôlabilité. Les développeurs peuvent non seulement contrôler ce que le modèle dit, mais aussi lui indiquer comment le dire. Cette capacité permet de personnaliser davantage l'expérience de l'utilisateur, avec des applications allant du service à la clientèle au contenu créatif. Le modèle est également disponible dans l'API de synthèse vocale. Notez que ces modèles de synthèse vocale sont actuellement limités à des voix synthétisées prédéfinies, qu'OpenAI contrôle pour s'assurer qu'elles sont cohérentes avec les préréglages synthétisés.

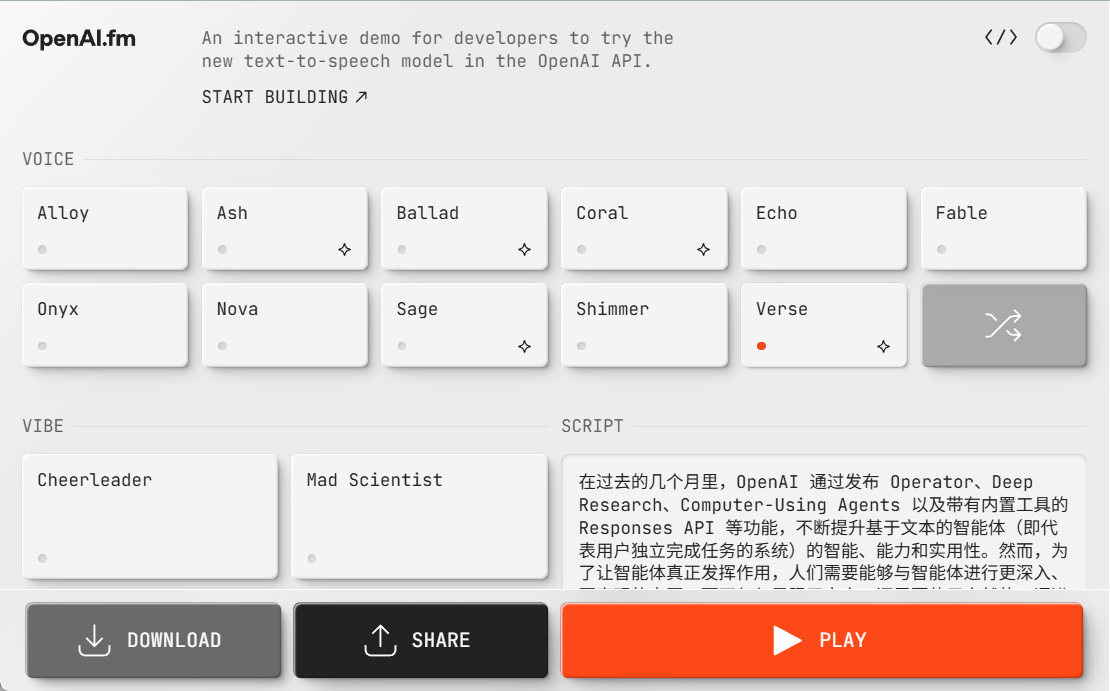

Découvrez rapidement les gpt-4o-mini-tts ici !

https://www.openai.fm/

L'innovation technologique à l'origine du modèle

OpenAI révèle que les nouveaux modèles audio sont construits sur les architectures GPT-4o et GPT-4o-mini et qu'ils ont été pré-entraînés à grande échelle en utilisant des ensembles de données spécifiquement orientés vers l'audio, ce qui est essentiel pour optimiser les performances des modèles. Cette approche ciblée permet aux modèles de comprendre plus profondément les subtilités de la parole et d'exceller dans une variété de tâches liées à l'audio.

En outre, OpenAI a amélioré ses techniques d'affinage des connaissances afin de permettre le transfert des connaissances de modèles audio volumineux vers des modèles plus petits et plus efficaces. En s'appuyant sur des méthodes avancées d'auto-jeu, son ensemble de données d'affinage capture efficacement la dynamique réelle du dialogue et reproduit de véritables scénarios d'interaction entre l'utilisateur et l'assistant. Cela permet au petit modèle d'offrir une qualité de dialogue et une réactivité excellentes.

Pour la modélisation de la parole vers le texte, OpenAI a adopté un paradigme basé sur l'apprentissage par renforcement (RL) afin de porter la précision de la transcription à un niveau supérieur. Cette approche améliore considérablement la précision et réduit les hallucinations, ce qui rend sa solution de conversion de la parole au texte plus compétitive dans les scénarios de reconnaissance vocale complexes.

Ces avancées technologiques représentent les derniers progrès dans le domaine de la modélisation audio, où l'OpenAI combine des approches innovantes avec des améliorations pratiques visant à accroître les performances des applications vocales.

Ouverture de l'API et perspectives d'avenir

Ces nouveaux modèles audio sont désormais disponibles pour tous les développeurs. Pour les développeurs qui utilisent déjà des modèles de texte pour créer des expériences de dialogue, l'intégration des modèles de parole à texte et de texte à parole est le moyen le plus simple de créer des assistants vocaux, et OpenAI a également publié l'intégration avec le SDK Agents pour simplifier le processus de développement. Pour les développeurs qui souhaitent créer des expériences de synthèse vocale à faible latence, OpenAI recommande d'utiliser les modèles de synthèse vocale de l'API Realtime.

À l'avenir, l'OpenAI prévoit de continuer à investir davantage dans l'intelligence et la précision de ses modèles audio et d'explorer les moyens de permettre aux développeurs d'introduire des sons personnalisés afin de créer des expériences plus personnalisées tout en garantissant la conformité avec ses normes de sécurité. L'OpenAI se réjouit des applications innovantes que les développeurs créeront en utilisant ces capacités audio améliorées et affirme qu'elle continuera à investir dans d'autres modalités, y compris la vidéo, afin d'aider les développeurs à créer des expériences intelligentes multimodales.

La publication par OpenAI d'une nouvelle génération d'API de modèles audio a sans aucun doute insufflé une nouvelle vitalité au développement de la technologie d'interaction vocale. Avec les progrès continus de la technologie et les scénarios d'application de plus en plus riches, nous avons des raisons de croire que l'avenir du monde numérique deviendra plus "capable d'écouter et de parler", et que l'interaction homme-machine sera plus naturelle et plus fluide.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...