Mini LLM Flow : Construire des mini-intelligences LLM avec une "Directed Graph Structure" en 100 lignes de code

Introduction générale

miniLLMFlow est un cadre minimaliste de développement de grands modèles de langage (LLM) qui ne contient que 100 lignes de code, démontrant ainsi la philosophie de conception "The Way is Simple" (le chemin est simple). Le cadre est spécifiquement conçu pour permettre aux assistants IA (par exemple ChatGPT, Claude, etc.) de programmer de manière autonome, en prenant en charge des fonctionnalités avancées telles que la multi-intelligence, la décomposition des tâches et l'amélioration de la recherche RAG. Le projet utilise le protocole open source du MIT et est continuellement mis à jour et entretenu sur la plateforme GitHub. Ses meilleures caractéristiques sont les suivantesModélisation des flux de travail LLM en tant que structures de graphes dirigés imbriquésL'application de l'IA, qui traite des tâches simples par l'intermédiaire de nœuds, relie les agents par des actions (en marquant des arêtes), réalise la décomposition des tâches par l'intermédiaire de nœuds d'orchestration de processus et prend en charge l'imbrication des processus et le traitement par lots, ce qui rend le développement d'applications d'IA complexes simple et intuitif.

Liste des fonctions

- Soutien aux systèmes de développement collaboratif multi-intelligence

- Fournir des fonctions de décomposition des tâches et d'ordonnancement des processus

- Mise en œuvre du développement de l'application RAG (Retrieval Augmented Generation)

- Prise en charge de la fonction de traitement par lots des nœuds pour les tâches à forte intensité de données

- Assurer la gestion du flux de travail avec une structure de graphe dirigé imbriqué

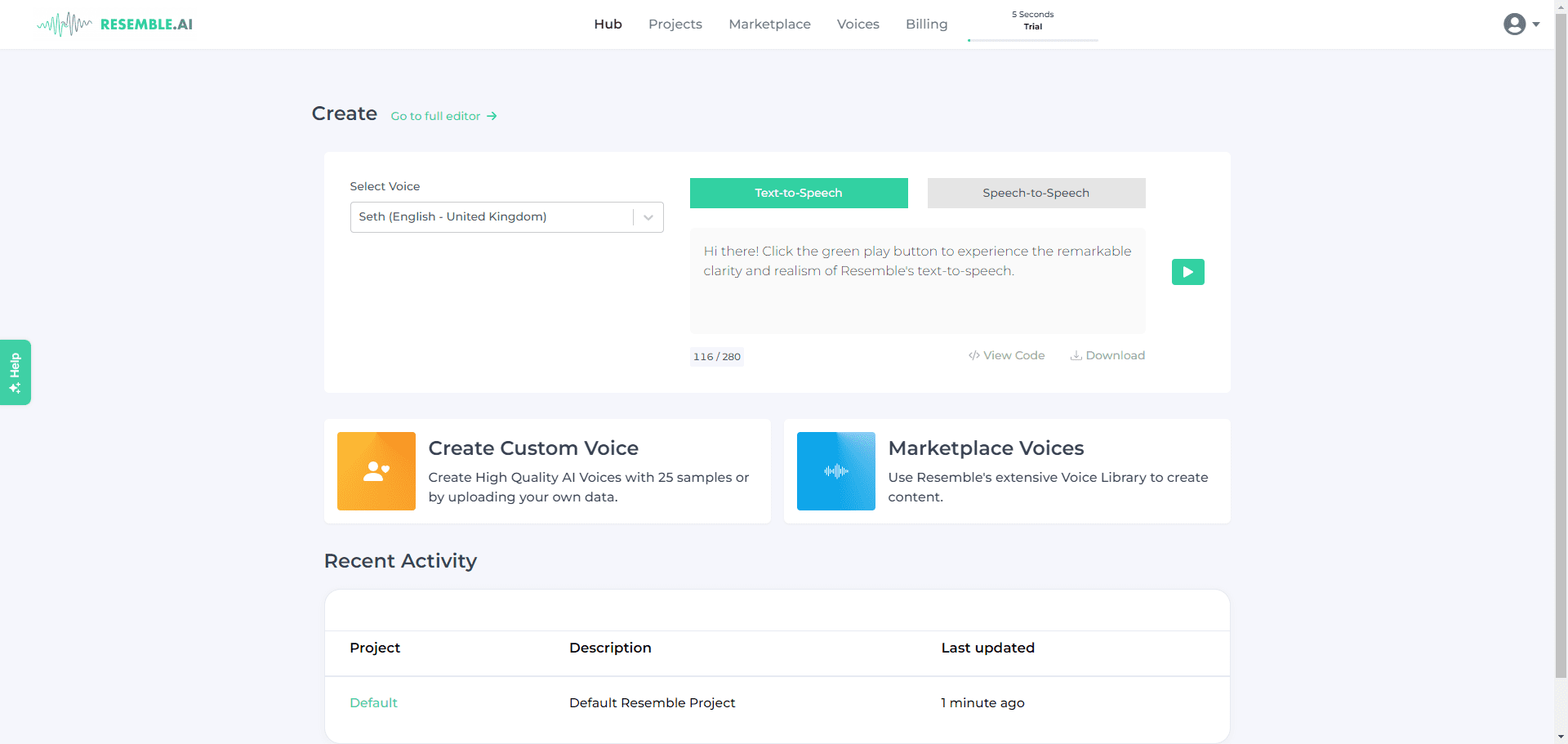

- Intégration des assistants LLM classiques (par exemple ChatGPT, Claude)

- Prise en charge des outils personnalisés et de l'empaquetage des API

- Documentation complète et support didactique

Utiliser l'aide

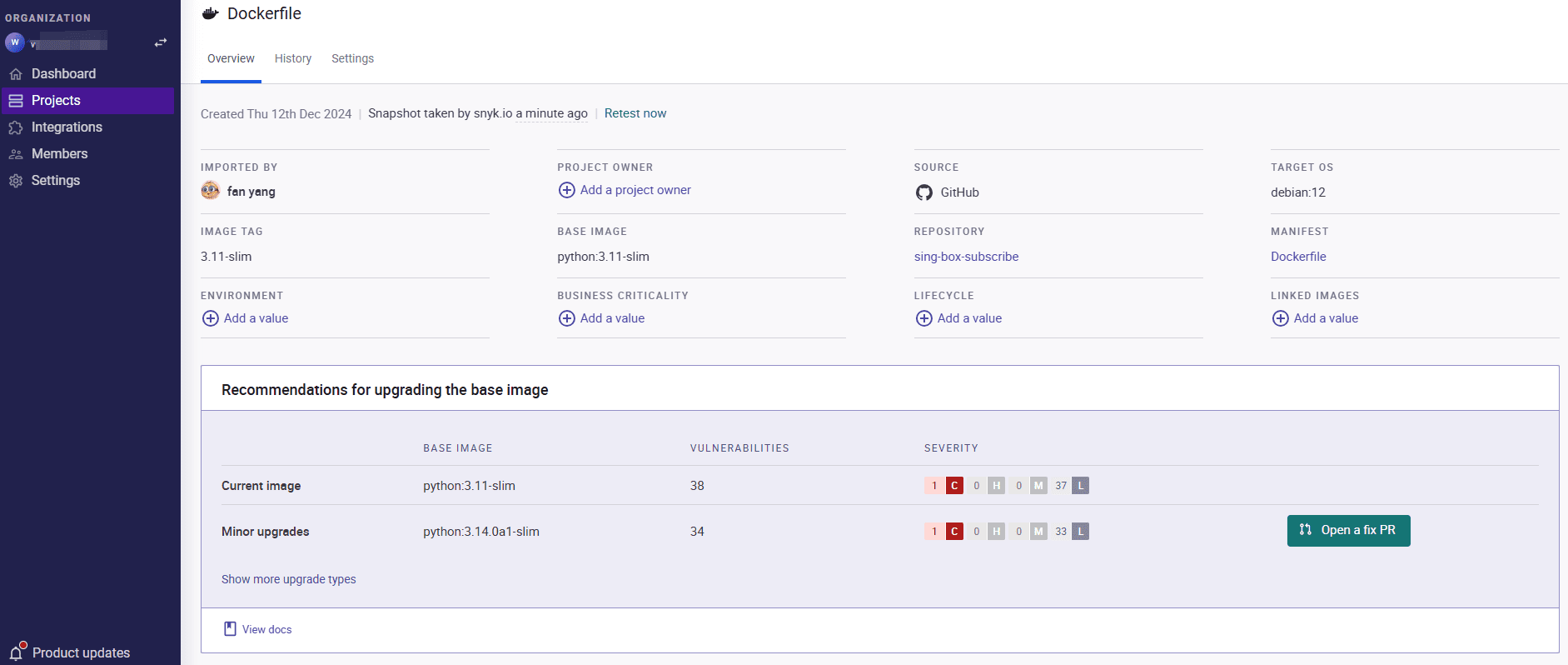

1. configuration de l'installation

Méthode 1 : Installation via pip

pip install minillmflow

Approche 2 : Utilisation directe du code source

Intégrez rapidement à votre projet en copiant le fichier du code source (seulement 100 lignes) directement à partir du projet.

2. description de l'infrastructure

miniLLMFlow utilise une structure de graphe dirigé imbriqué et contient les concepts de base suivants :

- NœudsUnité de base pour le traitement des tâches LLM individuelles

- ActionsLes interactions entre les intelligences : les arêtes étiquetées des nœuds connectés pour les interactions entre les intelligences

- FluxGraphiques dirigés formés par des nœuds de chorégraphie pour la décomposition des tâches

- L'emboîtementLes processus peuvent être réutilisés en tant que nœuds pour soutenir la construction d'applications complexes.

- LotLes services d'aide à la décision : Prise en charge du traitement parallèle des tâches à forte intensité de données

3. le guide du processus de développement

- phase de conception

- Identifier les processus de haut niveau et les structures de nœuds

- Conception de structures de mémoire partagée

- Définir les champs de données et les méthodes de mise à jour

- Phase de réalisation

- Commencer par une mise en œuvre simple

- Ajout de fonctionnalités complexes étape par étape

- Développé avec l'aide de l'assistant LLM

- Développé avec l'assistant LLM

- Développement de projets avec Claude: :

- Créer un nouveau projet et télécharger des documents

- Mise en place d'instructions pour la personnalisation des projets

- Claude vous aide à concevoir et à réaliser votre projet

- Développer avec ChatGPT: :

- Utiliser un assistant GPT spécialisé

- Possibilité d'utiliser des modèles plus récents pour l'élaboration du code

- Développement de projets avec Claude: :

4. exemple de démarrage

Le projet fournit un tutoriel d'introduction complet montrant comment mettre en œuvre le système Paul Graham Article Abstract et QA Proxy, qui peut être rapidement expérimenté en commençant avec Google Colab.

5. les bonnes pratiques

- Commencer par une fonctionnalité simple et l'étendre progressivement

- Utiliser pleinement l'assistant LLM pour le développement

- Voir l'exemple de code dans la documentation

- Utiliser les outils de débogage et de test intégrés

- Suivre les mises à jour du projet et les discussions au sein de la communauté

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...