LM Speed : tester rapidement les performances des API des grands modèles

Introduction générale

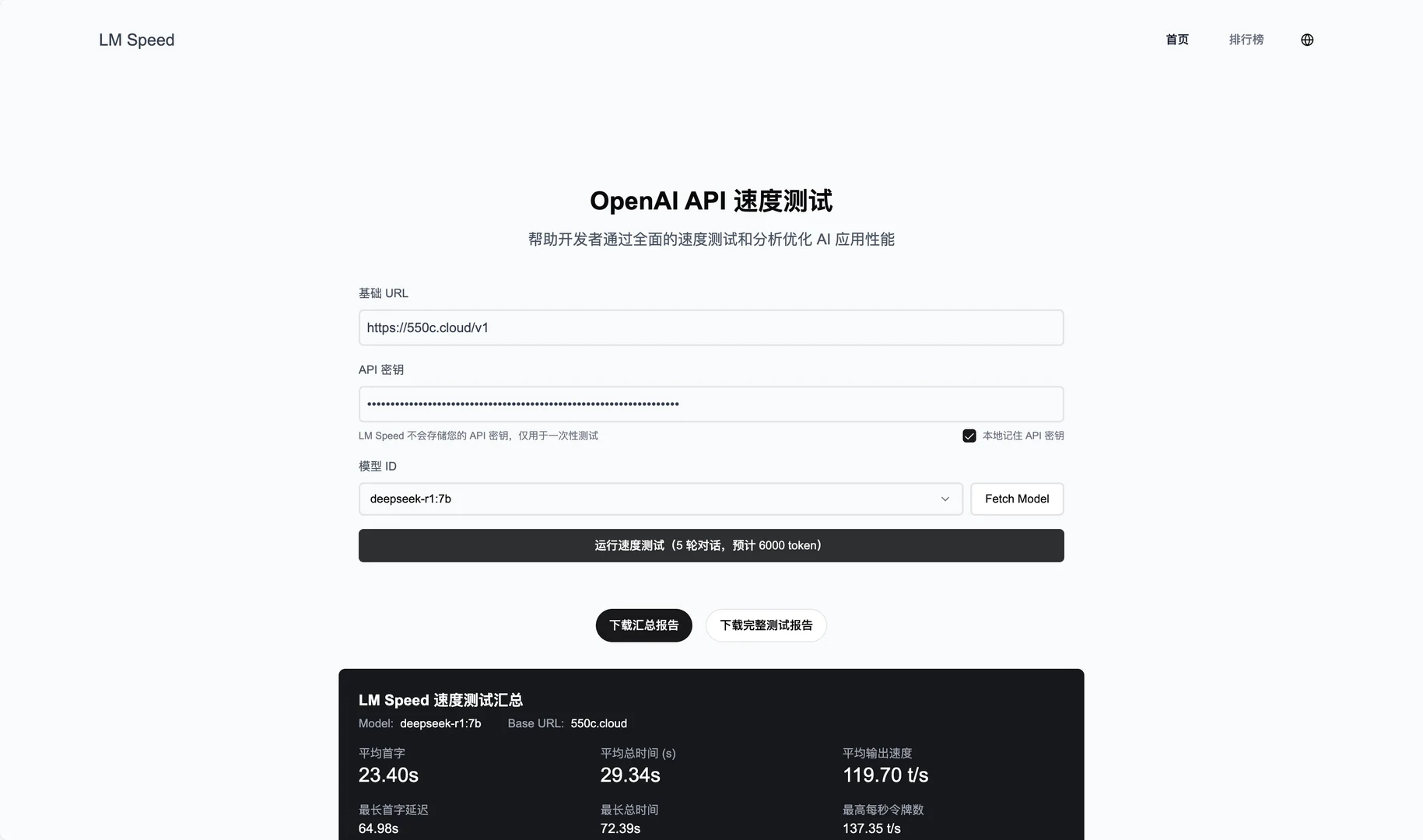

LM Speed est un outil conçu spécifiquement pour les développeurs d'IA et disponible en tant que service en ligne sur lmspeed.net. Sa fonction principale est de tester et d'analyser les performances des API de modèles de langage, en aidant les utilisateurs à identifier rapidement les goulets d'étranglement en matière de vitesse et à optimiser les stratégies d'appel. L'outil prend en charge une variété d'interfaces, y compris l'API OpenAI, et fournit un suivi des données en temps réel ainsi que des rapports de performance détaillés. Que vous soyez un développeur individuel ou une équipe, LM Speed facilite la comparaison des performances des différents modèles et fournisseurs grâce à des graphiques de données intuitifs et des tests automatisés.

Liste des fonctions

- Contrôle des performances en temps réel : affichage de données multidimensionnelles telles que le nombre de traitements par seconde. jeton (TPoS).

- Évaluation complète des performances : mesure des paramètres essentiels tels que la latence du premier jeton, le temps de réponse, etc.

- Visualisation des données : générez des graphiques riches pour visualiser les tendances des performances.

- Tests de résistance automatisés : cinq séries consécutives de tests pour garantir la fiabilité des données.

- Génération de rapports en un clic : création automatique de rapports de tests professionnels, exportation et partage possibles.

- Test rapide des paramètres d'URL : lancez le test directement à partir du lien, sans saisie manuelle.

- Sauvegarde des données historiques : enregistrement des résultats des tests et analyse des tendances.

Utiliser l'aide

Utilisation des services en ligne

- Accès au site web

Ouvrez votre navigateur et allez sur https://lmspeed.net. - Paramètres d'entrée du test

Remplissez le formulaire avec les informations suivantes :baseUrladresse de service de l'API, par exemplehttps://api.deepseek.com/v1.apiKeyVotre clé API : Votre clé API.modelIdl'ID du modèle à tester, par ex.free:QwQ-32B.

- test de démarrage

Cliquez sur le bouton "Start Test" et le système lancera automatiquement cinq séries de tests de résistance. Pendant le test, vous verrez des mises à jour de données en temps réel, y compris les TPoS et les temps de réponse. - Voir les résultats

Une fois le test terminé, la page affiche des graphiques et des mesures détaillés, tels que la latence du premier jeton et la performance moyenne. Vous pouvez cliquer sur le bouton "Générer un rapport" pour télécharger le PDF ou le partager avec votre équipe. - Test rapide des paramètres d'URL

Si vous ne souhaitez pas l'entrer manuellement, vous pouvez lancer le test directement à l'aide d'un lien. Exemple :

https://lmspeed.net/?baseUrl=https://api.suanli.cn/v1&apiKey=sk-你的密钥&modelId=free:QwQ-32B

Après avoir ouvert le lien, le test démarre automatiquement. Note : Pour des raisons de sécurité, il est recommandé de ne pas transmettre la clé API directement dans l'URL.

Déploiement local Processus d'installation

- Préparation de l'environnement

Assurez-vous que Git, Node.js (v16 ou supérieure recommandée), Docker et Docker Compose sont installés sur votre ordinateur ; si ce n'est pas le cas, téléchargez-les et installez-les d'abord. - entrepôt de clones

Ouvrez un terminal et entrez la commande suivante pour télécharger le code :

git clone https://github.com/nexmoe/lm-speed.git

cd lm-speed

- Déploiement Docker

- établir

docker-compose.ymlcopier le code officiellement fourni :version: '3.8' services: app: image: nexmoe/lmspeed:latest ports: - "8650:3000" environment: - DATABASE_URL=postgresql://postgres:postgres@db:5432/nexmoe - NODE_ENV=production depends_on: - db restart: always db: image: postgres:16 restart: always environment: POSTGRES_USER: postgres POSTGRES_PASSWORD: postgres POSTGRES_DB: nexmoe volumes: - postgres_data:/var/lib/postgresql/data volumes: postgres_data: - S'exécute dans le terminal :

docker-compose up -d - Une fois le déploiement réussi, accédez à la page

http://localhost:8650Services de visualisation.

- Déploiement manuel

- Installer la dépendance :

npm install - Copier et configurer les variables d'environnement :

cp .env.example .envcompilateur

.envremplissez l'adresse de la base de données et la configuration de l'API. - Démarrer le service :

npm run dev - entretiens

http://localhost:3000.

Fonction en vedette Fonctionnement

- suivi en temps réel

Lors des tests en ligne, la page affiche dynamiquement les changements de TPoS et de temps de réponse. Vous pouvez survoler les graphiques avec votre souris pour voir les valeurs exactes. - test automatisé

Après avoir cliqué sur "Start Test", le système effectue automatiquement cinq séries de tests. Les résultats de chaque série sont enregistrés, et la valeur moyenne et la plage de fluctuation sont générées à la fin pour vous aider à juger de la stabilité de l'API. - Exportation du rapport

Lorsque le test est terminé, cliquez sur "Exporter le rapport" et sélectionnez le format PDF. Le rapport contient l'environnement de test, les mesures de performance et les graphiques. Il peut être partagé par l'équipe ou archivé. - Analyse des données historiques

Le service en ligne conserve une trace de vos tests. Après avoir ouvert une session, allez à la page "Historique" pour consulter les résultats des tests précédents et les tendances en matière de performance.

mise en garde

- Assurez-vous que la clé API est valide, sinon le test échouera.

- En cas de déploiement local, vérifiez que le pare-feu a des ports ouverts (par défaut 3000 ou 8650).

- Si le graphique se charge lentement, il se peut qu'il y ait un problème de réseau et nous vous recommandons d'actualiser la page et de réessayer.

Avec ces étapes, vous pouvez tester les performances de l'API de modélisation linguistique en ligne ou localement avec LM Speed. L'opération est simple, les résultats sont clairs et très utiles.

scénario d'application

- Les développeurs choisissent les services API

Test des développeurs avec LM Speed DeepSeek et des API telles que Silicon Flow pour sélectionner le fournisseur le mieux adapté au projet. - Modèle d'optimisation de l'équipe Appel

Les équipes d'IA l'utilisent pour surveiller les performances des API en cas de forte charge, en ajustant les stratégies d'appel pour améliorer l'efficacité de l'application. - Les chercheurs analysent les fluctuations de performance

- Les chercheurs ont étudié l'évolution des performances du modèle dans différentes conditions à travers cinq séries de tests et de données historiques pour rédiger le rapport académique.

QA

- Quelles sont les API supportées par LM Speed ?

Il prend principalement en charge les API au format OpenAI, telles que DeepSeek, Suanli, etc. Tant que l'API est compatible avec le SDK OpenAI, elle peut être testée. - Qu'en est-il des résultats instables des tests ?

Vérifiez que la connexion réseau est stable ou augmentez le nombre de cycles de test (le code peut être modifié pour un déploiement local). Des fluctuations importantes dans les résultats peuvent être dues à un problème avec le fournisseur de l'API. - Dois-je payer ?

Les services en ligne sont actuellement gratuits, mais les fonctionnalités peuvent être limitées. Le déploiement local est entièrement gratuit et le code est libre.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...