llamafile : distribuer et exécuter des LLM à l'aide d'un seul fichier, simplifier le déploiement des LLM, support multiplateforme pour les LLM

Introduction générale

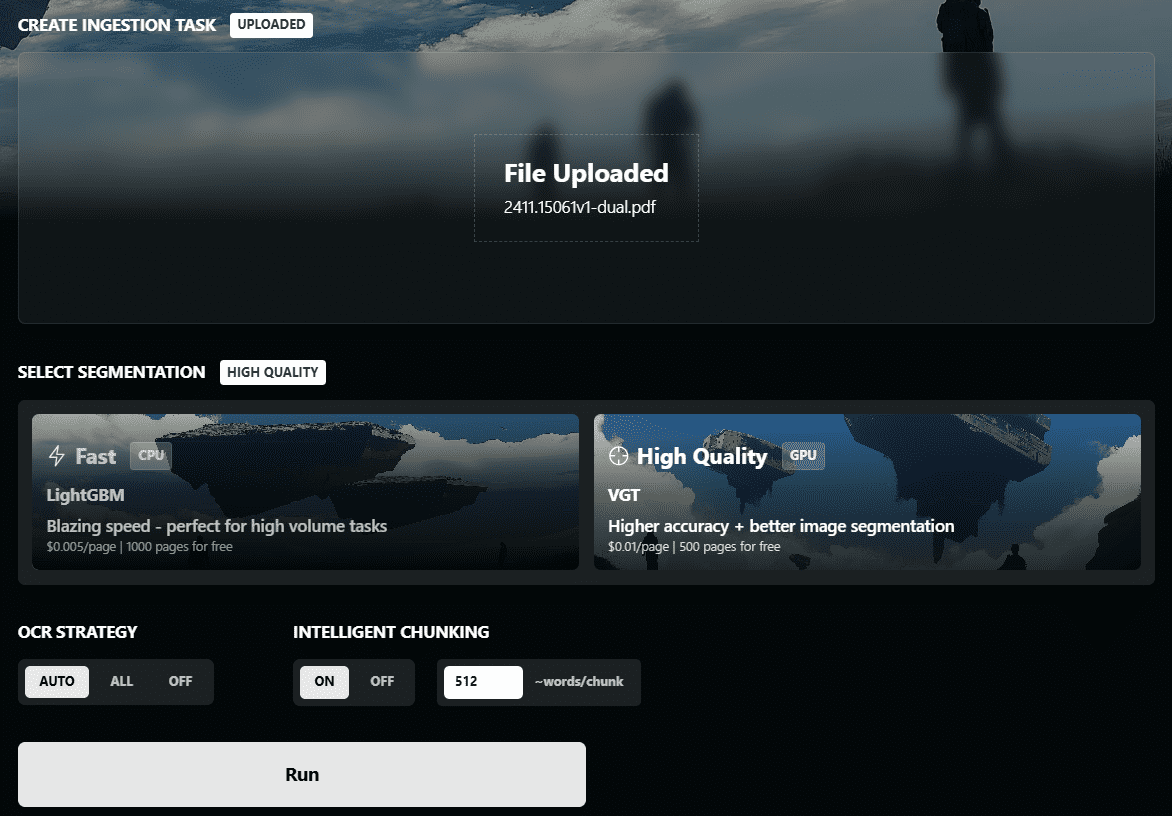

llamafile est un outil du projet Mozilla Builders conçu pour simplifier le déploiement et le fonctionnement du Large Language Model (LLM). En combinant le llama.cpp Associé à Cosmopolitan Libc, llamafile simplifie le processus complexe de déploiement de LLM en un seul fichier exécutable qui peut être exécuté localement sur un large éventail de systèmes d'exploitation, sans aucune installation. L'outil prend en charge non seulement les dialogues textuels, mais aussi la saisie d'images afin de garantir la confidentialité des données.

Liste des fonctions

- Opération sur un seul fichierLe modèle LLM et l'environnement d'exécution sont regroupés dans un seul exécutable.

- Compatibilité multiplateformeWindows, macOS, Linux, FreeBSD, OpenBSD et NetBSD sont pris en charge.

- opération localeLe traitement des données est effectué localement afin de garantir la confidentialité et la sécurité.

- soutien multimodalLe système de gestion de l'information : il prend en charge la saisie de textes et d'images, offrant ainsi de riches fonctions interactives.

- Compatible avec l'API OpenAILe programme de l'IA fournit une interface compatible avec l'API de l'IA ouverte pour faciliter l'intégration dans les applications existantes.

- haute performanceNoyau de multiplication matricielle optimisé pour un fonctionnement plus rapide sur le CPU et le GPU.

- projet open sourceLes avantages : code source ouvert, contributions actives de la communauté, mises à jour et optimisations permanentes.

Utiliser l'aide

Installation et fonctionnement

- Télécharger llamafile: Accès Page GitHub Téléchargez la dernière version de llamafile.

- Délégation de l'autorité exécutive(pour les utilisateurs de macOS, Linux et BSD) :

chmod +x path/to/llamafile - Exécuter llamafile: :

- Pour les utilisateurs de macOS, Linux et BSD :

./path/to/llamafile - Pour les utilisateurs de Windows : Renommez le fichier en

.exeet de l'exécuter :.\path\to\llamafile.exe

- Pour les utilisateurs de macOS, Linux et BSD :

Fonctionnement

- Lancement de l'interface WebAprès avoir exécuté llamafile, le navigateur ouvrira automatiquement un écran de discussion (si ce n'est pas le cas, veuillez le visiter manuellement).

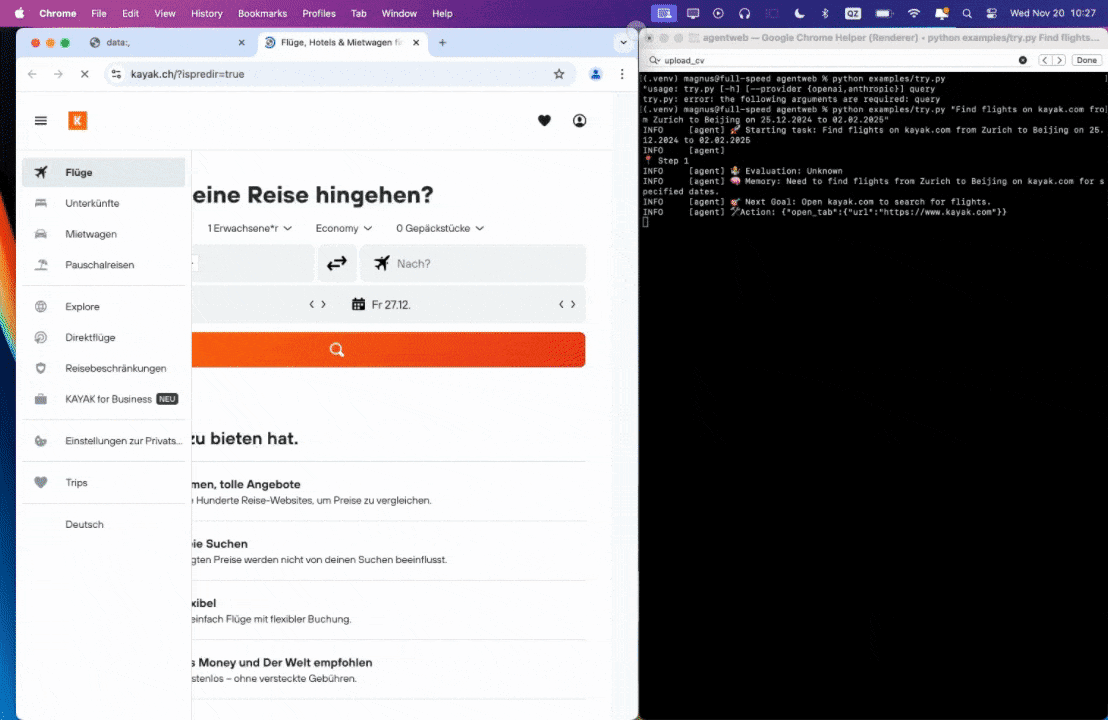

http://127.0.0.1:8080/). - Utiliser l'interface API de l'OpenAIL'interface : llamafile fournit une interface compatible avec l'API OpenAI et prend en charge les cas d'utilisation courants de l'API. Il peut être invoqué avec les commandes suivantes :

curl http://localhost:8080/v1/chat/completions -H "Content-Type: application/json" -d '{ "model": "LLaMA_CPP", "messages": [{"role": "user", "content": "Hello, world!"}] }' - saisie d'imagesLes services d'aide à l'enfance et à la famille sont également disponibles : téléchargez des images et posez des questions à leur sujet, par exemple :

curl -X POST http://localhost:8080/v1/images -F "image=@path/to/image.jpg" -F "prompt=Describe this image" - mode ligne de commandeLe fichier : llamafile prend également en charge le mode ligne de commande pour les opérations scénarisées :

./path/to/llamafile --cli -p "Your prompt here"

problèmes courants

- Questions de compétenceSi vous rencontrez des problèmes de permissions, assurez-vous que le fichier a les permissions d'exécution (utilisez la commande

chmod +x). - Limite de taille des fichiersLes utilisateurs de Windows doivent savoir que la taille d'un seul fichier exécutable ne peut excéder 4 Go et que des fichiers de poids externes peuvent être utilisés pour résoudre ce problème.

- problème de dépendanceLes utilisateurs de macOS doivent installer Xcode Commandement Line Tools, les utilisateurs de Linux peuvent avoir besoin d'installer le SDK CUDA ou le SDK ROCm pour prendre en charge l'accélération GPU.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...