LiteAvatar : portraits 2D audio de personnes numériques interactives en temps réel, fonctionnant à 30 images par seconde sur l'unité centrale.

Introduction générale

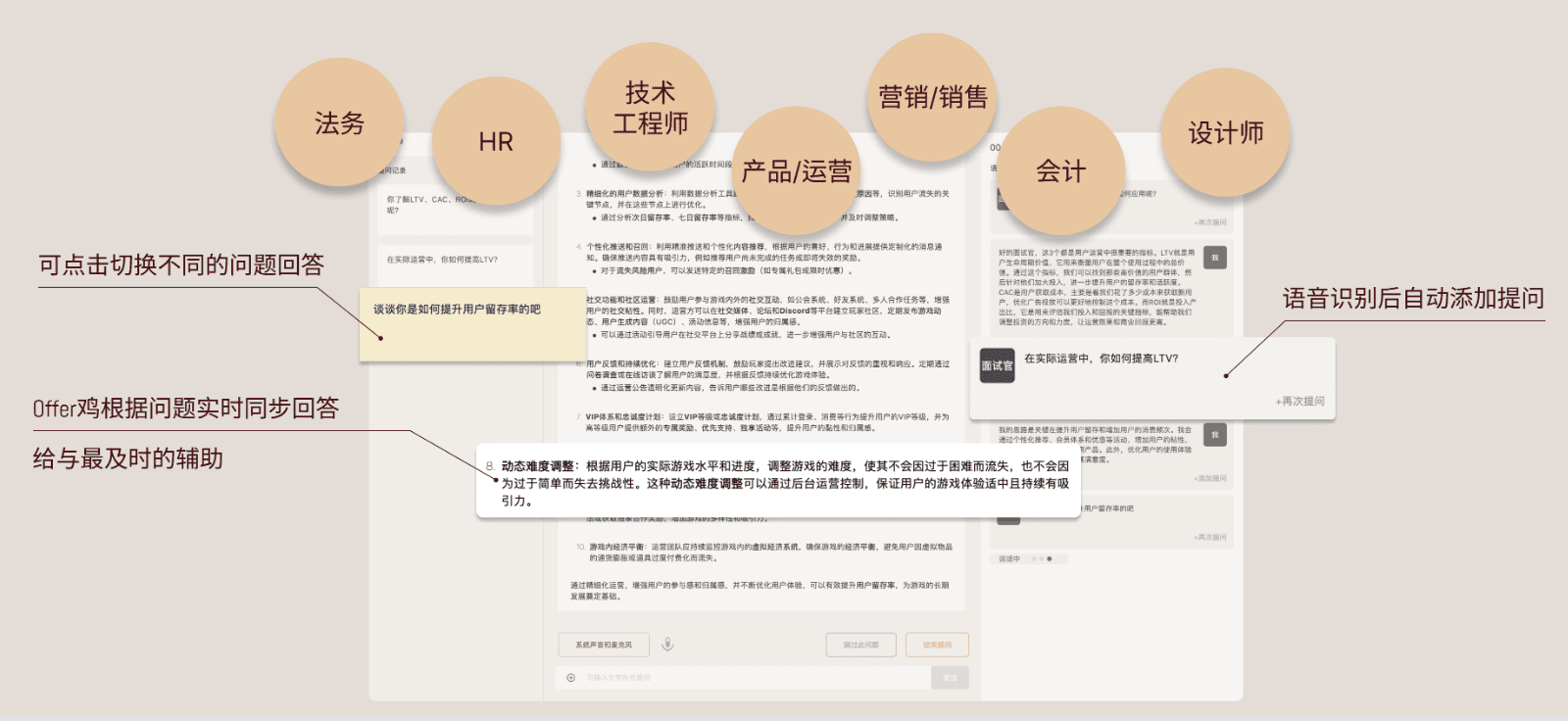

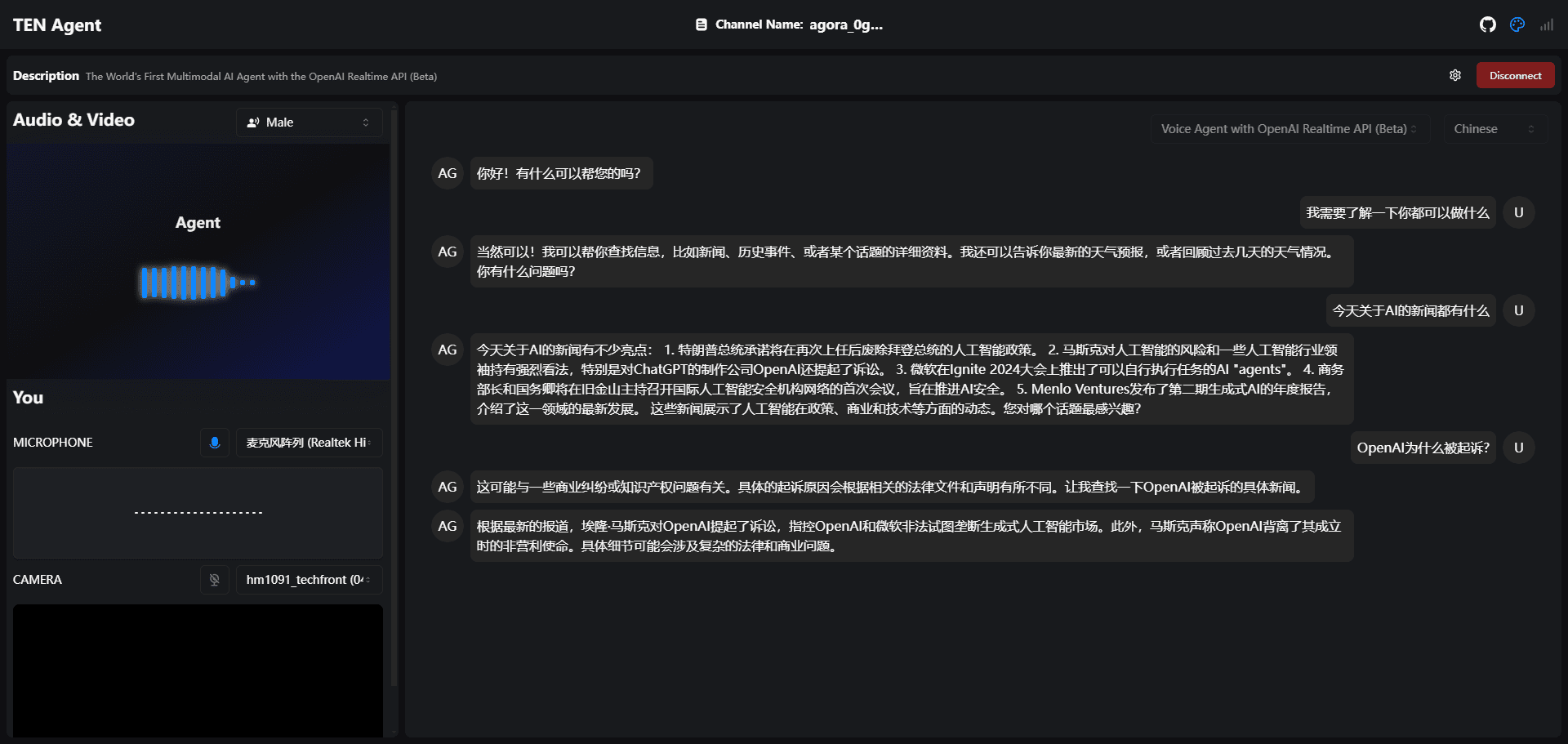

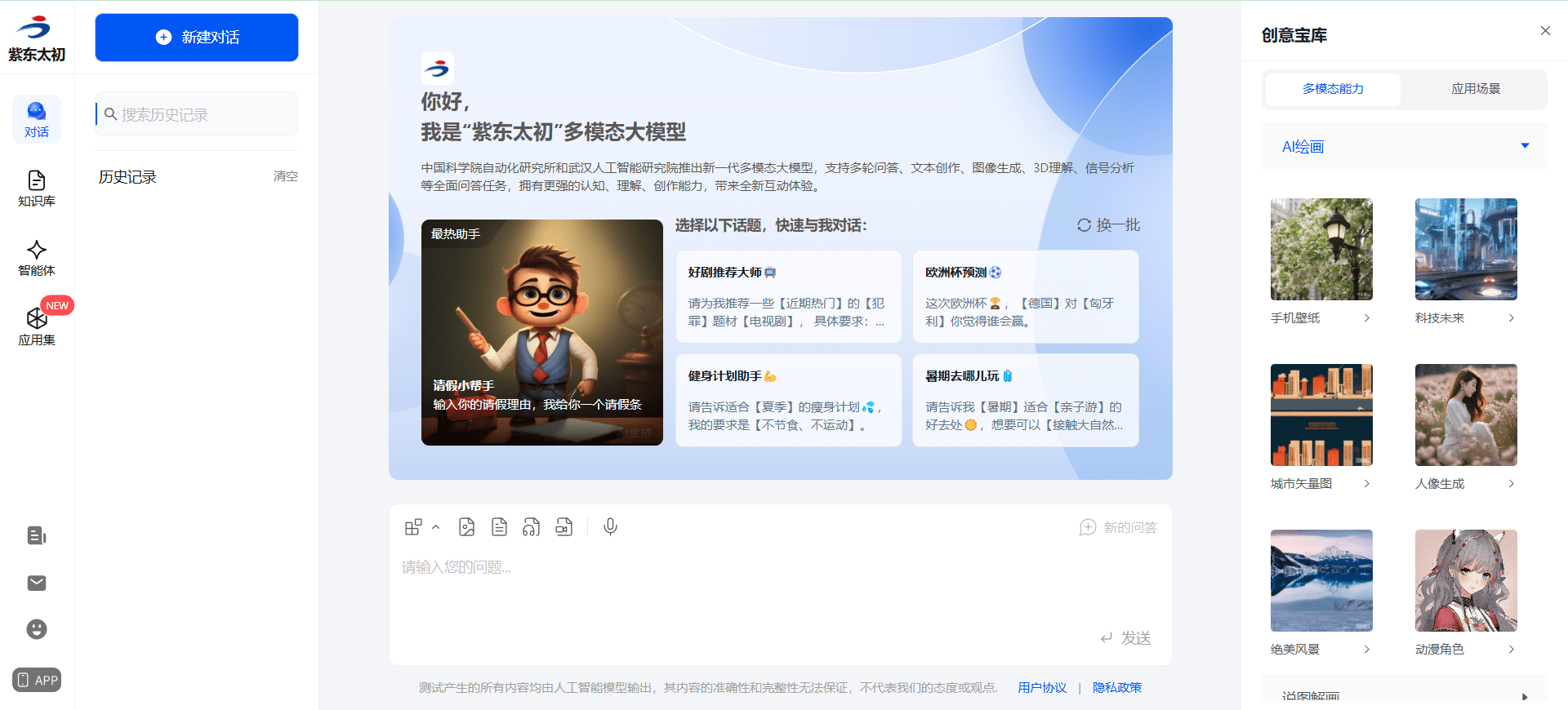

LiteAvatar est un outil open source développé par l'équipe HumanAIGC (qui fait partie d'Ali) qui se concentre sur la génération d'animations faciales à partir d'avatars 2D audio en temps réel. LiteAvatar combine la reconnaissance vocale (ASR) et la prédiction de la bouche pour générer des expressions faciales synchronisées et des mouvements de bouche basés sur les caractéristiques audio entrantes, avec des effets d'animation fluides et naturels. Le projet est hébergé sur GitHub, avec le code complet et la documentation disponibles pour les développeurs, qui peuvent y accéder gratuitement et les développer selon leurs besoins. Que ce soit pour le divertissement, l'éducation ou l'hébergement virtuel, cet outil démontre la combinaison parfaite entre légèreté et haute performance.

Déploiement de la version interactive en temps réel de LiteAvatar : https://github.com/HumanAIGC-Engineering/OpenAvatarChat

Liste des fonctions

- Génération d'animations pilotées par l'audioLes avatars : Générer des expressions faciales et des animations de la bouche des avatars en temps réel en entrant de l'audio.

- Fonctionnement légerLes animations fluides à 30 images par seconde peuvent être réalisées en s'appuyant uniquement sur le processeur, sans nécessiter de support GPU.

- Prédiction de la synchronisation de la boucheLe modèle ASR est utilisé pour extraire les caractéristiques audio et générer des mouvements de bouche qui correspondent au contenu de la parole.

- Prise en charge des appareils mobilesLe modèle optimisé est adapté aux appareils à faible consommation d'énergie et convient aux téléphones mobiles ou aux tablettes.

- Soutien à l'Open SourceLe code source complet est fourni, ce qui permet aux utilisateurs de personnaliser les fonctionnalités ou de les intégrer dans d'autres projets.

- Capacité de traitement en temps réelLe traitement à faible latence des entrées audio garantit une synchronisation optimale de l'animation avec le son.

Utiliser l'aide

LiteAvatar est un projet open source basé sur GitHub qui nécessite que les utilisateurs aient une certaine base technique pour l'installer et l'utiliser. Ce qui suit est un guide d'installation et d'utilisation détaillé pour vous aider à démarrer rapidement avec cet outil d'avatar 2D piloté par le son.

Processus d'installation

- Préparation de l'environnement

- Assurez-vous que Python 3.8 ou plus est installé sur votre ordinateur. Cela peut être fait avec la commande

python --versionVérifier la version. - Installer Git, qui permet de télécharger du code depuis GitHub ; les utilisateurs de Windows peuvent télécharger Git depuis le site officiel, et les utilisateurs de Linux ou macOS peuvent l'installer via un gestionnaire de paquets (par ex.

sudo apt install git). - Préparez un terminal qui prend en charge la ligne de commande (par exemple, CMD, PowerShell pour Windows ou Terminal pour Linux/macOS).

- Assurez-vous que Python 3.8 ou plus est installé sur votre ordinateur. Cela peut être fait avec la commande

- Télécharger le projet LiteAvatar

- Ouvrez un terminal et entrez la commande suivante pour cloner le dépôt de code :

git clone https://github.com/HumanAIGC/lite-avatar.git - Une fois le clonage terminé, allez dans le répertoire du projet :

cd lite-avatar

- Ouvrez un terminal et entrez la commande suivante pour cloner le dépôt de code :

- Installation des dépendances

- Le projet nécessite la prise en charge de certaines bibliothèques Python. Exécutez la commande suivante pour installer les dépendances :

pip install -r requirements.txt - au cas où

requirements.txtIl n'y a pas de dépendances spécifiques listées dans la documentation, vous pouvez vous référer à la documentation du projet, les dépendances communes peuvent inclurenumpy,torch(version CPU),modelscopeetc. Exemple d'installation manuelle :pip install numpy torch modelscope

- Le projet nécessite la prise en charge de certaines bibliothèques Python. Exécutez la commande suivante pour installer les dépendances :

- Vérifier l'installation

- Une fois l'installation terminée, lancez une commande de test simple (la commande exacte est basée sur le README du projet, par exemple :

python demo.py - Si aucune erreur n'est signalée, l'environnement est configuré avec succès.

- Une fois l'installation terminée, lancez une commande de test simple (la commande exacte est basée sur le README du projet, par exemple :

Utilisation

La fonction principale de LiteAvatar est de générer des animations à partir d'avatars audio. Voici les étapes détaillées :

Préparation des fichiers audio

- format audioLes formats les plus courants, tels que

.wavpeut-être.mp3. Il est recommandé d'utiliser un son mono clair avec un taux d'échantillonnage d'environ 16 kHz pour obtenir les meilleurs résultats. - Source audioIl peut s'agir de votre voix enregistrée ou de l'audio extrait d'une vidéo. Outil recommandé : Audacity (logiciel d'édition audio gratuit).

Exécution d'animations en temps réel

- procédure de déclenchement

- Dans le répertoire du projet, exécutez le script principal (en supposant que l'option

main.py(Le nom de fichier spécifique est basé sur le README) :python main.py --audio_path your_audio_file.wav - Paramètre Description :

--audio_path: Spécifie le chemin d'accès au fichier audio.--output: Paramètre optionnel permettant de spécifier le chemin d'enregistrement de la vidéo animée générée, la valeur par défaut peut être affichée directement.

- Dans le répertoire du projet, exécutez le script principal (en supposant que l'option

- Test d'entrée en temps réel

- Si l'entrée micro est prise en charge, essayez le mode temps réel (il faut vérifier si le README prévoit cette fonction). Exemple de commande :

python main.py --live - Le programme écoute l'entrée du microphone et génère des animations en temps réel.

- Si l'entrée micro est prise en charge, essayez le mode temps réel (il faut vérifier si le README prévoit cette fonction). Exemple de commande :

Voir les résultats

- Sortie de l'animationAprès son exécution, le programme affiche une animation de l'avatar sur l'écran ou génère un fichier vidéo (tel qu'un

output.mp4). - Paramètres de réglageSi l'animation n'est pas satisfaisante, vous pouvez vous référer à la documentation pour ajuster les paramètres du modèle, tels que la fréquence d'images ou la sensibilité de la bouche (en fonction de l'implémentation du code).

Fonction en vedette Fonctionnement

Génération d'animations pilotées par l'audio

- déplacer: :

- Préparer le fichier audio, par exemple

test.wav. - Exécuter la commande :

python main.py --audio_path test.wav --output result.mp4 - Le programme appelle le modèle ASR de ModelScope pour extraire les caractéristiques audio, puis génère l'animation à l'aide du modèle de prédiction de la bouche.

- Préparer le fichier audio, par exemple

- effetLes bouches et les expressions des avatars changent en fonction de l'audio. Par exemple, leurs bouches s'ouvrent lorsqu'ils disent "bonjour" et ils chantent avec un sens du rythme plus prononcé.

Déploiement d'appareils mobiles

- conditions préalablesLes modèles doivent être exportés dans un format léger (par exemple ONNX) et intégrés dans les téléphones portables.

- gréement: :

- Convertir le modèle localement (des scripts spécifiques doivent être ajoutés à la documentation du projet, l'exemple suppose que le fichier

export.py) :python export.py --model lite_avatar_model.pth --output lite_avatar.onnx - commandant en chef (militaire)

.onnxLes fichiers sont déployés sur le mobile et exécutés à l'aide de frameworks compatibles avec ONNX, tels que NCNN.

- Convertir le modèle localement (des scripts spécifiques doivent être ajoutés à la documentation du projet, l'exemple suppose que le fichier

- en fin de compteAnimation en temps réel à faible consommation d'énergie sur les téléphones mobiles, adaptée aux applications de chat vidéo.

mise en garde

- l'optimisation des performancesSi vous avez des problèmes de laggy, vous pouvez réduire le taux de rafraîchissement (par exemple de 30fps à 15fps) en modifiant le fichier de configuration ou les paramètres de la ligne de commande.

- ajuster les composants pendant les essaisSi vous obtenez une erreur, vérifiez que les versions de vos dépendances correspondent, ou consultez la page GitHub Issues pour obtenir l'aide de la communauté.

- évolutivitéSi vous souhaitez ajouter de nouvelles fonctionnalités (par exemple le contrôle des emoji), vous pouvez forker le projet et modifier le code, l'équipe HumanAIGC invite les contributeurs à soumettre des Pull Requests.

Avec ces étapes, vous pouvez facilement installer et utiliser LiteAvatar pour expérimenter le processus de génération d'animation d'avatar piloté par le son. Cet outil fournit une solution efficace et pratique pour les tests de développement et les applications réelles.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...