Kotaemon : un outil de quiz sur les documents multimodaux, simple à déployer et open source

Introduction générale

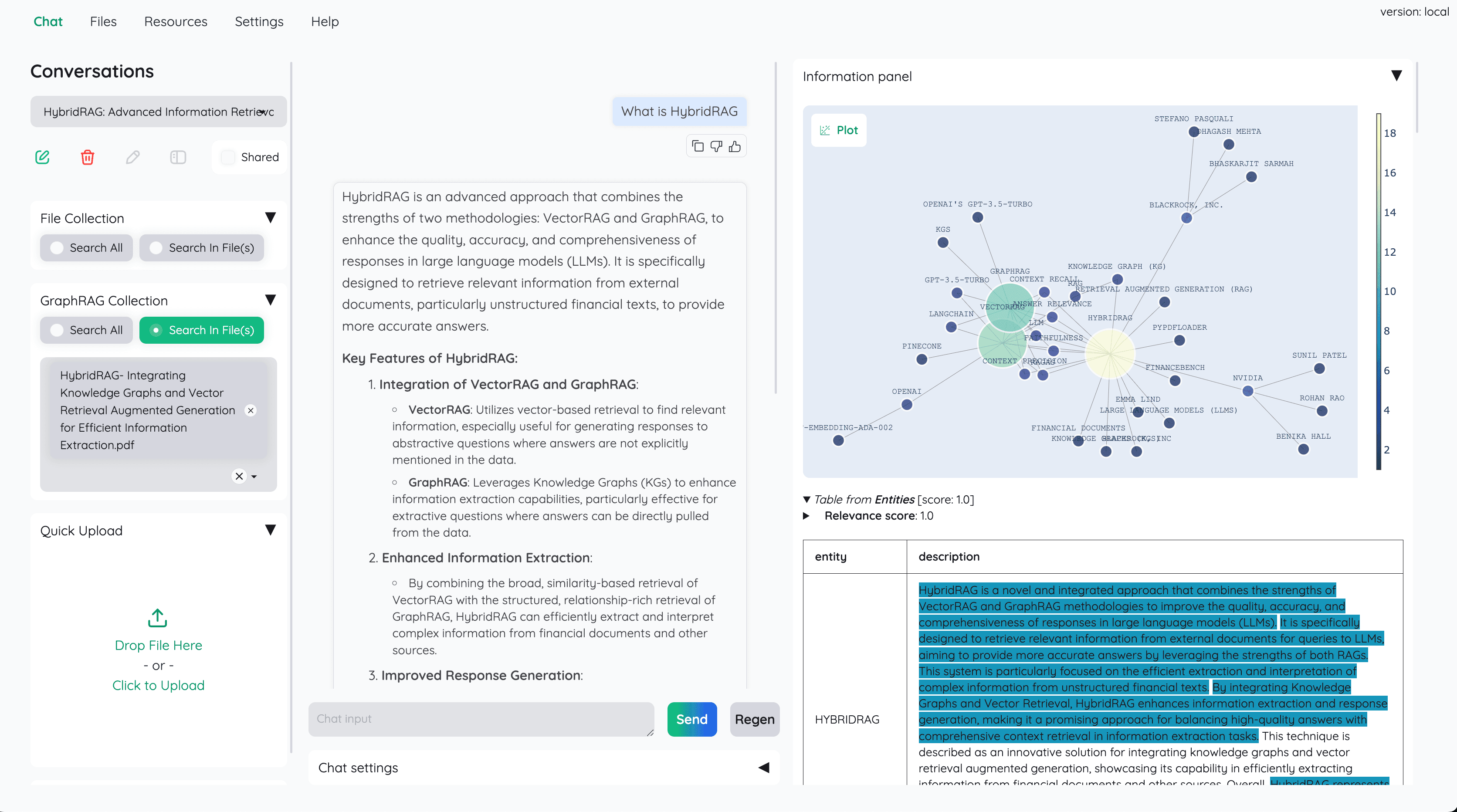

Kotaemon est un outil de Q&R documentaire open source conçu pour fournir aux utilisateurs finaux et aux développeurs des fonctionnalités de Q&R basées sur la Génération Augmentée par Récupération (RAG). Développé par Cinnamon, le projet supporte une variété de fournisseurs d'API LLM (par exemple, OpenAI, AzureOpenAI, Cohere, etc.) ainsi que des LLM natifs. Kotaemon fournit une interface utilisateur propre et personnalisable pour le quizzing de documents et pour la construction d'applications LLM. RAG Tuyaux.

Liste des fonctions

- Prise en charge des connexions d'utilisateurs multiples, de l'organisation des fichiers dans des collections privées/publiques

- Prise en charge des LLM natifs et des fournisseurs d'API les plus courants

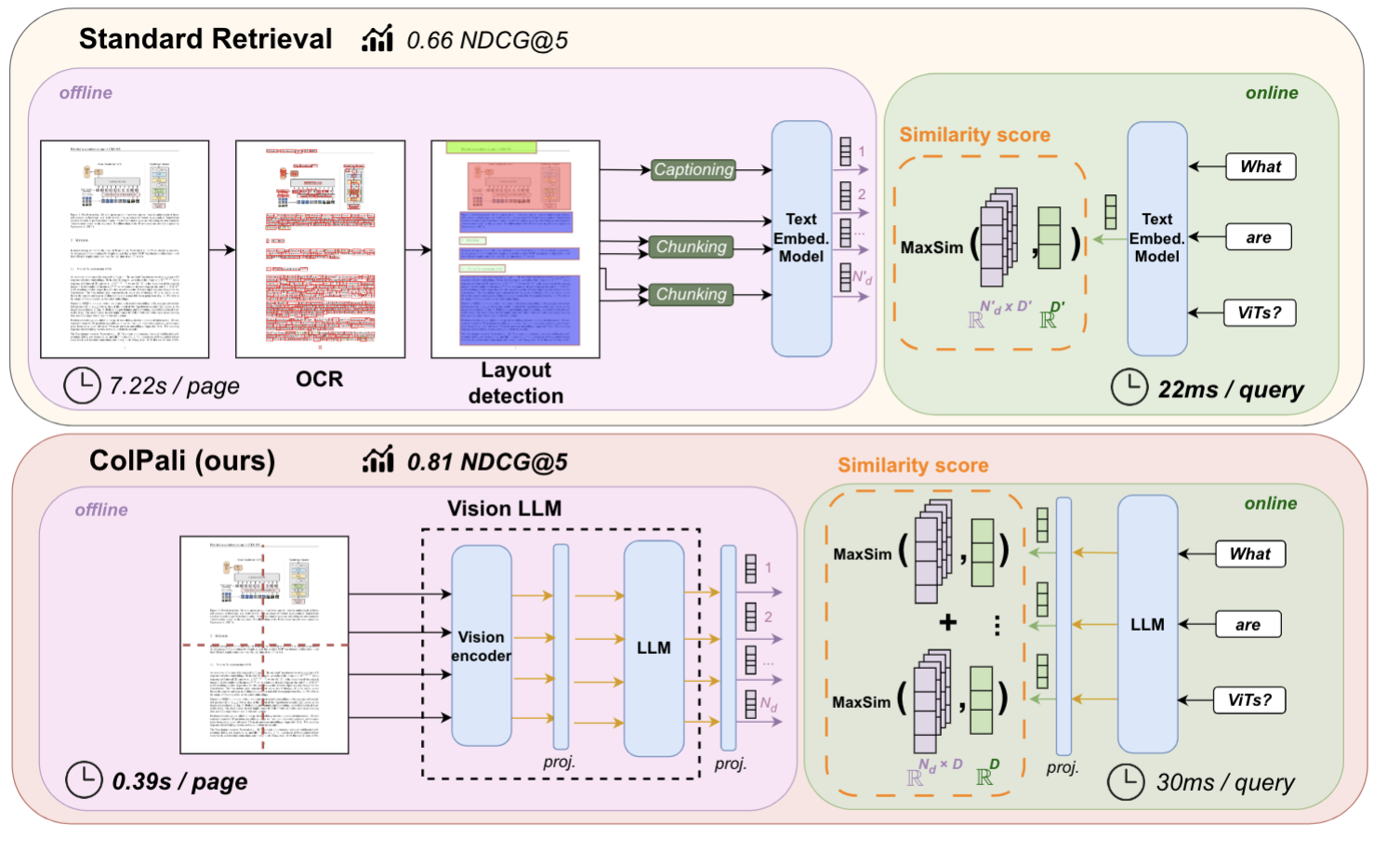

- Fourni avec une tuyauterie mixte RAG pour assurer une qualité de récupération optimale

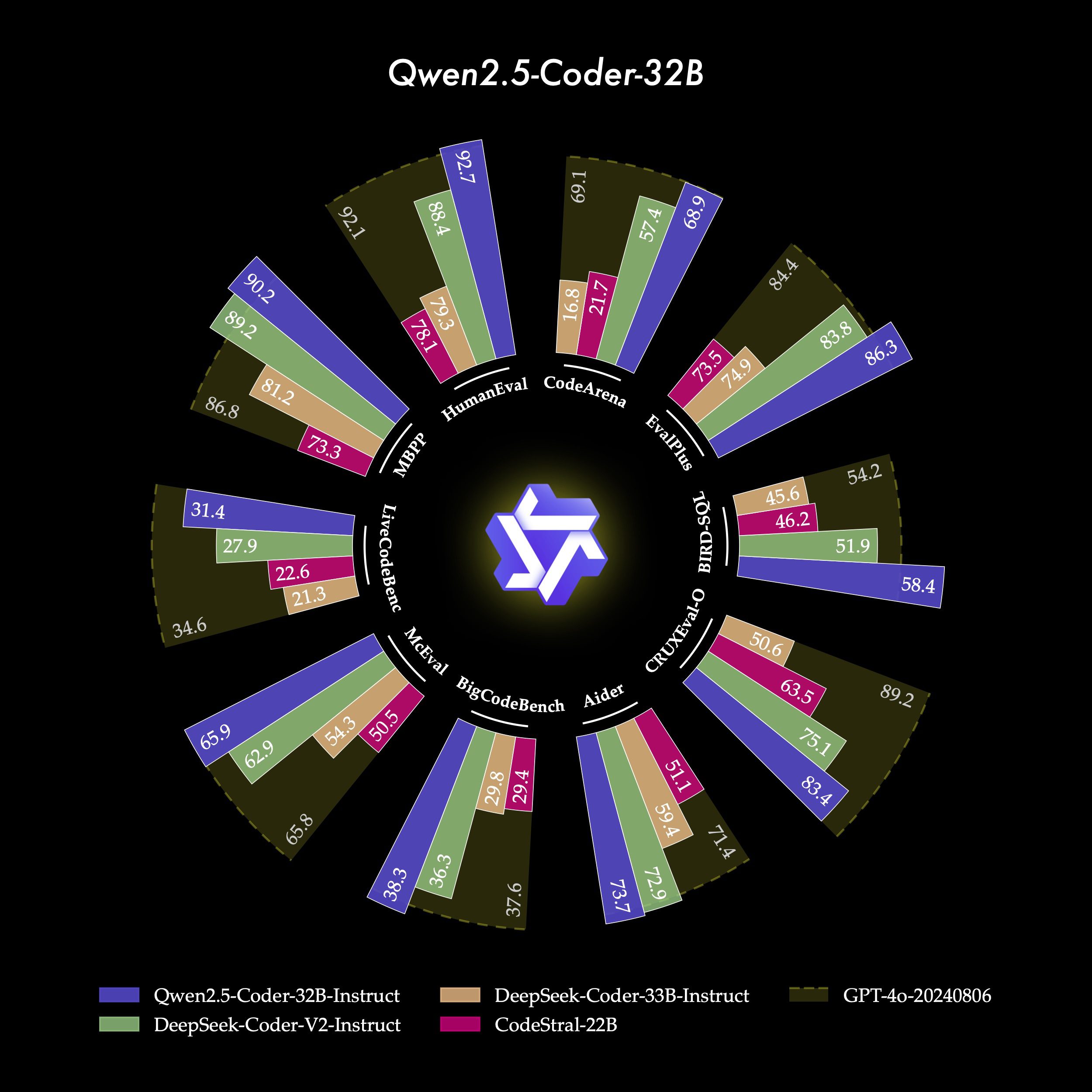

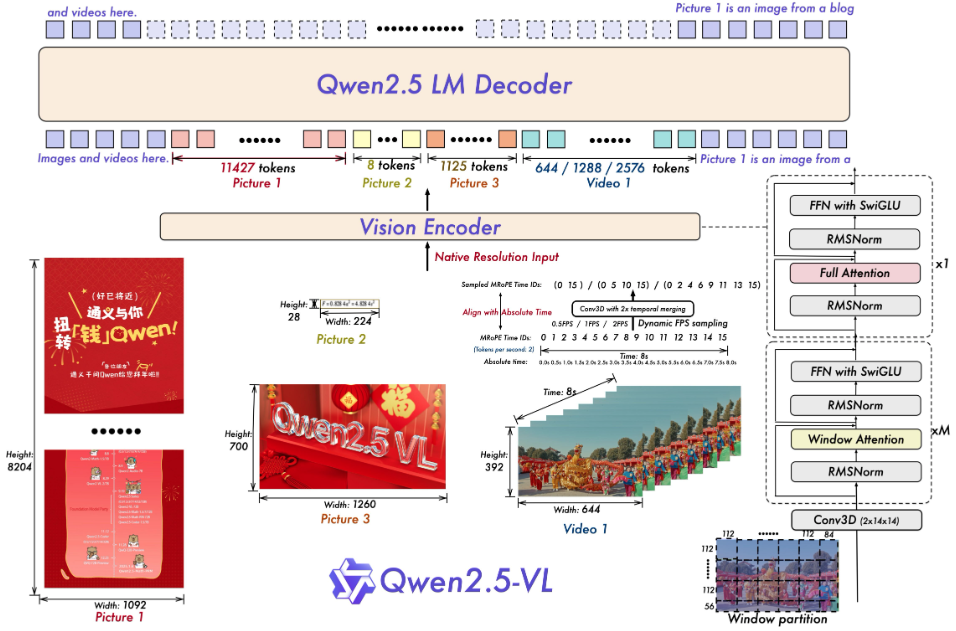

- Prise en charge des questions-réponses multimodales pour les documents contenant des graphiques et des tableaux

- Fournit des scripts faciles à installer sans nécessiter de configuration de l'environnement.

Caractéristiques fonctionnelles

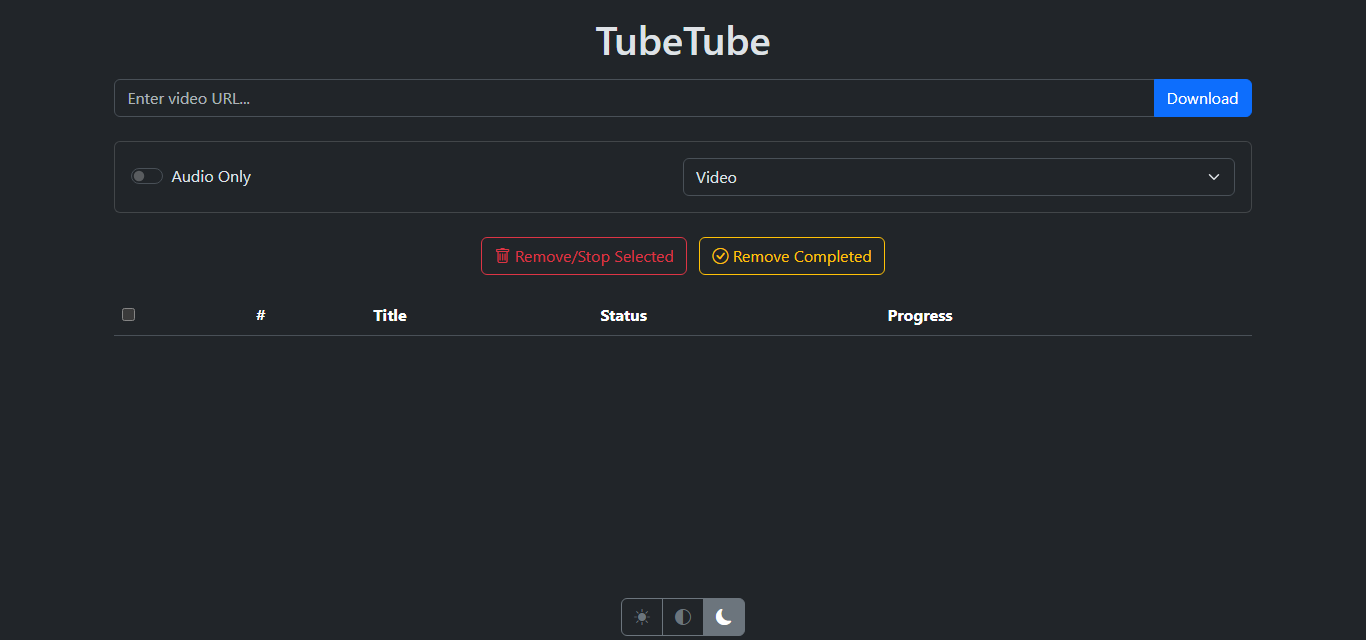

- Hébergement de votre propre interface utilisateur web pour le questionnaire de documentation (RAG). Prenez en charge les connexions d'utilisateurs multiples, organisez les fichiers par collections privées/publiques, collaborez avec d'autres personnes et partagez vos chats préférés.

- Organiser votre LLM et les modèles d'intégration. Prise en charge du LLM natif et des fournisseurs d'API les plus courants (OpenAI, Azure, Ollama, Groq).

- Tuyaux RAG mixtes. Fournit un pipeline RAG par défaut raisonnable combiné à un chercheur hybride (texte intégral et vecteur) + réorganisation pour assurer une qualité de recherche optimale.

- Support multimodal pour les questions-réponses. Questions et réponses pour plusieurs documents, avec prise en charge des graphiques et des tableaux. Prise en charge de l'analyse multimodale des documents (option disponible dans l'interface utilisateur).

- Citations avancées avec prévisualisation du document. Le système fournit par défaut des références détaillées afin de garantir que les réponses du programme LLM sont correctes. Cela peut être fait directement dans leVisualisateur de PDFVisualiser les citations (y compris les scores de pertinence) et les mettre en évidence. Avertir lorsque le pipeline de recherche renvoie des articles peu pertinents.

- Soutien aux méthodes de raisonnement complexes. Utilisation de la décomposition des questions pour répondre à des questions complexes/multi-sauts. Prise en charge du raisonnement basé sur les agents à l'aide de ReAct, ReWOO et d'autres agents.

- Interface utilisateur configurable. Vous pouvez régler la plupart des aspects importants du processus de récupération et de génération (y compris les invites) dans l'interface utilisateur.

- évolutivité. Construit sur Gradio, vous êtes libre de personnaliser ou d'ajouter tous les éléments de l'interface utilisateur que vous souhaitez. En outre, nous visons à soutenir de multiples stratégies d'indexation et de récupération de documents.

GraphRAGLe pipeline d'index est fourni à titre d'exemple.

Utiliser l'aide

Processus d'installation pour les utilisateurs normaux

Télécharger :à travers (une brèche)Nouvelles publicationstéléchargementkotaemon-app.zipDocumentation.

Installation :

- Décompressez le fichier téléchargé.

- entrer dans

scriptset lancez le programme d'installation correspondant à votre système d'exploitation :- Fenêtres.

run_windows.bat. Il suffit de double-cliquer sur le fichier. - macOS.

run_macos.sh- Cliquez avec le bouton droit de la souris sur votre fichier et sélectionnez "Ouvrir avec une autre application".

- Activez "Toutes les applications" et sélectionnez "Terminal".

- Note : Si vous souhaitez toujours ouvrir le fichier à l'aide du terminal, cochez la case "Toujours ouvrir avec cette application".

- A partir de maintenant, double-cliquez sur votre fichier et il devrait fonctionner correctement.

- Linux.

run_linux.sh. Veuillez utiliser lebash run_linux.shExécutez le script.

- Fenêtres.

- Une fois l'installation terminée, le programme d'installation vous demandera si l'interface utilisateur de ktem est lancée, veuillez répondre pour continuer.

- Si le lancement est réussi, l'application s'ouvrira automatiquement dans votre navigateur.

Processus d'installation du développeur

Déploiement de Docker (recommandé)

docker run \ -e GRADIO_SERVER_NAME=0.0.0.0 \ -e GRADIO_SERVER_PORT=7860 \ -p 7860:7860 -it --rm \ taprosoft/kotaemon:v1.0

Allez sur http://localhost:7860/ pour accéder à l'interface web.

Déploiement du code source

Clonez et installez les paquets nécessaires dans votre nouvel environnement Python.

# optional (setup env) conda create -n kotaemon python=3.10 conda activate kotaemon # clone this repo git clone https://github.com/Cinnamon/kotaemon cd kotaemon pip install -e "libs/kotaemon[all]" pip install -e "libs/ktem"

Affichez et modifiez vos variables d'environnement (clés d'API, points d'extrémité) dans la section .env Au milieu.

(Facultatif) Pour activer la visionneuse PDF_JS dans votre navigateur, téléchargez le fichier PDF_JS_DIST et l'extrait vers le libs/ktem/ktem/assets/prebuilt

Démarrer le serveur Web

python app.py

Le nom d'utilisateur et le mot de passe par défaut sont : admin / admin. Vous pouvez configurer d'autres utilisateurs directement dans l'interface utilisateur.

Lignes directrices pour l'utilisation

- Login et gestion des documents: :

- Les utilisateurs peuvent accéder à la plateforme par le biais d'un système de connexion multi-utilisateurs pour organiser et gérer leurs collections de documents.

- Permet de classer les fichiers dans des collections privées ou publiques pour faciliter la collaboration et le partage.

- Fonction Q&R: :

- Les utilisateurs peuvent télécharger des documents et effectuer des opérations de questions-réponses dans l'interface.

- Prise en charge des questions-réponses multimodales et possibilité de travailler avec des documents contenant des graphiques et des tableaux.

- Personnalisation des tuyaux RAG: :

- Les développeurs peuvent personnaliser et visualiser le pipeline RAG à l'aide de l'interface utilisateur fournie.

- Grâce à la prise en charge des LLM natifs et des fournisseurs d'API les plus courants, les utilisateurs peuvent choisir le modèle qui leur convient le mieux en fonction de leurs besoins.

- recherche hybride: :

- Le système fournit un pipeline de recherche hybride qui combine des recherches en texte intégral et des recherches vectorielles afin de garantir une qualité de recherche optimale.

- Prise en charge de la fonction de réorganisation pour améliorer la pertinence des résultats de la recherche.

- soutien multimodal: :

- La plateforme prend en charge les questions-réponses multimodales et est capable de traiter des documents contenant des graphiques et des tableaux pour une expérience de questions-réponses plus complète.

Fonctionnalités avancées

- gestion des modèles: :

- Les utilisateurs peuvent organiser et gérer leurs propres LLM et modèles intégrés.

- Grâce à la prise en charge des modèles natifs et des fournisseurs d'API les plus courants, les utilisateurs peuvent choisir le bon modèle en fonction de leurs besoins.

- Collaboration et partage: :

- Les utilisateurs peuvent partager leurs chats favoris avec d'autres personnes pour faciliter la collaboration et la communication.

- La prise en charge des connexions multi-utilisateurs permet aux utilisateurs de collaborer et de partager sur la plateforme.

- Retour d'information et contributions: :

- Le projet est en cours de développement et nous accueillons volontiers les commentaires des utilisateurs, les problèmes signalés et les propositions de relations publiques.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...