Analyse approfondie et comparaison de neuf cadres de sécurité de grands modèles courants

Avec le développement rapide et l'application étendue des technologies de modélisation linguistique à grande échelle, les risques potentiels en matière de sécurité sont de plus en plus au centre de l'attention de l'industrie. Afin de relever ces défis, de nombreuses entreprises technologiques de premier plan, des organismes de normalisation et des instituts de recherche du monde entier ont élaboré et publié leurs propres cadres de sécurité. Dans le présent document, nous allons trier et analyser neuf cadres de sécurité de grands modèles représentatifs, afin de fournir une référence claire aux praticiens dans les domaines concernés.

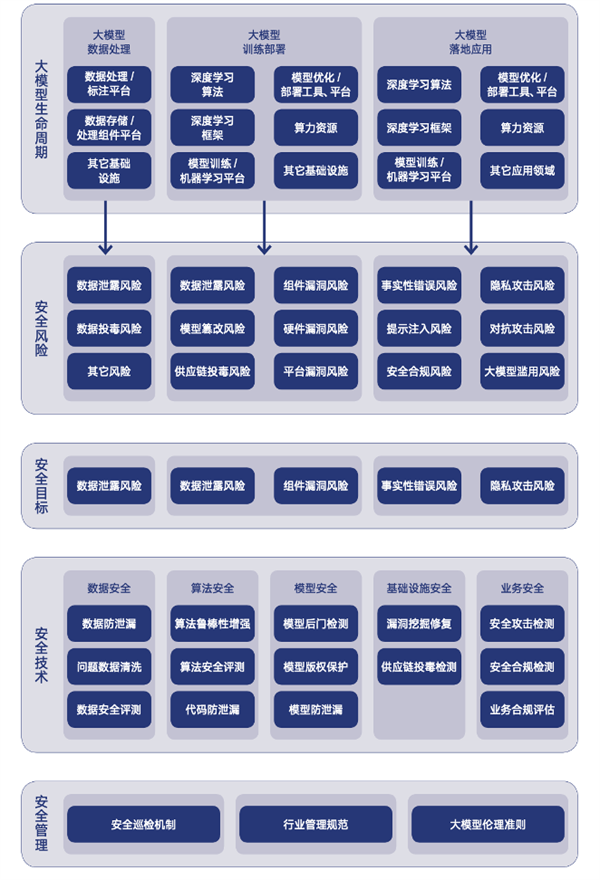

Figure : Vue d'ensemble du cadre de sécurité du Big Model

Secure AI Framework (SAIF) de Google (version 2025.04)

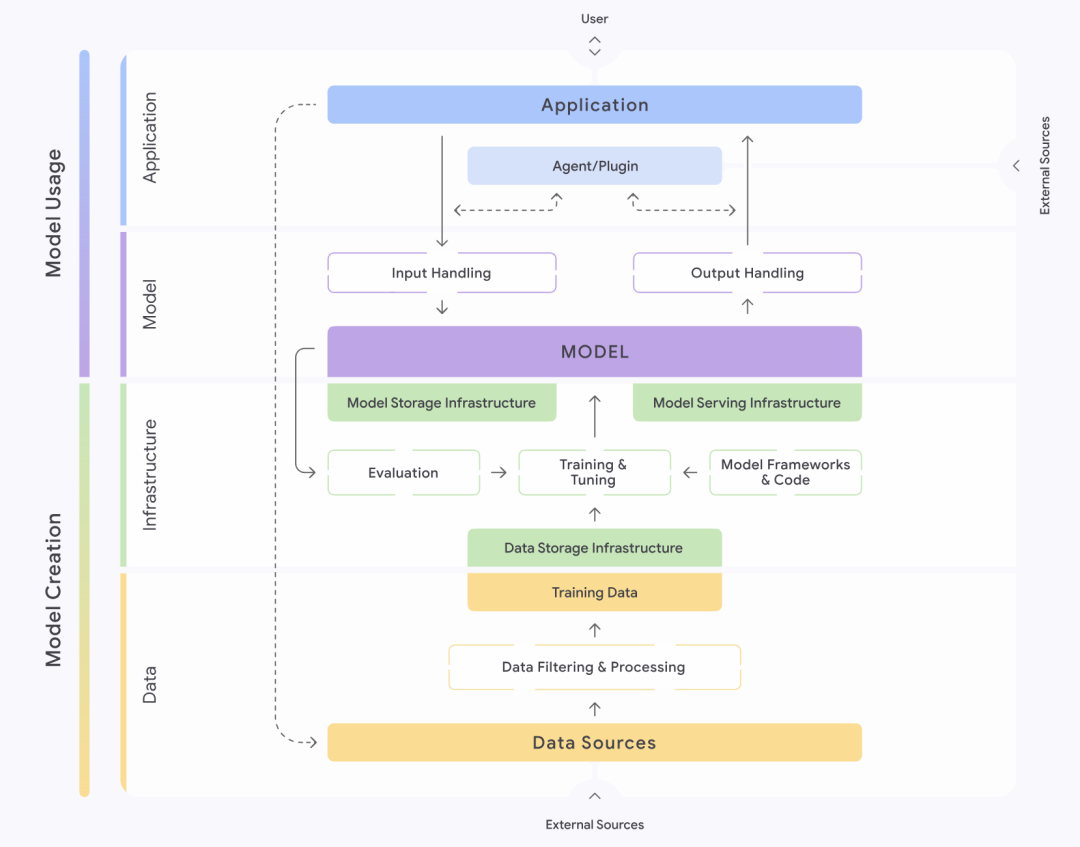

Figure : Structure du cadre de Google SAIF

Le Secure AI Framework, ou SAIF, introduit par Google (Google) fournit une approche structurée pour comprendre et gérer la sécurité des systèmes d'IA. Ce cadre divise méticuleusement les systèmes d'IA en quatre couches : données, infrastructure, modèle et application. Chaque couche est ensuite décomposée en différents composants, comme la couche de données, qui contient des éléments clés tels que les sources de données, le filtrage et le traitement des données, les données d'entraînement, etc.

Sur la base du cycle de vie complet d'un système d'IA, le SAIF identifie et trie quinze risques majeurs, qui comprennent l'empoisonnement des données, l'accès non autorisé aux données d'entraînement, la falsification de la source du modèle, le traitement excessif des données, la fuite de modèle, la falsification du déploiement du modèle, le déni de service du modèle, la rétro-ingénierie du modèle, les composants non sécurisés, les injections de mots clés, le brouillage du modèle, la fuite de données sensibles, l'accès aux données sensibles par extrapolation, les sorties de modèle non sécurisées et les comportements malveillants. non sécurisées et les comportements malveillants. En réponse à ces quinze risques, le SAIF propose également quinze mesures de prévention et de contrôle, qui constituent ses principales orientations en matière de sécurité.

OWASP's Top 10 Security Threats for Big Model Applications (version 2025.03)

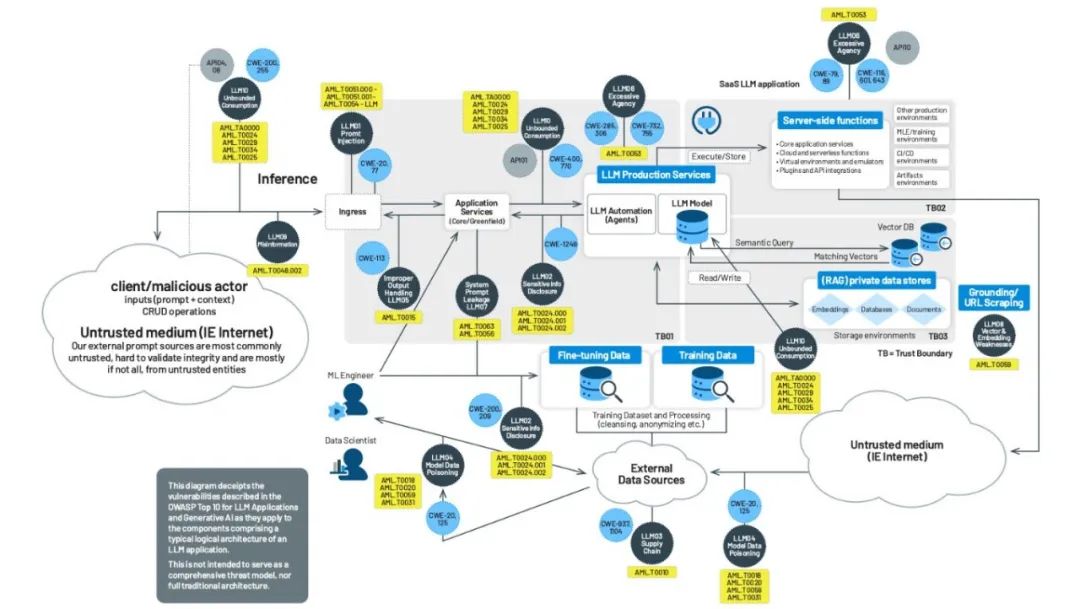

Figure : Les 10 principales menaces de sécurité pour les grands modèles d'applications de l'OWASP

L'Open World Application Security Project (OWASP), acteur majeur de la cybersécurité, a également publié sa liste des 10 principales menaces de sécurité pour les applications de type "big model". L'OWASP décompose les applications de type "big model" en plusieurs "domaines de confiance" clés, notamment le service de type "big model" lui-même, les fonctionnalités de tiers, les plugins, les bases de données privées et les données d'entraînement externes. les plugins, les bases de données privées et les données d'entraînement externes. L'organisation identifie un certain nombre de menaces de sécurité, à la fois dans les interactions entre ces domaines de confiance et à l'intérieur de ces domaines.

Les dix principales menaces de sécurité de l'OWASP sont, par ordre d'impact : l'injection d'invites, la divulgation d'informations sensibles, les risques liés à la chaîne d'approvisionnement, l'empoisonnement des données et des modèles, le traitement inapproprié des sorties, la surautorisation, la fuite d'invites du système, les vulnérabilités des vecteurs et de l'intégration, les informations trompeuses et la consommation illimitée de ressources. Pour chacune de ces menaces, l'OWASP propose des recommandations de prévention et de contrôle, fournissant ainsi des conseils pratiques aux développeurs et au personnel chargé de la sécurité.

Cadre de sécurité des modèles de l'OpenAI (mise à jour continue)

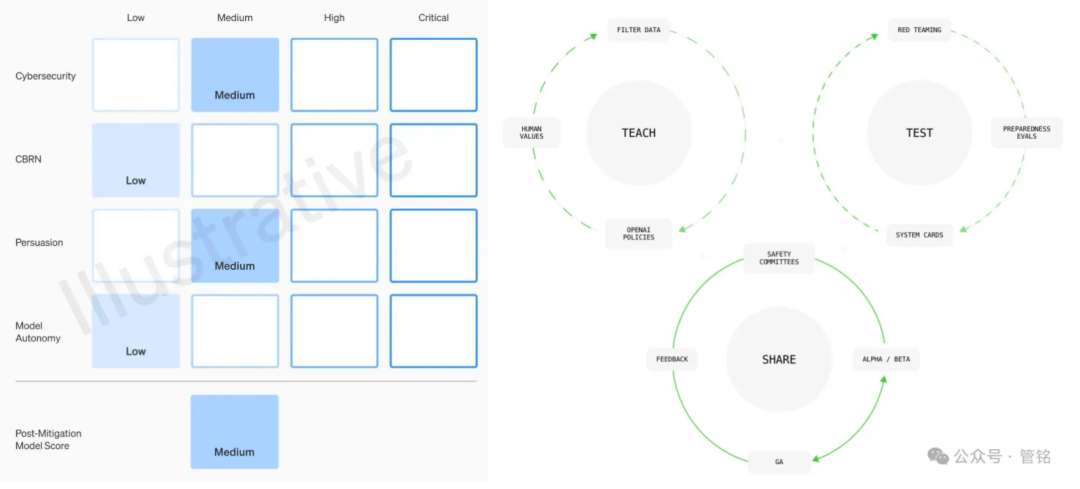

Figure : Dimensions du cadre de sécurité du modèle OpenAI

En tant que leader de la technologie des grands modèles, OpenAI accorde une grande importance à la sécurité de ses modèles. Son cadre de sécurité des modèles repose sur quatre dimensions : le risque lié aux armes de destruction massive (CBRN), la capacité de cyberattaque, le pouvoir de persuasion (la capacité des modèles à influencer les opinions et les comportements humains) et l'autonomie des modèles, qui sont classés comme faibles, moyens, élevés ou graves en fonction du niveau de préjudice potentiel. Avant chaque sortie d'un modèle, une évaluation détaillée de la sécurité, connue sous le nom de "carte système", doit être soumise sur la base de ce cadre.

En outre, l'OpenAI propose un cadre de gouvernance qui comprend l'alignement des valeurs, l'évaluation contradictoire et l'itération de contrôle. Dans la phase d'alignement des valeurs, l'OpenAI s'engage à formuler un ensemble de comportements du modèle qui sont cohérents avec les valeurs humaines universelles, et à guider le travail de nettoyage des données dans toutes les phases de la formation du modèle. Dans la phase d'évaluation contradictoire, l'OpenAI construira des cas de test professionnels pour tester complètement le modèle avant et après la prise de mesures de protection, et produira finalement des cartes de système. Dans la phase d'itération de contrôle, l'OpenAI adoptera une stratégie de lancement par lots pour les modèles qui ont déjà été déployés, et continuera d'ajouter et d'optimiser les mesures de protection.

Cadre de gouvernance de la sécurité de l'IA pour le Comité des normes de cybersécurité (publié le 2024.09)

Figure : Cadre de gouvernance de la sécurité de l'IA du comité des normes de sécurité du Net

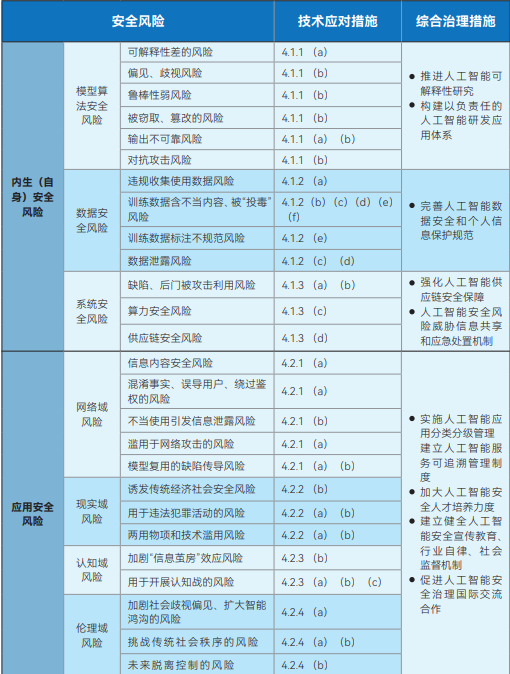

Le cadre de gouvernance de la sécurité de l'intelligence artificielle publié par le comité technique national de normalisation de la cybersécurité (NCSSTC) vise à fournir des orientations générales pour le développement sûr de l'intelligence artificielle. Le cadre divise les risques de sécurité de l'IA en deux catégories principales : les risques de sécurité endogènes (propres) et les risques de sécurité des applications. Les risques de sécurité endogènes font référence aux risques inhérents au modèle lui-même, qui comprennent principalement les risques de sécurité des algorithmes du modèle, les risques de sécurité des données et les risques de sécurité du système. Le risque de sécurité de l'application, quant à lui, fait référence aux risques auxquels le modèle peut être confronté au cours du processus d'application, et est subdivisé en quatre aspects : le domaine du réseau, le domaine de la réalité, le domaine de la cognition et le domaine de l'éthique.

En réponse à ces risques identifiés, le cadre indique clairement que les développeurs de modèles et d'algorithmes, les fournisseurs de services, les utilisateurs de systèmes et les autres parties concernées doivent prendre activement des mesures techniques pour les prévenir sous divers aspects, tels que les données d'entraînement, les installations arithmétiques, les modèles et les algorithmes, les produits et les services, ainsi que les scénarios d'application. Parallèlement, le cadre préconise la mise en place et l'amélioration d'un système global de gouvernance des risques liés à la sécurité de l'IA impliquant les institutions de recherche et de développement technologique, les fournisseurs de services, les utilisateurs, les services gouvernementaux, les associations sectorielles et les organisations sociales.

Système de normes de sécurité de l'intelligence artificielle du comité de normalisation de la cybersécurité V1.0 (version 2025.01)

Figure : Système de normes de sécurité de l'intelligence artificielle V1.0 du comité des normes de sécurité du Net

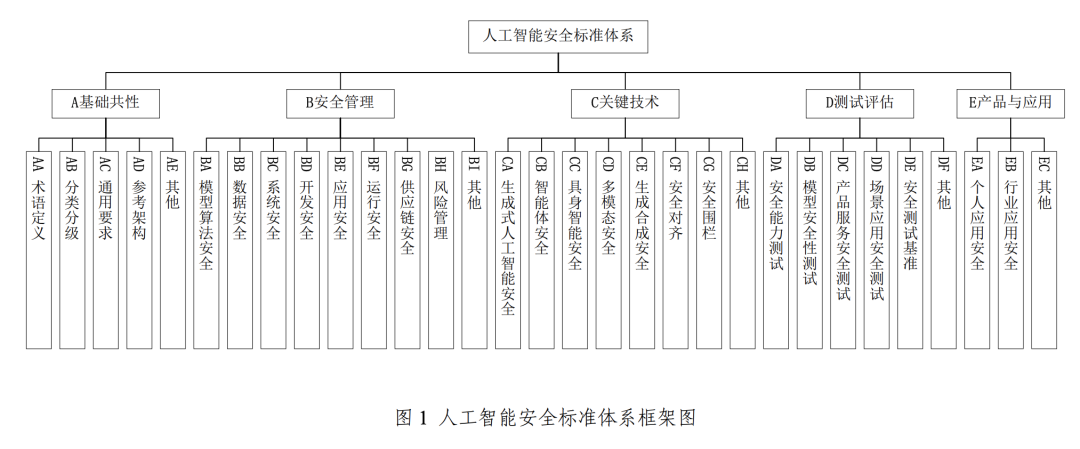

Pour soutenir et mettre en œuvre le cadre de gouvernance de la sécurité de l'intelligence artificielle susmentionné, la CCSN a également lancé le système de normes de sécurité de l'intelligence artificielle V1.0, qui compile systématiquement les normes clés qui peuvent aider à prévenir et à résoudre les risques de sécurité de l'intelligence artificielle, et se concentre sur une interface efficace avec le système de normes nationales existant pour la cybersécurité.

Ce système de normes se compose principalement de cinq parties essentielles : les caractéristiques communes de base, la gestion de la sécurité, la technologie clé, les essais et l'évaluation, ainsi que les produits et les applications. La partie relative à la gestion de la sécurité couvre la sécurité des algorithmes des modèles, la sécurité des données, la sécurité des systèmes, la sécurité du développement, la sécurité des applications, la sécurité des opérations et la sécurité de la chaîne d'approvisionnement. La section sur les technologies clés, quant à elle, se concentre sur des domaines de pointe tels que la sécurité de l'IA générative, la sécurité du corps intelligent, la sécurité de l'intelligence incarnée (qui fait référence à l'IA avec des entités physiques, telles que les robots, dont la sécurité implique des interactions avec le monde physique), la sécurité multimodale, la sécurité de la synthèse générative, l'alignement de la sécurité et les clôtures de sécurité.

Big Model Security Practices 2024 par l'Université de Tsinghua, Zhongguancun Lab et Ant Group (publié en 2024.11)

Figure : Cadre des pratiques de sécurité des grands modèles 2024

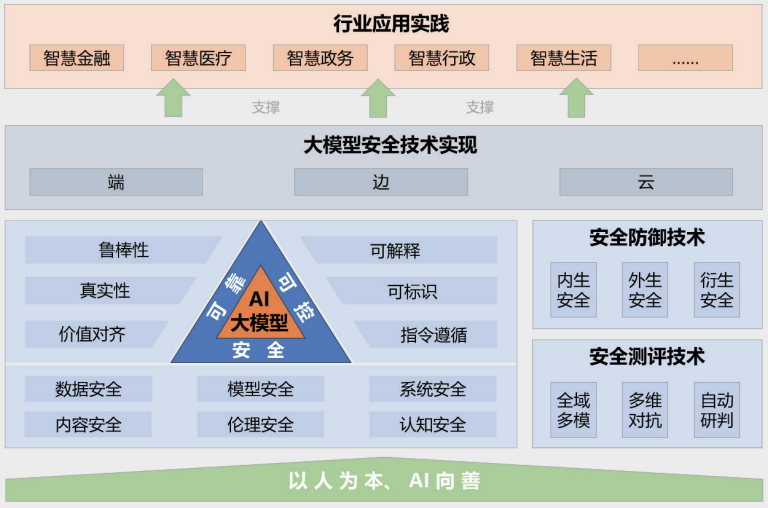

Le rapport "Big Model Security Practice 2024", publié conjointement par l'Université Tsinghua, Zhongguancun Lab et Ant Group, donne un aperçu de la sécurité des grands modèles du point de vue de l'intégration industrie-université-recherche. Le cadre de sécurité des grands modèles proposé dans le rapport comprend cinq parties principales : le principe directeur "orienté vers les personnes, l'IA pour le bien" ; un système technologique de sécurité des grands modèles sûr, fiable et contrôlable ; des technologies de mesure et de défense de la sécurité ; des mises en œuvre de technologies de sécurité collaboratives de bout en bout, de périphérie à périphérie et dans le nuage ; et des cas pratiques d'application dans de multiples industries.

Le rapport décrit en détail les nombreux risques et défis auxquels les grands modèles sont actuellement confrontés, tels que la fuite de données, le vol de données, l'empoisonnement de données, les attaques adverses, les attaques par commande (induisant des comportements non voulus dans les modèles par le biais de commandes bien conçues), les attaques par vol de modèle, les vulnérabilités en matière de sécurité matérielle, les vulnérabilités en matière de sécurité logicielle, les problèmes de sécurité dans le cadre lui-même, les risques de sécurité introduits par des outils externes, la génération de contenu toxique, la diffusion de contenu biaisé, la génération de fausses informations, les risques idéologiques, la fraude en matière de télécommunications et l'usurpation d'identité, la crise d'intégrité dans le secteur de l'éducation et les problèmes d'équité induits par les biais. risques idéologiques, fraude en matière de télécommunications et vol d'identité, violation de la propriété intellectuelle et des droits d'auteur, crise d'intégrité dans l'industrie de l'éducation et problèmes d'équité induits par les préjugés. Le rapport propose également des techniques de défense pour faire face à ces risques complexes.

Rapport de recherche sur la sécurité des grands modèles par Aliyun et ICTA (publié le 2024.09)

Figure : Cadre du rapport de recherche sur la sécurité des grands modèles d'Aliyun et de l'ICTA

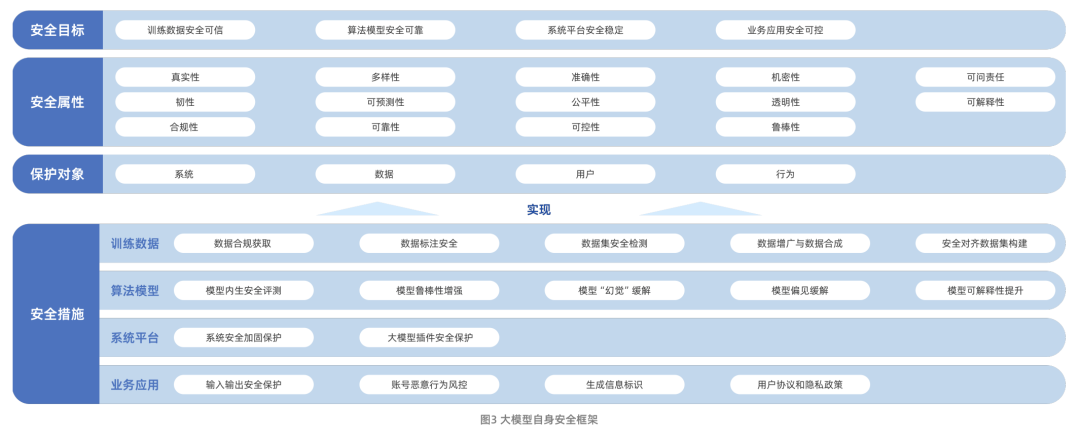

Le rapport de recherche sur la sécurité des grands modèles, publié conjointement par Aliyun et l'Académie chinoise des technologies de l'information et des communications (CAICT), décrit systématiquement l'évolution de la technologie des grands modèles et les problèmes de sécurité auxquels elle est actuellement confrontée. Ces défis comprennent principalement les risques liés à la sécurité des données, les risques liés à la sécurité des modèles algorithmiques, les risques liés à la sécurité de la plateforme du système et les risques liés à la sécurité de l'application commerciale. Il convient de noter que le rapport élargit le champ de recherche de la sécurité des grands modèles, de la sécurité du modèle lui-même à la manière d'utiliser la technologie des grands modèles pour renforcer et améliorer les capacités traditionnelles de protection de la sécurité des réseaux.

En ce qui concerne la sécurité du modèle, le rapport établit un cadre contenant quatre dimensions : les objectifs de sécurité, les attributs de sécurité, les objets de protection et les mesures de sécurité. Parmi celles-ci, les mesures de sécurité sont centrées sur les quatre aspects fondamentaux que sont les données de formation, les algorithmes du modèle, les plates-formes du système et les applications commerciales, reflétant ainsi une idée de protection globale.

Étude sur la sécurité et l'éthique du grand modèle de l'Institut de recherche de Tencent 2024 (publié le 2024.01)

Figure : Préoccupations de l'Institut de recherche de Tencent en matière de sécurité et d'éthique du Big Model

Le rapport "Big Model Security and Ethics Research 2024", publié par l'Institut de recherche Tencent, fournit une analyse approfondie des tendances de la technologie des grands modèles, ainsi que des opportunités et des défis que ces tendances représentent pour l'industrie de la sécurité. Le rapport énumère quinze risques majeurs, dont la fuite de données, l'empoisonnement de données, la falsification de modèles, l'empoisonnement de la chaîne d'approvisionnement, la vulnérabilité du matériel, la vulnérabilité des composants et la vulnérabilité de la plateforme. Parallèlement, le rapport présente quatre bonnes pratiques en matière de sécurité des grands modèles : une évaluation rapide de la sécurité, un exercice d'attaque et de défense de l'armée bleue des grands modèles, une pratique de protection du code source des grands modèles et un plan de protection de la sécurité contre la vulnérabilité de l'infrastructure des grands modèles.

Le rapport met également en évidence les progrès et les tendances futures en matière d'alignement des valeurs des grands modèles. Le rapport note que la manière de garantir que les capacités et les comportements des grands modèles sont alignés sur les valeurs humaines, les intentions réelles et les principes éthiques, afin de préserver la sécurité et la confiance dans le processus de collaboration entre les êtres humains et l'IA, est devenue un sujet central de la gouvernance des grands modèles.

La solution de sécurité Big Model de 360 (mise à jour continue)

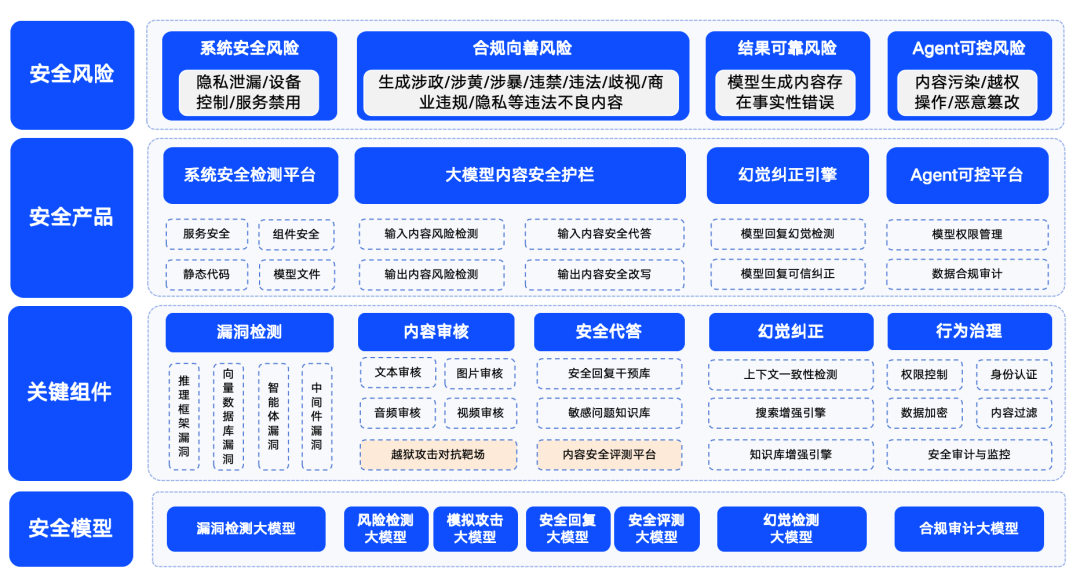

Figure : Schéma de la solution de sécurité 360 Big Model

Qihoo 360 a également activement développé le domaine de la sécurité des grands modèles et mis en avant ses solutions de sécurité. 360 résume les risques de sécurité des grands modèles en quatre catégories : les risques de sécurité du système, les risques de sécurité du contenu, les risques de sécurité de confiance et les risques de sécurité contrôlables. Parmi eux, la sécurité du système fait principalement référence à la sécurité des différents types de logiciels dans l'écosystème du grand modèle ; la sécurité du contenu se concentre sur le risque de conformité du contenu d'entrée et de sortie ; la sécurité de confiance se concentre sur la résolution du problème de "l'illusion" du modèle (c'est-à-dire que le modèle génère des informations qui semblent raisonnables mais qui ne sont pas réelles) ; et la sécurité contrôlable traite du problème plus complexe de la sécurité du processus de l'agent. La sécurité contrôlée aborde le problème plus complexe de la sécurité du processus de l'agent.

Afin de garantir que les grands modèles peuvent être sûrs, bons, crédibles et contrôlables pour une application dans diverses industries, 360 a construit une série de produits de sécurité des grands modèles basés sur sa propre accumulation de capacités dans le domaine des grands modèles. Ces produits comprennent le "360 Smart Forensics", qui vise principalement à détecter les vulnérabilités dans l'écosystème LLM, le "360 Smart Shield", qui se concentre sur la sécurité du contenu des grands modèles, et le "360 Smart Search", qui garantit une sécurité fiable. 360SmartSearch". Grâce à la combinaison de ces produits, 360 a formé un ensemble de solutions de sécurité relativement matures pour les grands modèles à un stade précoce.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...