InspireMusic : le cadre open source de génération unifiée de musique, de chansons et d'audio d'Ali

Introduction générale

InspireMusic est une boîte à outils open source basée sur PyTorch et axée sur la génération de musique, de chansons et d'audio. InspireMusic prend en charge la génération audio 24kHz et 48kHz et est capable de générer de l'audio de longue durée. L'objectif d'InspireMusic est d'aider les utilisateurs à innover en matière de paysages sonores et à améliorer l'esthétique harmonique dans la recherche musicale par le biais du processus d'étiquetage et de désétiquetage audio.

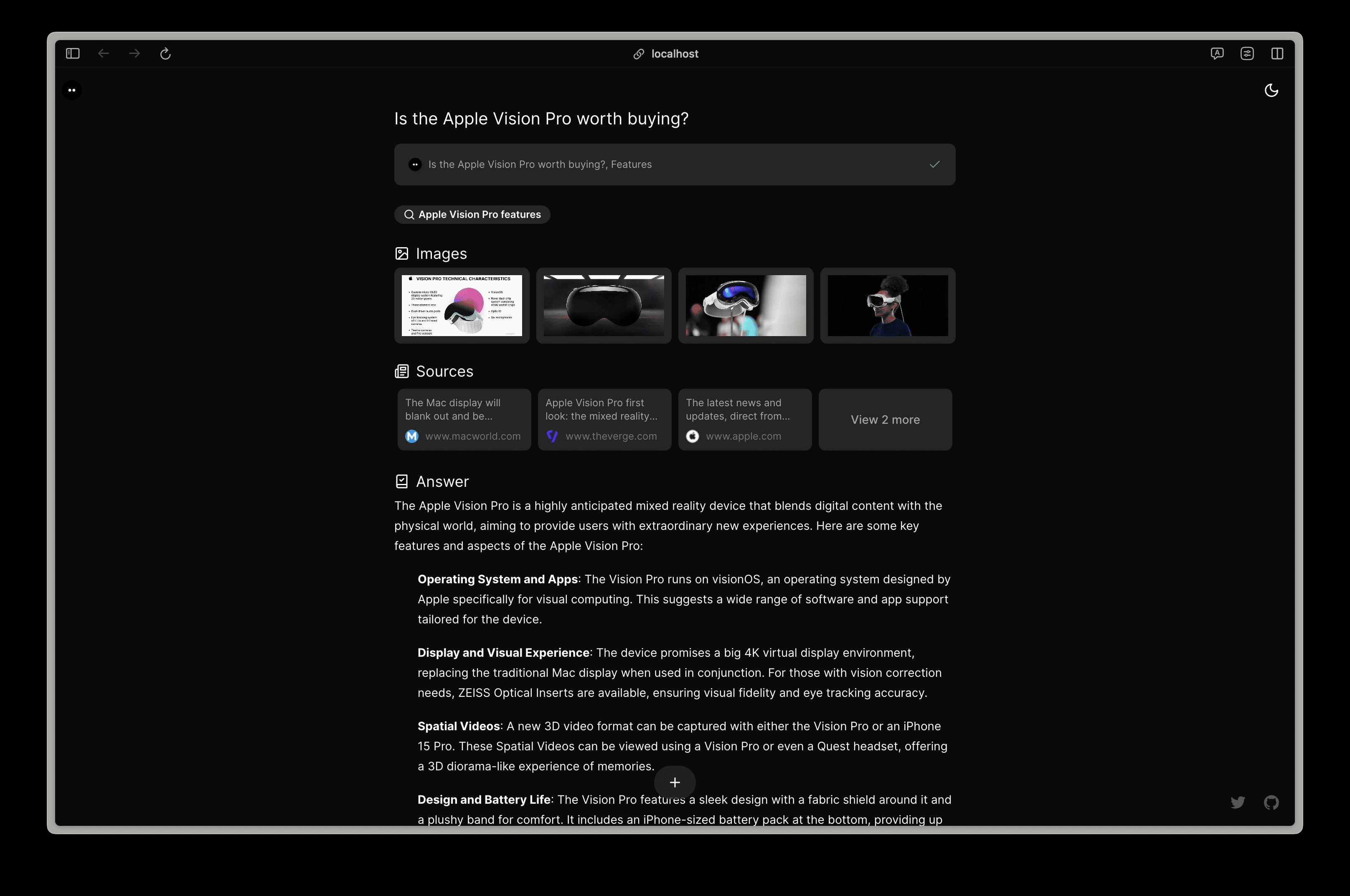

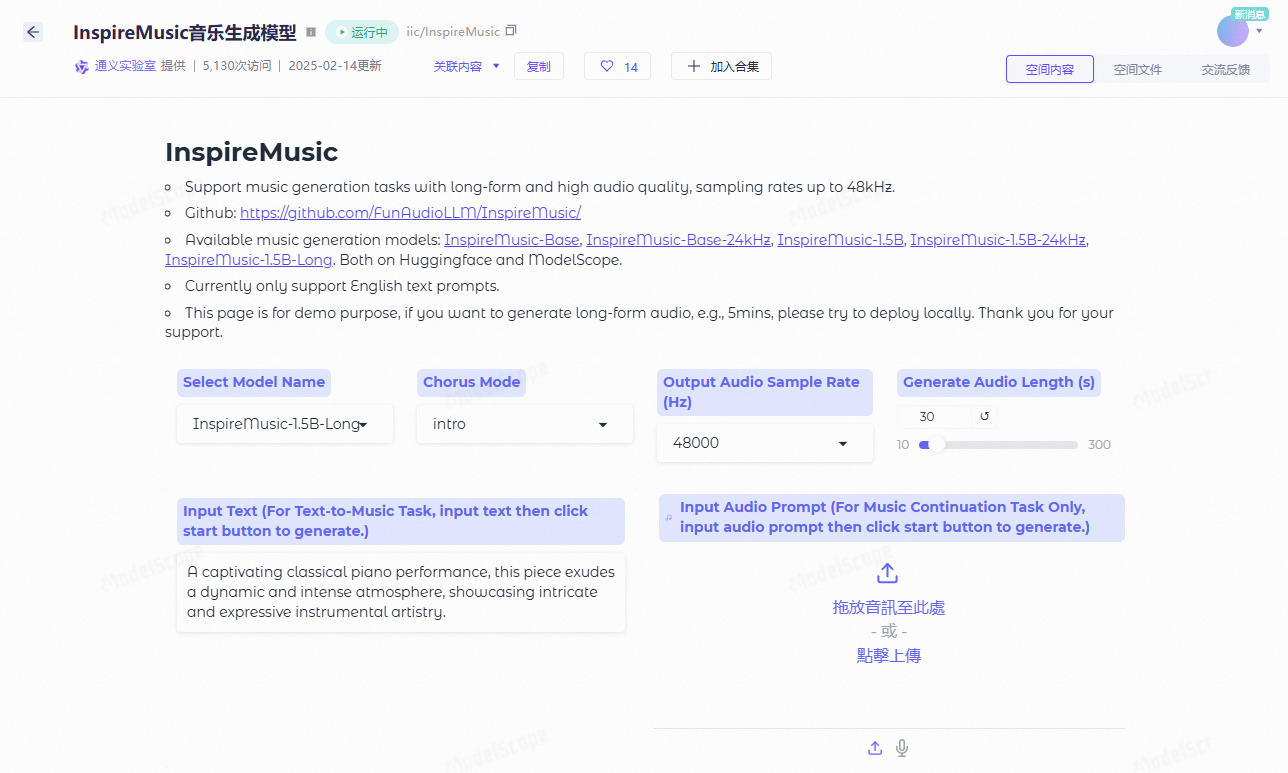

Démonstration : https://modelscope.cn/studios/iic/InspireMusic/summary

Liste des fonctions

- Du texte à la musique: Générer de la musique à partir d'indices textuels.

- Contrôle de la structure musicaleLes logiciels d'aide à la création de musique sont basés sur des structures musicales.

- Contrôle du style musicalVous pouvez contrôler le style de la musique générée.

- Génération d'un son de haute qualitéLa génération d'audio 24kHz et 48kHz est prise en charge.

- Génération audio longueLa génération d'audio de longue durée est prise en charge par le système.

- Entraînement de précision mixteLe système d'entraînement de précision mixte BF16, FP16/FP32 est pris en charge.

- Ajustement du modèle et inférenceLe système de gestion de l'information (SGI) : Il permet d'affiner et de raisonner facilement sur les scripts et les stratégies.

- Démonstration en ligneLes utilisateurs peuvent l'expérimenter sur ModelScope et HuggingFace.

Utiliser l'aide

Processus d'installation

- Entrepôt de clonage :

git clone https://github.com/FunAudioLLM/InspireMusic.git

cd InspireMusic

- Installer la dépendance :

pip install -r requirements.txt

- Installez PyTorch (choisissez la commande d'installation appropriée pour votre version de CUDA) :

pip install torch torchvision torchaudio

Lignes directrices pour l'utilisation

Du texte à la musique

- Préparez des messages-guides, par exemple : "Créez un morceau de musique de piano entraînant".

- Exécutez le script de génération :

python app.py --text "生成一段欢快的钢琴音乐"

- La musique générée sera enregistrée dans le répertoire de sortie spécifié.

Contrôle de la structure musicale

- Préparez un fichier de structure musicale qui définit les rythmes, les accords, etc. de la musique.

- Exécutez le script de génération :

python app.py --structure path/to/structure/file

- La musique générée sera basée sur le fichier de structure.

Contrôle du style musical

- Sélectionnez un style de musique prédéfini, par exemple "Classique", "Jazz", etc.

- Exécutez le script de génération :

python app.py --style "古典"

- La musique générée correspondra au style musical sélectionné.

Ajustement du modèle et inférence

InspireMusic propose des scripts de mise au point et d'inférence pratiques qui permettent aux utilisateurs d'affiner le modèle et l'inférence en fonction de leurs besoins. Voici un exemple simple de réglage fin :

- Préparer l'ensemble de données d'entraînement.

- Exécutez le script de mise au point :

python finetune.py --data path/to/dataset --output path/to/output/model

- Inférence à l'aide d'un modèle affiné :

python app.py --model path/to/output/model --text "生成一段新的音乐"

Démonstration en ligne

Les utilisateurs peuvent visiter les pages de démonstration en ligne sur ModelScope et HuggingFace pour découvrir la puissance d'InspireMusic. Il suffit de saisir des textes pour générer de la musique de haute qualité.

jian27 Integration Pack

Quark : https://pan.quark.cn/s/4843d9c54615

Baidu : https://pan.baidu.com/s/1hKIHENqPbKRBjnbVRBni7Q?pwd=2727

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...