HealthGPT : Un grand modèle médical pour soutenir l'analyse d'images médicales et les questions-réponses en matière de diagnostic

Introduction générale

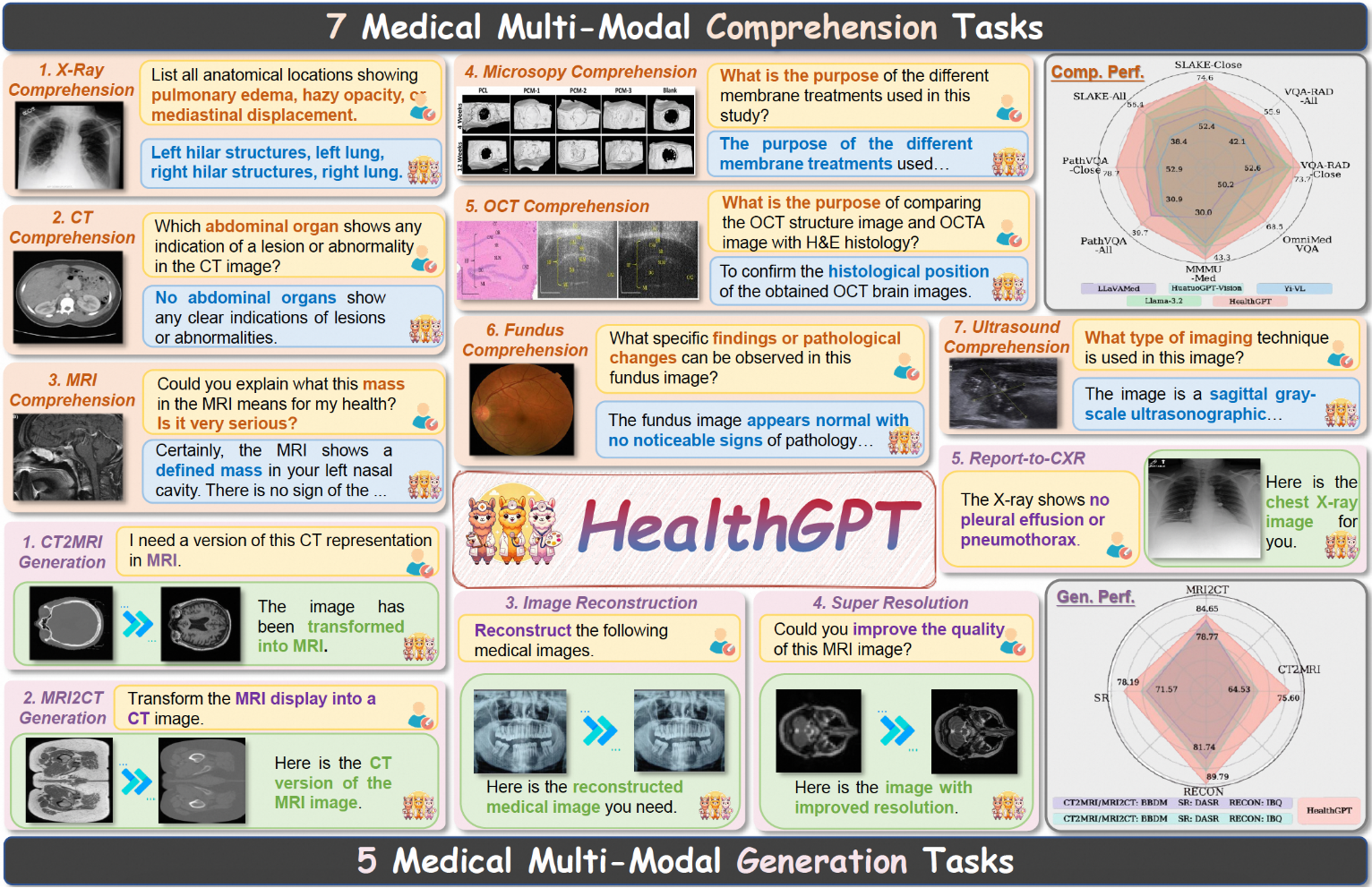

HealthGPT est un modèle de langage visuel médical de pointe qui vise à unifier les capacités de compréhension et de génération d'images médicales grâce à l'adaptation des connaissances hétérogènes. L'objectif du projet est d'intégrer la compréhension visuelle médicale et les capacités de génération dans un cadre autorégressif unifié, ce qui améliore considérablement l'efficacité et la précision du traitement des images médicales. HealthGPT prend en charge un large éventail de tâches de compréhension médicale et de tâches de génération, et est capable de bien fonctionner dans divers scénarios de traitement d'images médicales. Le projet est développé conjointement par l'université de Zhejiang, l'université des sciences et technologies électroniques, Alibaba, l'université des sciences et technologies de Hong Kong, l'université nationale de Singapour et de nombreuses autres organisations, et présente une grande valeur sur le plan de la recherche et de la pratique.

Liste des fonctions

- Questions-réponses visuelles médicales : Prise en charge d'un large éventail d'images médicales pour les tâches de questions-réponses, répondant avec précision aux questions médicales posées par les utilisateurs.

- Génération d'images médicales : capable de générer des images médicales de haute qualité pour aider au diagnostic médical et à la recherche.

- Aide à la classification des tâches : 7 types de tâches de compréhension médicale et 5 types de tâches de génération médicale sont pris en charge, couvrant ainsi un large éventail de scénarios d'application médicale.

- Architecture du modèle : le contenu textuel et visuel est généré à l'aide de la perception visuelle hiérarchique et des plugins H-LoRA, en sélectionnant les caractéristiques visuelles et les plugins H-LoRA.

- Modèle multi-version : les configurations HealthGPT-M3 et HealthGPT-L14 sont fournies pour s'adapter respectivement aux différents besoins et ressources.

Utiliser l'aide

Processus d'installation

- Préparation de l'environnement

Tout d'abord, clonez le projet et créez un environnement d'exécution Python :git clone https://github.com/DCDmllm/HealthGPT.git cd HealthGPT conda create -n HealthGPT python=3.10 conda activate HealthGPT pip install -r requirements.txt

- Préparation des poids de pré-entraînement

SantéUtilisation du GPTclip-vit-large-patch14-336En tant qu'encodeurs visuels, HealthGPT-M3 et HealthGPT-L14 sont basés respectivement surPhi-3-mini-4k-instructrépondre en chantantphi-4Préformation.

Téléchargez les poids de modèle nécessaires et placez-les dans le répertoire approprié :- Modélisation ViT :lien de téléchargement

- Modèle de base HealthGPT-M3 :lien de téléchargement

- Modèle de base HealthGPT-L14 :lien de téléchargement

- Modèle VQGAN :lien de téléchargement

- Préparation des poids H-LoRA et des poids adaptateurs

Téléchargez et placez les poids H-LoRA pour améliorer la compréhension visuelle médicale du modèle et les capacités de génération. Les poids complets seront bientôt disponibles, restez à l'écoute.

déduction

Questions et réponses sur la vision médicale

- Télécharger les documents nécessaires

- Mise à jour du chemin d'accès au script

spectacle (un billet)llava/demo/com_infer.shremplacer la variable suivante par le chemin d'accès au fichier téléchargé :- MODEL_NAME_OR_PATH : Chemin ou identifiant du modèle de base

- VIT_PATH : Chemin du poids du modèle de transformateur visuel

- HLORA_PATH : Compréhension visuelle des chemins de poids H-LoRA

- FUSION_LAYER_PATH : Chemin du poids de la couche de fusion

- Exécution de scripts

cd llava/demo bash com_infer.shIl est également possible d'exécuter directement des commandes Python :

python3 com_infer.py \ --model_name_or_path "microsoft/Phi-3-mini-4k-instruct" \ --dtype "FP16" \ --hlora_r "64" \ --hlora_alpha "128" \ --hlora_nums "4" \ --vq_idx_nums "8192" \ --instruct_template "phi3_instruct" \ --vit_path "openai/clip-vit-large-patch14-336/" \ --hlora_path "path/to/your/local/com_hlora_weights.bin" \ --fusion_layer_path "path/to/your/local/fusion_layer_weights.bin" \ --question "Your question" \ --img_path "path/to/image.jpg"

Reconstruction d'images

commandant en chef (militaire)HLORA_PATHfixé àgen_hlora_weights.binet configurer d'autres chemins d'accès au modèle :

cd llava/demo

bash gen_infer.sh

Vous pouvez également exécuter directement la commande Python suivante :

python3 gen_infer.py \

--model_name_or_path "microsoft/Phi-3-mini-4k-instruct" \

--dtype "FP16" \

--hlora_r "256" \

--hlora_alpha "512" \

--hlora_nums "4" \

--vq_idx_nums "8192" \

--instruct_template "phi3_instruct" \

--vit_path "openai/clip-vit-large-patch14-336/" \

--hlora_path "path/to/your/local/gen_hlora_weights.bin" \

--fusion_layer_path "path/to/your/local/fusion_layer_weights.bin" \

--question "Reconstruct the image." \

--img_path "path/to/image.jpg" \

--save_path "path/to/save.jpg"© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...