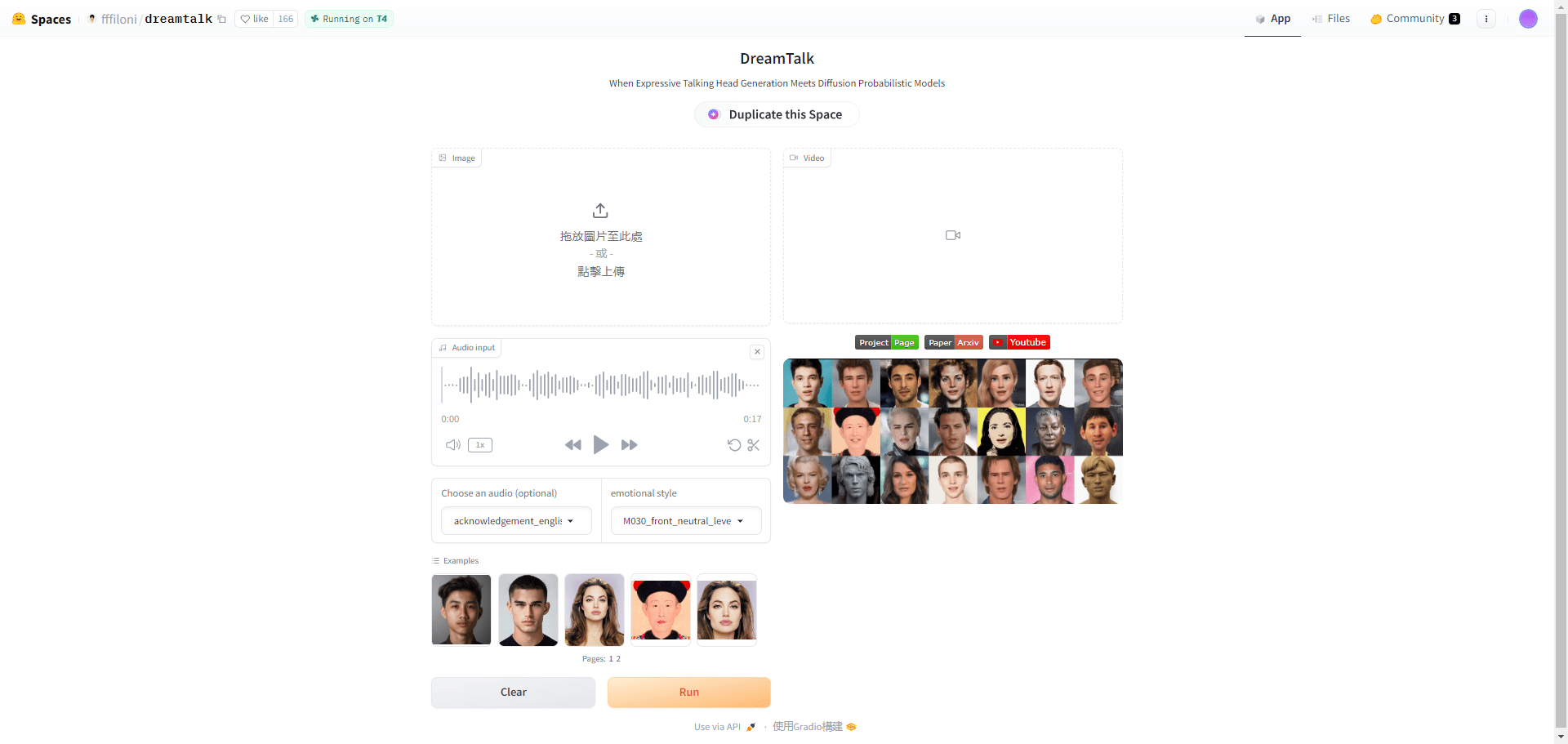

Harbor : un ensemble d'outils conteneurisés pour déployer des environnements de développement LLM locaux en un seul clic et pour gérer et exécuter facilement des services d'IA.

Introduction générale

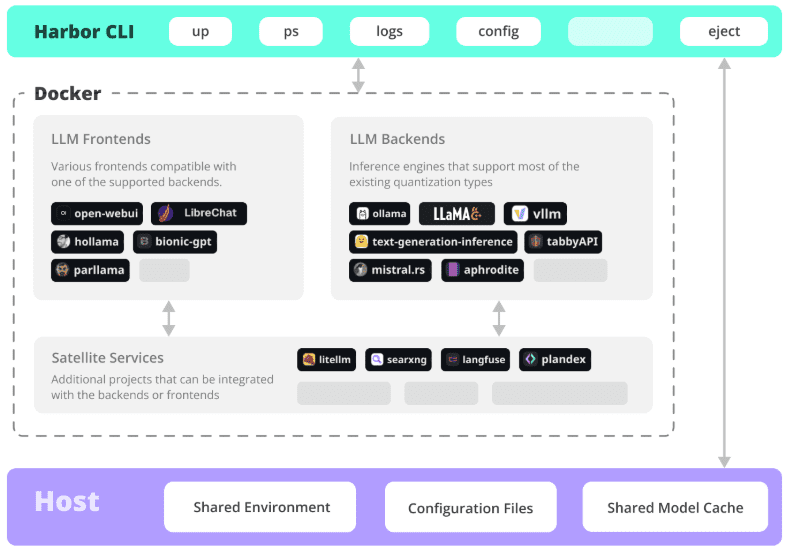

Harbor est un ensemble d'outils LLM conteneurisés révolutionnaires visant à simplifier le déploiement et la gestion d'environnements de développement d'IA locaux. Il permet aux développeurs de lancer et de gérer tous les composants du service d'IA, y compris le backend LLM, l'interface API, l'interface frontale, etc., d'un simple clic grâce à une interface de ligne de commande (CLI) concise et aux applications correspondantes. En tant que projet open source, Harbor est particulièrement adapté aux développeurs qui ont besoin de créer et d'expérimenter rapidement des applications LLM. Harbor adopte le protocole open source Apache 2.0, bénéficie d'un soutien actif de la communauté et a reçu plus de 770 étiquettes étoilées sur GitHub, et a été reconnu et utilisé par de nombreux développeurs.

Liste des fonctions

- Déploiement en un clic : démarrez un environnement de service LLM complet avec une seule commande.

- Gestion des conteneurs : intégration de Docker et de Docker Compose pour l'orchestration des services

- Support multi-backend : Compatible avec une variété de moteurs LLM et de formats de modèles (GGUF, SafeTensors, etc).

- Intégration de services : services API préconfigurés et interfaces frontales fonctionnant ensemble

- Outils de développement : fournit une chaîne complète d'outils de développement local

- Flexibilité de la configuration : prise en charge des composants de service personnalisés et des options de configuration

- Certificats SSL : prise en charge intégrée de Certbot pour une configuration aisée de l'accès HTTPS

- Migration de l'environnement : prise en charge de l'exportation de la configuration, facile à migrer vers l'environnement de production.

- Gestion de la surveillance : permet de surveiller l'état des services et de consulter les journaux.

- Contrôle des versions : gestion des différentes versions des composants du service d'intelligence artificielle.

Utiliser l'aide

1. préparation à l'environnement

1.1 Exigences du système

- Système d'exploitation : compatible avec Linux, MacOS ou Windows WSL2

- Docker Engine 20.10+

- Docker Compose 1.18.0+

- Node.js 16+ (optionnel, pour la méthode d'installation npm)

1.2 Installation de Harbor

# 方式1:使用npm安装

npm install -g @avlab/harbor

# 方式2:使用curl安装

curl -sfL https://get.harbor.ai | sh

2. utilisation de base

2.1 Démarrage des services

# 初始化Harbor环境

harbor init

# 启动所有服务

harbor up

# 查看服务状态

harbor ps

2.2 Configuration du service

# 配置模型路径

harbor config set models.path /path/to/models

# 启用特定服务

harbor enable chatui

harbor enable api

# 禁用服务

harbor disable service-name

3. fonctions avancées

3.1 Configuration du certificat SSL

# 设置环境变量

export NGINX_SSL_CERT_FILENAME=fullchain.pem

export NGINX_SSL_CERT_KEY_FILENAME=privkey.pem

export CERTBOT_DOMAIN=your_domain.com

export CERTBOT_EMAIL=your@email.com

# 获取证书

harbor ssl setup

3.2 Configuration personnalisée

# 导出配置

harbor eject

# 修改配置文件

vim harbor.yaml

# 使用自定义配置启动

harbor up -c custom-config.yaml

4. les procédures opérationnelles communes

4.1 Déploiement de nouveaux services

- Consultez la liste des services :

harbor list - Activez les services requis :

harbor enable <service-name> - Configurer les paramètres du service :

harbor config set <param> <value> - Démarrer le service :

harbor up - Vérifier l'état du service :

harbor ps

4.2 Identification des problèmes

# 查看服务日志

harbor logs <service-name>

# 检查服务状态

harbor status

# 重启服务

harbor restart <service-name>

5. les bonnes pratiques

- Sauvegarde régulière des fichiers de configuration

- Gestion des configurations personnalisées avec contrôle de version

- Contrôler l'utilisation des ressources du service

- Maintenir Harbor et ses composants à jour

- Accélérer le processus de déploiement grâce à des préréglages de projet

Services d'IA installables

utilisateur

Ouvrir l'interface WebUI ⦁︎ ComfyUI ⦁︎ LibreChat ⦁︎ ChatUI de HuggingFace ⦁︎ Chat sur le lobe ⦁︎ Hollama ⦁︎ parllama ⦁︎ BionicGPT ⦁︎ N'importe quoiLLM ⦁︎ Chat Nio

service d'arrière-plan

Ollama ⦁︎ llama.cpp ⦁︎ vLLM ⦁︎ TabbyAPI ⦁︎ Moteur Aphrodite ⦁︎ mistral.rs ⦁︎ discours ouvert ⦁︎ serveur de chuchotements plus rapide ⦁︎ Parler ⦁︎ génération de textes - inférence ⦁︎ LMDeploy ⦁︎ AirLLM ⦁︎ SGLang ⦁︎ KTransformateurs ⦁︎ Nexa SDK

Outils d'extension

Banc Harbor ⦁︎ Harbor Boost ⦁︎ SearXNG ⦁︎ Perplexica ⦁︎ Dify ⦁︎ Plandex ⦁︎ LiteLLM ⦁︎ LangFuse ⦁︎ Interprète libre ⦁ ︎nuageux (cloudflared) ⦁︎ cmdh ⦁︎ tissu ⦁︎ txtai RAG ⦁︎ TextGrad ⦁︎ Aider ⦁︎ aichat ⦁︎ omnichain ⦁︎ lm-evaluation-harness ⦁︎ JupyterLab ⦁︎ ol1 ⦁︎ Mains ouvertes ⦁︎ LitLytics ⦁︎ Repopack ⦁︎ n8n ⦁︎ Boulon.nouveau ⦁︎ Ouvrir les pipelines de l'interface WebUI ⦁︎ Qdrant ⦁︎ K6 ⦁︎ Promptfoo ⦁︎ Webtop ⦁︎ OmniParser ⦁︎ Flowise ⦁︎ Langflow ⦁︎ OptiLLM

Voir aussi Documentation sur les services Obtenez un bref aperçu de chaque service.

Étapes détaillées de l'installation d'Open WebUI avec Harbor

1. la préparation préalable

- S'assurer que Docker et Docker Compose sont installés

- Assurez-vous que le CLI Harbor est correctement installé

- S'assurer que le système répond aux exigences de base (8 Go de RAM ou plus recommandés).

2. initialisation de l'environnement Harbor

# 初始化Harbor环境

harbor init

# 验证Harbor环境

harbor doctor

3) Installation et configuration de l'Open WebUI

3.1 Activation des services de l'interface WebUI

# 启用Open WebUI服务

harbor enable webui

3.2 Configuration des paramètres de base (en option)

# 配置WebUI版本(如果需要指定特定版本)

harbor webui version <version>

# 配置WebUI端口(默认为8080)

harbor config set webui.port <port_number>

4) Activation des services

# 启动所有已启用的服务,包括WebUI

harbor up

# 或者仅启动WebUI服务

harbor up webui

5. vérification de l'installation

- Allez sur http://localhost:8080 (ou tout autre port que vous avez configuré)

- Vérifier l'état du service :

harbor ps

6. les commandes de gestion communes

Vérifier l'état du service

# 查看所有运行中的服务

harbor ps

# 查看WebUI日志

harbor logs webui

gestion des services

# 停止WebUI服务

harbor stop webui

# 重启WebUI服务

harbor restart webui

# 更新WebUI版本

harbor webui version latest

harbor restart webui

7. intégration de l'Ollama (facultatif)

Si vous souhaitez vous connecter à Ollama à l'aide de l'interface WebUI :

# 启用Ollama服务

harbor enable ollama

# 重启服务

harbor restart

8. dépannage des problèmes courants

Vérification de l'état de santé du service

harbor doctor

Afficher les messages d'erreur spécifiques

harbor logs webui

Résolution des conflits portuaires

Si le port 8080 est occupé :

# 修改WebUI端口

harbor config set webui.port 8081

harbor restart webui

9) Emplacement du fichier de configuration

- Fichier de configuration principal :

~/.harbor/.env - Configuration de l'interface WebUI :

~/.harbor/open-webui/

10. les recommandations en matière de sauvegarde

# 导出当前配置

harbor eject > harbor-backup.yaml

Mises en garde :

- S'assurer que le système dispose de ressources suffisantes pour exécuter le service.

- Le premier démarrage peut prendre un certain temps pour télécharger l'image.

- Si vous rencontrez des problèmes de permission, vérifiez les paramètres de permission de Docker

- Il est recommandé de sauvegarder régulièrement les fichiers de configuration

- Maintenir Harbor et les services connexes à la dernière version.

开始使用:

1. 完成安装后,打开浏览器访问 http://localhost:8080

2. 首次访问时会要求进行基本设置

3. 可以开始使用Open WebUI进行AI对话了

需要帮助时可以使用:

```bash

harbor help webui© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...