Rapport technique de KAG, le premier cadre de service professionnel d'amélioration des connaissances dans un domaine en Chine, qui aide les grands modèles à s'implanter dans des domaines verticaux.

Récemment, Liang Lei, responsable du moteur de connaissances du groupe Ant, a fait part des progrès réalisés par l'équipe au cours des six derniers mois dans la recherche sur la fusion du graphe de connaissances et du modèle de langage à grande échelle lors de la conférence Bund, et a publié KAG, le premier cadre de service d'amélioration des connaissances pour les domaines professionnels en Chine, qui aide à construire des intelligences professionnelles grâce à des fonctions d'amélioration des connaissances. Cet article est une compilation textuelle du contenu du rapport.

Rapports techniques connexes Adresse arXiv :https://arxiv.org/pdf/2409.13731

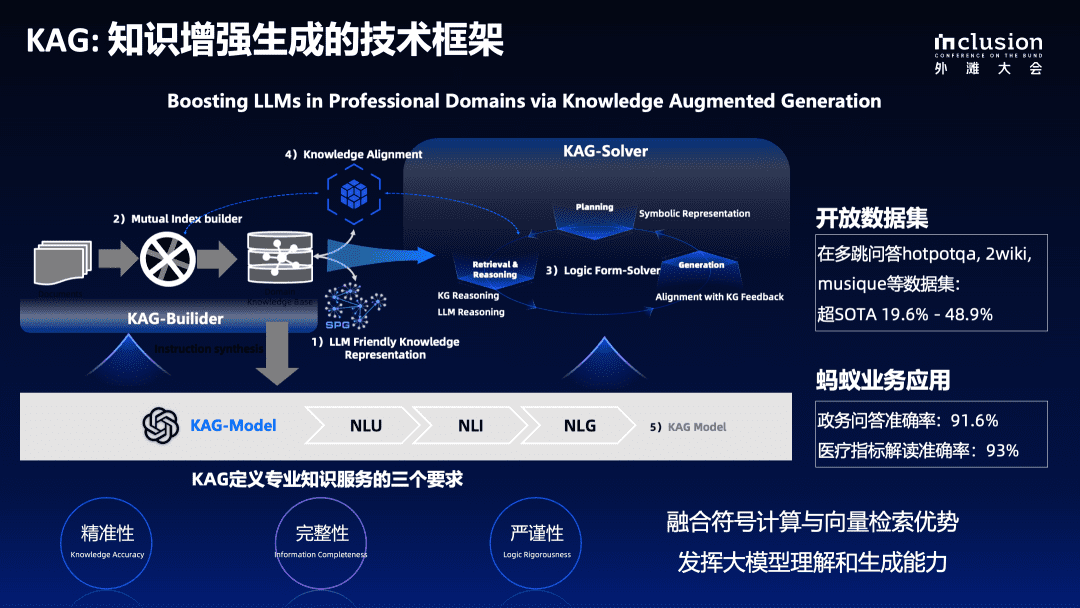

Cette fois-ci, nous avons annoncé KAG du rapport technique global. Nous espérons vraiment fusionner les avantages du calcul symbolique et de la recherche vectorielle de graphes de connaissances, car ils sont complémentaires à bien des égards. En même temps, nous construirons un système de génération de grands modèles de langage enrichi de connaissances en tirant parti des capacités de compréhension et de génération de grands modèles de langage.

Nous sommes sur le point d'être en OpenSPG Le cadre KAG est publié dans le projet open source, à l'adresse GitHub :

https://github.com/OpenSPG/KAG

Principales questions relatives à l'application de la modélisation des grands secteurs verticaux

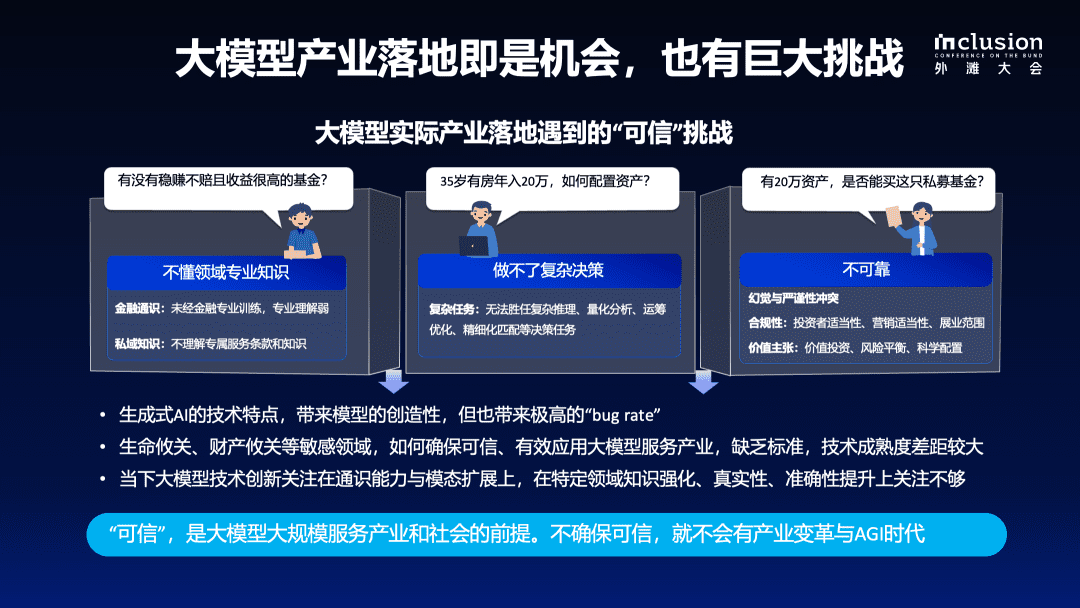

Après près de deux ans de recherche et de pratique, l'industrie a généralement reconnu les forces et les limites des grands modèles linguistiques, ainsi que les défis qu'ils posent dans les applications spécifiques à l'industrie. Bien que les modèles de grands langages aient démontré de fortes capacités de compréhension et de génération, il subsiste des problèmes tels que le manque de connaissance du domaine, la difficulté à prendre des décisions complexes et le manque de fiabilité dans les domaines professionnels. Nous pensons que la "fiabilité" est une condition préalable essentielle à la mise en œuvre des grands modèles de langage dans des scénarios réels.

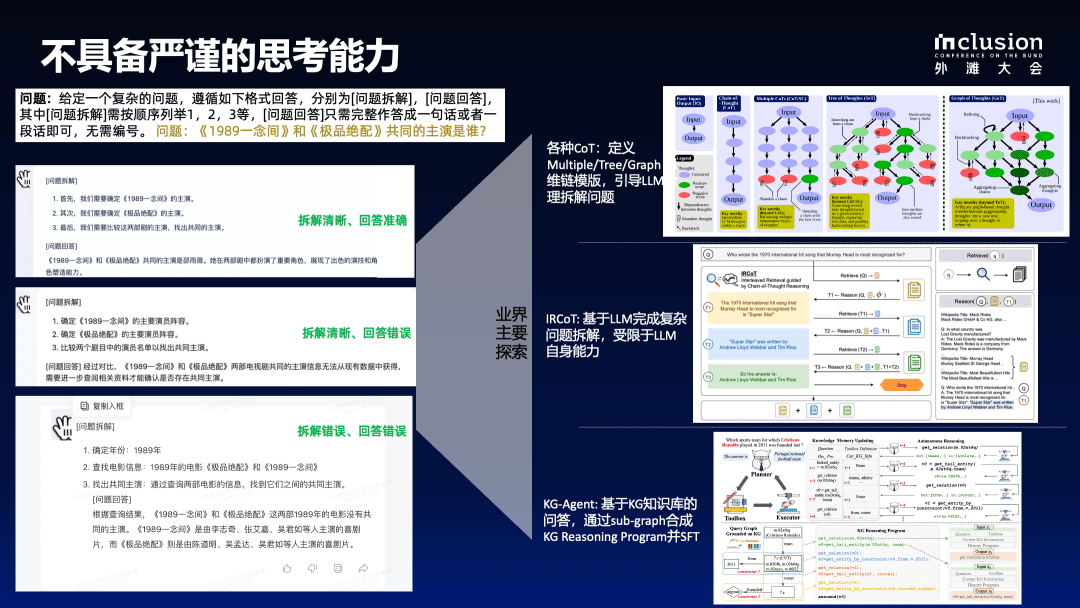

1.1 LLM n'a pas la capacité de penser de manière critique

Tout d'abord, les grands modèles de langage n'offrent pas de capacités de raisonnement rigoureuses. Par exemple, nous avons utilisé la question "Qui est la vedette commune de 1989 A Thought et The Best Match ?" Pour cette question, nous avons testé séparément plusieurs grands modèles de langage en Chine, et les résultats montrent que la précision et la cohérence des réponses sont faibles. Même si certains modèles peuvent donner une réponse, il y a des erreurs de logique ou un mauvais démontage du problème. Au fur et à mesure que les conditions deviennent plus complexes, par exemple en changeant les conditions en "acteur principal masculin" et "acteur principal féminin" ou en ajoutant des contraintes de temps, la précision et la stabilité continueront à diminuer.

Afin de résoudre ces problèmes, de nombreuses explorations ont été menées dans l'industrie. Par exemple, en construisant le modèle de la chaîne de pensée (COT) et en définissant le modèle de la chaîne de pensée multiple/arbre/graphique, le LLM est guidé pour désassembler raisonnablement le problème. Cette année, de plus en plus de recherches se sont concentrées sur l'introduction de la chaîne de pensée. RAG dans le modèle du grand langage pour compenser son manque d'informations factuelles. D'autres développements concernent GraphRAG, qui utilise des structures de graphe pour optimiser les mécanismes de recherche.

L'introduction de bases de connaissances externes est largement utilisée aujourd'hui, mais même lorsque des techniques telles que RAG sont introduites pour rendre les bases de connaissances spécifiques à un domaine ou les fichiers de faits disponibles pour la régénération dans de grands modèles linguistiques, l'exactitude des réponses générées n'est toujours pas totalement garantie.

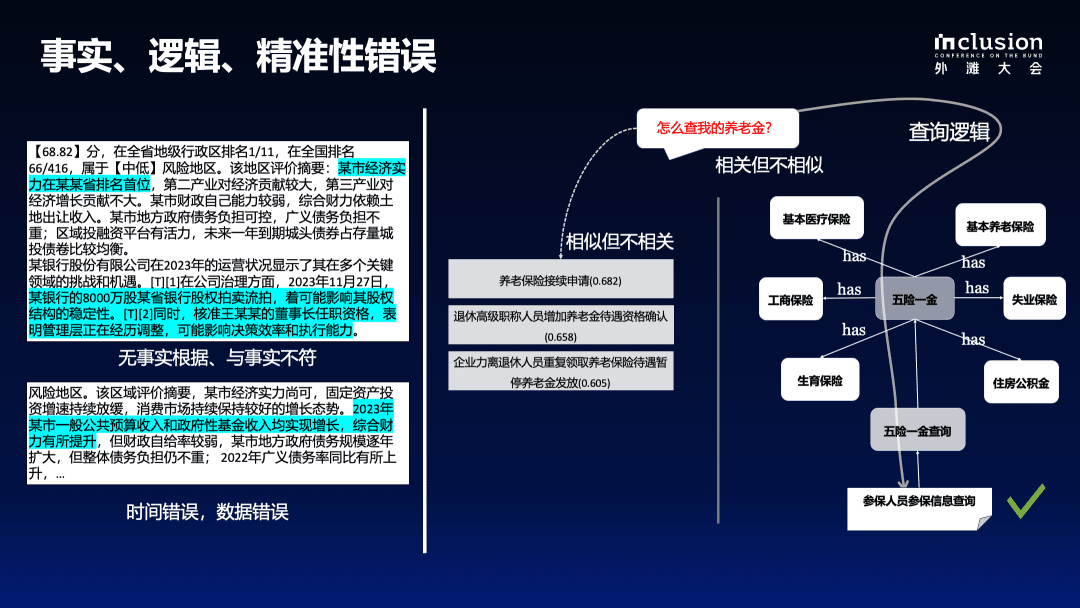

1.2 Erreurs de fait, de logique et de précision

La partie gauche de la figure ci-dessous montre un exemple d'utilisation d'un grand modèle pour interpréter un indicateur dans un rapport gouvernemental. Bien que les hommes d'affaires l'aient marqué à l'avance, le grand modèle y ajoutera toujours sa propre compréhension, ce qui donnera lieu à des informations déformées ou à des erreurs non étayées. Par exemple, il est mentionné qu'une certaine ville est classée première dans une certaine province, mais cela est incorrect du point de vue de l'entreprise. De même, l'information concernant une participation de 80 millions de dollars dans une banque qui a été vendue aux enchères n'est pas présente dans le document original. Pire encore, le modèle produit également des erreurs numériques et logiques, lorsque les indicateurs commerciaux fournis dans le document original appartiennent à 2022, mais que le contenu généré est étiqueté comme étant de 2023.

Les imprécisions dans le processus de rappel restent un problème même lorsqu'une base de connaissances externe est fournie. L'exemple ci-contre illustre les lacunes de l'approche RAG basée sur le calcul vectoriel. Par exemple, lorsqu'on demande comment trouver une pension, l'utilisation directe des vecteurs pour calculer les documents rappelés ne correspond pas aux connaissances définies par les experts métier.

Dans les domaines verticaux, de nombreuses connaissances sont étroitement liées les unes aux autres, même si elles ne semblent pas similaires à première vue. Par exemple, le terme "pension" appartient à la catégorie "cinq assurances et une pension", qui est étroitement liée à la politique nationale, et le grand modèle ne peut pas générer ces informations de manière arbitraire. Par conséquent, une structure prédéfinie de connaissances du domaine est nécessaire pour limiter le comportement du modèle et fournir une entrée de connaissances efficace.

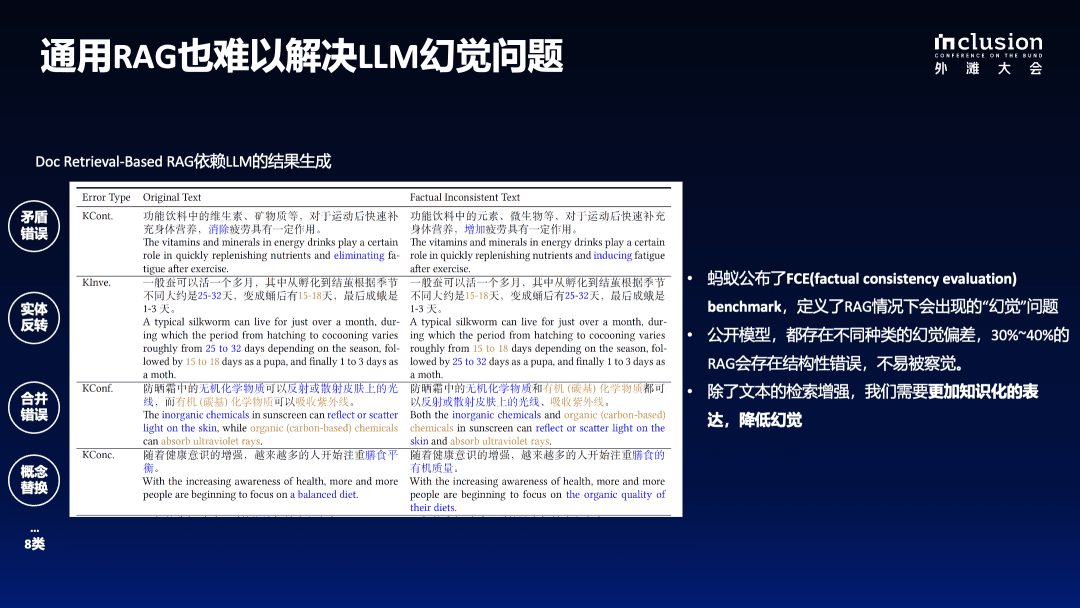

1.3 Le RAG générique peine également à résoudre les illusions du LLM

Comme le montre la figure ci-dessous, le texte original mentionne que les vitamines et les minéraux contenus dans les boissons fonctionnelles sont bénéfiques pour reconstituer le corps et éliminer la fatigue après l'exercice, mais après la réécriture du modèle, il peut être décrit à tort comme "ayant un certain effet sur l'augmentation de la fatigue", ce qui constitue un message trompeur qui causera du tort aux utilisateurs.

En outre, il y a des problèmes avec les inversions d'entités, comme la réécriture de la phrase originale de "15-18 jours après être devenu une chrysalide" à "25-32 jours après être devenu une chrysalide". Ces types d'erreurs de détail deviennent plus difficiles à détecter lorsque le modèle génère des centaines, voire des milliers de mots de contenu.

Selon les résultats de l'évaluation, même avec l'incorporation de la technique RAG, le grand modèle linguistique souffre toujours d'un taux de fantômes de 30%-40%, ce qui représente un pourcentage assez élevé. Par conséquent, lors de l'application de modèles linguistiques de grande taille dans des domaines verticaux, ceux-ci doivent répondre à des exigences de professionnalisme extrêmement élevées.

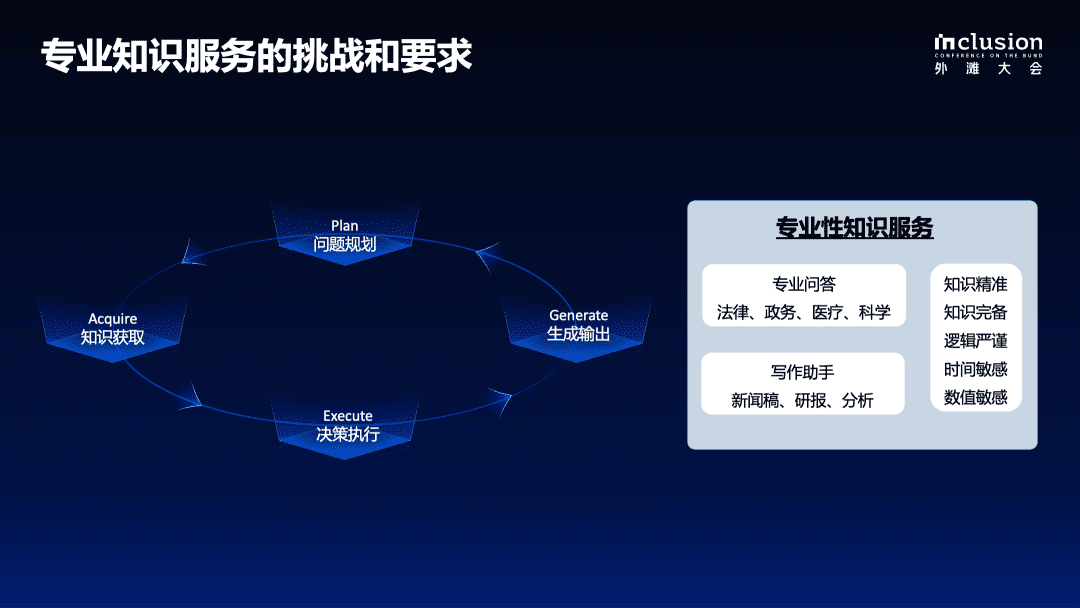

1.4 Défis et exigences en matière de services de connaissances professionnelles

Dans les scénarios décisionnels réels, qu'il s'agisse de produire un rapport de recherche ou de traiter une demande d'assurance automobile, la résolution de problèmes complexes nécessite un processus rigoureux, étape par étape, qui comprend la planification du problème, la collecte de données, l'exécution de la décision, ainsi que la production et la communication d'un retour d'information. Un processus décisionnel rigoureux et contrôlé doit également être mis en place lors de l'application de Big Language Models à des domaines professionnels.

Lorsque des services d'expertise sont fournis sur la base d'un grand modèle, plusieurs conditions doivent être remplies afin de mieux servir la communauté et les domaines spécifiques :

- Premièrement, il est important de garantir l'exactitude des connaissances, y compris l'intégrité de leurs limites et la clarté de leur structure et de leur sémantique ;

- Deuxièmement, la rigueur logique, la sensibilité au temps et la sensibilité numérique sont nécessaires ;

- Enfin, des informations contextuelles complètes sont nécessaires pour faciliter l'accès à des informations complémentaires complètes lors de la prise de décisions fondées sur la connaissance ;

Il s'agit également d'une capacité qui fait actuellement défaut dans la plupart des grands modèles. C'est pourquoi, au cours du premier semestre de cette année, nous avons mené de nombreuses explorations et avons formellement commencé à construire un cadre de génération contrôlée basé sur l'amélioration des connaissances pour les domaines verticaux.

KAG : Knowledge Augmentation Service Framework for Areas of Expertise (cadre de services d'enrichissement des connaissances pour les domaines d'expertise)

La figure ci-dessous illustre le principe de notre cadre général de génération améliorée des connaissances (KAG), qui est basé sur le principe de la génération améliorée des connaissances. OpenSPG Mises à jour basées sur des projets open source. Nous avons apporté des améliorations à cinq aspects de la combinaison actuelle de grands modèles de langage et de graphes de connaissances :

Tout d'abord, nous améliorons la représentation des connaissances. Le graphe de connaissances original est contraint par un schéma fort, ce qui conduit à un seuil d'application élevé et à des données éparses, le rendant souvent insoluble lorsqu'il s'agit de répondre à des questions dans des domaines verticaux. C'est pourquoi nous avons optimisé et amélioré la représentation des connaissances pour les grands modèles de langage, de sorte que le graphe de connaissances puisse mieux prendre en charge l'application de grands modèles de langage.

Deuxièmement, les graphiques constituent un excellent outil d'intégration pour mieux relier tous les types de connaissances, qu'il s'agisse de connaissances académiques rigoureuses ou d'informations contenues dans un texte. C'est pourquoi.Nous avons créé une structure d'index mutuel, passant d'un index inversé basé sur les termes à un index inversé basé sur les graphes.Cela permet non seulement d'indexer efficacement les documents, mais aussi de maintenir les associations sémantiques entre les documents et la cohérence entre les entités.

Troisièmement, au cours du processus de raisonnement, nous utilisons le désassemblage symbolique pour garantir la rigueur logique. Il est difficile d'assurer la cohérence logique du langage généré par le modèle linguistique, c'est pourquoi nous introduisons le résolveur et le raisonnement basés sur la forme logique pour la désambiguïsation basée sur les symboles.

Quatrièmement, afin de combler le fossé entre le coût de construction du graphe de connaissances et l'efficacité de l'application pratique, nous empruntons la méthode d'extraction des informations ouvertes pour construire le graphe de connaissances, ce qui réduit considérablement le coût de construction mais introduit également plus de bruit. Par conséquent, nous introduisons le mécanisme d'alignement des connaissances, qui utilise les connaissances conceptuelles pour compléter l'alignement entre les informations ouvertes et les connaissances du domaine, afin d'équilibrer les besoins d'extraction d'informations ouvertes et d'alignement sémantique.

Enfin, nous avons développé le modèle KAG dans le but de mieux intégrer les capacités des modèles de langage à grande échelle et des graphes de connaissances afin d'obtenir une synergie plus efficace. L'interaction organique entre les deux est facilitée par la synthèse des instructions, dans le but ultime d'intégrer pleinement les avantages du calcul symbolique et de la recherche vectorielle, et de faire jouer pleinement les capacités de compréhension et de génération des modèles de langage, de manière à promouvoir leur application et l'amélioration de leurs capacités dans des domaines verticaux.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...