Groq : fournisseur de solutions d'accélération de l'inférence de grands modèles d'IA, interface de grands modèles gratuite et à grande vitesse

Introduction générale à Groq

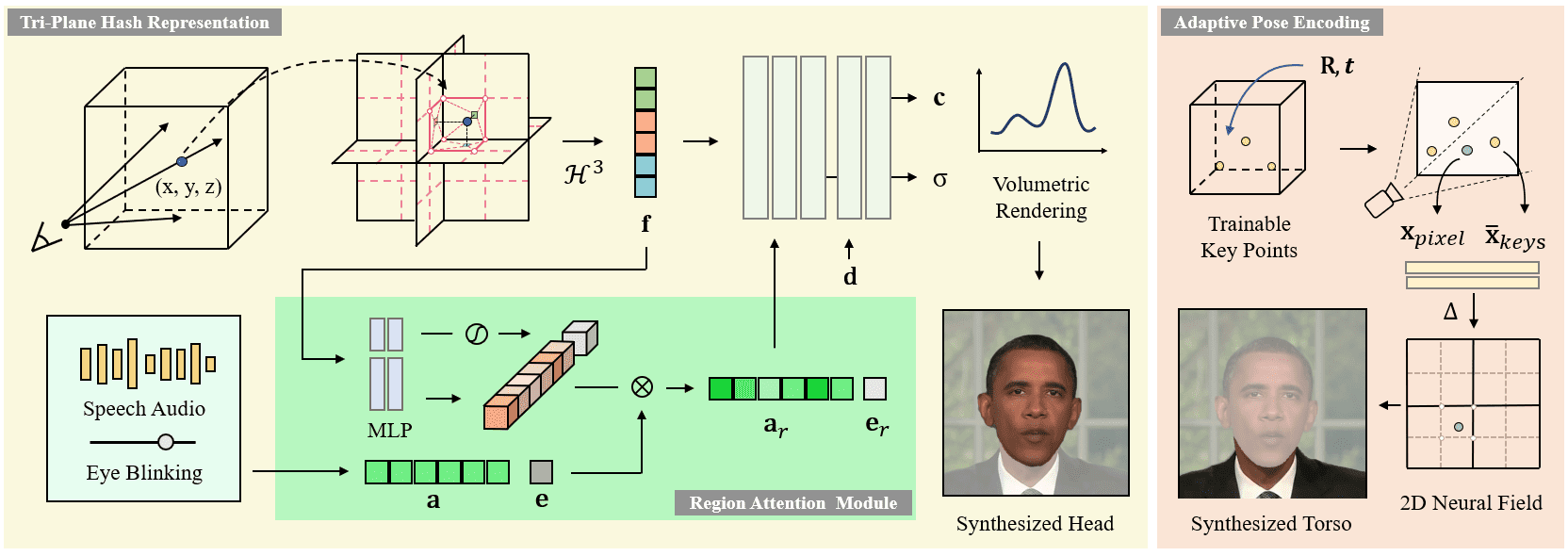

Groq, une entreprise basée à Mountain View, en Californie, a développé la GroqChip™ et la Language Processing Unit™ (LPU). Connue pour ses unités de traitement tensoriel développées pour les applications d'IA à faible latence.

Groq a été fondée en 2016 et son nom a été officiellement déposé la même année.Le principal produit de Groq est la Language Processing Unit (LPU), une nouvelle classe de puces conçues non pas pour former des modèles d'IA, mais pour les exécuter rapidement.Les systèmes LPU de Groq ont ouvert la voie à une nouvelle génération d'accélération de l'IA, conçue pour traiter des données séquentielles (par exemple, l'ADN, la musique, le code...), langage naturel) et surpasser les GPU.

Ils visent à fournir des solutions pour les applications d'IA en temps réel, revendiquant des performances d'IA de premier plan dans les centres de calcul, caractérisées par la vitesse et la précision.Groq prend en charge les cadres d'apprentissage machine standard tels que PyTorch, TensorFlow et ONNX. En plus de cela, ils proposent la suite GroqWare™, qui comprend des outils pour le développement personnalisé et l'optimisation des charges de travail, tels que le Groq Compiler.

Liste des fonctionnalités de Groq

- Traitement des applications d'IA en temps réel

- Prise en charge des cadres d'apprentissage automatique standard

- Prise en charge du matériel léger SaaS et PaaS

- Des performances d'IA rapides et précises

- GroqWare™ Suite pour des charges de travail optimisées et personnalisées

- Garantir des performances d'inférence à grande échelle précises, efficaces sur le plan énergétique et reproductibles

Aide Groq

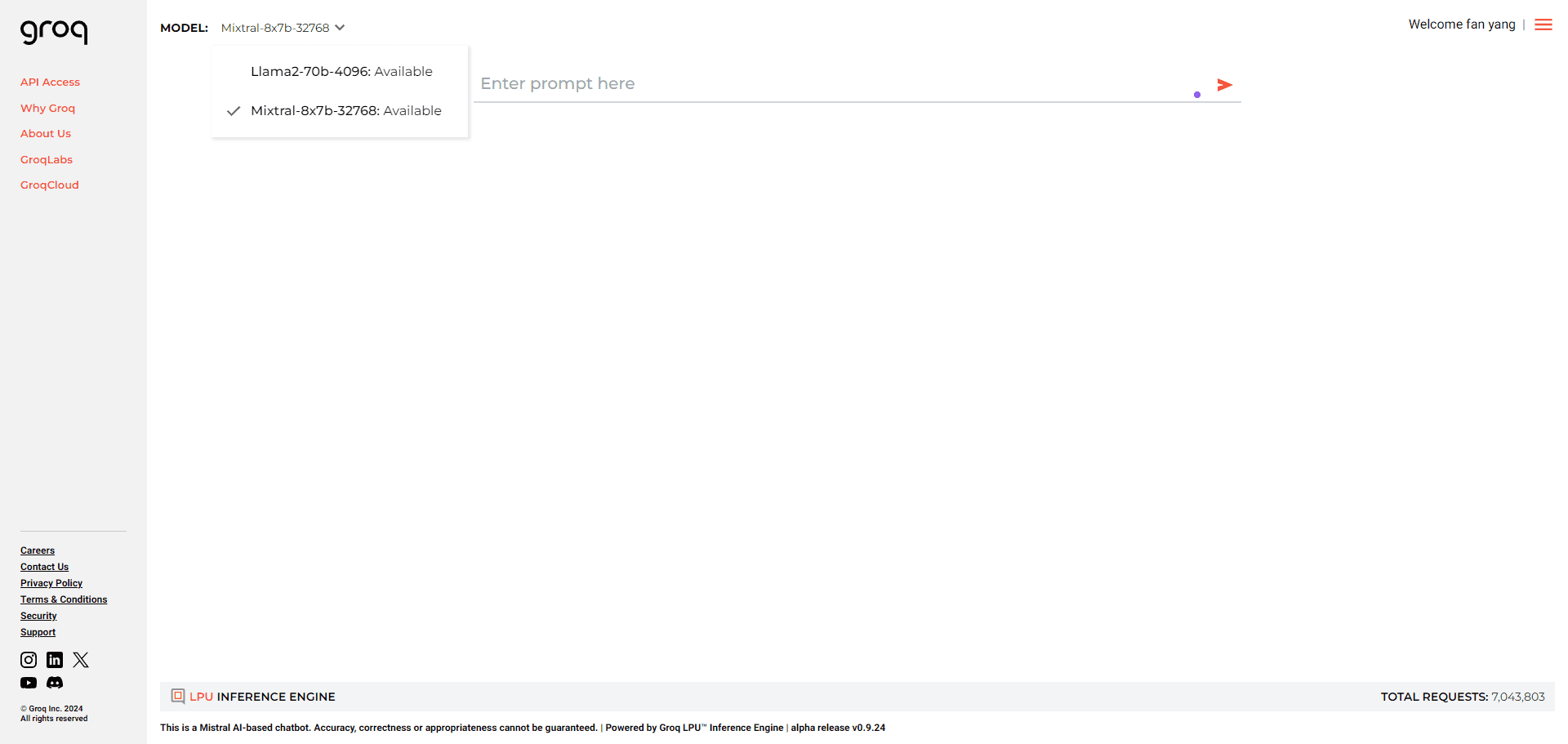

- Les développeurs peuvent bénéficier d'un accès en libre-service par l'intermédiaire de Playground sur GroqCloud.

- Si vous utilisez actuellement l'API OpenAI, vous n'avez besoin que de trois éléments pour la convertir en Groq : une clé API Groq, un point de terminaison et un modèle.

- Si vous avez besoin du raisonnement le plus rapide à l'échelle d'un centre de données, nous devrions en discuter.

Vous pouvez.Cliquez iciDemandez l'APIKEY gratuitement et choisissez le modèle une fois la demande terminée :

Achèvement du chat

| ID | Demandes par minute | Demandes par jour | Jetons par minute | Jetons par jour |

|---|---|---|---|---|

| gemma-7b-it | 30 | 14,400 | 15,000 | 500,000 |

| gemma2-9b-it | 30 | 14,400 | 15,000 | 500,000 |

| llama-3.1-70b-versatile | 30 | 14,400 | 20,000 | 500,000 |

| llama-3.1-8b-instant | 30 | 14,400 | 20,000 | 500,000 |

| llama-3.2-11b-text-preview | 30 | 7,000 | 7,000 | 500,000 |

| llama-3.2-1b-preview | 30 | 7,000 | 7,000 | 500,000 |

| llama-3.2-3b-preview | 30 | 7,000 | 7,000 | 500,000 |

| llama-3.2-90b-text-preview | 30 | 7,000 | 7,000 | 500,000 |

| llama-guard-3-8b | 30 | 14,400 | 15,000 | 500,000 |

| llama3-70b-8192 | 30 | 14,400 | 6,000 | 500,000 |

| llama3-8b-8192 | 30 | 14,400 | 30,000 | 500,000 |

| llama3-groq-70b-8192-tool-use-preview | 30 | 14,400 | 15,000 | 500,000 |

| llama3-groq-8b-8192-tool-use-preview | 30 | 14,400 | 15,000 | 500,000 |

| llava-v1.5-7b-4096-preview | 30 | 14,400 | 30,000 | (Pas de limite) |

| mixtral-8x7b-32768 | 30 | 14,400 | 5,000 | 500,000 |

Synthèse vocale

| ID | Demandes par minute | Demandes par jour | Seconde audio par heure | Secondes audio par jour |

|---|---|---|---|---|

| distil-whisper-large-v3-fr | 20 | 2,000 | 7,200 | 28,800 |

| chuchotement-large-v3 | 20 | 2,000 | 7,200 | 28,800 |

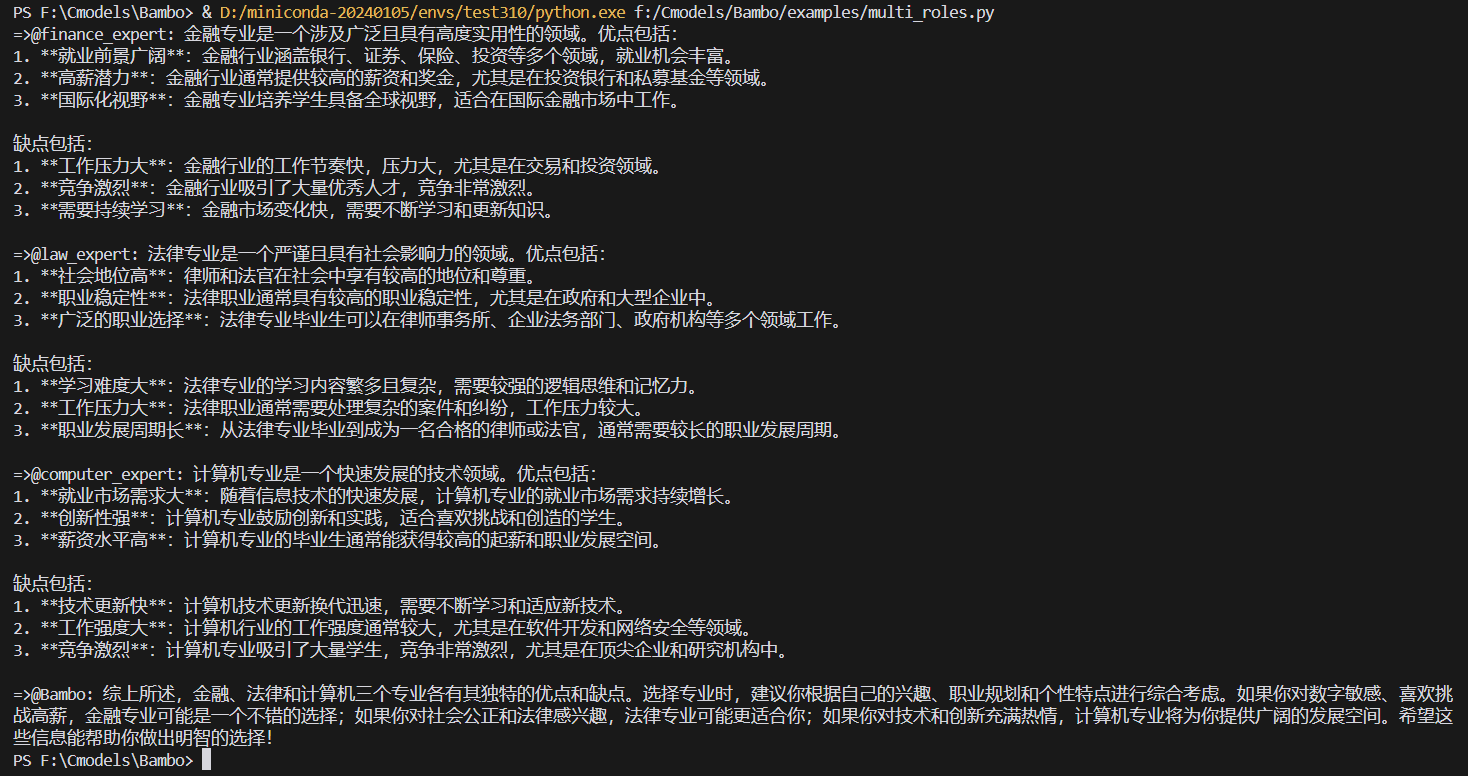

Ensuite, prenons l'exemple du format curl, cette interface est compatible avec le format d'interface OPENAI, alors laissez libre cours à votre imagination, tant qu'il existe des interfaces permettant la personnalisation de l'API OPENAI, ainsi que l'utilisation de Groq.

curl -X POST "https://api.groq.com/openai/v1/chat/completions" \N - curl -X POST "https://api.groq.com/openai/v1/chat/completions" \N

-H "Authorisation : Bearer $GROQ_API_KEY" \N -H "Authorisation : Bearer $GROQ_API_KEY" \N -H

-H "Content-Type : application/json" \N -H "Content-Type : application/json" -H "Content-Type : application/json" \N

-d '{"messages" : [{"role" : "user", "content" : "Explain importance of low latency LLMs"}], "model" : "mixtral-8x7b-32768"}'

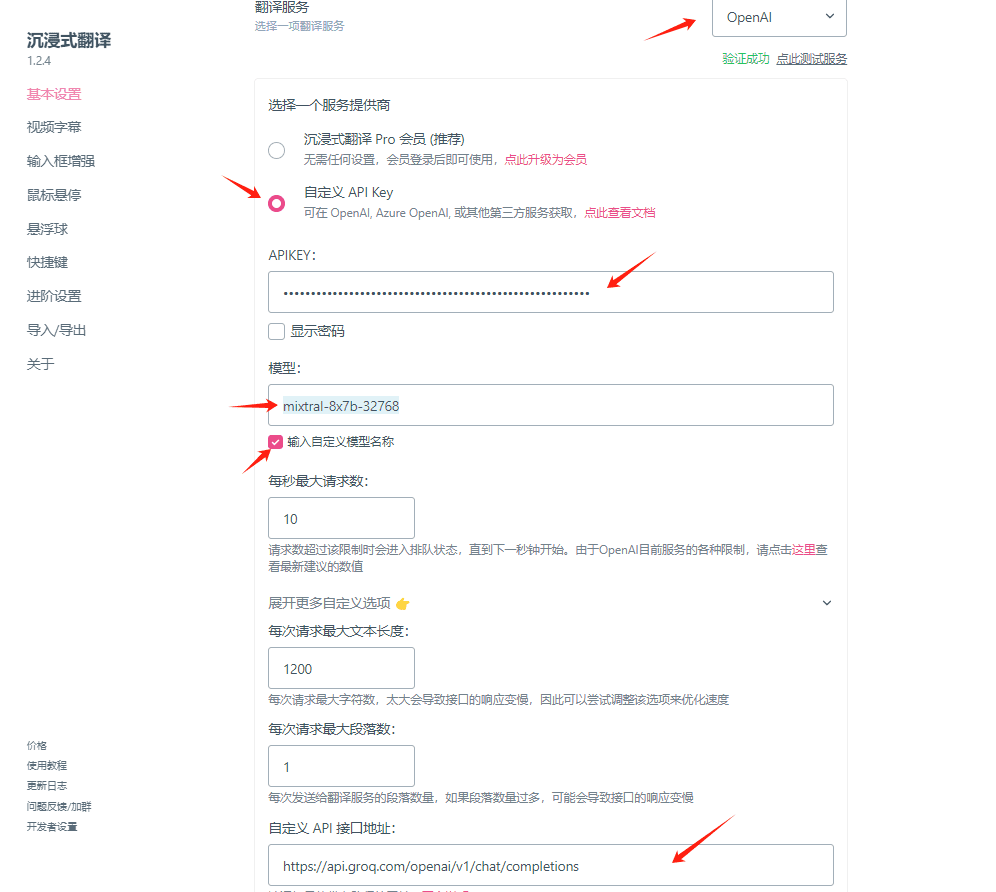

Exemple d'utilisation : configuration des clés Groq à utiliser dans le plugin Immersive Translation

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...