GPT4All : un client de modèle linguistique de grande taille fonctionnant sur des unités centrales, axé sur la localisation et la sécurité des données

GPT4All Introduction générale

GPT-4All est un projet open source développé par Nomic pour permettre aux utilisateurs d'exécuter de grands modèles linguistiques (LLM) sur des appareils locaux. En mettant l'accent sur la protection de la vie privée, le projet peut être utilisé sans connexion Internet et convient aussi bien aux particuliers qu'aux entreprises. GPT-4All prend en charge une large gamme de matériel, notamment les puces Mac série M, les GPU AMD et NVIDIA, et peut être facilement utilisé par les utilisateurs sur des ordinateurs de bureau et des ordinateurs portables. Le projet offre également un modèle open source riche et un soutien communautaire, permettant aux utilisateurs de personnaliser l'expérience du chatbot en fonction de leurs besoins.

GPT4All est un écosystème permettant d'exécuter des modèles de langage à grande échelle, puissants et personnalisés, qui fonctionnent nativement sur des processeurs grand public et n'importe quel GPU. Veuillez noter que votre processeur doit supporter les instructions AVX ou AVX2.

Le modèle GPT4All est un fichier de 3 à 8 Go que vous pouvez télécharger et insérer dans le logiciel de l'écosystème open source GPT4All. Nomic AI soutient et entretient cet écosystème logiciel afin d'en garantir la qualité et la sécurité et est le fer de lance des efforts visant à permettre à toute personne ou organisation de former et de déployer facilement ses propres modèles de langage à grande échelle.

Il ne nécessite pas de GPU ni de connexion internet et est capable de réaliser des inférences en temps réel sur le M1 Mac.

caractérisation

Votre chat est privé et ne quitte jamais votre appareil !

La confidentialité et la sécurité sont les premières priorités de GPT4All. Utilisez LLM pour gérer vos données locales sensibles qui ne quittent jamais votre appareil.

Exécution de modèles linguistiques sur du matériel grand public

GPT4All vous permet d'exécuter LLM à la fois sur les CPU et les GPU, avec une prise en charge complète des puces Mac série M, des GPU AMD et NVIDIA.

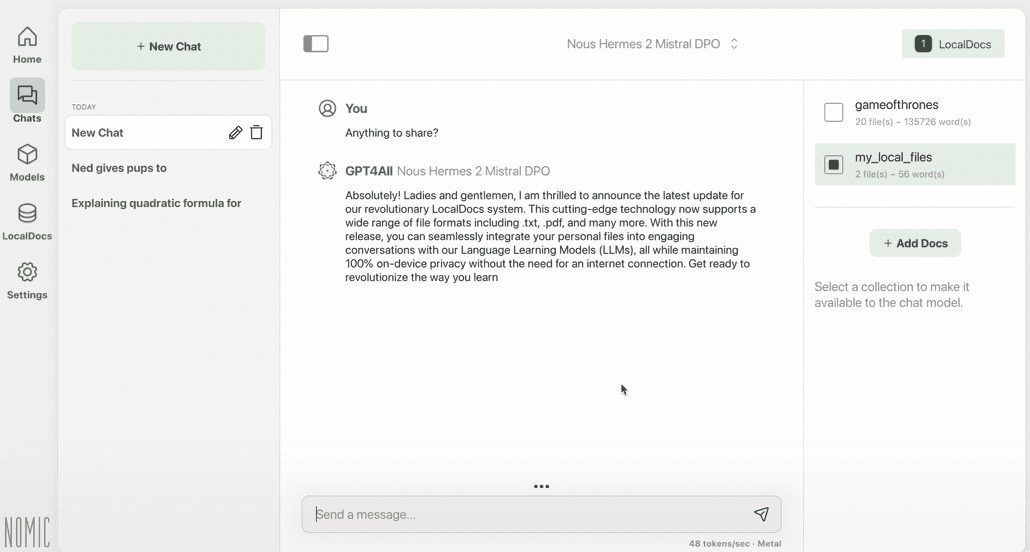

Chat avec des fichiers locaux

Utilisez LocalDocs pour permettre à votre LLM local d'accéder à vos informations privées et sensibles. Il fonctionne sans Internet et aucune donnée ne quitte votre appareil.

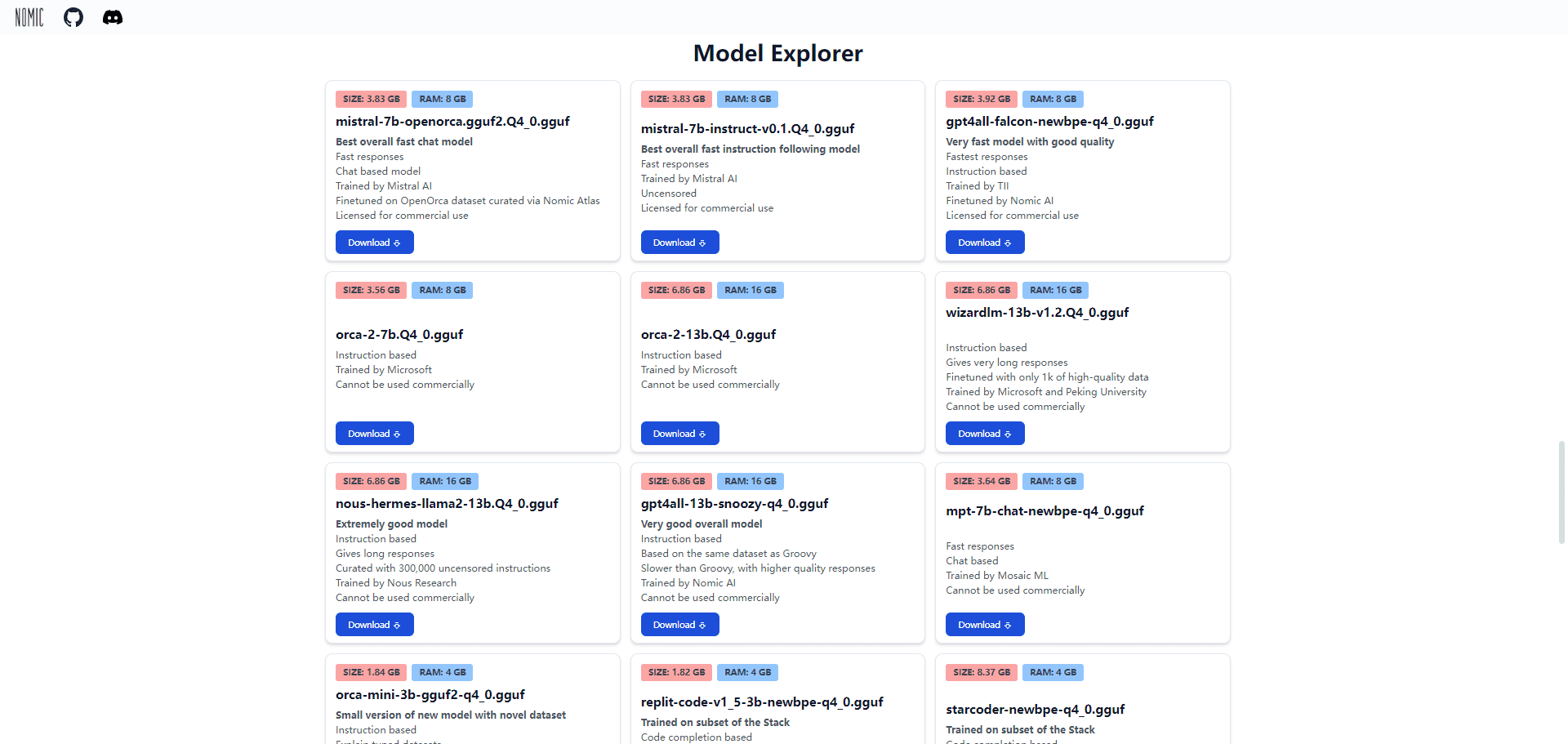

Explorer plus de 1000 modèles linguistiques open source

GPT4All prend en charge LLaMa, Mistral, Nous-Hermes et des centaines d'autres modèles populaires.

Liste des fonctions

- opération localeLes LLM : Exécutez les LLM sur votre appareil local sans connexion Internet.

- Vie privéeLes données sont stockées localement afin de garantir la confidentialité de l'utilisateur.

- Prise en charge de matériels multiplesCompatible avec les puces Mac série M, les GPU AMD et NVIDIA.

- communauté open sourceLes modèles à code source ouvert et le soutien de la communauté sont riches.

- PersonnalisationLes utilisateurs peuvent personnaliser les messages-guides du chatbot, la température, la durée du contexte et d'autres paramètres.

- Édition EntrepriseLes services d'assistance et de fonctionnalité de l'entreprise pour les déploiements à grande échelle.

Utiliser l'aide

Processus d'installation

- Télécharger le dossier de candidature: :

- entretiens Site officiel de Nomic Téléchargez le paquet d'installation pour Windows, macOS ou Ubuntu.

- Les utilisateurs de Windows et de Linux doivent s'assurer que l'appareil est équipé d'un processeur Intel Core i3 2nd Gen / AMD Bulldozer ou supérieur.

- Les utilisateurs de macOS doivent utiliser Monterey 12.6 ou une version ultérieure, qui fonctionne mieux sur les processeurs Apple Silicon M-series.

- Installation des applications: :

- Utilisateurs de Windows : Exécutez le programme d'installation téléchargé et suivez les instructions pour terminer l'installation.

- Utilisateurs de macOS : Faites glisser l'application téléchargée dans le dossier Applications.

- Utilisateurs d'Ubuntu : Installez le fichier de paquetage téléchargé à l'aide de la ligne de commande.

- Lancer l'application: :

- Une fois l'installation terminée, ouvrez l'application GPT-4All et suivez les instructions pour la configuration initiale.

Lignes directrices pour l'utilisation

- Exécution du modèle local: :

- Après avoir ouvert l'application, sélectionnez le modèle linguistique souhaité pour le télécharger et le charger.

- Un large éventail de modèles est pris en charge, notamment LLaMa, Mistral, Nous-Hermes et d'autres.

- Chatbots personnalisés: :

- Ajustez les paramètres tels que les alertes système, la température et la durée du contexte dans les paramètres afin d'optimiser l'expérience de chat.

- Utilisez la fonction LocalDocs pour permettre aux LLM locaux d'accéder à vos données privées sans connexion Internet.

- Caractéristiques de l'édition Enterprise: :

- Les utilisateurs professionnels peuvent contacter Nomic pour obtenir une licence Enterprise Edition afin de bénéficier d'une assistance et de fonctionnalités supplémentaires.

- L'édition Enterprise convient aux déploiements à grande échelle et offre une sécurité et une assistance accrues.

- Soutien communautaire: :

- Rejoignez la communauté GPT-4All pour participer aux discussions et contribuer au code.

- entretiens Dépôt GitHub Obtenir les dernières mises à jour et la documentation.

problèmes courants

- Comment garantir la confidentialité des données ? GPT-4All Toutes les données sont stockées localement sur l'appareil, ce qui garantit le respect de la vie privée de l'utilisateur.

- Une connexion internet est-elle nécessaire ? Non. Le GPT-4All peut être exécuté complètement hors ligne sur un appareil local.

- Quel est le matériel pris en charge ? Prend en charge les puces Mac série M, les GPU AMD et NVIDIA, ainsi que les ordinateurs de bureau et portables courants.

Analyse comparative du modèle GPT4All

| Modèle | BoolQ | PIQA | HellaSwag | WinoGrande | ARC-e | ARC-c | OBQA | Moyenne |

|---|---|---|---|---|---|---|---|---|

| GPT4All-J 6B v1.0 | 73.4 | 74.8 | 63.4 | 64.7 | 54.9 | 36 | 40.2 | 58.2 |

| GPT4All-J v1.1-breezy | 74 | 75.1 | 63.2 | 63.6 | 55.4 | 34.9 | 38.4 | 57.8 |

| GPT4All-J v1.2-jazzy | 74.8 | 74.9 | 63.6 | 63.8 | 56.6 | 35.3 | 41 | 58.6 |

| GPT4All-J v1.3-groovy | 73.6 | 74.3 | 63.8 | 63.5 | 57.7 | 35 | 38.8 | 58.1 |

| GPT4All-J Lora 6B | 68.6 | 75.8 | 66.2 | 63.5 | 56.4 | 35.7 | 40.2 | 58.1 |

| GPT4All LLaMa Lora 7B | 73.1 | 77.6 | 72.1 | 67.8 | 51.1 | 40.4 | 40.2 | 60.3 |

| GPT4All 13B snoozy | 83.3 | 79.2 | 75 | 71.3 | 60.9 | 44.2 | 43.4 | 65.3 |

| GPT4All Falcon | 77.6 | 79.8 | 74.9 | 70.1 | 67.9 | 43.4 | 42.6 | 65.2 |

| Nous-Hermes | 79.5 | 78.9 | 80 | 71.9 | 74.2 | 50.9 | 46.4 | 68.8 |

| Nous-Hermes2 | 83.9 | 80.7 | 80.1 | 71.3 | 75.7 | 52.1 | 46.2 | 70.0 |

| Nous-Puffin | 81.5 | 80.7 | 80.4 | 72.5 | 77.6 | 50.7 | 45.6 | 69.9 |

| Dolly 6B | 68.8 | 77.3 | 67.6 | 63.9 | 62.9 | 38.7 | 41.2 | 60.1 |

| Dolly 12B | 56.7 | 75.4 | 71 | 62.2 | 64.6 | 38.5 | 40.4 | 58.4 |

| Alpaga 7B | 73.9 | 77.2 | 73.9 | 66.1 | 59.8 | 43.3 | 43.4 | 62.5 |

| Alpaca Lora 7B | 74.3 | 79.3 | 74 | 68.8 | 56.6 | 43.9 | 42.6 | 62.8 |

| GPT-J 6.7B | 65.4 | 76.2 | 66.2 | 64.1 | 62.2 | 36.6 | 38.2 | 58.4 |

| LLama 7B | 73.1 | 77.4 | 73 | 66.9 | 52.5 | 41.4 | 42.4 | 61.0 |

| LLama 13B | 68.5 | 79.1 | 76.2 | 70.1 | 60 | 44.6 | 42.2 | 63.0 |

| Pythia 6.7B | 63.5 | 76.3 | 64 | 61.1 | 61.3 | 35.2 | 37.2 | 56.9 |

| Pythie 12B | 67.7 | 76.6 | 67.3 | 63.8 | 63.9 | 34.8 | 38 | 58.9 |

| Fastchat T5 | 81.5 | 64.6 | 46.3 | 61.8 | 49.3 | 33.3 | 39.4 | 53.7 |

| Fastchat Vicuña 7B | 76.6 | 77.2 | 70.7 | 67.3 | 53.5 | 41.2 | 40.8 | 61.0 |

| Fastchat Vicuña 13B | 81.5 | 76.8 | 73.3 | 66.7 | 57.4 | 42.7 | 43.6 | 63.1 |

| StableVicuña RLHF | 82.3 | 78.6 | 74.1 | 70.9 | 61 | 43.5 | 44.4 | 65.0 |

| StableLM Tuned | 62.5 | 71.2 | 53.6 | 54.8 | 52.4 | 31.1 | 33.4 | 51.3 |

| Base StableLM | 60.1 | 67.4 | 41.2 | 50.1 | 44.9 | 27 | 32 | 46.1 |

| Koala 13B | 76.5 | 77.9 | 72.6 | 68.8 | 54.3 | 41 | 42.8 | 62.0 |

| Open Assistant Pythia 12B | 67.9 | 78 | 68.1 | 65 | 64.2 | 40.4 | 43.2 | 61.0 |

| Mosaïque MPT7B | 74.8 | 79.3 | 76.3 | 68.6 | 70 | 42.2 | 42.6 | 64.8 |

| Mosaïque mpt-instruct | 74.3 | 80.4 | 77.2 | 67.8 | 72.2 | 44.6 | 43 | 65.6 |

| Mosaïque mpt-chat | 77.1 | 78.2 | 74.5 | 67.5 | 69.4 | 43.3 | 44.2 | 64.9 |

| Magicien 7B | 78.4 | 77.2 | 69.9 | 66.5 | 56.8 | 40.5 | 42.6 | 61.7 |

| Magicien 7B non censuré | 77.7 | 74.2 | 68 | 65.2 | 53.5 | 38.7 | 41.6 | 59.8 |

| Wizard 13B non censuré | 78.4 | 75.5 | 72.1 | 69.5 | 57.5 | 40.4 | 44 | 62.5 |

| GPT4-x-Vicuna-13b | 81.3 | 75 | 75.2 | 65 | 58.7 | 43.9 | 43.6 | 63.2 |

| Falcon 7b | 73.6 | 80.7 | 76.3 | 67.3 | 71 | 43.3 | 44.4 | 65.2 |

| Instructeur Falcon 7b | 70.9 | 78.6 | 69.8 | 66.7 | 67.9 | 42.7 | 41.2 | 62.5 |

| texte-davinci-003 | 88.1 | 83.8 | 83.4 | 75.8 | 83.9 | 63.9 | 51 | 75.7 |

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...