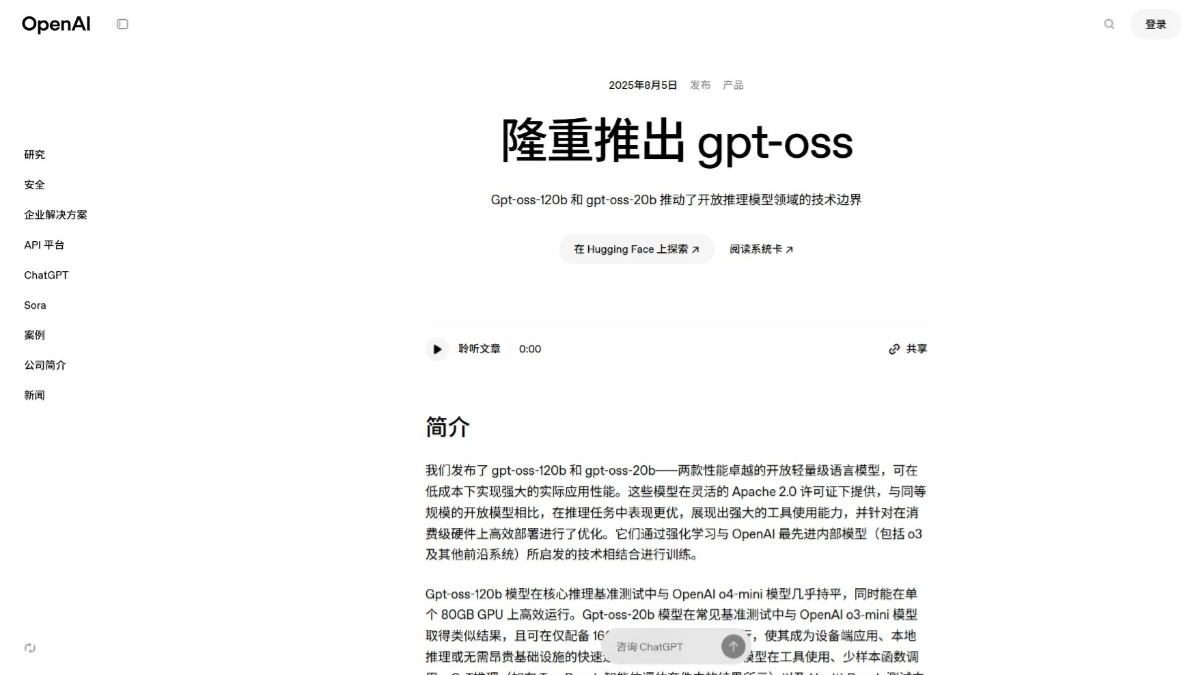

gpt-oss - une famille de modèles d'inférence open source d'OpenAI

Qu'est-ce que gpt-oss ?

gpt-oss est la famille de modèles d'inférence open source d'OpenAI qui permet aux développeurs de disposer de solutions d'IA efficaces, flexibles et faciles à déployer. gpt-oss se compose de deux versions, gpt-oss-120B, avec 117 milliards de paramètres et la prise en charge de l'exécution sur des GPU de 80 Go, et gpt-oss-20B, avec 21 milliards de paramètres et la prise en charge de l'utilisation sur des appareils ordinaires dotés de 16 Go de mémoire vive. gpt-oss-20B, avec 21 milliards de paramètres pour une utilisation sur un appareil normal avec 16 Go de RAM. Tous deux sont basés sur l'architecture MoE, prennent en charge une longueur de contexte de 128k et ont une inférence rapide avec des performances proches de celles de o4-mini et de gpt-oss-20B. o3-minigpt-oss prend en charge l'invocation d'outils, le raisonnement en chaîne, convient aux tâches d'inférence en plusieurs étapes, fournit des pondérations open source et des fonctions d'ajustement de la force d'inférence pour répondre à différents scénarios.

Principales caractéristiques de gpt-oss

- Capacités d'outillageLes outils d'aide à la résolution de tâches complexes : prise en charge de l'appel d'outils externes, tels que les recherches sur le web ou l'exécution de code Python, pour aider à résoudre des tâches complexes.

- Aide au raisonnement en chaîneLe modèle décompose les tâches complexes étape par étape, puis les résout une par une, et convient pour traiter les problèmes qui nécessitent un raisonnement en plusieurs étapes.

- faible besoin en ressourcesLe gpt-oss-20B peut être exécuté sur un appareil ordinaire doté de 16 Go de RAM, et le gpt-oss-120B peut être exécuté sur un seul GPU de 80 Go, ce qui peut être adapté à différents environnements matériels.

- Réponse rapide à l'inférenceLe modèle est capable d'une vitesse d'inférence de 40 à 50 tokens/s et donne de bons résultats dans les scénarios qui exigent des réponses rapides.

- Open Source et personnalisationLes utilisateurs peuvent les ajuster et les personnaliser localement afin de mieux répondre aux exigences de tâches spécifiques.

- Force d'inférence réglableSection : prend en charge des paramètres de force d'inférence faibles, moyens et élevés, que les utilisateurs ajustent en fonction de leurs besoins et scénarios spécifiques, en équilibrant le rapport entre la latence et la performance afin d'obtenir la meilleure utilisation.

L'adresse du site officiel de gpt-oss

- Site web du projet: : https://openai.com/zh-Hans-CN/index/introducing-gpt-oss/

- Dépôt GitHub: : https://github.com/openai/gpt-oss

- Bibliothèque de modèles HuggingFace: : https://huggingface.co/collections/openai/gpt-oss-68911959590a1634ba11c7a4

- Démonstration de l'expérience en ligne: : https://gpt-oss.com/

Performance de gpt-oss

- Programmation du concoursgpt-oss-120B a obtenu un score de 2622 et gpt-oss-20B un score de 2516 dans le test de programmation du concours Codeforces. Les deux versions ont obtenu de meilleurs résultats que certains modèles à code source ouvert, et un peu moins que les modèles à code source fermé. o3-mini et o4-mini, démontrant de fortes capacités de programmation.

- Résolution de problèmes génériquesLe résultat est le suivant : gpt-oss-120B surpasse o3-mini d'OpenAI et se rapproche du niveau de o4-mini dans les tests MMLU (Multi-task Language Understanding - Compréhension de la langue multitâche) et HLE (Human Level Evaluation - Évaluation du niveau humain). Cela montre que gpt-oss a une grande précision et une grande capacité de raisonnement logique lorsqu'il traite des problèmes génériques.

- Appel d'outilLe résultat est le suivant : gpt-oss-120B et gpt-oss-20B sont plus performants que o3-mini d'OpenAI dans la TauBench Intelligent Body Evaluation Suite, et atteignent ou dépassent même le niveau de o4-mini. Cela montre que gpt-oss a une grande efficacité et une grande précision dans l'invocation d'outils externes (recherche sur le web, interpréteur de code, etc.) et qu'il peut résoudre efficacement des problèmes complexes.

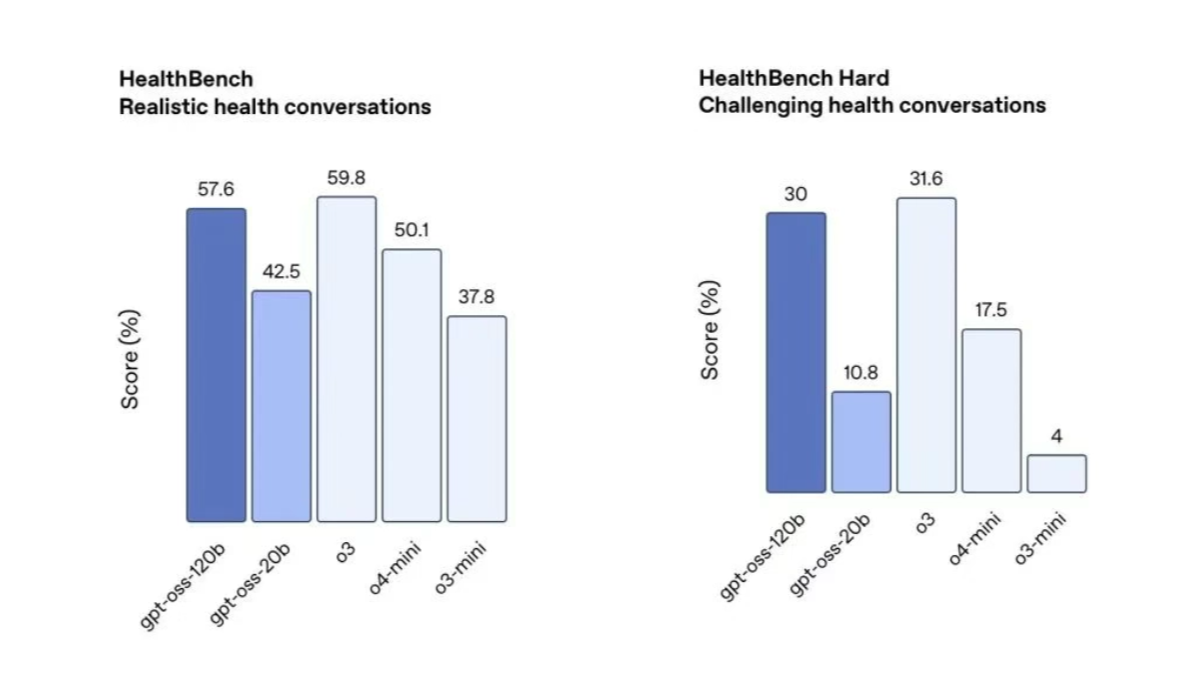

- Questions et réponses sur la santéDans le test HealthBench, gpt-oss-120B surpasse l'o4-mini, et gpt-oss-20B atteint un niveau comparable à l'o3-mini. Cela montre que gpt-oss a une grande précision et une grande fiabilité dans le traitement des questions liées à la santé et qu'il peut fournir des conseils et des informations utiles aux utilisateurs.

Comment utiliser gpt-oss

- Plate-forme d'expérience en ligne: :

- Adresse de l'expérience en ligneLe site Internet de la Commission européenne : Visitez l'expérience en ligne à l'adresse suivante : https://gpt-oss.com/

- procédure: :

- Ouvrez le lien ci-dessus.

- Saisir une question ou une instruction sur la page web.

- Cliquez sur "Soumettre" pour obtenir une réponse du modèle.

- Déploiement du dépôt GitHub: :

- Visitez le dépôt GitHub à l'adresse suivante: : https://github.com/openai/gpt-oss

- entrepôt de clones: :

git clone https://github.com/openai/gpt-oss.git

cd gpt-oss- Installation des dépendances: :

pip install -r requirements.txt- Télécharger le modèle de poidsSélectionnez le fichier de poids pour gpt-oss-20b ou gpt-oss-120b selon le cas et placez-le dans le répertoire spécifié.

- modèle opérationnelExécuter le script d'inférence du modèle en suivant les instructions du référentiel. Exemple :

python run_inference.py --model gpt-oss-20b --input "你的输入文本"Principaux avantages du gpt-oss

- Source ouverte et flexibilitéLes poids et le code du modèle sont fournis pour permettre un réglage fin et une personnalisation au niveau local afin de répondre à des besoins spécifiques.

- Performances d'inférence efficacesLes systèmes d'inférence peuvent atteindre des vitesses de 40 à 50 tokens/s, avec une faible latence pour les scénarios de réponse rapide.

- Large éventail d'applicationsL'entreprise prend en charge un large éventail d'environnements matériels, depuis les appareils moyens dotés de 16 Go de RAM jusqu'aux appareils très performants équipés de GPU de 80 Go.

- Un raisonnement solideLe système de gestion de l'information de l'Union européenne (UE) : il prend en charge le raisonnement en chaîne et l'invocation d'outils, ce qui permet de résoudre des problèmes complexes étape par étape et d'élargir l'éventail des applications.

- Sécurité et fiabilitéLa phase de pré-entraînement permet de filtrer les données nuisibles et d'effectuer un réglage fin contradictoire afin de garantir la sécurité et la fiabilité du modèle.

Personnes auxquelles s'adresse le gpt-oss

- Développeurs et ingénieursLes développeurs et les ingénieurs ont besoin de modèles open source pour le développement de projets, le prototypage rapide ou la personnalisation, et la flexibilité et le code open source fournis par les modèles peuvent répondre à ces besoins.

- Scientifiques des données et chercheursLes scientifiques des données et les chercheurs s'intéressent aux mécanismes internes du modèle et souhaitent les affiner, les expérimenter ou les étudier, et la nature open-source du modèle leur permet d'explorer et d'optimiser le modèle en profondeur.

- utilisateur professionnelLes utilisateurs professionnels ont besoin de modèles d'inférence performants et peu coûteux pour le service client intelligent, l'analyse de données ou les tâches d'automatisation, où la gratuité commerciale et les capacités d'inférence efficaces du modèle sont idéales.

- Éducateurs et étudiantsDans le domaine de l'éducation, il s'agit d'une aide à l'apprentissage qui permet aux étudiants de répondre à des questions, de fournir des conseils de rédaction ou d'effectuer des exercices de programmation.

- travailleur créatifLe modèle aide les écrivains, les scénaristes, les développeurs de jeux, etc. à générer du contenu créatif, à s'inspirer et à améliorer l'efficacité de la création.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...