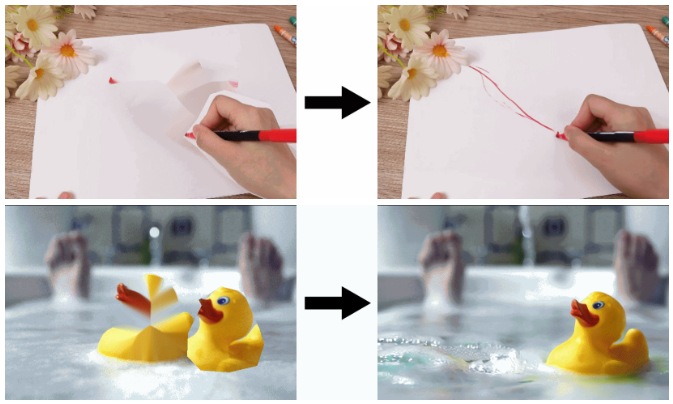

Go-with-the-Flow : contrôle le mouvement des objets dans la vidéo, en ajoutant ou en soustrayant tout objet en mouvement dans la vidéo.

Introduction générale

Go-with-the-Flow est un projet open source développé par l'équipe de recherche de Netflix Eyeline Studios pour contrôler les modèles de mouvement des modèles de diffusion vidéo en déformant le bruit. Le projet permet aux utilisateurs de déterminer comment les caméras et les objets d'une scène se déplacent, et même de transférer des modèles de mouvement d'une vidéo à l'autre. Go-with-the-Flow y parvient en affinant le modèle sous-jacent sans modifier le pipeline ou l'architecture d'origine. Le code et les modèles du projet sont libres et peuvent être librement utilisés et modifiés par les utilisateurs.

Nœud ComfyUI : https://github.com/kijai/ComfyUI-VideoNoiseWarp

Liste des fonctions

- Contrôle des mouvements de cisaillement et de traînéeLes utilisateurs peuvent créer des vidéos en coupant différentes parties d'une image et en les faisant glisser.

- Prolifération des vidéosLa transformation d'une animation grossière en une belle animation nécessite l'utilisation de la GPU.

- bruit distorsionLes mouvements sont plus naturels si l'on utilise un bruit déformé au lieu d'un bruit gaussien pur.

- Changement de mode de mouvement: Appliquer des motifs de mouvement d'une vidéo à une autre.

- Interface utilisateur graphique (GUI): Fournit une interface graphique native pour les animations créées par l'utilisateur.

- source ouverteLe code et les modèles sont en libre accès et peuvent être librement consultés et modifiés par les utilisateurs.

Utiliser l'aide

Processus d'installation

- Entrepôt de clonage :

git clone https://github.com/VGenAI-Netflix-Eyeline-Research/Go-with-the-Flow.git

cd Go-with-the-Flow

- Installer les dépendances locales :

pip install -r requirements_local.txt

- Exécuter l'interface graphique :

python cut_and_drag_gui.py

Suivez les instructions de l'interface graphique pour terminer l'opération, et les fichiers MP4 générés doivent être transférés vers un ordinateur équipé d'un GPU pour un traitement ultérieur.

Processus d'utilisation

- Clonez le dépôt et installez les dépendances sur un ordinateur équipé d'un GPU :

git clone https://github.com/VGenAI-Netflix-Eyeline-Research/Go-with-the-Flow.git

cd Go-with-the-Flow

pip install -r requirements.txt

- Bruit de distorsion :

python make_warped_noise.py <视频路径或 URL> --output_folder noise_warp_output_folder

- Raisonnement en cours d'exécution :

python cut_and_drag_inference.py noise_warp_output_folder \

--prompt "A duck splashing" \

--output_mp4_path "output.mp4" \

--device "cuda" \

--num_inference_steps 5

Ajustez les chemins d'accès aux dossiers, les mots clés et d'autres hyperparamètres si nécessaire. La sortie sera sauvegardée sous le nom de output.mp4.

Principales fonctions

- Contrôle des mouvements de cisaillement et de traînéeLes animations : Sélectionnez différentes parties de l'image dans l'interface graphique et faites-les glisser pour créer des animations approximatives.

- Prolifération des vidéosLes animations : Transférez des fichiers d'animation bruts vers un ordinateur équipé d'un GPU et exécutez des scripts d'inférence pour générer de superbes animations.

- bruit distorsion: Utilisation

make_warped_noise.pyLe script génère des bruits de distorsion pour des effets de mouvement plus naturels. - Changement de mode de mouvementApplication de modèles de mouvement d'une vidéo à une autre en ajustant les repères et les hyperparamètres.

Procédure d'utilisation détaillée

- Couper et faire glisserLe logiciel d'animation : Chargez une image dans l'interface graphique et utilisez la souris pour sélectionner et faire glisser différentes parties de l'image afin de créer des animations approximatives.

- Générer du bruit déforméFonctionne sur un ordinateur équipé d'un processeur graphique (GPU)

make_warped_noise.pyqui génère le fichier de bruit de distorsion. - raisonnement en cours d'exécution: Utilisation

cut_and_drag_inference.pyDes scripts qui convertissent des animations brutes en belles animations pour les convertir en fichiers MP4. - Paramètres de réglageLes résultats de l'analyse des données de l'enquête sont présentés dans le tableau suivant : Ajustez les repères, les hyperparamètres et les chemins d'accès aux fichiers si nécessaire pour obtenir les meilleurs résultats.

Avec les étapes ci-dessus, les utilisateurs peuvent facilement créer et contrôler les modèles de mouvement de la vidéo pour une génération et une animation vidéo de haute qualité.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...