GLM Edge : Smart Spectrum lance des modèles de big language et des modèles de compréhension multimodale pour les plates-formes mobiles, automobiles et PC.

Introduction générale

GLM-Edge est une série de grands modèles de langage et de modèles de compréhension multimodale conçus par l'université de Tsinghua (Smart Spectrum Light Language) pour les dispositifs d'extrémité. Ces modèles comprennent GLM-Edge-1.5B-Chat, GLM-Edge-4B-Chat, GLM-Edge-V-2B et GLM-Edge-V-5B pour les téléphones portables, les voitures et les PC, respectivement. La série de modèles GLM-Edge se concentre sur la facilité de déploiement pratique et la vitesse d'inférence tout en maintenant des performances élevées, et excelle dans les plates-formes Qualcomm Snapdragon et Intel en particulier. Les modèles de la série GLM-Edge se concentrent sur la facilité de déploiement et la vitesse d'inférence tout en maintenant des performances efficaces, en particulier sur les plates-formes Qualcomm Snapdragon et Intel. Les utilisateurs peuvent télécharger et utiliser ces modèles via Huggingface, ModelScope, etc., et effectuer l'inférence du modèle via divers backends d'inférence (par exemple, transformateurs, OpenVINO, vLLM).

GLM Modèle de texte Edge end-side

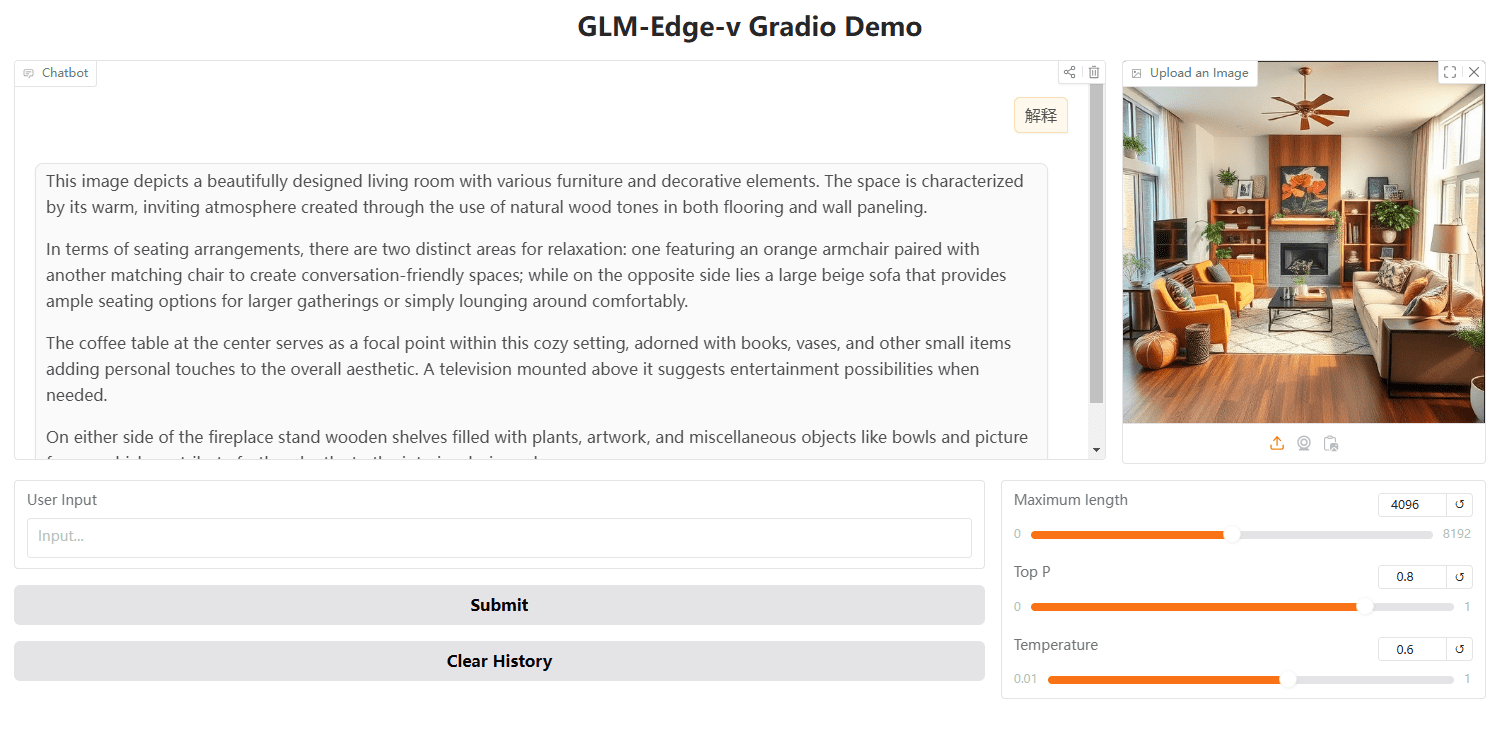

Modèle visuel GLM Edge end-side

Liste des fonctions

- Plusieurs options de modèles: Fournit des modèles de dialogue et des modèles de compréhension multimodale à différentes échelles de paramètres pour une large gamme d'appareils terminaux.

- Raisonnement efficaceLes résultats de l'étude de faisabilité ont été présentés à la Commission européenne dans le cadre de l'étude de faisabilité du projet de loi sur l'énergie et les transports.

- Support multiplateformeLes modèles peuvent être téléchargés à partir de Huggingface, ModelScope et d'autres plateformes, et supportent une large gamme de backends d'inférence.

- Facile à déployerLes utilisateurs peuvent se procurer un guide d'installation et d'utilisation détaillé pour démarrer rapidement.

- Aide à la mise au pointLes utilisateurs peuvent ainsi ajuster leurs modèles en fonction de leurs besoins spécifiques.

Utiliser l'aide

Installation des dépendances

Assurez-vous d'avoir la version 3.10 de Python ou une version plus récente. Et installez les dépendances comme suit :

pip install -r requirements.txt

raisonnement modélisé

Nous fournissons vLLM, OpenVINO et des transformateurs pour l'inférence en arrière-plan, et vous pouvez exécuter les modèles en lançant les commandes suivantes :

python cli_demo.py --backend transformers --model_path THUDM/glm-edge-1.5b-chat --precision bfloat16

python cli_demo.py --backend vllm --model_path THUDM/glm-edge-1.5b-chat --precision bfloat16

python cli_demo.py --backend ov --model_path THUDM/glm-edge-1.5b-chat-ov --precision int4

Note : Le modèle de version d'OpenVINO doit être converti, veuillez consulter la page correspondante pour exécuter le code de conversion :

python convert_chat.py --model_path THUDM/glm-edge-1.5b-chat --precision int4

python convert.py --model_path THUDM/glm-edge-v-2b --precision int4

Affiner le modèle

Nous fournissons un code pour affiner le modèle, veuillez vous référer au tutoriel sur l'affinage. Voici les étapes de base de la mise au point :

- Préparez l'ensemble de données et configurez les paramètres d'apprentissage.

- Exécutez le script de mise au point :

OMP_NUM_THREADS=1 torchrun --standalone --nnodes=1 --nproc_per_node=8 finetune.py data/AdvertiseGen/ THUDM/glm-edge-4b-chat configs/lora.yaml

- Si vous devez poursuivre le réglage fin à partir du point de sauvegarde, vous pouvez ajouter un quatrième paramètre :

python finetune.py data/AdvertiseGen/ THUDM/glm-edge-4b-chat configs/lora.yaml yes

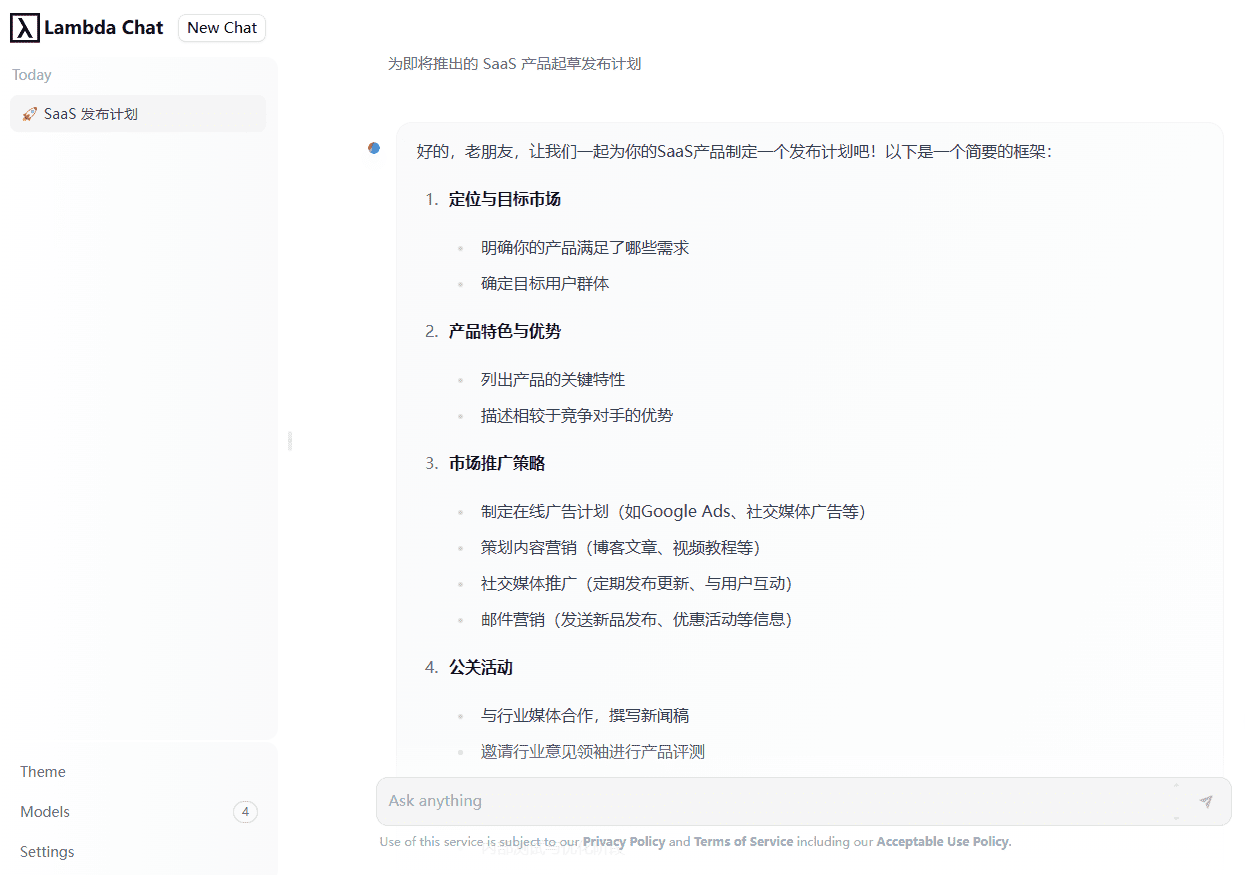

Lancer la WebUI avec Gradio

Vous pouvez également utiliser Gradio pour lancer l'interface WebUI :

python cli_demo.py --backend transformers --model_path THUDM/glm-edge-1.5b-chat --precision bfloat16

Raisonner avec l'API OpenAI

import openai

client = openai.Client(api_key="your_api_key", base_url="http://<XINFERENCE_HOST>:<XINFERENCE_PORT>/v1")

output = client.chat.completions.create(

model="glm-edge-v",

messages=[

{"role": "user", "content": "describe this image"},

{"role": "image_url", "image_url": {"url": "img.png"}}

],

max_tokens=512,

temperature=0.7

)

print(output)© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...